Démystifier le mode effet film de l’iPhone 13, voici comment Apple l’a fait

Je me souviens avoir regardé un documentaire quand j'étais jeune, qui expliquait la division du travail derrière le film. Et les photographes sont souvent accompagnés d'un préposé au "follow-focuser", ce qui est comme si chaque golfeur avait un caddie, et chaque joueur de rallye aura un navigateur, ce qui est presque devenu la norme dans l'industrie cinématographique.

Le suiveur de mise au point s'assure principalement uniquement que le point focal (plan focal) de l'objectif répond aux besoins du directeur de la photographie, c'est-à-dire de s'assurer que le sujet est clair.

Cela semble être un travail assez simple, mais tout le monde ne peut pas le faire. Il a des exigences élevées en matière de vitesse de mise au point et de précision de commutation. Sans des années d'accumulation pour former la mémoire musculaire, il est difficile d'atteindre le point de compétence et il est difficile de basculer avec précision entre les différents points focaux.

Même maintenant que la technologie de mise au point automatique de l'appareil photo a fait de grands progrès, l'industrie cinématographique est toujours indissociable, et elle est toujours entièrement manuelle, et le photographe a toujours un tel "suivi".

Le mouvement de la mise au point mettra en évidence les personnages et peut également mettre en évidence l'environnement. L'instinct de l'œil humain est de suivre un sujet clair. Le changement de mise au point guidera l'attention du public pour se déplacer avec la mise au point, créant ainsi un récit ou une atmosphère. Il a devenir un film, un morceau de langage. Zha Dao devrait avoir son mot à dire.

Si les gens ordinaires veulent filmer de manière similaire à ce genre d'effet "film", si ce n'est pas un stade ultérieur, un appareil photo plein format et un objectif à grande ouverture suffisent, mais d'un point de vue économique et universel, il peut être un score négatif.

Et le "Movie Effect Mode" de cette année sur l'ensemble de la série iPhone 13 peut être un nouveau choix.

Le mode effet film est le mode portrait vidéo

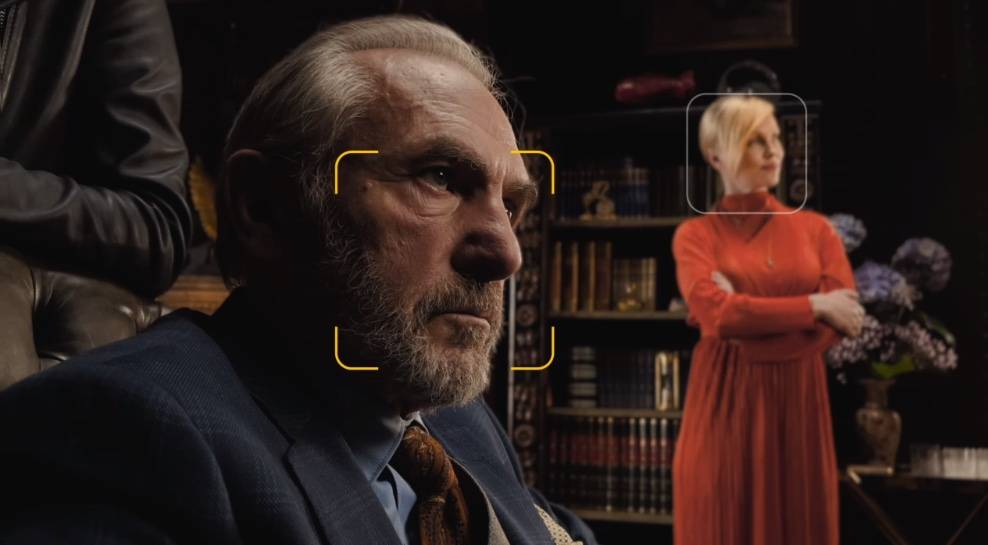

De tous les TVC sur iPhone 13, ceux qui m'ont le plus impressionné étaient "Whodunnit" et "Qui a volé mon iPhone". L'ajout du mode effet de film a grandement amélioré l'histoire de tout le film. Bien sûr, les acteurs de ce dernier sont aussi un gros.

Il est fortement recommandé de regarder le clip complet

En fait, dès avant qu'Apple ne lance l'iPhone 13 le 15 septembre, il y avait des rumeurs correspondantes selon lesquelles Apple lancerait la fonction "portrait vidéo", et ne pensait pas que ce serait très "utile" à ce moment-là.

Mais lorsque nous avons vu la démonstration commerciale de "Whodunnit" et après avoir obtenu la série iPhone 13, nous avons essayé de "reproduire" pendant un certain temps, puis avons progressivement compris que la signification de "mode effet film" était comparable à celle de l'iPhone 7 De plus. Mode portrait".

Ils ne sont pas basés sur la technologie optique classique, mais trouvent une autre voie. L'ancien "mode portrait" et le "mode effet film" actuel sont basés sur la parallaxe multi-objectifs, pas sur LiDAR, ce qui explique pourquoi l'iPhone 13 est pris en charge par tous les systèmes, pas seulement dans la série Pro.

Le but est évident, c'est-à-dire vulgariser comme le "portrait modèle" de l'année.

Votre visage est grand, vous gagnez.

C'est également sur cette base que l'effet de prise de vue du "mode effet film" de l'iPhone 13 est similaire, et la reconnaissance du sujet pour simuler la profondeur de champ se concentrera sur le visage, et sous plusieurs visages, la grande priorité sera étant donné.

Il ne peut pas identifier les objets et les animaux, et il nécessite une intervention manuelle pour basculer. Dans la scène bondée, l'iPhone 13 peut reconnaître plusieurs visages en même temps, mais il changera fréquemment la mise au point. À ce moment-là, il doit également intervenir pour sélectionner la personne que vous souhaitez suivre, ou appuyer directement et maintenir enfoncé pour verrouiller ce.

De plus, le "mode effet film" a été lancé pour la première fois par Apple, et naturellement il existe de nombreuses restrictions. L'une est que la découpe n'est pas assez détaillée, les bords des personnages sont parfois "percés", et les plus hauts ne peuvent enregistrer que des vidéos 1080p 30p, il en va de même pour la version iPhone 13 Pro Max 1 To.

Cependant, sous les restrictions ci-dessus, le "mode effets de film" de l'ensemble de la série iPhone 13 peut toujours prendre en compte l'encodage Dolby Vision HDR, qui est également un choix à peser pour Apple.

"Movie Effect Mode" est en fait né de la curiosité

Dans le passé, l'émergence de nombreuses nouvelles fonctionnalités nécessitait un aperçu des besoins et obtenu à partir des commentaires des utilisateurs, mais Apple, au sommet de la pyramide, a conçu des produits plus conformes à sa propre compréhension et à son propre rythme.

▲ Johnnie Manzari, concepteur d'interface homme-machine d'Apple. Photo de : Getty Images

Dans une interview avec Matthew Panzarino, rédacteur en chef de TechCrunch, le concepteur d'interface homme-machine d'Apple, Johnnie Manzari, a expliqué le début et la fin du modèle d'effet de film.

Le "mode effet film" ne part pas de la fonction elle-même, mais uniquement parce que le département de conception est curieux du processus de réalisation d'un film, l'utilisant comme point de départ pour étudier et apprendre les techniques de photographie argentique, afin d'atteindre conversion de mise au point réelle et certaines caractéristiques optiques.

Dans le même temps, John a déclaré que le développement du "mode effet film" est quelque peu similaire à la fonction photo portrait à effet de lumière en studio qui est apparue sur l'iPhone X.

À partir des portraits du portraitiste classique Andy Warhol (Avedon Warhol), du peintre baroque Rembrandt et de la peinture méticuleuse chinoise, apprenez l'expérience et analysez, puis appliquez-la dans l'algorithme du produit.

Oeuvre d'Andy Warhol (je suis en bas à gauche).

Le "mode effet film" est un processus similaire. L'équipe Apple a d'abord discuté avec des vidéastes de classe mondiale et regardé un grand nombre de films.

Au cours du processus, nous avons découvert des tendances immuables dans le processus de réalisation d'un film. Le changement entre les points focaux est un langage courant dans l'industrie cinématographique, et nous devons comprendre avec précision comment et quand ils sont utilisés.

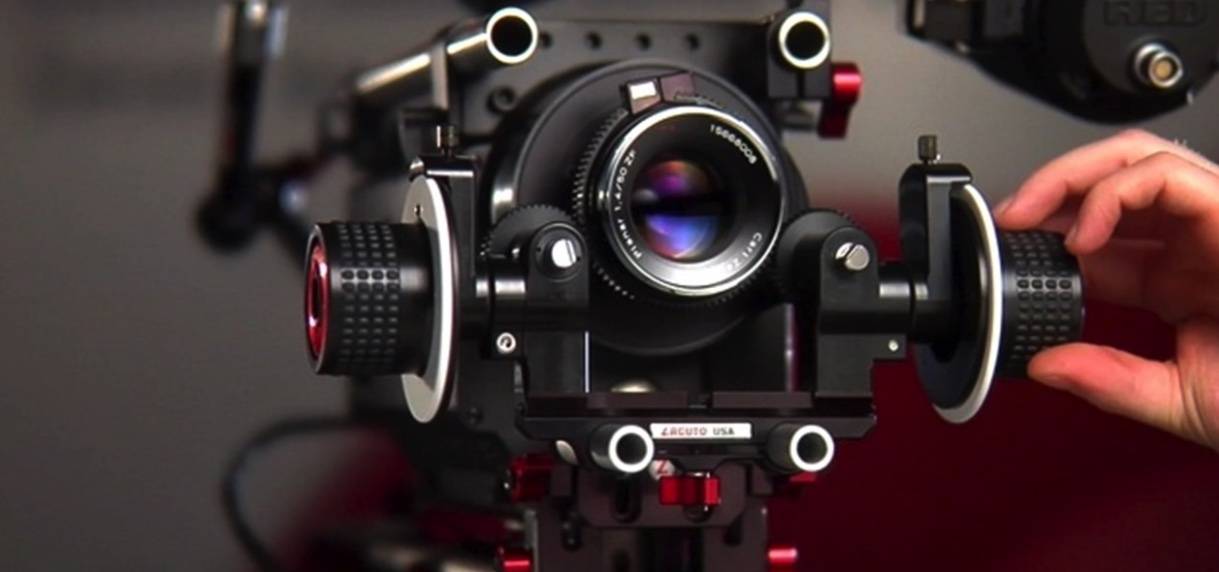

▲Le décalage de la mise au point en « mode effet film''.

Par conséquent, John et les membres de l'équipe ont travaillé en étroite collaboration avec le directeur de la photographie et le premier assistant de la photographie pour comprendre le mécanisme derrière tout cela. L'utilisation d'une faible profondeur de champ peut guider l'attention du public et aider à la description de l'histoire.

Cependant, le "zoom" est destiné aux professionnels, et il est difficile pour les gens ordinaires d'en saisir l'exactitude.

Après avoir su qu'il faut de nombreuses années de pratique pour que le suiveur de mise au point maîtrise la situation en temps réel consistant à maintenir la mise au point constante en fonction de la position de la caméra et du sujet, John, l'équipe de conception et Apple pensent tous que ce "film mode effet" est sur le point d'être commercialisé. "Ce sera une fonctionnalité très compétitive.

Équipement de mise au point simple

Pour cela, en étudiant Apple, le "mode effet film" est décomposé en deux parties, l'une "trouver la mise au point" et l'autre comment transférer en douceur.

Trouver le point focal est finalement défini comme une "détection du regard", qui est en fait plus proche de la détection de visage, afin que le public puisse se concentrer sur le mouvement du protagoniste et guider le public pour comprendre rapidement l'histoire.

Le transfert en douceur est une caractéristique ajoutée par l'observation à long terme de John de la molette de commande de mise au point actionnée par un suiveur. Un suiveur qualifié utilisera la commande du rouleau pour faire bouger la mise au point naturellement et de manière stable, et modifiera également la mise au point en fonction de la focale. longueur de la lentille.La distance de l'objet change en temps réel.

Apple a passé beaucoup de temps en "mode d'effet de film" à essayer de simuler le travail manuel de ce suiveur, nous tournons donc en "mode d'effet de film". Lors de la commutation entre différents points de mise au point, ce n'est pas une poussée et une traction rapides mécaniques , mais Il existe un processus de suivi plus évident.

Bien entendu, le "mode effets cinéma" vient de sortir, tout comme le "mode portrait", il a encore beaucoup à optimiser.

C'est comme si vous voyiez Lang Lang jouer du piano si facilement et librement, mais vous savez qu'il est impossible d'utiliser des algorithmes pour atteindre son niveau de maîtrise.

Le héros derrière le débarquement du "mode effet film" A15

Puisqu'il est "deviné" via un algorithme, en théorie, le "mode effet film" peut être téléchargé sur d'autres iPhones (tels que l'iPhone 12) via OTA, mais la prévisualisation en temps réel peut être sacrifiée. Mais avec la pensée d'Apple, il est difficile de décentraliser de nouvelles fonctionnalités en sacrifiant une certaine expérience.

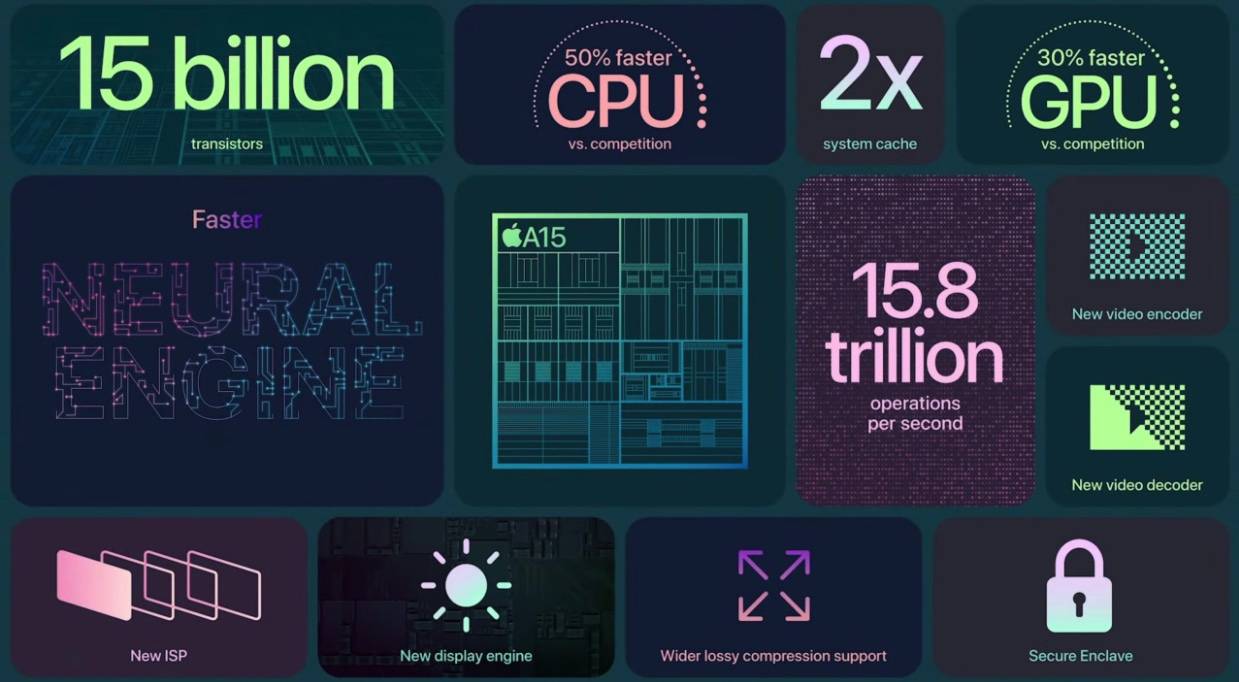

▲ A15 points de mise à niveau, notez que les mises à niveau CPU et GPU sont comparées à celles des concurrents.

Par conséquent, le "mode effet film" sera une fonctionnalité temporairement exclusive de toute la série iPhone 13, et ce sera également un seuil pour la puissance de calcul des puces de la série A, et il pourrait également devenir une nouvelle génération d'iPhone " utilisateurs d'ongles."

Kaiann Drance, vice-président du marketing iPhone, a déclaré dans une interview que faire des vidéos avec une profondeur de champ simulée est plus "difficile" que des portraits.

Kaiann Drance, vice-président du marketing iPhone.

La vidéo doit bouger au fur et à mesure que le sujet bouge, un anti-tremblement en temps réel (numérique plus optique) est requis et différentes scènes, personnes, animaux et objets sont reconnus avec précision. Par conséquent, pour les moteurs neuronaux et l'apprentissage automatique, une profondeur de qualité supérieure est requis Données, et rendu en temps réel.

Oh, et la mise au point en temps réel et la prise en charge de l'encodage Dolby Vision HDR. Et derrière tout cela vient de A15, on peut dire que le jeune âge a assumé la responsabilité importante de toute la famille.

Par rapport au CPU de l'A15, dans le test réel, les performances du GPU se sont considérablement améliorées.Il peut adopter une toute nouvelle architecture et empiler un cœur de plus. De plus, la puissance de calcul du moteur de réseau neuronal de l'A15 a été augmentée à 15,8 TOPS.

Et ces améliorations matérielles peuvent être liées à l'amélioration des fonctions vidéo de la série iPhone 13 cette fois. Le "mode effet film" contient des problèmes d'apprentissage automatique différents des photos statiques. Je pense que lorsque A15 a été développé, l'équipe de conception d'interaction homme-machine de John avait déjà eu des échanges approfondis avec le développement de puces.

Dans la vidéo de test de TechCrunch, ils ont également constaté que le "mode effet film" de la série iPhone 13 utilise des capteurs redondants pour prédire le sujet pendant le processus d'identification des personnes.

Dès que l'arrière de la tête de la fille de Matthew est apparu à l'écran, l'iPhone 13 dans sa main a immédiatement changé la mise au point, comme s'il y avait un réalisateur qui contrôle la situation globale dans une pièce de théâtre. Le protagoniste n'est pas apparu sur scène, et l'éclairage est préparé à l'avance. , Et amener le public à attendre son apparition avec impatience.

Concernant ce détail du "mode film", John, le concepteur d'interaction homme-machine d'Apple, a déclaré :

En observant la production du film, nous avons découvert que le suiveur de mise au point n'attend pas que le protagoniste déplace la mise au point, mais dispose d'un processus de prédiction. Nous utilisons également des capteurs redondants pour prédire le mouvement des personnes en dehors de l'écran grâce à l'apprentissage automatique. Lorsqu'elles apparaissent à l'écran, l'accent est déjà mis sur elles.

Jobs aimait à dire qu'Apple est à l'intersection de la technologie et de l'art.

Avant la sortie de la série iPhone 13, le "mode portrait" ressemblait davantage à un terme technique, et il faisait froid. Quant au "mode effet film" et à la présentation de TVC, il ne fait plus froid, mais avec une certaine température. Après une compréhension approfondie de l'histoire derrière le "mode effet film", il a apporté un peu de "l'art de la prise de vue".

Pour les gens ordinaires, le "mode effet film" n'a peut-être pas une signification aussi profonde. Il ressemble plus à un tournevis à vin rouge dans un couteau suisse. Ce n'est peut-être pas le plus parfait et le plus économique, mais c'est un outil qui peut être utilisé en cas d'urgence. .

Les films nous montrent des émotions et des histoires humaines. Si vous utilisez le bon langage, il sera transmis. En ce moment, nous avons travaillé dur pendant longtemps pour permettre à votre histoire de vie d'être enregistrée et interprétée sur votre téléphone portable. J'ai hâte de voir les histoires écrites par des personnes utilisant le "mode effet film".

#Bienvenue pour suivre le compte officiel WeChat d'Aifaner : Aifaner (WeChat ID : ifanr), un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo