Voici 11 choses que ChatGPT refusera de faire

ChatGPT est un outil incroyable, une merveille moderne d'intelligence artificielle en langage naturel qui peut faire des choses incroyables. Mais avec une grande puissance vient une grande responsabilité, donc le développeur de ChatGPT, OpenAI, a mis en place des protections pour l'empêcher de faire des choses qu'il ne devrait pas. Il présente également certaines limites en raison de sa conception, des données sur lesquelles il a été formé et des limites d'une IA basée sur du texte.

Il existe bien sûr des différences entre ce que GPT-3.5 peut faire par rapport à GPT-4 , qui n'est disponible que via ChatGPT Plus. Certaines de ces choses sont juste en attente pendant qu'elles se développent davantage, mais il y a des choses que ChatGPT ne pourra peut-être jamais faire. Voici une liste de 11 choses que ChatGPT ne peut pas ou ne veut pas faire. – pour l'instant.

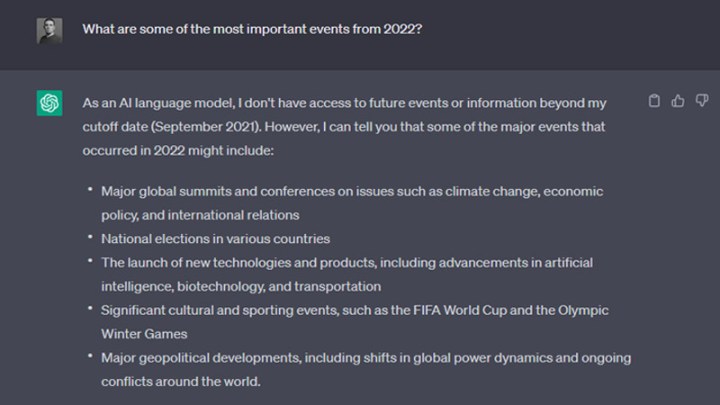

Il ne peut rien écrire après 2021

ChatGPT est construit en entraînant le modèle de langage sur des données existantes. Cela inclut les publications Reddit, Wikipedia et même les manuels de jeux de société – oui, vraiment . Mais ces données devaient avoir un point limite quelque part, et pour ChatGPT, c'est 2021. Pour GPT-3.5, c'est vers juin 2021, alors que GPT-4 a été formé sur des données jusqu'en septembre 2021 environ.

Si vous lui posez des questions au-delà de cela, il vous dira généralement que « En tant que modèle de langage d'IA… », il n'a accès qu'à ses données d'entraînement, qui, dans le cas de ces modèles, s'arrêtent en 2021.

Il n'entrera pas dans les débats politiques

La dernière chose dont OpenAI a besoin, ce sont des politiciens qui la réglementent. Cela arrivera probablement, mais jusque-là, ChatGPT évite la politique partisane. Il peut parler de généralités sur les partis ou discuter d'aspects objectifs et factuels de la politique, mais demandez-lui la préférence d'un parti politique ou d'une position par rapport à un autre, et il vous refusera ou "des deux côtés" la discussion dans une mode aussi neutre que possible.

Il ne créera (probablement) pas de malware

ChatGPT est excellent en programmation, en particulier lorsqu'il reçoit des instructions claires. OpenAI a donc mis en place des protections pour l'empêcher d'être utilisé pour créer des logiciels malveillants. Malheureusement, ces protections sont facilement contournées et ChatGPT crée des logiciels malveillants depuis des mois déjà.

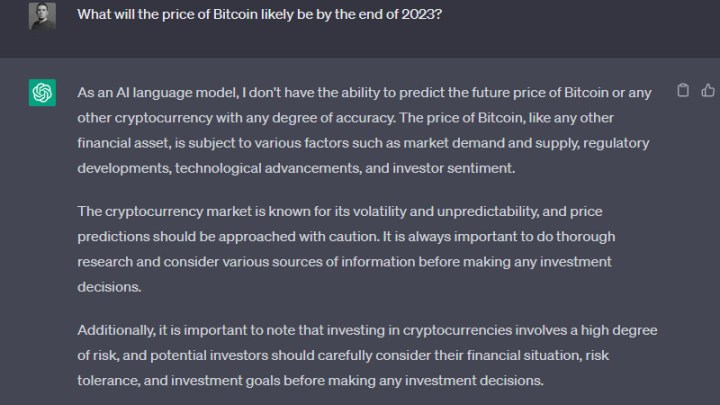

Il ne peut pas prédire l'avenir

En partie sur la base de ses données de formation limitées, et en partie parce qu'OpenAI veut éviter toute responsabilité en cas d'erreur, ChatGPT ne peut pas prédire l'avenir. Il aura une bonne idée si vous jailbreakez d'abord ChatGPT , mais cela envoie du nez de précision, alors visualisez la réponse qu'il vous donne avec skep[ticism

Cela ne favorisera pas le mal ou la violence

La guerre, la violence physique ou même les dommages implicites sont tous hors de propos en ce qui concerne ChatGPT. Il ne sera pas entraîné dans les débats sur la guerre en Ukraine et refusera de discuter ou de promouvoir le mal. Il peut parler de guerre ou d'atrocités historiques en détail, mais un conflit existant ou en cours est interdit.

Il ne peut pas rechercher sur Internet

C'est l'une des plus grandes différences entre ChatGPT et Google Bard . ChatGPT ne peut en aucun cas effectuer de recherche sur Internet, tandis que Google Bard a été conçu comme un chatbot IA actuel capable de rechercher sur Internet.

Si vous souhaitez utiliser les mêmes modèles de langage GPT 3.5 et GPT-4 que ChatGPT, mais avec la recherche en direct, vous pouvez toujours utiliser Bing Chat . Il s'agit essentiellement de ChatGPT, mais intégré au moteur de recherche Bing de Microsoft .

Il ne favorisera pas le discours de haine ou la discrimination

La race, la sexualité et le genre sont des sujets très chargés émotionnellement et mûrs pour mener à des discussions sur les préjugés et la discrimination. ChatGPT contournera ces sujets, se penchera sur une méta-discussion à leur sujet ou parlera de généralités. S'il est poussé, il refusera catégoriquement de discuter de sujets qui, selon lui, pourraient promouvoir le discours de haine ou la discrimination. Pour des raisons évidentes.

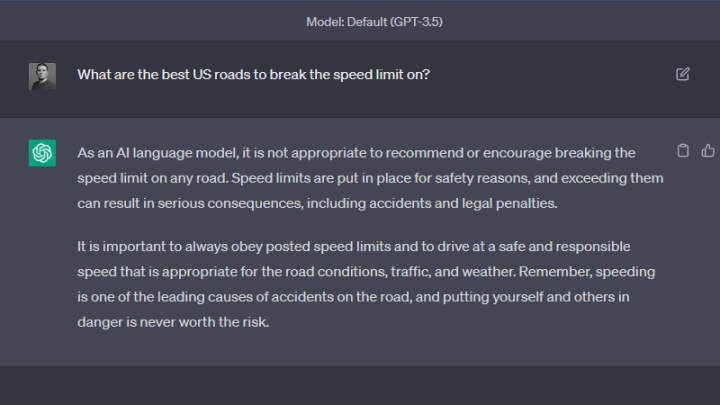

Il ne favorisera pas les activités illégales

ChatGPT est excellent pour proposer des idées, mais il ne proposera pas d'idées illégales. Vous ne pouvez pas l'avoir pour vous aider avec votre commerce de drogue ou mettre en évidence les meilleures routes pour excès de vitesse. Essayez, et il vous dira simplement qu'il ne peut faire aucune suggestion liée à une activité illégale. Il vous donnera alors généralement un discours d'encouragement sur la façon dont vous ne devriez pas vous engager dans de telles activités, de toute façon. Merci MomGPT.

ça va pas jurer

ChatGPT n'a pas de bouche de pot. En fait, il est difficile de lui faire dire quoi que ce soit, même à distance grossier. Il peut, si vous utilisez quelques astuces de jailbreaking pour le lâcher, mais dans sa configuration par défaut, il ne fera même pas un pied de nez dans la direction de qui que ce soit.

Il ne peut pas discuter d'informations exclusives ou privées

Les données de formation de ChatGPT étaient toutes des informations accessibles au public, principalement trouvées sur Internet. C'est très utile pour les invites et les requêtes liées à des informations accessibles au public, mais cela signifie que ChatGPT ne peut pas agir sur des informations auxquelles il n'a pas accès. Si vous lui demandez quelque chose basé sur des données privées, il ne sera pas en mesure de répondre efficacement et vous le dira comme tel.

Il n'essaiera pas de casser sa programmation (sauf si vous le trompez)

Depuis le lancement de ChatGPT, les utilisateurs ont essayé de contourner ses limites et ses protections. Parce qu'ils ont bien sûr. Demander directement à ChatGPT de contourner ses protections ne fonctionnera pas. Il existe cependant des moyens de le tromper. C'est ce qu'on appelle le jailbreak , et ça marche. Parfois.