Les meilleurs outils d’IA d’iOS 18 arrivent en décembre, mais Siri attend plus longtemps

La boîte à outils Apple Intelligence a été témoin d'un mélange échelonné de fonctionnalités retardées et d'avantages décevants. Mais il semble que l’ensemble le plus prometteur de ces outils d’IA dévoilés par Apple à la WWDC plus tôt cette année soit à nos portes.

Dans la dernière édition de sa newsletter PowerOn , Mark Gurman de Bloomberg écrit que la mise à jour iOS 18.2 commencera à être déployée via le canal stable au cours de la première semaine de décembre.

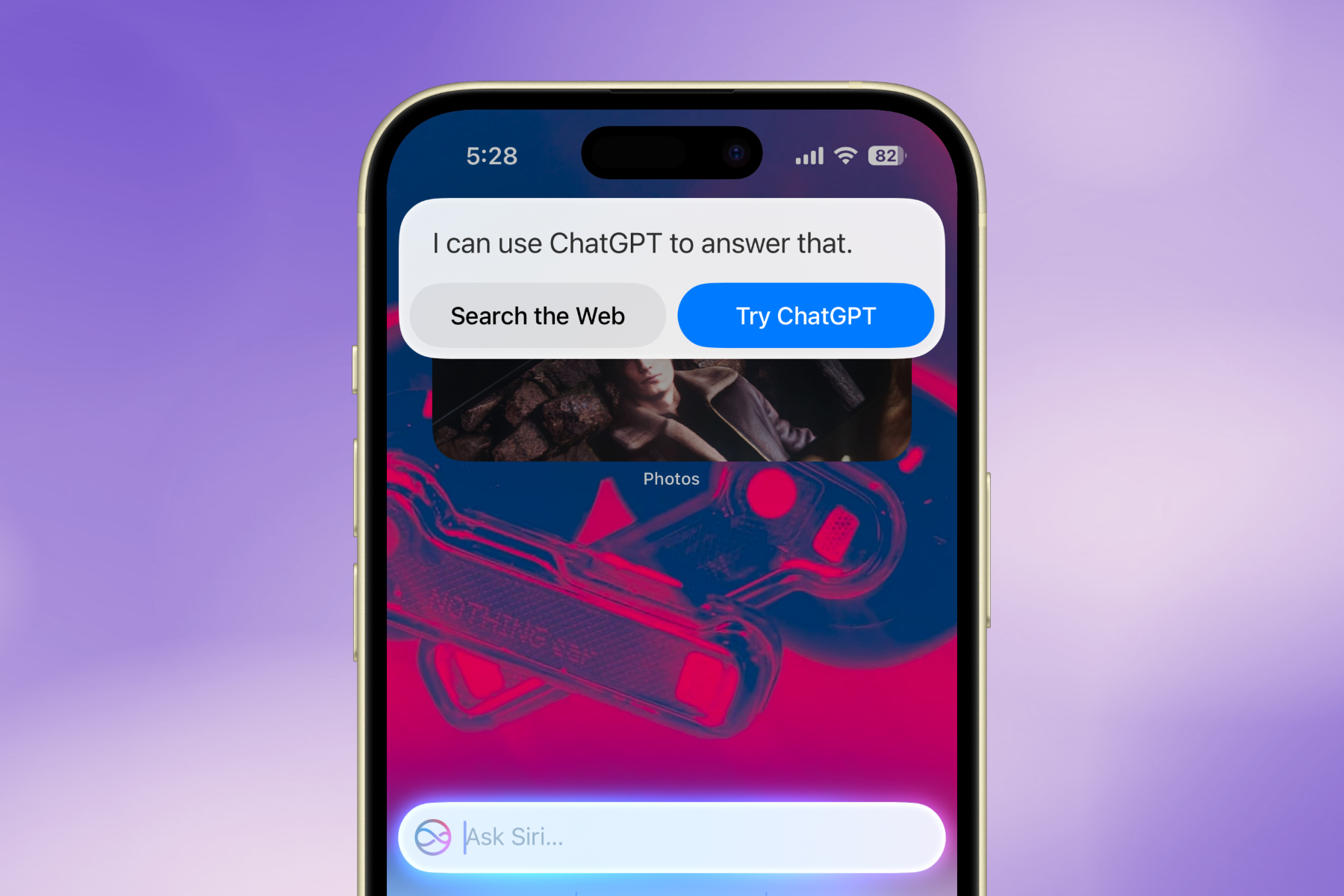

L'itération susmentionnée d'iOS est déjà en phase de test bêta et a introduit un trio de mises à niveau d'IA les plus intéressantes destinées à l'iPhone. Parmi eux se trouve l'intégration de Siri avec ChatGPT d'OpenAI , qui transfère de manière transparente les requêtes complexes vers le chatbot.

Ensuite, nous avons l'intelligence visuelle , qui permet aux utilisateurs de pointer l'appareil photo de leur téléphone vers le monde qui les entoure et d'extraire des informations précieuses sur tout ce qui apparaît dans le cadre. Dans sa version actuelle, il peut accomplir des tâches telles que l'identification d'une race de chien ou la récupération de détails répertoriés sur une affiche.

Cependant, étant donné le niveau profond d'intégration avec la pile d'OpenAI, il ne sera pas surprenant de voir l'intelligence visuelle bénéficier du même ensemble de fonctionnalités que la dernière itération de ChatGPT et de ses propres capacités de compréhension multimodale.

iOS 18.2 bêta a également introduit des astuces telles que l'application autonome Image Playgrounds qui permet aux utilisateurs de créer des images amusantes basées sur leurs propres images. Le système Genmoji personnalisé est également sur la table des mises à jour.

Gurman ajoute qu'avec la mise à jour iOS 18.4, Siri atteindra enfin la forme qui a enthousiasmé les fans pour la véritable renaissance de l'assistant virtuel à l'ère de l'IA. "Il devrait permettre à l'assistant numérique d'exploiter les données des gens et de répondre aux requêtes en fonction des informations affichées sur leurs écrans", écrit-il.

À l'heure actuelle, Gemini de Google est capable d'analyser des fichiers locaux, à la fois du texte et des médias, et de répondre en fonction des informations qu'il a récupérées dans ces fichiers. L'intégration profonde avec Workspace permet à l'IA de jeter un coup d'œil aux fichiers de Google Drive et d'autres outils clés tels que Docs.

L'outil Notebook LM est également capable de faire de même et peut même donner un sens aux vidéos YouTube ainsi qu'aux URL de pages Web tierces sans demander aux utilisateurs un abonnement.

Dans le cas d'Apple, Siri – optimisé par la pile technologique d'OpenAI – sera capable de répondre aux questions en extrayant des informations à partir de fichiers et de données stockés localement sur le téléphone. Imaginez des scénarios tels que l'extraction d'informations de voyage à partir d'un courrier électronique, des détails de planification à partir d'entrées de calendrier et des données professionnelles à partir de PDF et de feuilles.

Cependant, la plus utilitaire de ces fonctionnalités sera une intégration plus approfondie avec des applications tierces. Cela permettrait à l'assistant virtuel d'exécuter des tâches dans des applications tierces uniquement sur la base de commandes vocales ou textuelles.

Notamment, Apple permettra également aux utilisateurs de puiser dans le potentiel d'autres outils tiers , tels que Gemini, à l'avenir. De plus, Siri sera également en mesure de fournir des réponses basées sur le contenu à l'écran.

iOS 18.4 devrait arriver en avril de l’année prochaine. C'est la même fenêtre où Apple devrait lancer l'iPhone SE de nouvelle génération , doté d'un nouveau design, d'un silicium plus rapide et de la prise en charge d'Apple Intelligence.