Expérience de première version Baidu a lancé deux nouveaux modèles pour évaluer DeepSeek. Je leur ai demandé de cueillir des pastèques et de vendre des barbecues. Tous les détails sont ici.

S'il était impossible de progresser sans un modèle GPT-4 auto-développé l'année dernière, l'orientation du développement de l'IA est devenue plus concrète cette année – elle est également impossible sans un modèle d'inférence profonde.

Cela a également inspiré un nouveau cycle de concurrence entre les principaux fabricants dans le domaine de l’IA. En plus d'accéder à DeepSeek, Tencent Yuanbao, Alibaba, etc. ont lancé de manière intensive leurs propres modèles de réflexion profonde pour rivaliser pour les super applications à l'ère de l'IA.

Baidu ne fait pas exception. Depuis le début de l'année, ses produits tels que Baidu Wenku et Wen Xiaoyan App ont successivement intégré le modèle DeepSeek-R1.

Bien entendu, les modèles auto-développés et l’accès à DeepSeek ne sont pas des choix opposés, et il n’est pas nécessaire de faire un choix entre les deux.

À l'occasion du deuxième anniversaire des débuts de Wen Xin Yiyan, Baidu a officiellement lancé aujourd'hui Wen Xin Large Model 4.5 et Deep Thinking Model X1. L'APPSO a également été invitée à en faire l'expérience en amont.

Un bref résumé des «character designs» de ces deux modèles :

- Grand modèle textuel 4.5 : grand modèle de base multimodal natif, bon pour générer ou interpréter des images et répondre aux questions

- Deep Thinking X1 : modèle Deep Thinking, prend en charge l'invocation multi-outils

Deux modèles ont été lancés sur le site officiel de Wen Xin Yi Yan, avec une utilisation gratuite

https://yiyan.baidu.com

Cueillir des pastèques, comprendre des mèmes et identifier des peintures anciennes, quelle est la capacité multimodale de Wenxin 4.5 ?

Parlons d'abord de Wenxin 4.5. En tant que grand modèle de base multimodal natif, il m'a réservé beaucoup de surprises en termes de capacités de reconnaissance et de compréhension multimodales.

En ce qui concerne le processus classique de sélection des pastèques, Wenxin 4.5 fournit divers critères de jugement tels que la couleur, les rayures, les sons, les champs de melon, etc. Cependant, en tant que producteur de melons IA mature et pragmatique, il n'ose rien dire.

Les mots sont durs, mais vous ne pouvez savoir quelle pastèque est la plus sucrée qu'en la coupant et en la goûtant.

En termes d'identification des « mèmes », Wenxin 4.5 est également très bon dans ce domaine. En lançant une émoticône pour tester le terrain, il a réussi à reconnaître l'identité de Pig Man. Lorsqu'il s'agissait d'identifier une autre émoticône, Wenxin 4.5 a non seulement compris le sens littéral, mais a également capturé avec précision les métaphores et les connotations qui se cachent derrière elle.

Voici une petite astuce. En plus de la fonction de partage de base, ses réponses peuvent être enregistrées dans Baidu Netdisk en un seul clic, ou des documents peuvent être générés automatiquement. Lorsque vous rencontrez les réponses divines de l'IA, vous pouvez également les enregistrer à tout moment, et la connexion opérationnelle est assez fluide.

Testez à nouveau votre compréhension et commencez à faire des casse-tête.

"Y a-t-il un mot que tout le monde prononce mal ? Qu'est-ce que c'est ?" Il a répondu à cette question facilement sans s'y laisser entraîner. Le processus de raisonnement logique était clair et il a également posé quelques questions complémentaires adaptées au sujet.

Lequel est le plus grand, 9,8 ou 9,11 ? Un morceau de gâteau. Cependant, j'ai testé "Combien de r y a-t-il dans Strawberry" plusieurs fois de suite, et sa confiance a débordé de l'écran, mais elle est également tombée les unes après les autres.

Voici une question de physique qui teste à la fois la capacité de calcul et la capacité de reconnaissance d’images. Il analyse d'abord calmement la structure, puis démonte les options une par une, et enfin verrouille fermement la bonne réponse D. Le processus est bien fondé et ressemble un peu à un « représentant de classe de physique ».

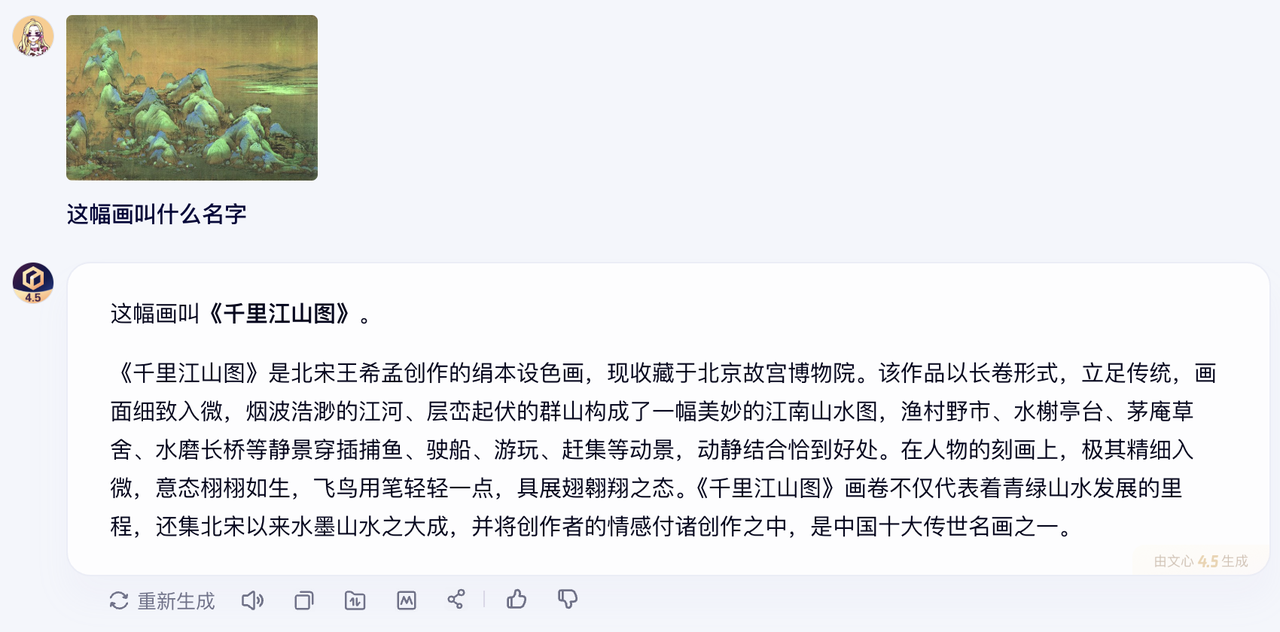

Dans ma vie quotidienne, je tombe souvent sur des peintures anciennes ou des captures d’écran de films d’origine inconnue. La façon la plus courante d’y parvenir est de publier sur les plateformes sociales et de demander l’aide d’internautes enthousiastes dans la zone de commentaires. Maintenant, je peux peut-être le donner à Wenxin 4.5 pour qu'il l'essaye.

Après les tests, même si la fonction de recherche en ligne est désactivée, elle peut toujours répondre aux questions avec précision.

Outre les images, la reconnaissance audio est également sans ambiguïté. Par exemple, j'ai enregistré un morceau de "Sunny Day" avec mon téléphone portable, et il a reconnu instantanément la chanson grâce aux paroles. Cependant, vous ne pouvez pas compter sur cela lorsqu'il s'agit de certaines chansons trop impopulaires et trop niches.

De plus, qu'il s'agisse du téléchargement de rapports de l'industrie technologique ou de la vidéo de démonstration de 44 secondes des dernières réalisations du robot publiée par Li Feifei sur la plate-forme X il y a quelque temps, la capacité de synthèse de Wenxin 4.5 est difficile à critiquer.

En novembre de l'année dernière, Baidu a lancé la technologie iRAG, une technologie de graphe Vincent améliorée par la récupération, qui se concentre sur une technologie ultra-réaliste et sans hallucinations.

Son principe fondamental est de combiner les milliards de ressources d'images de Baidu Search avec de puissantes capacités de modèle de base afin de fournir une référence précise pour la génération d'images en récupérant des données d'images réelles et fiables. Désormais, Wenxin 4.5 prend également en charge la génération d'images.

Par exemple, la valeur marchande de Tesla a récemment fluctué violemment. J’ai donc trouvé une issue pour Musk, l’homme le plus riche du monde, et j’ai demandé à Wenxin 4.5 de générer une photo de « Musk vendant un barbecue sur un stand la nuit ».

Le stand de barbecue a toujours besoin d'une photo, alors ne vous inquiétez pas, il prend également en charge le redessinage partiel et le réglage des détails est très convivial.

Cependant, il reste encore à l'améliorer dans la génération de texte. Par exemple, je voulais « redessiner » un « signe marovien » pour Musk, mais soit le texte était flou et difficile à lire, soit la position était mal alignée. Plusieurs séries de tentatives se sont soldées par des échecs.

Pensée lente ≠ lente, X1 ouvre la bonne voie pour utiliser le modèle de raisonnement profond ?

Parlons du modèle d'inférence profonde X1 lancé par Baidu aujourd'hui. Il s’agit évidemment d’un modèle qui compare DeepSeek R1.

Selon l'introduction officielle, le modèle de texte X1 a évolué à partir de la technologie de réflexion lente publiée par Baidu en octobre 2023. Il possède des capacités complètes de compréhension, de planification, de réflexion et d'évolution, et prend également en charge la multimodalité.

Si vous êtes pressé, laissez le problème à Wenxin 4.5, et les tâches complexes et longues seront gérées par X1, qui possède des capacités de raisonnement plus approfondies.

Prenons comme exemple la recommandation des spécialités de Guangzhou. Wenxin 4.5 s'est contenté de griffonner quelques noms généraux de mets délicats, tels que « petits pains de riz » et d'autres réponses superficielles, tandis que X1 s'est directement transformé en un « guide touristique attentionné », fournissant des noms et des adresses de guichet unique et une meilleure compréhension des pensées des touristes.

Face au problème classique du chariot, le temps de réflexion de X1 n'est pas trop lent, l'analyse est succincte et les résultats sont discutés du point de vue de différents systèmes éthiques. La profondeur et l'étendue sont en ligne.

Pour en venir à une question de raisonnement logique plus complexe, les performances de X1 sont également remarquables.

L'invocation multi-outils est l'une des fonctionnalités de Text Center X1.

Les responsables ont déclaré que X1 avait débloqué la recherche avancée, les questions et réponses sur les documents, la compréhension des images, le dessin IA, l'interpréteur de code et d'autres outils.

J'ai eu une idée soudaine et j'ai téléchargé une photo en forme de cœur. Il y avait en fait une formule mathématique intégrée dans l’image. Cela semblait simple mais assez difficile. Après tout, extraire des informations mathématiques à partir d’images nécessite une compréhension visuelle élevée et des capacités de traitement logique.

Quant au résultat, il a réussi à extraire le contenu de la formule et à expliquer la signification de la formule.

La capacité de génération de texte complexe est également un point fort de X1. J'ai d'abord demandé à X1 de générer un script de 500 mots avec pour thème "Lin Daiyu déracine le saule pleureur". Le scénario « conquiert la force avec la douceur », conserve les traits de caractère de Lin Daiyu et intègre également des conflits et des tournants dramatiques.

Immédiatement après, j'ai en outre demandé à X1 d'analyser le scénario d'un point de vue psychologique et, sur cette base, de peaufiner un nouveau scénario de 1 000 mots.

La tâche est cette fois évidemment plus complexe. La théorie utilisée par X1 est appropriée. Même si ce n’est pas particulièrement profond, il est très rare qu’un modèle d’IA soit capable de réaliser une telle interprétation interdisciplinaire en peu de temps. Bien sûr, cela n’est pas sans défauts. Le nombre de mots ne répond pas aux exigences.

C'est juste une réponse. Comparé à Deepseek, qui regorge de jargon « inflationniste » des sciences sociales, X1 est évidemment plus sobre dans sa production linguistique, et son expression est plus douce et plus terre-à-terre, avec un peu plus de chaleur qui touche le cœur des gens.

DeepSeek est doué pour une réflexion globale, en poursuivant une réflexion technique approfondie et étendue, mais son langage est légèrement aliéné.

Récemment, le blogueur technologique Alexander Doria a avancé un point de vue : le prochain cycle de développement dans le domaine de l'IA sera « le modèle lui-même est le produit ». Celui qui peut gérer la formation des modèles contrôlera l’avenir.

Il a également cité la prédiction de l'investisseur Databricks Naveen Rao :

"Dans les 2-3 prochaines années, les fournisseurs d'IA fermés cesseront de fournir des services API. Seuls les modèles open source continueront à fournir des API, et les entreprises fermées se tourneront vers la création de capacités plus uniques."

Si l'on regarde le marché intérieur, les performances de Baidu sont tout à fait représentatives.

Depuis la sortie de Wenxin Yiyan il y a deux ans, Baidu a continué d'augmenter ses investissements dans des modèles auto-développés, avec un rythme d'itération constant. Les débuts de Wenxin 4.5 et X1 constituent également la meilleure note de bas de page de la tendance « modèle en tant qu'application ».

Le premier s’appuie sur des milliards de paramètres pour attaquer directement les capacités multimodales, tandis que le second utilise une réflexion lente et l’invocation de plusieurs outils pour montrer ses capacités de raisonnement. Cette disposition différenciée des capacités répond avec précision aux divers besoins des utilisateurs et transforme le modèle lui-même d'un noyau purement technique en un « produit » pouvant être directement utilisé.

En regardant l'histoire, l'accumulation technologique de Baidu à l'ère de la recherche et ses tentatives de transformation à l'ère de l'Internet mobile lui ont permis de se tenir à l'avant-garde, mais il a également raté certaines opportunités en raison du contrôle du rythme ou de la concurrence sur le marché.

À l'image de la situation actuelle, si l'on compare l'IA au « feu », Baidu est sans aucun doute, il y a deux ans, le « Prométhée » qui sait le mieux utiliser le feu sur le marché chinois. Cependant, comme par le passé, Baidu, en tant qu'« Académie militaire de Whampoa » de l'IA chinoise, s'est levé tôt et s'est précipité à la réunion du soir.

Ceci est indissociable de la tendance de l’écosystème de l’industrie de l’IA.

Le PDG d'OpenAI, Sam Altman, a prédit le mois dernier que le coût d'utilisation de l'IA de niveau fixe chuterait de 90 % environ tous les 12 mois.

La baisse rapide des coûts a affaibli les obstacles importants à la survie du modèle à source fermée, réduisant progressivement le fossé du monopole technologique. Dans le même temps, le modèle open source et gratuit est devenu un nouveau moyen d'attirer les utilisateurs et d'étendre l'influence technologique en raison de son seuil bas et de sa grande accessibilité.

La pénétration rapide de DeepSeek et de Manus sur une courte période montre également qu’il n’existe actuellement aucun obstacle significatif aux produits d’IA. Les utilisateurs se tourneront vers la meilleure expérience sans aucune nostalgie.

Qu'il s'agisse de Baidu, d'autres grandes entreprises ou de développeurs indépendants, il semble que nous soyons revenus à l'ère imprudente de l'essor de l'Internet mobile.

# Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (WeChat ID : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo