Les nouvelles récapitulatives de l’IA d’Apple sont un gâchis, ce qui est plus inquiétant que le « clickbait »

Je ne m’attendais pas à ce que l’IA d’Apple soit un jour critiquée comme un « clickbait ». Ce n'est pas une bonne nouvelle pour Apple, qui n'a pas encore lancé de version complète d'Apple Intelligence.

La situation réelle est peut-être bien plus grave que l’adjectif inoffensif « clickbait ». Si les grands titres n'utilisent que des exagérations et des citations hors contexte pour attirer l'attention, on peut dire que ce que fait l'IA d'Apple « confond le bien et le mal ».

Il convient de préciser que la responsabilité de ce « problème » incombe entièrement à l'IA d'Apple et n'a rien à voir avec l'accès à ChatGPT.

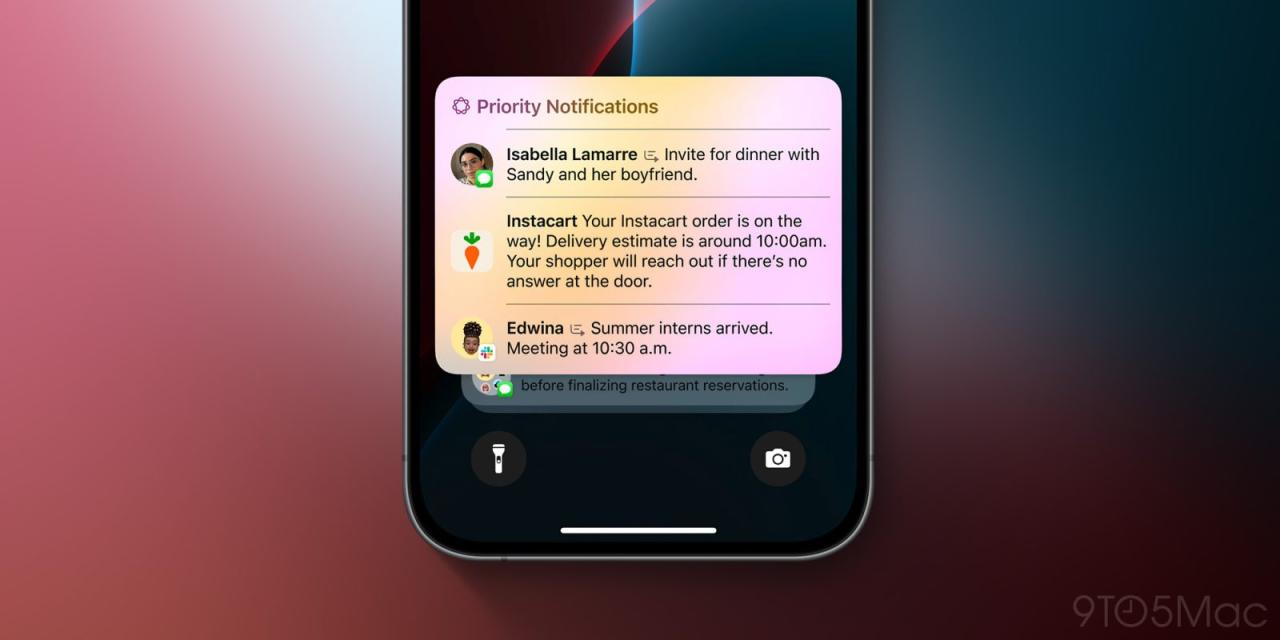

▲Source de l'image : 9TO5Mac

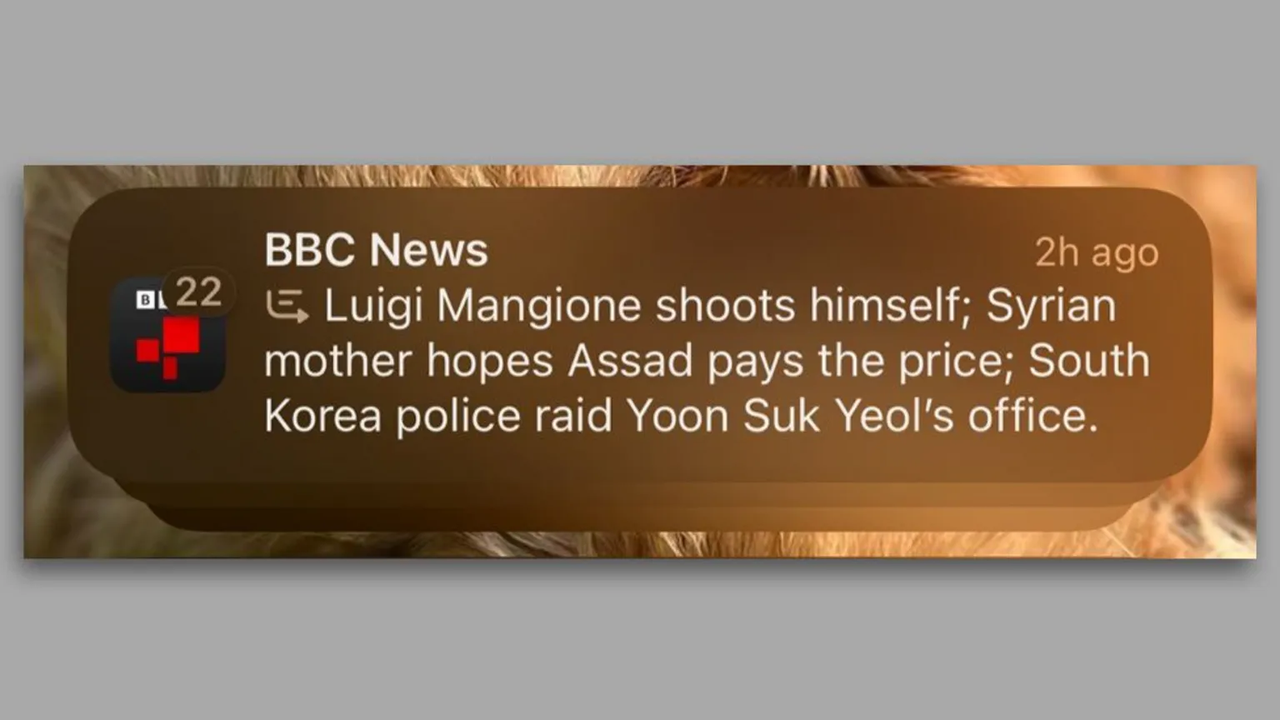

Récemment, la British Broadcasting Corporation (BBC) a publié une série d'informations et de rapports de suivi sur le meurtre du PDG de UnitedHealth Insurance Company, Brian Thompson, par Luigi Mangione, mentionnant, entre autres détails, qu'il fera face à des accusations de meurtre au premier degré.

Cependant, une capture d'écran fournie par la BBC montre que le résumé de l'actualité généré par le résumé de l'IA d'Apple est "Luigi Mangione se tire une balle ". On est loin du véritable cours des événements : il serait toujours détenu dans une prison de Pennsylvanie.

C'est tellement scandaleux, tellement faux.

▲Source : BBC

En réponse à cette erreur ridicule, la BBC a officiellement déposé une plainte auprès d'Apple, demandant à cette dernière de prendre des mesures correctives et d'éviter que de telles erreurs ne se reproduisent. Un porte-parole de la BBC a déclaré qu'elle "s'engageait à respecter les normes les plus élevées d'exactitude et d'impartialité et s'efforçait d'éviter d'induire délibérément et sérieusement nos lecteurs en erreur".

Par ailleurs, Reporters sans frontières (RSF) a également exhorté Apple à abandonner ses capacités d'intelligence artificielle générative . L'organisation a déclaré que l'incident du « faux titre » montrait que « les services d'IA générative sont encore trop immatures pour fournir des informations fiables au public ».

Vincent Berthier, responsable de la technologie et du journalisme à Reporters sans frontières, a déclaré que l'IA est une machine à probabilités et que les faits ne peuvent pas être déterminés en lançant des dés. Il a également souligné que la loi européenne sur l'intelligence artificielle ne classe pas l'IA génératrice d'informations comme un système à haut risque, laissant ainsi un « vide juridique sérieux ».

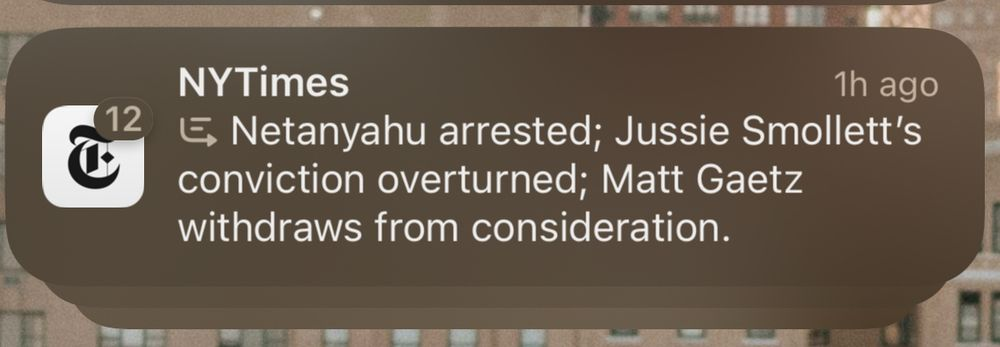

▲Source de l'image : Engadget

En fait, ce n’est pas la première fois que le résumé de l’IA d’Apple « fabrique des nouvelles ». Le mois dernier, un journaliste du nom de Ken Schwencke, du site d'information américain d'investigation « ProPublica », a partagé une capture d'écran sur Bluesky.

Le premier article de la capture d'écran indiquait clairement « Netanyahu a été arrêté ». Cependant, ce qui se passe réellement, c’est que la Cour pénale internationale a émis un mandat d’arrêt contre le Premier ministre israélien Benjamin Netanyahu.

Ce rapport, sérieusement déformé par l’IA d’Apple, vient du New York Times (NYTimes), qui n’a pas encore commenté le sujet.

▲Source de l'image : Ciel bleu

La fonctionnalité de génération de résumés intelligents d'Apple Intelligence sera officiellement lancée au second semestre de cette année. L'intention d'Apple est de pouvoir "aider à affiner les informations qui comptent le plus pour vous grâce à sa compréhension approfondie du langage , et les notifications généreront des résumés afin que vous puissiez voir les détails importants en un coup d'œil".

Il semble que la « compréhension profonde du langage » mentionnée par Apple semble très aqueuse. Petros Iosifidis, professeur de politique médiatique à la City University de Londres, a déclaré que l'erreur d'Apple "semble embarrassante".

Iofidis a également déclaré qu'il était "surpris qu'Apple lance un produit aussi manifestement à moitié cuit". Même si la technologie présente des avantages potentiels à l'avenir, il existe actuellement « un réel danger de propagation de la désinformation ».

▲Petros Iosifidis (Source : London City University)

Avec le développement actuel de la technologie de l’IA générative, nous semblons naturellement penser que l’utiliser pour résumer un article est « un jeu d’enfant » pour l’IA. En fait, la plupart des outils d’IA inventent rarement des choses lorsqu’ils sont utilisés, mais les malentendus ou la sortie de leur contexte sont plus fréquents.

Outre Apple, des entreprises technologiques telles que Google et Microsoft tentent également d'utiliser la technologie de l'intelligence artificielle pour classer, trier et résumer les actualités. Bien que de tels outils d'IA puissent améliorer l'expérience utilisateur, s'ils commettent des erreurs sans intervention humaine, les « malentendus » qui en résultent peuvent se propager de manière exponentielle.

▲Source de l'image : Moyen

Même si l’IA peut déjà faire un excellent travail en aidant les individus à améliorer leur efficacité au travail dans la plupart des scénarios, la probabilité d’erreurs n’est en aucun cas nulle. Nous devons donc faire presque le seul choix entre « prendre le risque de commettre des erreurs » et « profiter de la commodité de l’IA ».

La prochaine fois, il faudra « garder les yeux ouverts » pour toutes les informations sur les réseaux sociaux.

# Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (ID WeChat : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo