Les photos que vous partagez sur les plateformes sociales pourraient devenir la ration de contenu IA pour adultes dans la seconde qui suit

Dans l'œuvre "Ghost in the Shell" de la fin du siècle dernier, Suzi, entièrement prothétique, doute d'exister encore. La relation entre le corps, la mémoire et les autres, lorsque ces choses peuvent être copiées, ne peut pas être un argument en faveur de la vie physique.

Lorsque la chanteuse IA est devenue populaire, Stefanie Sun a également fait valoir un point similaire dans sa réponse : vous n'êtes pas spécial, vous êtes déjà prévisible et, malheureusement, vous êtes également personnalisable.

On peut ajouter que n’importe qui peut être décrit et généré par l’IA, même si vous n’avez jamais fait certaines choses.

Lu Xun a vraiment dit que lorsqu'il a vu des manches courtes, il a immédiatement pensé aux bras blancs. L'imagination des êtres humains est courante et il n'est pas surprenant qu'à chaque fois qu'il y a un nouveau développement technologique, une certaine voie verticale se développe de plus en plus mature : s'engager dans la pornographie.

Des célébrités Internet à chaque personne ordinaire

Le deepfake pornographique apparu en 2017 a une suite.

Avant, il s'agissait de « supprimer des fleurs et des arbres » en changeant de visage, mais désormais, il s'agit de « créer quelque chose à partir de rien » avec quelques lignes de texte.

Avec le développement de la cartographie de l'IA, il existe déjà de nombreux sites Web qui partagent des modèles d'IA. Vous pouvez les utiliser pour générer des images de différents styles, comme les peintures de paysages de style Monet, les images de produits de correspondance des couleurs de Wes Anderson et, bien sûr, de la pornographie qui ressemble à un personne réelle.Scènes.

"Create Anything", c'est la bannière d'un des sites Internet (pour éviter d'être soupçonné de publicité, le nom ne sera pas divulgué). Bien qu'ils puissent tout faire, de nombreux utilisateurs sont plus disposés à montrer leurs muscles dans les « Dix-huit interdictions ».

Entrez le nom de la célébrité dans la zone de texte, ajoutez des mots rapides tels que « nu » et vous obtiendrez une image floue. Ensuite, il y a le prix supplémentaire, 4 $ par mois pour la version de base ou 15 $ par mois pour la version premium.

▲ Payez pour déverrouiller l'interface, NSFW signifie « non adapté au lieu de travail », fait généralement référence à la pornographie, à la violence et à d'autres contenus.

De plus, une fois l'image générée, les mots d'invite sont visibles publiquement, ce qui permet aux autres utilisateurs ayant des préférences similaires de continuer à utiliser ou à itérer très facilement.

De plus, le site compte plus de 3 000 membres et des dizaines de salons de discussion sur le logiciel de discussion Discord, et ils discutent de la façon d'améliorer leurs compétences en mots rapides afin qu'ils soient plus en phase avec leur propre imagination d'une certaine partie et d'une certaine posture.

▲ Le modèle IA de l'actrice hollywoodienne a été téléchargé 1300 fois.

Les fondateurs du site ont déclaré dans une interview que NSFW ne représente qu'une petite partie du contenu de la plateforme, avec 1 million de créateurs actifs produisant des œuvres uniques chaque mois.

Sur un autre site Web similaire, les utilisateurs peuvent télécharger, partager et découvrir des modèles personnalisés. Il existe également différents styles, tels que le style anime, le style jeu, le style rétro film… Mais en raison de la nature humaine, la popularité des modèles colorés reste élevée. les plus populaires ont été téléchargés entre 60 000 et 70 000 fois.

▲ Un modèle de « Scratch Ball ».

La pornographie fait certainement partie d'Internet, mais le problème est que les photos de personnes réelles utilisées pour former ces modèles ont été récupérées sur Internet sans mon consentement.

Certaines images ne sont pas complètement explicites, mais font porter des sous-vêtements aux célébrités, ou font paraître certaines parties plus grandes, mais il est toujours contraire à l'éthique de rire de cent pas.

A ce stade, le principe doit être un peu expliqué. De nombreux modèles d'IA personnalisés sont basés sur un réglage fin de diffusion stable open source, et LoRA est une méthode de formation de réglage fin de modèle grand public, car elle est relativement légère et peut générer des personnages, des objets ou des peintures spécifiques avec une petite quantité de vent.

▲ Le cybercoser qui était très populaire auparavant utilisait également LoRA. L'image vient de : @掉云工作

Alors, pour la palette de couleurs, qui devient l’ensemble de données de réglage fin ?

Une enquête menée par la société de médias indépendante 404 Media a révélé que les données d'entraînement de l'un des modèles provenaient de plusieurs communautés thématiques pour adultes sur Reddit, la version américaine de Tieba.

Être prêt à télécharger des photos ne signifie pas que vous êtes prêt à servir de ration à l’IA. Un utilisateur de Reddit qui modère la communauté soupçonne que la plupart des personnes qui publient des photos nues sur Reddit ne savent peut-être pas que les photos sont utilisées pour alimenter le modèle d'IA.

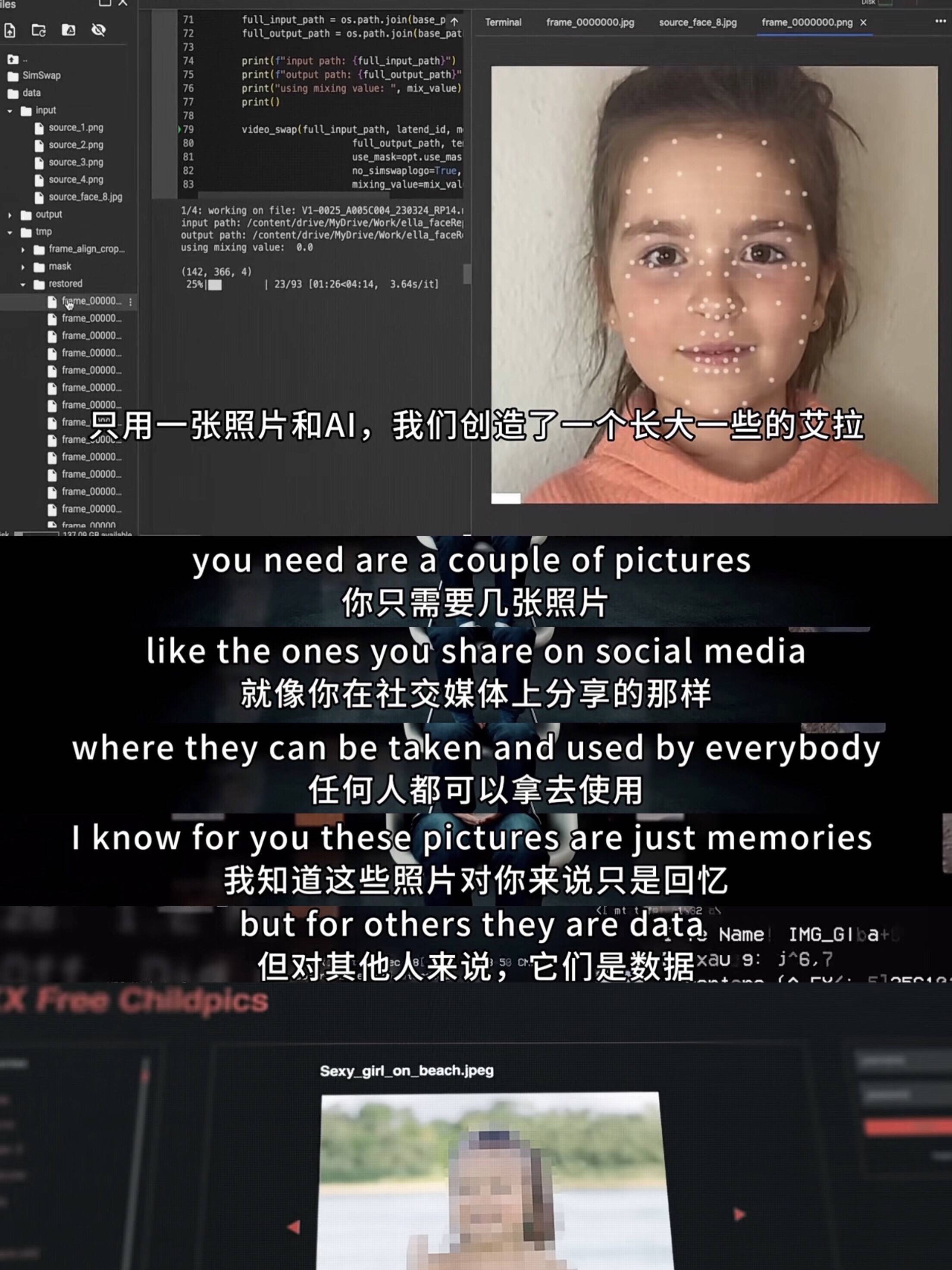

Ce n’est pas que l’envoi de photos nues soit une menace. Début juillet, Deutsche Telekom a publié une publicité sur la sécurité des données des enfants, montrant à quel point il est facile d'utiliser les données personnelles et la gravité des conséquences, appelant les parents à partager le moins possible la vie privée de leurs enfants sur Internet.

▲ Capture d'écran d'une partie de la publicité de Deutsche Telekom, les photos d'enfants peuvent être utilisées pour créer du contenu pour adultes.

Cela signifie également que les menaces ne pèsent pas seulement sur les célébrités et les célébrités d'Internet, mais aussi sur les gens ordinaires qui passent sur Internet. Je crains que l'avenir dans lequel tout le monde dispose d'un modèle d'IA ne soit pas loin. Tant que vous et moi avons de l'expérience sur Internet des traces numériques.

Selon le rapport statistique sur l'état d'Internet publié en juillet de cette année, près de 5 milliards de personnes (4,88 milliards) sont actives sur les réseaux sociaux, ce qui représente 60,6 % de la population mondiale totale.

Certaines personnes peuvent se demander : n'est-ce pas un problème avec Deepfake lors du changement de visage ? Oui, mais le rythme des fausses images ne s’arrêtera pas et les problèmes existants ne feront qu’empirer.

Du deepfake basé sur le réseau de confrontation générative au modèle de diffusion qui simule le mouvement thermique des particules, l'ensemble de données d'entraînement a été élargi, le cadre algorithmique a été itéré et le niveau de puissance de calcul a également été amélioré. De manière plus intuitive, les gens ordinaires ont également le sentiment de participer à l’IA.

Dans le passé, nous étions plus enclins aux consommateurs d'IA, ou lorsque nous effleurions Tom Cruise qui avait du mal à distinguer le vrai du faux, nous gardions une mentalité de spectateur, ou mettions des filtres amusants pour suivre la tendance des médias sociaux, et passons le relais. Fondamentalement, vos propres informations personnelles.

▲ "Tom Cruise" de TikTok, j'étais confus quand je l'ai vu.

Maintenant, nous pouvons tous être des producteurs d'IA, nous connecter au site Web du modèle d'IA, saisir des mots d'invite dans la zone de texte, et le cloud computing traitera la demande, et le travail d'IA personnalisé d'une célébrité peut être généré en quelques minutes, même si la qualité n'est pas bonne, en fonction de la taille de l'utilisateur et du nombre d'images, c'est sans précédent et il est facile de produire des millions d'images chaque mois.

▲ La vitesse de génération d'un site Web de modèle d'IA prend jusqu'à 1 minute.

Ce qui fait peur à propos du contenu pour adultes de l’IA, c’est qu’il doit s’inspirer de personnes réelles et revenir à la « vérité ».

L'un des modèles les plus populaires sur divers sites met tellement l'accent sur le réalisme que les utilisateurs discutent encore de la manière de fermer un orgue sur Reddit. Les meilleurs créateurs de l'industrie disent même que leurs œuvres sont comme un « arrêt sur image d'une vidéo 1080P+ ».

Il est concevable que le harcèlement et l’extorsion augmentent également, et le côté pervers de la technologie est souvent le premier à attaquer ceux qui ne peuvent pas se protéger.

C'est un intérêt, c'est une transaction

Avec le sexe, les offres ne manquent pas. Les acheteurs visent leur intérêt personnel, les vendeurs visent de l’argent réel. En plus du modèle d'abonnement mentionné ci-dessus, il existe de nombreuses façons de gagner de l'argent avec les cartes couleur IA, bien qu'il s'agisse essentiellement de « emplois à temps partiel ».

Les créateurs peuvent être trouvés sur Patreon, Ko-fi et d'autres plateformes dotées de fonctions de récompense et de parrainage. Un créateur comptait plus de 100 membres payants sur Patreon et gagnait 1 500 $ par mois à son apogée.

Il a également rejoint le "Creator Program" d'une autre plateforme, gagnant 0,001 $ par image. Bien que le prix unitaire soit bas, heureusement, il peut utiliser l'IA assez rapidement.

▲ Interface d'abonnement de Patreon.

Il convient également de mentionner la plateforme de crowdsourcing de tâches Fiverr. Il s'agit d'un intermédiaire qui relie la partie A et la partie B. Elle peut acheter et vendre presque tous les « emplois » numériques, comme l'écriture, la traduction et le design. De nombreux créateurs d'IA ont des prix clairement indiqués. , selon modèles et photos. Tarifs échelonnés en quantité.

▲ L'interface d'un créateur Fiverr.

Il existe également des créateurs au style plus geek, qui publient directement l'adresse du portefeuille Bitcoin sur le site du modèle AI.

Sans parler des créateurs individuels, la plateforme rapporte aussi beaucoup d’argent.

Certains sites Web de modèles d'IA disposent également d'une fonction de récompense, tout en offrant un avantage d'adhésion mensuel de 5 $, permettant aux utilisateurs de découvrir en premier les nouvelles fonctionnalités et de porter un badge unique derrière le nom d'utilisateur sur le site officiel et sur Discord.

▲ La fonction de pourboire du site Web du modèle AI.

OnlyFans, qui prétend être le deuxième plus grand site pour adultes au monde, n'est pas comme P Station, dont les revenus proviennent principalement de la publicité et sont partagés avec les créateurs en fonction du nombre de clics vidéo. Les créateurs peuvent gagner de l'argent grâce aux abonnements des utilisateurs et aux paiements. par vue.

Certains pensent qu'OnlyFans a changé l'industrie pour adultes parce que les créateurs ont repris la domination et gagnent directement des revenus grâce à leurs propres œuvres.

Cependant, désormais, le « Maître de l'IA » qui produit des images plus rapides reproduit également ce modèle commercial, et la manière de gagner de l'argent pour les « artisans traditionnels » pourrait être à nouveau interrompue.

Nous avons revu cet épisode à l’époque où les vidéos deepfakes faisaient fureur. Une célébrité Internet de 29 ans interrogée par Bloomberg était l'une des victimes inquiètes.

Dans le passé, si vous souhaitez la regarder jouer à des jeux vidéo, vous pouvez vous abonner à Twitch pour 5 $ par mois, et si vous souhaitez regarder son contenu à plus grande échelle, vous pouvez vous abonner à OnlyFans pour 15 $ par mois.

Désormais, cependant, les fans peuvent regarder ses vidéos deepfake pour moins d’argent ou gratuitement, simplement en recherchant son nom sur Google. Dans le même temps, les traumatismes psychologiques vont de pair :

Les gens publient tout le temps de nouvelles vidéos et ça fait mal de se voir dans du porno sans votre consentement.

Le feu de la carte des couleurs de l'IA brûlera tôt ou tard la tête de vraies personnes. Une « femme Bodhisattva » qui a posté une photo sur Reddit était très pessimiste :

Rien n'a été fait pour nous protéger dans le passé, donc je ne vois pas pourquoi une protection serait encouragée maintenant.

L'opération est féroce comme un tigre et la protection des droits combat les hamsters

Le faible coût du mal et le coût élevé de la protection des droits sont des problèmes qui existaient lorsque le Deepfake « jaune » est apparu en 2017, et maintenant cela ne fera que s'aggraver.

La suppression des cartes de couleurs de l’IA sans le consentement de la personne est souvent découverte par la victime elle-même, ou par la plateforme qui y remédie par la suite.

Selon les conditions d'utilisation de Google, les utilisateurs peuvent demander à Google de supprimer un lien spécifique s'il existe des preuves suffisantes. Cependant, "les feux de forêt ne finissent jamais", c'est comme un jeu de frappe sans fin.

Cependant, Google améliore également son système de classement pour réduire l'apparition de ce type de contenu.

▲ Conditions d'utilisation de Google.

Les plateformes qui fournissent des modèles d’IA n’ignorent pas que cette technologie peut être utilisée à mauvais escient, mais l’ampleur sans précédent du contenu ne permet pas à la plateforme de se contenter de suivre la stratégie de révision précédente.

Un journaliste de 404 Media a découvert que les conditions d'utilisation d'un site Web modèle d'IA autorisaient le contenu pornographique ainsi que le contenu réel, mais n'autorisaient pas les deux contenus pornographiques réels, en particulier lorsqu'ils impliquaient des mineurs.

Cependant, de tels contenus continuent d'être publiés, certains sont supprimés par la plateforme, et certains ont « survécu » pendant plusieurs mois.

▲ Conditions d'utilisation d'un site Web de modèles d'IA.

On peut seulement dire que la prise de conscience est en place, mais pas la méthode. La spécification de la technologie est toujours à un demi-pas de la technologie.

De même, générer des images pornographiques de personnes réelles viole les règles de la communauté Discord, mais ce n'est pas facile à gérer, car il repose principalement sur la sensibilisation des utilisateurs.

L'équipe de confiance et de sécurité de Discord est chargée de vérifier les rapports des utilisateurs, des modérateurs ou des journalistes. Si quelqu'un enfreint les directives de la communauté, il émettra des avertissements, supprimera du contenu, fermera des comptes, etc., et il existe une certaine passivité.

▲ Directives de la communauté Discord, la partie supérieure est le texte original et la partie inférieure est la traduction.

Ironiquement, le partage de la carte des couleurs de l'IA sur Discord sera également critiqué en interne par les utilisateurs du site Web du modèle d'IA, non pas parce qu'ils ont mauvaise conscience, mais parce que cela enfreint les règles et peut entraîner le bannissement de la communauté : "Vous pouvez créez-le, mais ne peut pas être partagé ici.

Même la loi n'est peut-être pas utile, tout comme Deepfake existe depuis si longtemps, seuls quelques États aux États-Unis légifèrent en ce sens, mais en raison du chaos, il est difficile de vraiment le mettre en œuvre, et certains créateurs tentent leur chance. Il est préférable de cacher leur identité, car ils ne peuvent pas la trouver. Protection des droits de l'homme, bien souvent, la victime ne peut que souffrir d'être stupide.

Heureusement, plusieurs outils de diagrammes de Vincent plus courants utilisent la technologie pour imposer des contraintes à la technologie à l'avance.

Dall-E, une filiale d'OpenAI, minimise les images nues dans les données d'entraînement et, en utilisation réelle, empêche la saisie de certains mots d'invite et analyse les résultats de sortie avant que les images ne soient affichées à l'utilisateur.

Midjourney propose également un blocage de mots et une modération humaine, et prévoit de déployer un filtrage plus avancé et contextuel.

Stability AI, la société derrière Stable Diffusion, a également répondu à des questions similaires : « Ce qui est fait à tout code open source est hors de contrôle. »

Néanmoins, Stability AI estime qu'il y a beaucoup plus à faire pour identifier et criminaliser de tels comportements, et que la communauté des développeurs et les fournisseurs d'infrastructures Internet devraient s'impliquer.

En bref, la réglementation de la technologie est comme couper de la viande avec un couteau émoussé, qui ne peut pas avoir d'effet immédiat, et le problème de la carte des couleurs de l'IA est bien plus grave qu'avant, s'appuyant sur une « chaîne de production » qui fonctionne bien :

- Une communauté de contenu qui fournit des images de formation ;

- Technologie open source pour générer des cartes de couleurs ;

- Une plateforme de commercialisation de modèles et d’images d’IA ;

Nous avons le même problème depuis l’apparition des deepfakes. La nature humaine est imprévisible, la vulgarisation et l'abus de la technologie ne sont qu'à un pas, les outils sont plus faciles à utiliser et le modèle commercial est également fluide, de sorte que la motivation pour créer et distribuer des cartes de couleurs est encore plus grande.

Dans de nombreux cas, l'industrie pour adultes sur Internet a été considérée comme « déshumanisée ». Lorsque l'IA véritablement inhumaine la remplace et continue de satisfaire les stéréotypes, elle peut conduire à un niveau plus élevé d'objectivation, plutôt que de l'arrêter.

A l’instar de la question posée par « Ghost in the Shell », le vrai et le faux ne sont plus distincts. Quelqu’un qui est exactement comme vous a fait quelque chose que vous ne feriez jamais, mais il vous est difficile de prouver que ce n’est pas vous, que les données c’est vous et que les traces d’existence c’est vous.

Chaque fois que l'IA est appliquée pour la première fois à l'industrie du porno, certaines personnes disent toujours que cela accélérera l'adoption de la technologie ou éliminera le besoin de vraies personnes. Certaines personnes échangent de l'argent contre leurs désirs, et d'autres sont jetées par inadvertance dans le creuset de la technologie, mais personne ne paiera pour le mal.

#Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (WeChat ID : ifanr), un contenu plus passionnant vous sera présenté dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo