S’il y a une « concurrence de pincement de visage », les humains ne peuvent prendre que la deuxième place

Le film de science-fiction « Blade Runner » dépeint un monde futur difficile à distinguer entre le vrai et le faux :

▲ Qui sont les réplicateurs ? Image extraite de : "Blade Runner 2049"

Les "réplicants" fabriqués par les humains ont des visages presque identiques aux humains. À moins qu'un instrument professionnel ne soit utilisé pour les tests émotionnels, ou que le nombre caché dans le corps ne soit trouvé, les humains ne peuvent pas du tout identifier les "réplicants" à partir de leur apparence.

Un tel monde futur est peut-être un peu loin, mais si vous ne regardez que le visage, vous ne pourrez peut-être vraiment pas distinguer le vrai du faux.

Le "faux visage" de l'IA a traversé l'étrange vallée

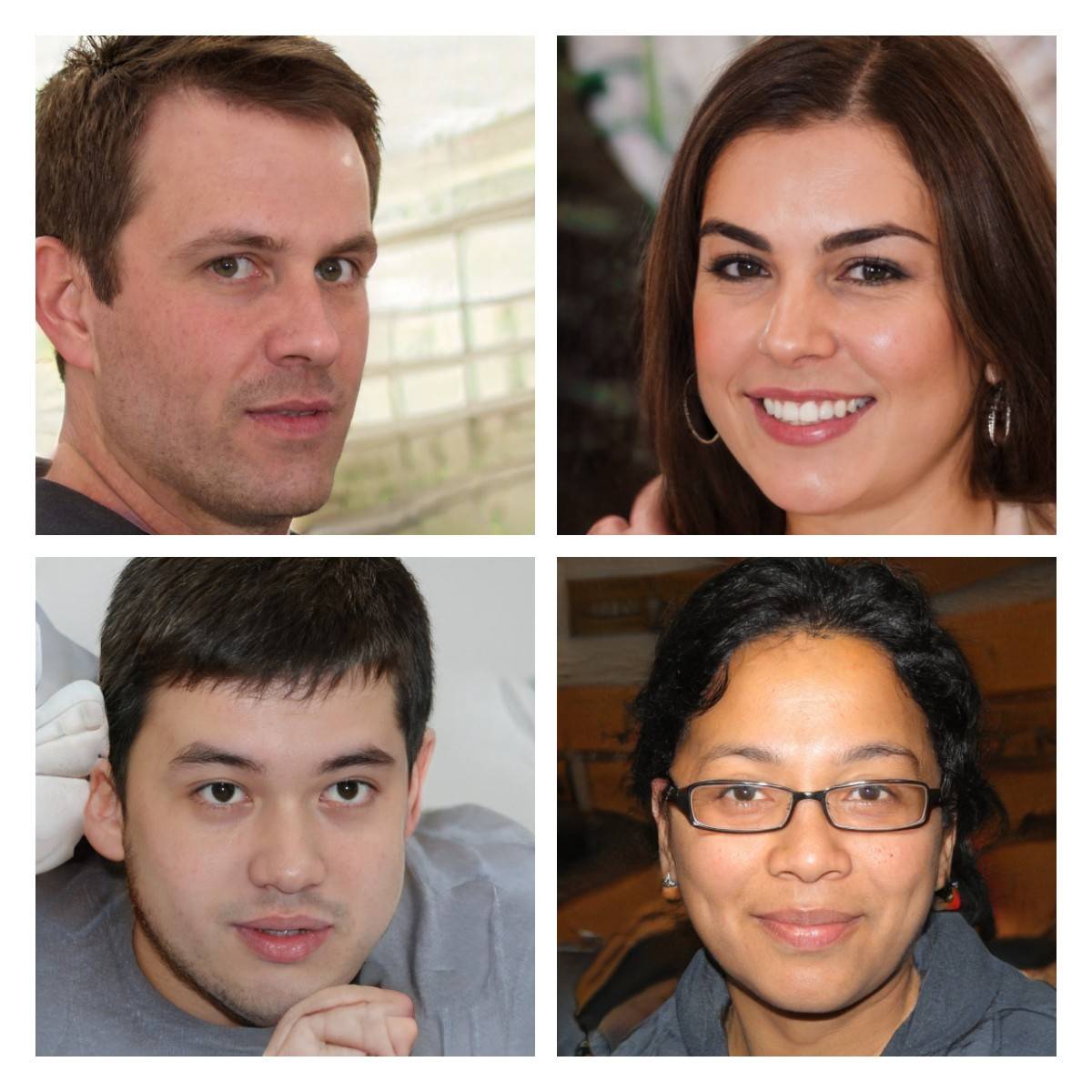

Regardez d'abord un ensemble de photos, avez-vous la confiance nécessaire pour distinguer le "faux visage" en un coup d'œil ?

Lequel des visages ci-dessus est faux ? (Voir la fin de l'article pour la réponse, mais ne vous inquiétez pas, il y a encore beaucoup de visages à venir)

Le concept de "faux visage" évoqué ici fait référence à des photos de visage synthétisées par l'IA, et non à de vraies personnes. Si vous sentez qu'il est difficile de juger du vrai et du faux pendant un moment, ne vous inquiétez pas, vous n'êtes pas seul.

Le professeur Hany Farid de l'Université de Californie à Berkeley travaille depuis de nombreuses années sur la technologie de synthèse d'images IA.

Selon une étude qu'il a récemment publiée dans les Actes de l'Académie nationale des sciences, les visages synthétisés par l'IA sont indiscernables des personnes réelles et semblent même plus dignes de confiance que les personnes réelles.

Les résultats de cette étude ont été au-delà des attentes des chercheurs.

![]()

Le Dr Sophie Nightingale, co-auteur de la recherche, a déclaré que l'objectif initial de la recherche était de trouver des moyens d'améliorer la crédibilité des visages de l'IA en utilisant des comparaisons réelles.

Farid pense que le rythme actuel de développement et d'amélioration de la technologie de synthèse d'images IA est très rapide, même plus rapide que l'imagerie CG traditionnelle.

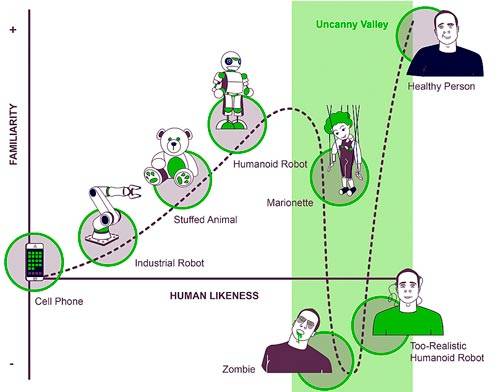

Nous pensons avoir traversé l'étrange vallée des visages statiques

L'effet Uncanny Valley est une théorie psychologique selon laquelle les gens auront une impression favorable d'objets similaires aux gens, mais lorsque la similitude atteint un certain niveau (comme les zombies, les poupées anthropomorphes), les réactions des gens deviendront extrêmement négatives et dégoûtantes.

Lorsque la similitude augmente encore et atteint la similitude avec la personne réelle, la réponse émotionnelle de la personne redeviendra positive et il peut y avoir un effet d'empathie entre les humains.

A en juger par les résultats expérimentaux de Farid, le visage synthétisé par l'IA est susceptible d'avoir quitté la scène de "Walking Dead".

Comment un visage humain aussi réaliste est-il synthétisé ?

Les réseaux antagonistes génératifs (GAN) sont actuellement les algorithmes de synthèse les plus courants. Le nom semble très peu familier, mais sa logique n'est pas compliquée.

Pour faire simple, il y a un "peintre" et un "évaluateur" dans le GAN. Le "peintre" doit dessiner une image qui ressemble le plus possible à un visage humain et la donner à "l'évaluateur" pour qu'il en juge.

"L'évaluateur" regarde beaucoup de photos réelles avant de juger et d'analyser les caractéristiques du visage. Lorsque la peinture du "peintre" peut tromper d'innombrables "évaluateurs" qui ont lu des visages, une photo de visage synthétique AI est née.

Dans ce processus, la précision de "l'évaluateur" continuera à s'améliorer après un apprentissage continu, et les compétences correspondantes du "peintre" augmenteront également. Les deux forment une relation de confrontation, améliorant ainsi la qualité de l'image synthétisée jusqu'à ce qu'elle puisse faire correspondre le faux au vrai..

Farid a utilisé le modèle Nivdia StyleGAN2 publié par NVIDIA dans l'expérience.Afin d'étudier la crédibilité de ses photos synthétiques, les chercheurs ont organisé trois expériences.

![]()

Dans la première expérience, les chercheurs ont invité 315 participants à distinguer 128 groupes (un total de 800 groupes) de groupes photo composés de personnes réelles et d'IA. En conséquence, le taux moyen de participants corrects était inférieur à 50 %, seulement 48,2 % .

Ensuite, dans la deuxième expérience, les chercheurs ont invité 219 nouveaux participants formés à participer à la même expérience et ont donné des commentaires corrects après chaque séparation.

Avec l'aide des chercheurs, la précision de la deuxième expérience a été améliorée, mais elle n'était que légèrement supérieure à 50 %, atteignant 59,0 %. Farid et Nightingale n'ont pas été surpris par la fidélité de la photo AI, mais le résultat de l'expérience 3 était inattendu.

![]()

Dans la troisième expérience, 223 nouveaux participants ont évalué la fiabilité du même lot de photos de 1 à 7. Les résultats ont montré que la fiabilité des photos synthétisées par l'IA était de 7,7 % supérieure à celle des vrais visages. .

▲ Deepfake change de visage Nicolas Cage

Les chercheurs pensent que les photos synthétisées par l'IA qui ont un certain degré de crédibilité sont susceptibles d'être utilisées par des criminels à l'avenir pour commettre des fraudes ou semer la confusion dans les réseaux sociaux.Cette question doit être prise en compte par la société et le développement de la technologie de synthèse d'images nécessite des accords.

La question est donc, puisque le visage synthétique de l'IA comporte certains risques sociaux, pourquoi les gens investissent-ils encore de l'énergie dans la recherche ?

Le visage de l'IA est très bon, mais c'est une "épée à double tranchant"

▲ Keanu Reeves fait ses débuts

Lors du salon du jeu vidéo E3 2019, l'apparition surprise de Keanu Reeves dans la bande-annonce "Cyberpunk 2077" a instantanément enflammé les émotions de tous les publics à l'intérieur et à l'extérieur de la salle, puis il est lui-même monté sur scène et a annoncé qu'il jouerait un rôle important dans le modèle de visage "Johnny Silver" "Hand" du jeu, a suscité les attentes d'innombrables joueurs.

▲ Dans Resident Evil 8, Helena Mankowska a servi de modèle pour le visage de Mme Timitrescu

Parce que dans le monde virtuel, un visage humain réaliste peut apporter un fort sentiment d'immersion aux joueurs.Avec l'amélioration des fonctions du jeu, l'utilisation de personnes réelles comme modèles de visage au lieu de visages de pincement numériques est devenue de plus en plus de fabricants de jeux pour façonner des personnages. .

Mais l'utilisation de modèles de visages réels signifie souvent des frais de licence élevés pour les portraits et des coûts de capture de mouvement, ce qui n'est pas réaliste pour certains petits studios.

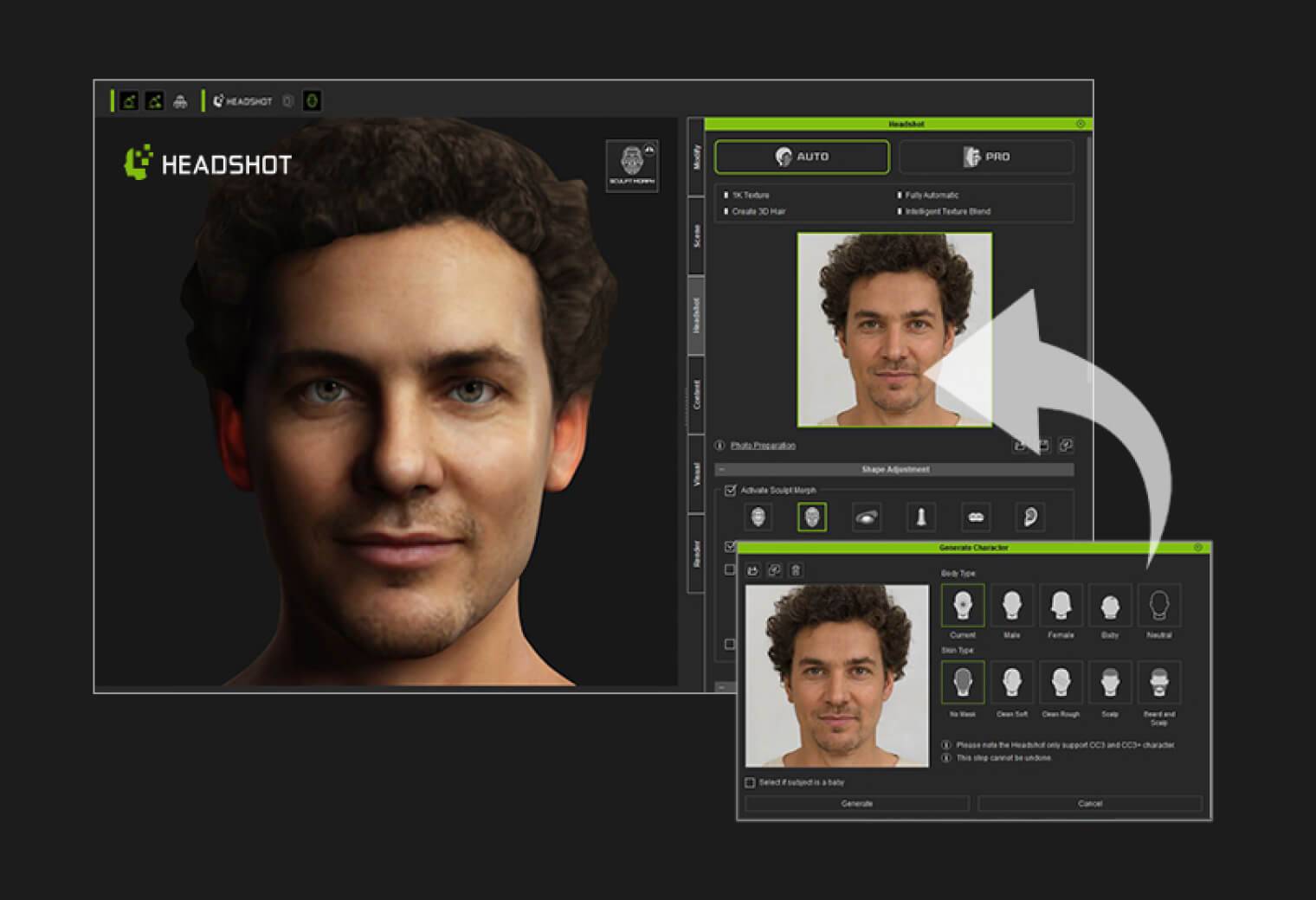

C'est à ce moment-là qu'un visage synthétique d'IA sans droit d'auteur devient pratique – il semble plausible qu'une personne qui n'existe pas dans le monde joue un personnage virtuel.

Par exemple, Generated Photo, un projet de photo composite AI gratuit, a coopéré avec la société de logiciels d'animation Reallusion pour utiliser des portraits synthétisés par l'IA comme images 3D pour l'animation, les jeux ou les publicités. Les développeurs peuvent choisir librement la race, l'âge et le sexe des personnages. Il y a des problèmes de droits d'auteur.

Imaginez, si les visages des PNJ dans des jeux tels que Sims ou GTA sont faits de portraits réalistes, l'immersion et la présence du jeu seront grandement améliorées.

En plus des jeux, certains logiciels de service client nécessitent également un grand nombre d'avatars réels pour communiquer avec les clients. Si vous remplacez les vrais avatars par des avatars IA, vous pouvez non seulement éviter les litiges sur les droits d'auteur des portraits, mais également protéger la vie privée contre les fuites.

Cependant, bien que les photos synthétisées par l'IA aient une signification raisonnable, en même temps, elles auront également un certain impact sur l'authenticité des photos en ligne. Après tout, personne ne veut être fasciné par une personne inexistante sur une application de rencontres.

![]()

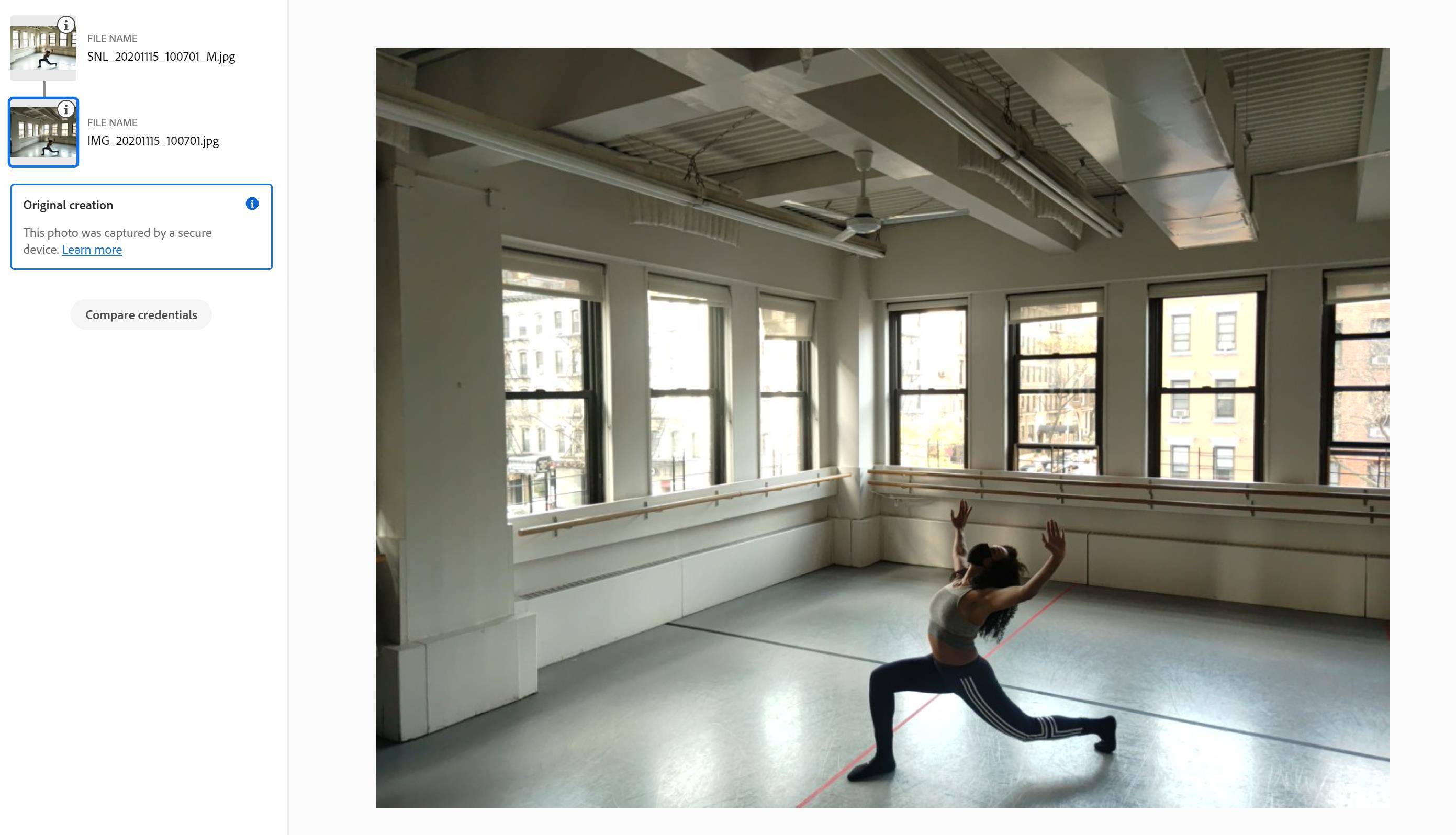

Farid pense que la seule façon de résoudre ce problème est d'ajouter une certification "d'authenticité" à chaque photo réellement prise, afin que les gens puissent distinguer son authenticité lors de la visualisation et de l'utilisation de la photo.

Cela ressemble à une version inversée de Blade Runner, où les personnages du film ont une identification numérotée gravée dans les globes oculaires des réplicants, alors qu'en réalité, ils sont étiquetés sur de vraies photos pour combattre les "faux".

En fait, des entreprises comme Adobe et Microsoft font déjà la promotion de technologies connexes.

En février 2021, des entreprises et des institutions telles qu'Adobe, Microsoft, Intel, Arm et Truepic ont formé un projet appelé Content Origination and Authenticity Alliance (C2PA) pour lutter contre la désinformation et créer des normes techniques de sécurité et de traçabilité vérifiables.

La méthode de vérification est également très simple – les informations telles que la prise de vue et la post-modification des photos sont conservées intactes grâce à la technologie blockchain, et quelle que soit la manière dont les photos sont modifiées, elles peuvent être visualisées directement.

Les vraies photos certifiées auront un petit "i" dans le coin supérieur droit. Lorsque vous cliquez dessus, vous pouvez voir les détails de la date de prise de vue, de l'emplacement et de l'objectif générés par l'appareil photo. Si quelqu'un utilise un logiciel tel que Photoshop Après avoir modifié le photo, vous pouvez également revenir à l'image d'origine de la photo pour obtenir l'image complète.

La méthode de certification C2PA peut garantir l'authenticité des photos dans l'actualité sérieuse et d'autres domaines dans une certaine mesure, mais en raison de sa courte mise en place, elle n'est actuellement utilisée que sur certains médias ou plateformes sociales, et elle est encore obsolète pour fournir des garanties d'authenticité pour tout le matin du contenu Internet.

![]()

C'est-à-dire qu'à l'avenir, les photos synthétiques basées sur l'IA pourraient constituer un risque pour la sécurité sociale. Actuellement, des modèles de synthèse d'images tels que Nivdia StyleGAN2 peuvent être téléchargés publiquement sur des plateformes telles que Github. Est-ce vraiment sûr de le faire ? Farid estime que cela nécessite une attention particulière de la part du personnel technique après avoir pesé les avantages et les risques.

Donc la question est, il y a tellement de visages dans l'article, lesquels sont de vraies personnes ?

![]()

La réponse est : sauf indication contraire, tous sont faux.

#Bienvenue pour prêter attention au compte WeChat officiel d'Aifaner : Aifaner (WeChat : ifanr), un contenu plus excitant vous sera apporté dès que possible.

Love Faner | Lien d'origine · Voir les commentaires · Sina Weibo