Soudain! DeepSeek a été accusé de « vol » par les États-Unis et a fait l’objet d’une enquête d’OpenAI et de Microsoft. Le journal a révélé qu’il avait franchi le fossé de Nvidia.

Pendant la Fête du Printemps, une tempête autour de Deepseek fait des vagues dans le cercle de l'IA.

Selon le dernier rapport de Bloomberg, des chercheurs en sécurité de Microsoft ont découvert l’automne dernier que des individus potentiellement liés à DeepSeek effectuaient des extractions de données à grande échelle via l’API d’OpenAI.

Selon des personnes proches du dossier, en tant que partenaire technologique d'OpenAI et principal bailleur de fonds, Microsoft a immédiatement informé OpenAI après avoir découvert la situation.

Selon les rapports, ce comportement pourrait enfreindre les conditions de service d'OpenAI. Parce que les conditions d'utilisation d'OpenAI indiquent clairement que les utilisateurs ne peuvent pas utiliser de méthodes automatisées ou programmatiques pour extraire des données de son service sans autorisation.

Même si DeepSeek obtient une certaine forme d'accès à l'API, cela peut être considéré comme une violation des conditions de service s'il est utilisé d'une manière qui dépasse la portée de l'autorisation d'OpenAI, par exemple à des fins commerciales illégales ou non autorisées.

OpenAI n'a pas répondu aux demandes de commentaires, Microsoft a refusé de commenter et DeepSeek n'a pas encore répondu.

Il convient de mentionner que de nombreux étrangers pensaient auparavant que DeepSeek aurait pu utiliser les données de sortie de modèles tels que ChatGPT comme matériel de formation pendant le processus de formation, grâce à la technologie de distillation de modèles, les « connaissances » contenues dans ces données ont été migrées vers le propre modèle de DeepSeek.

Cette pratique n'est pas rare dans le domaine de l'IA, mais les sceptiques se demandent si DeepSeek a utilisé les données de sortie du modèle OpenAI sans divulgation complète. Cela semble se refléter dans la conscience de soi de DeepSeek-V3.

Dans le rapport technique du dernier modèle R1, l'équipe DeepSeek a clairement indiqué que les données de sortie du modèle OpenAI n'étaient pas utilisées et a déclaré que des performances élevées avaient été obtenues grâce à l'apprentissage par renforcement et à une stratégie de formation unique.

Par exemple, une méthode de formation en plusieurs étapes est adoptée, comprenant la formation de base du modèle, la formation par apprentissage par renforcement (RL), le réglage fin, etc. Cette méthode de formation cyclique en plusieurs étapes aide le modèle à absorber différentes connaissances et capacités à différentes étapes.

Les utilisateurs précédents ont découvert que lorsqu’on leur demandait l’identité d’un modèle, celui-ci se confondait avec GPT-4.

Le rapport de Bloomberg souligne également que David Sacks, responsable des affaires d'IA aux États-Unis, a déclaré dans une récente interview avec Fox News qu'il existe des « preuves concluantes » que DeepSeek utilise les données de sortie du modèle OpenAI pour développer sa propre technologie. Cependant, Sacks n’a fourni aucune preuve spécifique.

De nombreux responsables américains ont également déclaré que DeepSeek était soupçonné de « vol » et ont lancé une enquête de sécurité nationale sur son impact.

En réponse aux remarques de David Sacks, la réponse d'OpenAI a été relativement conservatrice et prudente. Son porte-parole a déclaré : « Nous savons que des entreprises chinoises, ainsi que d'autres entreprises, ont tenté de « distiller » les modèles des principales sociétés américaines d'IA.

Le porte-parole a souligné qu'en tant que leader dans le domaine de l'IA, OpenAI a pris des contre-mesures correspondantes pour protéger sa propriété intellectuelle, notamment un contrôle strict des capacités de pointe et la décision quelles fonctions peuvent être rendues publiques. Ils estiment qu’une collaboration étroite avec le gouvernement américain est essentielle pour protéger les modèles d’IA de pointe.

Cependant, alors que cette controverse continue de fermenter, l'attention des médias étrangers a également commencé à se tourner vers le modèle open source V3 publié plus tôt par DeepSeek, qui a également divulgué en détail les détails approfondis de l'optimisation sous-jacente dans un rapport technique.

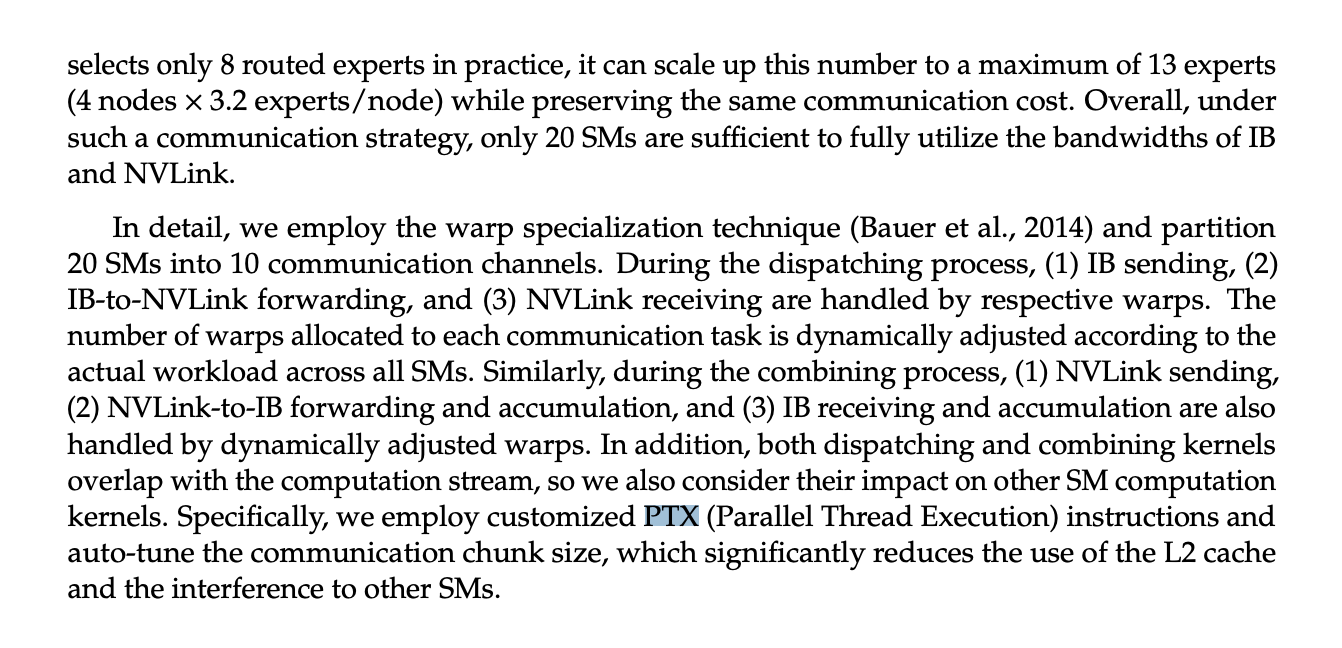

Les médias étrangers ont révélé que le développement du modèle V3 a même contourné CUDA et atteint des performances maximales en optimisant le langage d'assemblage de bas niveau du GPU NVIDIA PTX.

PTX est une architecture de jeu d'instructions intermédiaire pour les GPU NVIDIA qui permet des optimisations fines telles que l'allocation de registres et l'ajustement du niveau de thread/déformation. Si CUDA est un « langage de haut niveau » qui communique avec les GPU NVIDIA, alors PTX est comme un « langage machine de bas niveau ».

Imaginez que vous jouez à une console de jeu. Normalement, nous n'avons besoin que d'un contrôleur (comme CUDA) pour jouer à des jeux, ce qui est très pratique, mais il se peut qu'il ne soit pas en mesure d'utiliser toute la puissance de la console de jeu.

Le PTX revient à ouvrir le capot arrière de la console de jeu et à régler directement les différents accessoires et circuits à l'intérieur. Bien que cela soit compliqué et nécessite beaucoup de connaissances professionnelles, cela peut rendre la console de jeu plus rapide et plus performante.

En termes simples, PTX est un outil qui permet aux développeurs de « soulever le couvercle » du GPU et d'ajuster directement son fonctionnement interne. C'est comme modifier une voiture. Au lieu d'appuyer simplement sur l'accélérateur, vous réglez directement chaque partie du moteur pour obtenir des performances maximales.

Lorsque DeepSeek a formé le modèle V3, il a reconfiguré le GPU H800, notamment en divisant 20 SM pour la communication entre serveurs et en implémentant un algorithme de pipeline avancé. Les capacités d'optimisation ont largement dépassé le niveau de développement CUDA conventionnel. Si cette technologie est vraie, elle bouleversera également le fossé matériel que Nvidia a construit depuis longtemps.

▲ Capture d'écran du rapport technique DeepSeek v3

Cependant, bien que PTX puisse apporter une optimisation des performances plus extrême, il impose également des exigences extrêmement élevées à l'équipe de développement. En revanche, la solution CUDA de NVIDIA reste le premier choix de la plupart des développeurs en raison de ses avantages en termes de facilité de développement et d'itération rapide.

De plus, l'optimisation PTX nécessite souvent une personnalisation pour un modèle de matériel spécifique.

Si cette stratégie d’optimisation « sur mesure » est efficace, elle augmente également considérablement la difficulté de développement et les coûts de maintenance. Cela explique également pourquoi CUDA dominera toujours le développement grand public dans un avenir prévisible.

Cependant, chercher des percées en dehors des règles existantes est souvent le début d'une subversion. On peut s'attendre à ce que la vague technologique déclenchée par DeepSeek au pays et à l'étranger cette fois-ci exploite l'ordre existant de l'ensemble de la chaîne industrielle de l'IA.

# Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (ID WeChat : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo