Vous détestez les mosaïques ? Google dit que vous pouvez le « réparer »

![]()

Le film de science-fiction "Blade Runner" sorti en 1982 envisageait une année 2019 pleine de technologie cyberpunk : le ciel est plein de voitures volantes et les humains peuvent utiliser une machine à grand écran (Esper) pour accomplir de nombreuses tâches incroyables.

Lorsque le protagoniste Rick Deckard a retracé la localisation des clones, il a utilisé Esper pour déterrer des indices qui ont été ignorés à l'œil nu.

Rick a fourré une photo suspecte trouvée sur les lieux dans Esper, et a agrandi un coin de la photo de manière non destructive encore et encore, et a finalement trouvé l'androïde Jura dans le reflet du miroir.

L'imagination des œuvres de science-fiction est en effet limitée par la technologie de l'époque. Les PC ne sont devenus populaires qu'en 1982. "Blade Runner" n'imaginait pas que l'émergence d'Internet avait changé le mode de vie de l'homme, ni ne pouvait imaginer que la technologie de simulation aurait Un jour été remplacée par la technologie numérique.

Cependant, son imagination de la technologie d'image de grossissement sans perte est très avancée, ce qui est un problème difficile à résoudre jusqu'à présent.

Vous avez peut-être aussi rencontré cette situation : après la fête, des amis ont pris une photo de groupe ensemble, puis ont zoomé pour voir le visage de l'ancien camarade de classe ou la marque de boisson ce soir-là quand j'y suis retourné, mais ce que j'ai vu était flou.

En effet, lorsque nous agrandissons la photo dans une certaine mesure, la résolution locale est déjà très faible et nous ne voyons que des images composées de pixels.

![]()

Est-il possible pour nous d'extraire des informations d'image supplémentaires à partir de "mosaïques" triviales comme le fantasme d'il y a 30 ans ?

Un blog récemment publié par l'équipe AI de Google mentionnait un nouvel algorithme d'image, très proche de la vision de "Blade Runner".

Augmentation incroyable de la résolution

64 x 64 Pikachu

Quelle est la taille d'une photo de 64 X 64 pixels ? En utilisant la photo de 12 mégapixels prise par l'iPhone comme modèle, elle ne fait qu'environ un tiers de sa taille. Lorsqu'elle est affichée sur un écran haute définition, vous ne verrez qu'une "mosaïque" complète.

Photos super haute résolution

À l'ère numérique, chaque image que nous voyons à l'écran est composée de pixels densément emballés. Plus l'image est composée de pixels par unité de surface, plus la résolution est élevée et plus l'image est claire.

Les chercheurs en intelligence artificielle de Google se demandent s'il est possible d'extraire suffisamment d'informations sur l'image à partir d'une faible résolution, d'utiliser l'apprentissage automatique pour restaurer autant que possible l'image d'origine, d'augmenter la résolution de l'image et d'obtenir une image claire ?

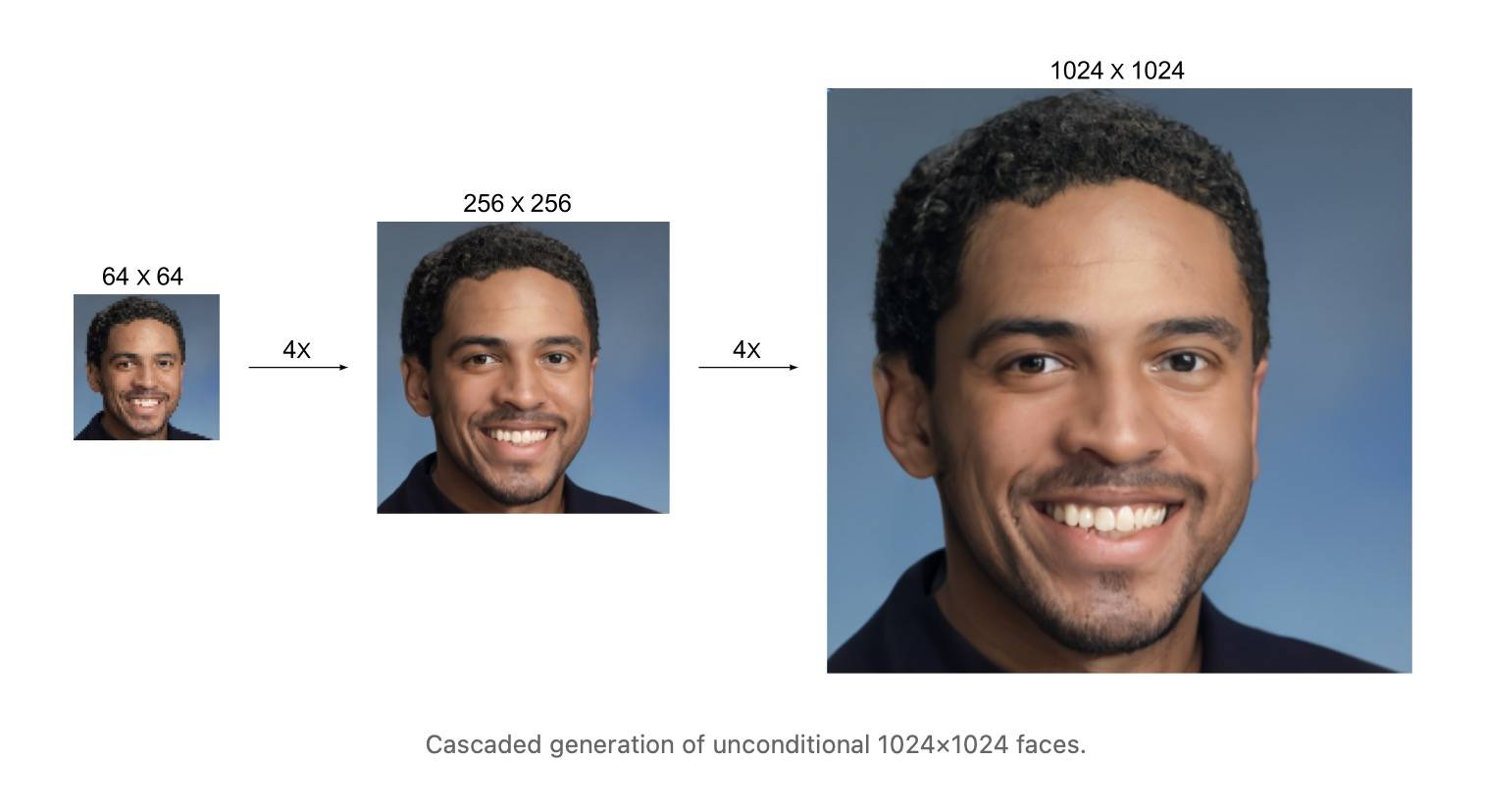

Image de : Google

Dans son blog récemment publié, Google a montré ses derniers résultats de recherche, ce qui est très choquant par rapport à l'effet. Grâce à deux algorithmes différents, des photos de 64 X 64 pixels peuvent être restaurées à une résolution de 1024 X 1024 pixels et des détails. L'effet est très réaliste.

Il convient de souligner que les photos restaurées par Google via des algorithmes d'apprentissage automatique présentent nécessairement des écarts par rapport aux photos originales, mais lorsque nous ne pouvons pas obtenir la scène originale (comme les anciennes photos du passé), une "restauration" est au plus près du réel Les photos sont vraiment précieuses.

Image de : Google

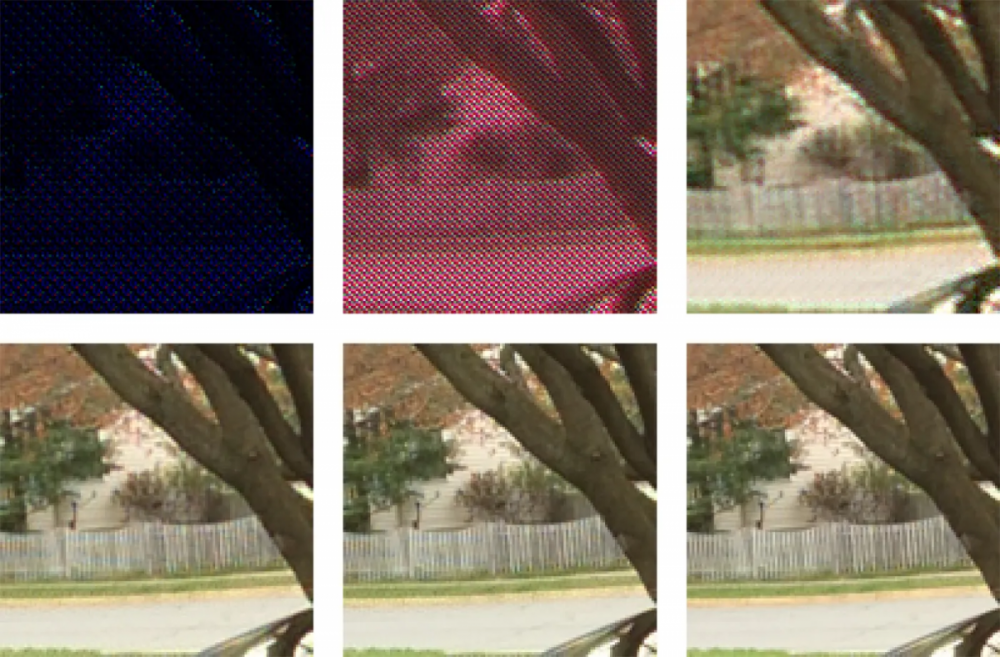

Selon Google, réparer une photo "mosaïque" consiste en deux processus : "détruire" et "réorganiser".

Premièrement, afin de creuser autant que possible les détails graphiques du bloc de pixels "mosaïque", les chercheurs de Google traiteront d'abord les échantillons de test avec l'algorithme de bruit gaussien pour obtenir une "carte de flocon de neige" composée entièrement de bruit, qui ressemble à un peu comme le téléviseur analogique précédent.L'image du signal.

▲ La troisième ligne est l'algorithme de réparation de Google et la quatrième ligne est la référence de l'image d'origine.

Ensuite, les chercheurs utilisent des algorithmes de réseau de neurones pour inverser le processus de destruction du bruit gaussien, synthétiser de nouvelles données d'image via le processus de restauration inverse et réduire autant que possible le bruit de l'image de bruit pur pour obtenir une image claire.

Image de : Google

Le principe de la restauration d'image n'est pas compliqué, mais l'algorithme mis en jeu n'est pas simple. Afin de restituer la grande image haute définition "restauration un à un", les chercheurs de Google ont proposé l'algorithme de super-résolution SR3 et le modèle de diffusion en cascade CDM Améliorez la précision de la restauration grâce à l'apprentissage de la comparaison d'images à grande échelle.

Il convient de mentionner que bien que nous ayons toujours utilisé « mosaïque » pour désigner des images à faible résolution et à faible résolution de gros pixels, cela est essentiellement différent des vraies photos codées.

Image de : Google

La raison pour laquelle l'algorithme de restauration de Google peut rendre les images basse définition claires est essentiellement basée sur les informations d'image correctes contenues dans l'image elle-même, à travers la comparaison et la mise en correspondance d'innombrables images dans une énorme base de données, et enfin un remplissage approximatif de pixels simulé.

Lorsque la photo est maculée de mosaïque, les informations d'image contenues dans la photo changent.

En termes simples, l'algorithme de mosaïque consiste à sélectionner au hasard la couleur des pixels d'une zone à un intervalle fixe, puis à obtenir la valeur moyenne de tous les pixels de la zone et à la remplir dans le carré avec une nouvelle couleur.

Après le codage, les informations de pixel d'origine sont perdues et seules les informations d'erreur calculées aléatoirement sont obtenues. À ce stade, laissez le machine learning les restaurer, tout comme lui demander de répondre correctement à une question qui est complètement fausse. impossible de répondre.

Donc, si quelqu'un veut utiliser l'algorithme de Google pour extraire certaines des informations privées effacées, il peut dissiper cette idée.

Tu es entré dans le futur

Image de : Google

L'algorithme de réparation HD de Google est susceptible d'être finalement appliqué aux logiciels de traitement d'image Google tels que Google Photos, Snapseed, etc. Il deviendra l'un de nos outils de retouche photo comme le HDR, la correction d'angle de vision et d'autres algorithmes.

Pour en revenir au film "Blade Runner", Esper est en fait une machine très intéressante, c'est un peu une fusion de la technologie analogique et de la technologie numérique.

D'une part, il est très avancé, les gens peuvent le contrôler avec la voix et obtenir un grossissement sans perte; d'autre part, il est très démodé, avec un grand écran clair mais toujours une structure CRT, le processus d'importation de photos est pour numériser à partir de photos physiques.

Selon l'effet du film, Esper peut être une certaine coordonnée de la photo à point fixe, puis agrandir la photo à travers une structure de lentille précise (microscope). En y regardant maintenant, l'idée d'une amplification sans perte est très avancée, mais la technologie de simulation n'est évidemment pas un avenir réaliste.

Pour les gens modernes, les téléphones portables et les ordinateurs entre leurs mains sont l'"Esper" de tout le monde.

Image de : Adobe

Maintenant que les photos ont déjà achevé l'évolution d'un flux de travail entièrement numérique, il n'est pas difficile d'agrandir des photos avec la technologie numérique. En d'autres termes, vous êtes effectivement entré dans le "futur" décrit dans "Blade Runner".

Image de : Adobe

La super-résolution d'image a toujours été un sujet de recherche brûlant dans le domaine de la vision par ordinateur.Des entreprises telles qu'Adobe développent des technologies de traitement d'image connexes, qui ont été appliquées dans des logiciels de traitement graphique tels que Photoshop et Lightroom.

Prenons l'exemple de Photoshop. Après avoir importé l'image au format RAW, vous pouvez sélectionner la fonction "Super résolution" de la fonction "Améliorée". Le logiciel se référera à un contenu similaire pour enrichir la texture de l'image et agrandir la résolution de l'image par 4. L'ensemble du processus Cela prend environ une minute.

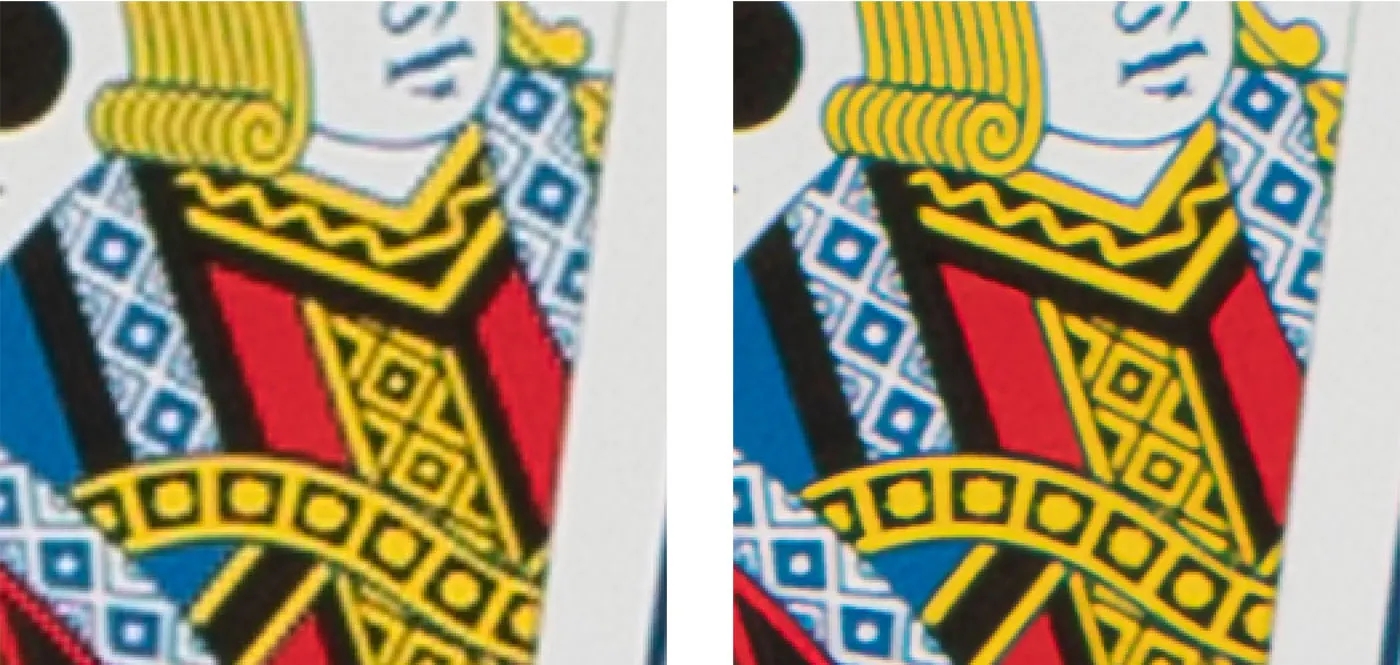

Image de : Adobe

On peut voir sur les photos avant et après l'amélioration du contraste que la netteté des photos a été considérablement améliorée après l'augmentation de la résolution, et que certains détails flous et méconnaissables sont également devenus clairs.

Adobe a mentionné dans un blog technique publié en mars de cette année que l'algorithme de super-résolution qu'il utilise a également suivi de nombreuses formations en apprentissage automatique et s'améliore et s'améliore constamment.

Image de : Adobe

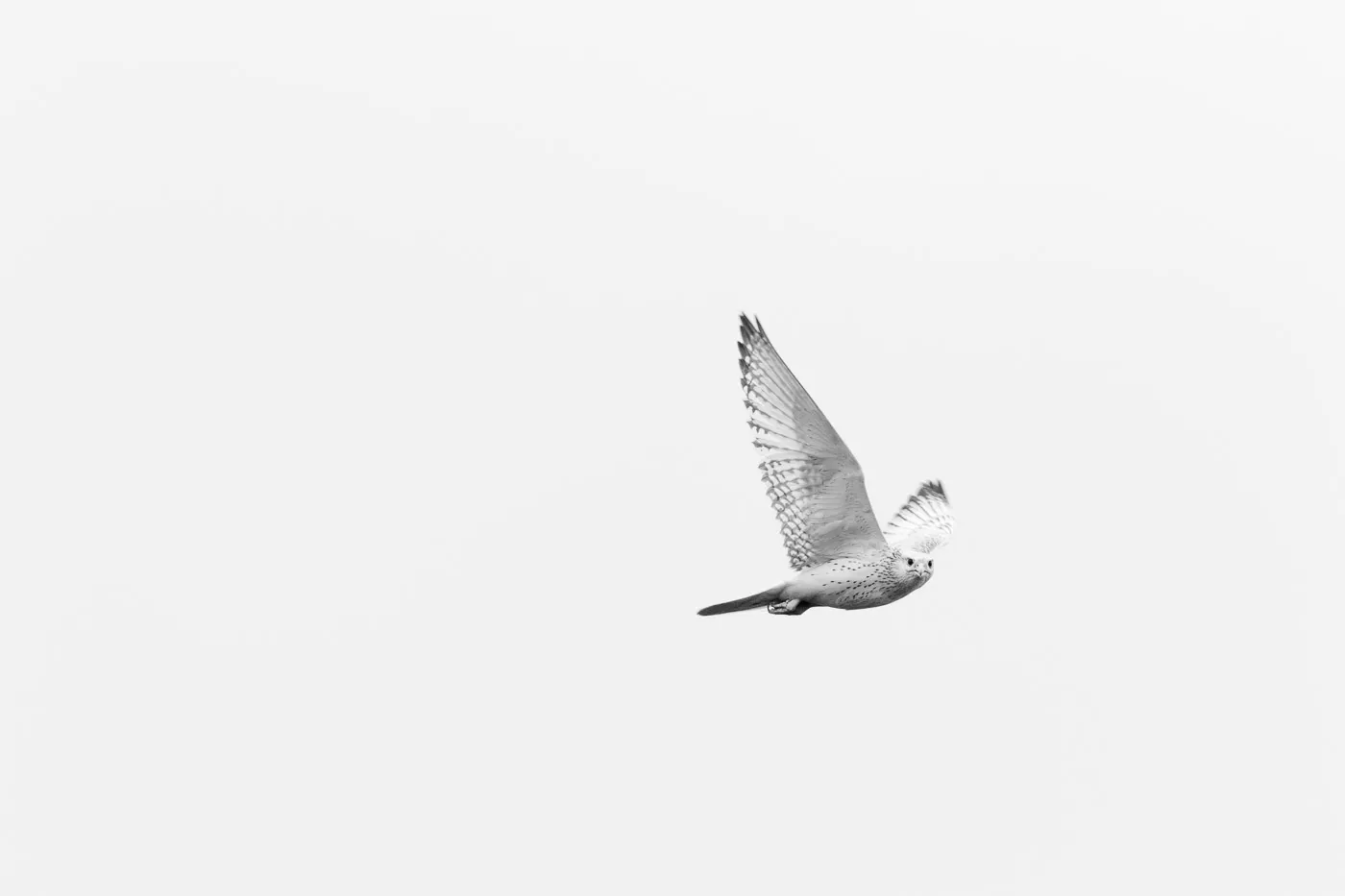

Est-il judicieux d'exploser la résolution des images ? Peut-être qu'après avoir pris une photo, vous ne l'agrandirez pas pour approfondir chaque détail, mais lorsque vous devez imprimer cette photo, la résolution de l'imagerie de la photo détermine directement la taille maximale de l'impression.

Ceci est particulièrement important pour les photographes. Parfois, lors de la prise de vue de paysages avec un objectif grand angle, un aigle survole le ciel. Les détails des plumes de l'aigle ne peuvent pas être capturés avec un objectif grand angle. Il est possible d'obtenir la photo vous voulez.

▲ Commencez par recadrer, puis effectuez un zoom avant avec des super pixels pour obtenir des photos de 10 millions de pixels. Image de : Adobe

Adobe a utilisé une photo de 2,5 mégapixels dans son blog à titre d'exemple et a utilisé la fonction de super-résolution pour l'agrandir à 10 millions de pixels afin qu'elle puisse être imprimée en une photo "décente". Adobe décrit ce processus comme un "zoom numérique". "

En comparant les algorithmes d'Adobe et de Google, il existe quelques différences entre les deux. Adobe nécessite des photos au format RAW qui conservent une grande quantité d'informations d'origine pour les calculs, tandis que l'algorithme de Google peut restaurer des photos sur la base d'informations très approximatives.

▲ L'algorithme d'Adobe continue de progresser grâce à de nombreux apprentissages automatiques.

À l'heure actuelle, les deux algorithmes ne sont pas encore complètement matures et beaucoup d'apprentissage automatique est nécessaire pour améliorer la précision du calcul et de la restauration.

Mais ce qui est certain, c'est que la technologie de super-résolution deviendra l'une des technologies d'imagerie les plus populaires dans un avenir proche, aidant les gens à se débarrasser des limitations des téléobjectifs et autres équipements, et à enregistrer chaque détail et chaque instant de la vie. Afin d'y voir un monde plus clair, nous n'avons cessé d'explorer.

#Bienvenue pour suivre le compte WeChat officiel d'Aifaner : Aifaner (WeChat ID : ifanr), un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo