Pourquoi le smartphone d’Apple, critiqué par Musk, est-il plus proche de la forme idéale de l’IA ?

La WWDC d'Apple de cette année était une conférence sur l'IA annoncée à l'avance, et il était rare que Cook exagère l'atmosphère à plusieurs reprises par rapport à il y a quelques mois.

Mais quand vous aurez vu la conférence de presse entre OpenAI et Google et Microsoft le mois dernier, vous aurez l’impression que cela ne ressemble pas à une conférence sur l’IA.

Apple n'a même pas officiellement publié un grand modèle, n'a pas comparé les paramètres des concurrents et ses capacités multimodales et d'autres aspects conventionnels, n'a pas parlé de l'avenir de l'AGI et n'a pas lancé un produit phare comme Copilot, que les médias a crié comme "tout renverser l'application".

Au lieu de cela, Apple a inventé un mot appelé Apple Intelligence (ci-après dénommé « Apple Intelligence »). Cette racine homophonique indique aux gens que ce qu'Apple publie n'est pas un logiciel ou du matériel, mais une nouvelle expérience utilisateur.

Cook estime que l'IA doit être centrée sur l'utilisateur et doit être intégrée de manière transparente à votre expérience quotidienne :

Elle doit vous connaître et se baser sur votre contexte personnel, comme votre vie quotidienne, vos relations, vos communications, etc., qui dépassent tous le cadre de l'intelligence artificielle. Il s'agit de l'intelligence personnelle et du prochain grand pas d'Apple.

Apple a choisi d'infiltrer les capacités d'IA dans l'ensemble de l'écosystème, ce qui signifie qu'il est difficile d'assister à la démonstration enthousiaste de GPT-4o, mais cette "sans surprise" est différente de la sortie de l'iPhone 15 l'année dernière, qui était un smartphone. Un profil de la fin d’un grand récit.

Apple Smart ouvre la voie à un nouveau récit pour les applications d'IA. Il ne s'agit peut-être pas seulement d'un nouveau chapitre pour Apple.

Intelligence personnelle et confidentialité personnelle

Lors du dévoilement d'Apple Smart, Apple a résumé ses cinq caractéristiques : puissance, facilité d'utilisation, intégration approfondie, personnalisation et privatisation .

Si vous souhaitez que l’IA intègre les détails de la vie sans même se faire remarquer, vous devez lui faire connaître mieux que vous. Cela signifie également que plus vous disposez de données personnelles, plus elles ont de chances d'être réalisées. La question qui se pose alors est la suivante : est-ce basé sur le transfert de données personnelles ?

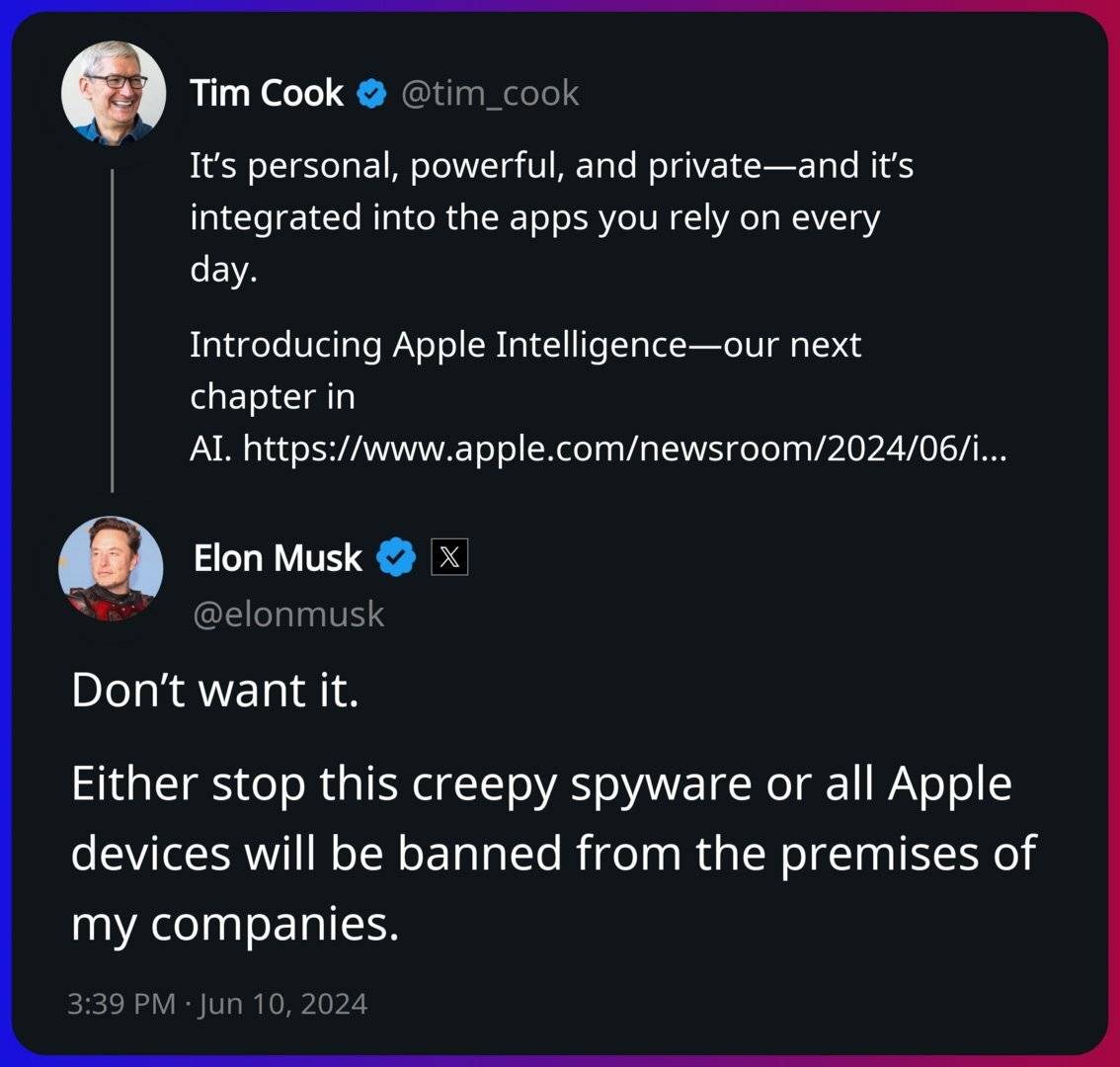

C’est aussi la raison pour laquelle Musk a critiqué Apple après la conférence de presse d’aujourd’hui.

Il a même déclaré directement sous le tweet de Cook que "tous les appareils Apple seront interdits d'entrer dans les bureaux de mon entreprise" et a remis en question la protection de la vie privée des utilisateurs après la coopération entre Apple et OpenAI.

En fait, c'est effectivement un problème qui va inquiéter les utilisateurs, notamment pour Apple, qui compte 2,2 milliards d'appareils actifs. Mais cela va également à l’encontre de l’approche toujours prudente d’Apple en matière de protection de la vie privée.

Dans le passé, les appareils Apple et les fonctions liées à l’IA étaient essentiellement mis en œuvre par l’apprentissage automatique local, nécessitant une petite quantité de données, largement fondées sur des considérations de confidentialité personnelle.

Bien qu'Apple n'ait pas présenté ces problèmes un par un lors de la conférence de presse, grâce à certaines sessions de partage de médias après la conférence, nous en avons également appris davantage sur la gestion intelligente de la vie privée par Apple. Nous pouvons essayer de clarifier certains problèmes actuellement controversés sur Internet. .

APPSO a appris qu'Apple avait fourni deux nouvelles solutions de traitement de données impliquant le cloud.

Premièrement, les utilisateurs n'ont pas besoin d'envoyer toutes leurs données, tous leurs e-mails, tous leurs messages, toutes leurs photos, tous leurs documents vers le cloud de quelqu'un d'autre et de les stocker là-bas afin que le modèle de serveur puisse les détecter si nécessaire.

Au lieu de cela, l'intelligence Apple sur l'appareil de l'utilisateur détermine quelles petites informations sont pertinentes pour répondre à la question. Par conséquent, les questions posées au cloud ne contiennent que cette petite partie de l'information, et Apple garde une petite partie de l'information confidentielle.

Apple a créé un système de cryptage pour que les iPhones, par exemple, ne puissent communiquer qu'avec des serveurs dotés de balises désignées. Autrement dit, s'il y a des modifications dans le logiciel sur ce serveur, sa signature changera et vous pourrez refuser de communiquer avec lui.

Y compris le traitement des données utilisateur en coopération avec OpenAI, les adresses IP des utilisateurs ayant des comptes enregistrés seront masquées lors de l'utilisation des services et OpenAI n'est pas autorisé à enregistrer les demandes des utilisateurs.

Cela peut dans une certaine mesure répondre aux doutes du public, et il est en effet nécessaire qu'Apple divulgue davantage d'informations à ce sujet. Le smartphone d'Apple, qui met l'accent sur la « personnalisation », doit résoudre ce problème s'il veut réaliser le plan présenté lors de la conférence de presse.

De plus , le modèle de coopération entre Apple et OpenAI n'est probablement pas exclusif. À l'avenir, il est évidemment possible de coopérer avec d'autres grands modèles dans différents scénarios et régions.

Ce n'est pas un problème auquel Apple est confronté en tant que fabricant, mais peu importe qui il s'agit, il doit choisir avec soin ses partenaires. Lorsque l'IA entrera dans la vie avec un grand nombre de terminaux, la bataille entre confidentialité et commodité deviendra plus intense. même si cela est considéré comme plus tolérable. Il en va de même pour le marché chinois.

Une conférence de presse sans matériel, mais elle a un grand impact sur le matériel

De la dénomination à la méthode de mise en œuvre de l'intelligence Apple, nous pouvons voir qu'Apple souhaite définir le matériel d'IA à sa manière et pénétrer les capacités d'IA dans l'ensemble de l'écosystème, plutôt que de lancer une certaine application et fonction tueuse.

C'est la plus grande différence par rapport à la grande quantité de matériel d'IA actuel. L'année dernière, les fabricants de matériel ont lancé la tendance du matériel d'IA. Beaucoup d'entre eux assimilent simplement le matériel d'IA à de grands modèles + équipements terminaux. En conséquence, ils lancent souvent des produits semi-finis dotés d'une certaine fonction et d'une mise à jour expérimentale.

C'est également une raison importante pour laquelle le matériel d'IA de célébrités Internet tel que Ai Pin et Rabbit R1 est tombé dans la poussière après une vague d'enthousiasme.

L'idée de l'intelligence Apple est similaire à la manière dont l'apprentissage automatique a été appliqué aux produits Apple dans le passé. Bien qu'Apple ne mentionne pas beaucoup l'IA, elle a été intégrée dans de nombreuses petites fonctions couramment utilisées, par exemple le mode audio adaptatif. des AirPods Pro est également mis en œuvre grâce à l’apprentissage automatique.

Beaucoup de gens disent qu'Apple a pris du retard à l'ère des grands modèles. Cela est probablement vrai d'un seul point de vue technologique, mais ce dont Apple a besoin n'a jamais été d'un modèle plus puissant que ChatGPT, mais de transformer la puissance de calcul en un modèle holistique plutôt que partiel. expérience.

Bien que le système et les logiciels soient les protagonistes de cette conférence, le matériel constitue un élément non spécifié mais crucial. APPSO a appris que cette fois, Apple Smart exécute un modèle avec une échelle de 3 milliards de paramètres côté appareil .

Apple est discret mais confiant à ce sujet. Il semblerait que les ingénieurs d'Apple pensent qu'il s'agit du meilleur modèle côté terminal actuellement.

À titre de comparaison, les paramètres de Phi-Silica, un petit modèle côté appareil publié par Microsoft il n'y a pas si longtemps, sont de 3,3 milliards, tandis que les modèles des fabricants nationaux de téléphones mobiles dans la plupart des scénarios côté appareil ont des paramètres compris entre 7 milliards et 13 milliards. .

Des paramètres plus élevés signifient probablement des performances plus élevées, mais si les mêmes performances peuvent être obtenues avec une échelle de paramètres plus petite, cela aura une plus grande importance pour la combinaison d'appareils mobiles et de grands modèles.

De plus, de nombreuses études du secteur ont prouvé que les performances des petits modèles optimisés ne peuvent pas être inférieures à celles des grands modèles dans certains scénarios d'utilisation. Le petit modèle open source d'Apple, OpenELM, précédemment exposé, couvre 270 millions, 450 millions, 1,1 milliard et 3 milliards de paramètres.

Bien qu'Apple estime que les utilisateurs apprécient l'expérience plutôt que l'échelle des paramètres, le modèle côté appareil est probablement celui où Apple déploie discrètement ses efforts.

Si tout se passe bien, Apple est très susceptible de promouvoir une nouvelle vague de matériel, du Vision Pro aux AirPod avec caméras, en passant par les rumeurs de robots de ménage. Grâce à ses solides capacités de conception, de production et de chaîne d’approvisionnement, Apple peut réutiliser les logiciels pour façonner le matériel.

Cette conférence, qui n'a dévoilé aucun nouveau matériel, est peut-être la conférence qui a eu le plus grand impact sur le matériel Apple ces dernières années.

Siri deviendra le véritable système d'exploitation d'Apple

Lorsqu’Apple souhaite intégrer des capacités d’IA dans son système d’exploitation, Siri devient un pont important.

Lors de la séance de partage médiatique d’aujourd’hui, John Giannandrea, vice-président senior de la stratégie d’apprentissage automatique et d’intelligence artificielle d’Apple, a déclaré :

Siri n'est plus seulement un assistant vocal, c'est en réalité un système d'appareils.

Nous avons également prédit dans l'article d'aperçu de la WWDC que le but ultime de l'IA d'Apple est de réaliser ce scénario : se réveiller le matin, réveiller Siri avec le mot "Siri", puis le laisser ouvrir le compte public WeChat "Aifan". euh" pour lire les derniers articles. De cette façon, vous pouvez écouter le reportage matinal d'Ai Faner sans utiliser vos mains du tout.

La capacité de Siri à devenir intelligent est en fait une amélioration de sa capacité de compréhension sémantique, et il peut comprendre la signification de toutes ces données comme un être humain. Cette compréhension s’enrichira au fil du temps.

Le langage interactif naturel, après l'essor des grands modèles, a toujours été considéré comme remplaçant l'interface graphique GUI de nos appareils actuels. Derrière cela se cache l'amélioration significative de la capacité de l'ordinateur à comprendre le langage naturel.

L'arrivée de l'interaction basée sur le langage naturel n'affectera pas seulement nos appareils portables, mais la forme des applications sera également complètement modifiée. Par exemple, Siri appelle des capacités spécifiques via des API pour effectuer diverses tâches, ou même des applications ne seront plus nécessaires. ils seront utilisés sous une nouvelle forme.

Le co-fondateur d'OpenAI, Andrej Karpathy, a également exprimé un point de vue similaire. Il pense que c'est la chose la plus excitante chez Apple et a cité six raisons :

- E/S multimodales : prend en charge la lecture et l'écriture de texte, d'audio, d'images et de vidéo. On peut dire qu’il s’agit d’API natives humaines.

- Agence : permet à toutes les parties du système d'exploitation et des applications d'interagir via des « appels de fonction » ; le LLM du processus noyau peut planifier et coordonner le travail en fonction des requêtes des utilisateurs.

- Expérience transparente : intégrez pleinement ces fonctionnalités de manière hautement transparente, rapide et toujours active. Pas besoin de copier et coller des informations ou d'inviter le projet, ajustez l'interface utilisateur en conséquence.

- Proactivité : il ne suffit pas de suivre les invites, mais également d'anticiper les invites, de fournir des suggestions et de les exécuter de manière proactive.

- Hiérarchie de délégation : exécutez autant d'intelligence que possible sur l'appareil (Apple Silicon est idéal pour cela), mais permet également de déléguer le travail vers le cloud.

- Modularité : permet au système d'exploitation d'accéder et de prendre en charge l'ensemble de l'écosystème LLM en pleine croissance (comme la sortie de ChatGPT).

- Protection de la vie privée : <3

Les détails d’Apple WWDC d’aujourd’hui pointent tous vers cet avenir. Mais Apple sait aussi que cela ne se réalisera probablement pas d'ici quelques années, alors il vous dit simplement qu'au moins Siri est beaucoup plus facile à utiliser.

Depuis deux ans, ce qui nous manque le plus, c'est en fait le « Amazing » apporté par l'AIGC. Mais tout comme les téléphones mobiles et Internet, il n’existe toujours aucun signe de technologie ou de produits profondément ancrés dans le tissu de la vie.

Hydrater les choses en silence est le but ultime de l'innovation technologique et la forme idéale de l'IA. C'est aussi l'aspect le plus attendu de l'intelligence d'Apple.

# Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (ID WeChat : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo