Après la création d’OpenAI : rêves, désaccords et AGI

Note de l'éditeur : Lorsque Sam Altman a développé la vision d'OpenAI, il a déclaré sans hésitation qu'ils souhaitaient développer une AGI (Artificial General Intelligence) qui soit bénéfique et sûre pour toute l'humanité.

Avec l'injection de capital de Microsoft, de nombreuses personnes ont commencé à en douter : OpenAI peut-il vraiment le faire ?

Face à cette question, Sam Altman a donné une réponse affirmative.

Bloomberg a récemment créé une série de podcasts de quatre épisodes, « Foundering : The OpenAI Story », documentant l'ascension de Sam Altman dans le but de mieux comprendre l'un des fondateurs les plus importants de notre époque.

Aujourd’hui, nous traduisons le deuxième épisode de cette série de podcasts. Il comprend les éléments suivants :

La nature multiforme de l'AGI : tout mettre en œuvre pour créer l'AGI est considéré comme une vision importante par OpenAI. Cela pourrait résoudre de nombreux défis mondiaux, mais pose également des risques sans précédent, notamment une intelligence artificielle incontrôlable et de graves conséquences sociales.

L'évolution d'OpenAI : de l'innovation basée sur les données au partage minutieux de modèles. Comment OpenAI reste-t-il « ouvert » malgré des facteurs commerciaux ?

Lutte de pouvoir chez OpenAI : le désir d'Elon Musk d'un plus grand contrôle a créé des désaccords avec certains employés d'OpenAI. Sous la direction de Sam Altman, OpenAI est passée du statut d'organisation à but non lucratif à celui d'organisation à but lucratif.

Lien du podcast original :

Je veux commencer par un rêve, un rêve de construire une IA.

Ce rêve est imaginé et écrit depuis des décennies, alors que l’humanité travaille ensemble pour créer une nouvelle entité plus puissante que nous-mêmes. Certains chercheurs pensent que ce rêve pourrait bientôt devenir réalité.

Un jour, les cerveaux numériques qui résident dans nos ordinateurs seront aussi performants, voire meilleurs, que nos cerveaux biologiques. Les ordinateurs deviendront plus intelligents que nous. Nous appelons cela l’intelligence artificielle générale (AGI).

C'est ce qu'a déclaré Ilya Sutskever, l'un des co-fondateurs d'OpenAI. Lors d’un Ted Talk l’année dernière, il s’est souvent comporté comme un mystique religieux en parlant de l’avenir de l’intelligence artificielle.

Mais maintenant, il parle simplement de la recherche de l’AGI, un type d’intelligence artificielle capable de penser et de résoudre des problèmes comme les humains. Il peut basculer librement entre jouer à des jeux, résoudre des problèmes scientifiques, créer de beaux arts et conduire des voitures.

L'objectif d'OpenAI est de créer une AGI. Dans le monde de l’IA, cette idée était très avant-gardiste, du moins elle l’était. Ilya décrit l’AGI comme un bond en avant presque mystique et capital, comme Prométhée apportant le feu, avec des conséquences qui seront énormes. Cela nous mènera vers la gloire technologique, mais aussi vers le chaos. Dans le documentaire "iHuman", il a exprimé sa confiance dans les changements futurs.

L’émergence de l’IA est une bonne chose aujourd’hui, car elle résoudra tous les problèmes auxquels nous sommes confrontés aujourd’hui. Il s'attaquera à l'emploi, à la maladie et à la pauvreté. Mais cela entraînera également de nouveaux problèmes. Le problème des fausses nouvelles deviendra plus grave, les cyberattaques deviendront plus extrêmes et nous disposerons d’armes d’IA entièrement automatisées.

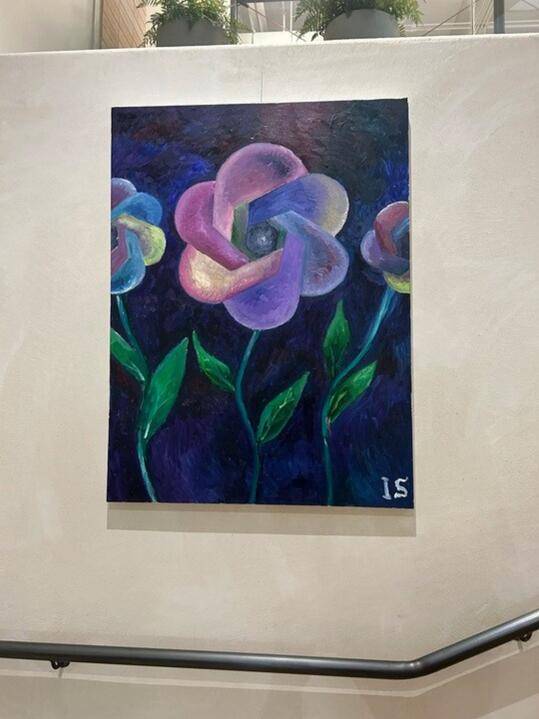

Ilya est un chercheur en IA très accompli qui a travaillé chez Google avant de rejoindre OpenAI. Il a une affection profonde et passionnée pour l'humanité. Il sait jouer du piano et dessiner. L'une de ses peintures est accrochée dans le bureau d'OpenAI. Il s'agit d'une fleur en forme de logo de l'entreprise.

Parallèlement, il est également très concentré sur la recherche en IA. Il a dit un jour à un journaliste : "Je vis une vie très simple. Je vais au travail et ensuite je rentre chez moi. Je ne fais rien d'autre. Il y a de nombreuses situations sociales auxquelles participer et de nombreuses activités auxquelles participer, mais je ne le fais pas". Je n'y participerai pas.

Il passe beaucoup de temps à observer la trajectoire de l’IA et à tenter de prédire l’avenir. Ilya s'inquiète particulièrement de savoir si AGI aura ses propres désirs et objectifs. Ce fantasme s’entend dans ses propos.

Ce n’est pas qu’il détestera activement les humains et voudra leur faire du mal, mais il deviendra trop puissant. Je pense qu’une bonne analogie est la façon dont les humains traitent les animaux. Nous ne détestons pas les animaux, mais lorsqu'il faut construire une autoroute entre deux villes, nous ne les consultons pas. Il est concevable que la surface de la Terre soit recouverte de panneaux solaires et de centres de données.

Je veux m'arrêter ici un instant, cela présente une image très forte et puissante selon laquelle nous créons une sorte de nouvelle existence. Il sera intéressé par nous, mais finalement indifférent, tout comme nous le sommes avec les cerfs.

Ce qui m'a le plus frappé dans cet enregistrement, c'est le ton d'Ilya, qui n'était pas de la peur, mais de la crainte. Ilya imagine une AGI qui pourrait nous renverser afin d'atteindre ses objectifs, un scénario dramatique difficile à vraiment imaginer. Cette conception d’une entité surnaturelle et omnipotente a une très forte connotation religieuse.

Je dois préciser que tout cela est entièrement théorique et que nous sommes encore loin de l'AGI. OpenAI fait actuellement de son mieux pour développer des modèles capables d’imiter les humains de manière crédible, mais il existe encore un grand écart entre l’imitation et l’IA capable de penser de manière indépendante. Pourtant, OpenAI veut le faire, et veut être le meilleur et le premier. Voici ce que Sam Altman a dit lors de son témoignage devant le Congrès en 2023 :

Ma plus grande préoccupation est l’énorme impact que nous aurons sur le monde. L'ensemble de notre domaine, de notre technologie et de notre industrie, peut causer un « préjudice important » au monde. C'est pourquoi nous avons créé cette entreprise. Je pense que si quelque chose ne va pas avec cette technologie, cela pourrait tourner « horriblement mal ».

Vous écoutez "Foundering" et je suis votre hôte Ellen Hewitt. Dans cet épisode, nous vous emmenons dans les débuts chaotiques et idéalistes d’OpenAI.

Nous discutons du rêve de construire une AGI toute-puissante, ce qui est important. Parce que c’est vers cela que progresse rapidement OpenAI, la course à la lune de cette génération. Nous discuterons de la manière dont la technologie de l'IA évolue de manière spectaculaire et rapide, et de la manière dont ce changement rapproche plus que jamais le rêve de l'AGI.

En quelques années seulement, elle est passée d’une idée curieuse qui faisait rire à une étape qui, selon certains experts, pourrait être franchie en quelques années. Sam Altman a même suggéré que cela pourrait se produire en 2028. Nous examinerons également les compromis faits par OpenAI pour poursuivre ce rêve.

Initialement, l’entreprise avait promis de partager largement ses recherches et de ne pas se laisser corrompre par la recherche du profit. Mais lorsque leur technologie a commencé à progresser et qu’il a semblé qu’ils pourraient acquérir une grande puissance, ils ont fait demi-tour. Ce moment critique s’est ensuite transformé en lutte de pouvoir au sein d’OpenAI, avec Sam Altman prenant les rênes.

Commençons par 2015. OpenAI venait d'être fondée à cette époque, avec un engagement d'un milliard de dollars d'Elon Musk, ainsi que des fonds d'autres donateurs. C'était un petit laboratoire de recherche naissant.

Au début, Sam et Elon n'étaient pas là très souvent. À l’époque, Sam dirigeait encore l’accélérateur de startups Y Combinator, mais il commençait à se positionner comme un leader d’opinion dans le domaine de l’IA. Il parlait en particulier de scénarios apocalyptiques en matière d’IA.

En 2015, il a déclaré dans un blog que le développement d’une intelligence artificielle surhumaine pourrait constituer la plus grande menace pour la pérennité de l’humanité. Il a également écrit que l’IA pourrait détruire tous les êtres humains de l’univers. La même année, il a mentionné lors d'un événement technologique qu'OpenAI était sur le point d'être créé.

En fait, je viens d’accepter de financer une entreprise effectuant des recherches sur la sécurité de l’IA. Vous savez, je pense que l’IA provoquera probablement la fin du monde. Mais en attendant, de grandes entreprises utiliseront des techniques avancées d’apprentissage automatique.

Je veux parler de cette citation. Il affirme que l’IA pourrait tous nous tuer tout en nous demandant de nous fier à ses conclusions d’expert. Mais il est aussi « désinvolte » lorsqu’il s’agit de gagner de l’argent.

Au début d’OpenAI, Sam et Elon n’étaient pas souvent impliqués dans le travail quotidien. Ils sortent et parlent aux gens, recrutent des talents, parlent aux journalistes. Ils viennent environ une fois par semaine pour faire le point sur les progrès. Ces jours-là, Sam intervenait dans la conversation puis partait.

Il me semble très intelligent, pointu et très efficace. Quand la conversation est terminée, c'est fini.

Il s'agit de Peter Abele, un chercheur qui a travaillé chez OpenAI pendant ses deux premières années. À ses débuts, OpenAI ressemblait à une startup typique, a-t-il déclaré. Pendant un certain temps, ils n’ont même pas eu de bureau et se sont réunis dans l’une des maisons des cofondateurs.

Nous avons commencé à travailler dans l'appartement de Greg Brockman dans le Mission District de San Francisco fin 2015 et début 2016. Nous nous asseyons essentiellement sur le canapé, sur le comptoir de la cuisine et au lit, et c'est là que se déroule le travail. C'est fou d'imaginer qu'un projet d'une telle envergure puisse démarrer ici. Nous avons 20 des meilleurs chercheurs en IA au monde qui se concentrent sur la réalisation de quelque chose qui n’a jamais été réalisé auparavant.

En l’absence de Sam et Elon, les principaux dirigeants étaient deux hommes qui joueraient plus tard des rôles importants. Ce ne sont pas des célébrités mais ils joueront un rôle énorme dans le futur.

L'un est Greg, dont l'appartement leur sert de bureau, et l'autre est Ilya, le scientifique en IA dont nous avons entendu parler au début de l'épisode. Vous pouvez considérer Greg comme le bourreau de travail en charge des opérations commerciales et Ilya comme le génie de l'IA.

Ensemble, ils dirigeaient OpenAI, et Peter se souvenait d'avoir parcouru les rues de San Francisco avec Ilya chaque semaine, de parler de la situation dans son ensemble, de se demander : résolvons-nous le bon problème ?

Je pense qu’il a vu le potentiel de l’IA plus tôt et plus clairement que quiconque. Il était plus optimiste que les autres et faisait des analogies. Par exemple, un réseau neuronal n’est qu’un programme informatique, juste un circuit, nous le programmons simplement d’une manière différente.

Pendant ce temps, Greg continuait à travailler dur.

Greg est le genre de personne qui met tout son cœur et son âme dans son travail. Il pourrait continuer à travailler et à travailler. J'ai vu des gens comme ça, mais très peu.

Même après qu'OpenAI ait quitté l'appartement de Greg, il vivait toujours au bureau. Un ancien employé a déclaré qu'il travaillait toujours à son bureau lorsqu'ils arrivaient au travail le matin et qu'il tapait encore sur son clavier lorsqu'ils partaient le soir.

Lorsque Greg s'est marié quelques années plus tard, il a même organisé une cérémonie laïque au bureau. Décorée d'un grand tissu de fond fleuri, la forme de la fleur est également le logo OpenAI. La bague était tenue par une main de robot et le célébrant du mariage était Ilya.

Lorsque Greg et Ilya ont rejoint OpenAI, ils n'avaient pas besoin d'argent. Ilya a vendu une entreprise à Google, et Greg possédait une grande partie de Stripe, et cette entreprise valait des dizaines de milliards de dollars.

Dans la Silicon Valley, la raison habituelle pour laquelle les gens créent des startups est parce qu’ils pensent pouvoir créer une entreprise lucrative. Mais OpenAI est une organisation à but non lucratif. Greg et Ilya ont été inspirés par ce rêve.

Voici Reid Hoffman, l'un des premiers donateurs d'OpenAI :

Il n’y a pas de rendement des capitaux propres pour l’équipe initiale. Ils le font pour l'humanité.

"C'est pour l'humanité", a toujours dit OpenAI. Leur site Web indique que notre mission est de garantir que l’AGI profite à toute l’humanité.

Eh bien, ce n’est un secret pour personne que la Silicon Valley aime les grandes déclarations de mission et que WeWork souhaite promouvoir une prise de conscience mondiale, mais la déclaration de mission d’OpenAI est encore plus grandiose, avec des connotations d’altruisme.

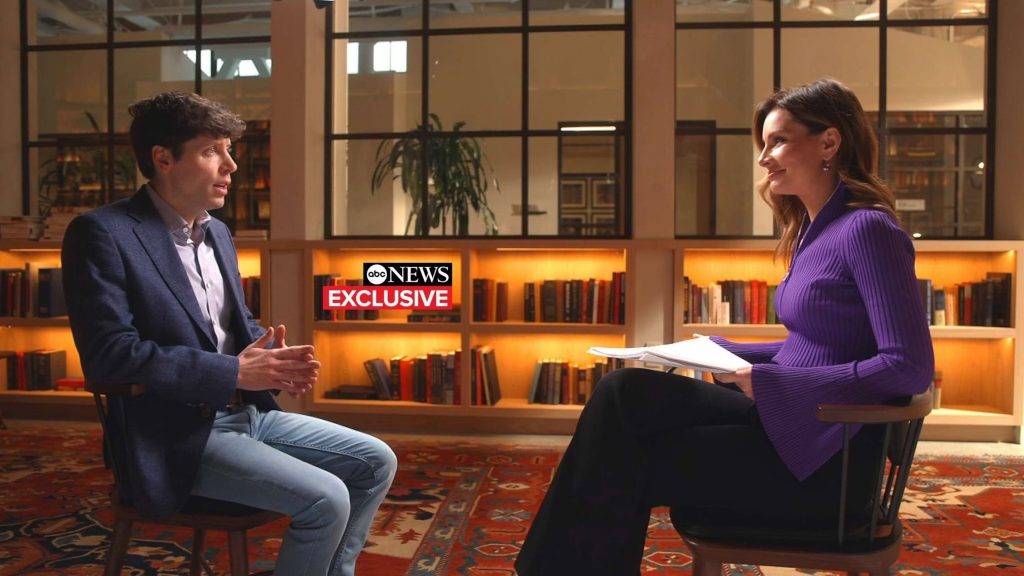

Lorsque Sam parle du travail de l'entreprise, il évoque souvent des catastrophes potentielles. Ici, il parle à Rebecca Jarvis d'ABC, sa voix à nouveau sérieuse alors qu'il se positionne comme un leader d'opinion dans le domaine. Alors, quel est le pire résultat ?

Sam Altman : Une chose qui me préoccupe particulièrement est que ces modèles pourraient être utilisés à des fins de désinformation à grande échelle. Maintenant qu’ils s’améliorent dans l’écriture du code informatique, je crains que ces systèmes ne soient utilisés pour des cyberattaques offensives.

Rebecca Jarvis : Vous faites valoir un point important, à savoir que les humains qui contrôlent les machines disposent désormais également d’un pouvoir énorme.

Sam Altman : Nous sommes très préoccupés par le fait que les gouvernements autoritaires développent cette technologie.

Rebecca Jarvis : Poutine a dit un jour que celui qui remporterait cette course à l’IA contrôlerait fondamentalement l’humanité. Êtes-vous d'accord avec ce constat?

Sam Altman : C’est en effet une déclaration effrayante.

Sam dit que cette chose est si précieuse que les superpuissances mondiales se battront pour l'acquérir. Les sceptiques croient que si vous donnez l'impression que ce sur quoi vous travaillez est important, vous attirerez plus d'attention et de financement. Nous nous concentrerons sur cette perspective dans le prochain épisode.

Aux débuts d’OpenAI, leurs plans pour sauver l’humanité n’étaient pas clairs. Leur stratégie était un peu dispersée, voici le souvenir de Peter :

Nous avons examiné la robotique, où nous avons fait quelques recherches ; nous avons examiné les robots analogiques, où nous avons acquis beaucoup d'expérience ; et nous avons examiné les agents numériques qui peuvent effectuer diverses tâches sur le Web. comme réserver des vols. Nous nous sommes également penchés sur les jeux vidéo.

OpenAI affirme que l’un de ses premiers objectifs sera de construire un robot majordome capable de dresser et de débarrasser les tables. Comme la servante des Jetsons.

La société a également construit une main robotique capable de résoudre un Rubik's Cube d'une seule main et a déployé beaucoup d'efforts pour développer un robot capable de jouer à Dota 2, un jeu en ligne multijoueur extrêmement populaire. Ils pensent que la complexité de l’environnement de jeu peut permettre à l’IA de mieux naviguer dans le monde réel.

Voici quelqu'un qui teste le bot :

Ce robot est génial, bien meilleur que ce à quoi je m'attendais.

Ces robots Dota rivalisent même avec des joueurs professionnels :

Préparez-vous à l'avance, l'action commence ! Ainsi, l'IA a reçu la première goutte de sang…

Un robot capable de jouer à Dota est techniquement impressionnant, mais cela ne semble pas être le cas pour le commun des mortels, et les applications commerciales de ces produits ne sont pas immédiatement évidentes. Voici un commentaire d'un ancien employé :

Nous faisons des choses aléatoires et voyons ce qui se passe. On a parfois l'impression qu'il y a un grand écart entre ce qui a été construit et ce qui a été imaginé. Les gens programment des robots pour qu’ils jouent à des jeux vidéo pendant la journée, puis s’assoient autour de la table pour déjeuner et parlent de sauver l’humanité.

Une idée répandue dans le domaine de l’IA est que pour créer quelque chose de puissant, il faut parfois commencer par quelque chose de trivial. Les jeux vidéo et les robots domestiques ouvriront la voie aux voitures autonomes et à l’IA qui guérit le cancer.

Au sein d'OpenAI, ils se comparent parfois au projet Manhattan, l'équipe chargée de construire la première bombe atomique, et ils pensent que c'est une bonne chose, ambitieuse et importante. Voici ce que m'a dit un autre ancien employé :

C'est une course aux armements, ils veulent tous créer le premier AGI et ils pensent qu'ils peuvent le faire le mieux. Je ne vois pas beaucoup de crainte à propos de l’IA elle-même, je vois juste de l’enthousiasme à l’idée de développer l’IA.

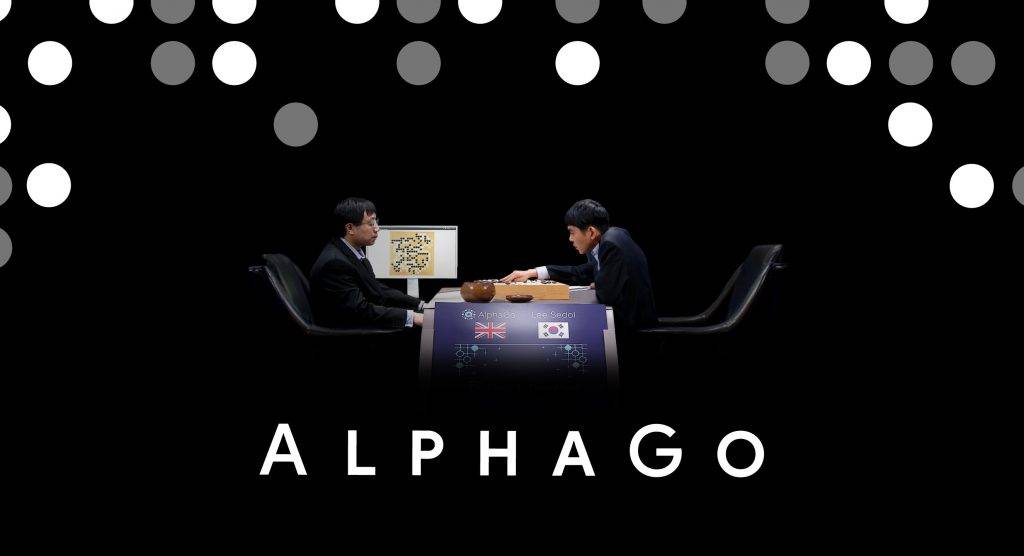

En 2015, l’IA était très différente de ce qu’elle est aujourd’hui : elle était plus faible et plus difficile à entraîner. La grande avancée à l'époque était qu'un robot était capable de battre les meilleurs joueurs du monde au Go, un jeu de plateau stratégique complexe venu de Chine. Mais cette IA ne peut que jouer au Go, elle ne peut rien faire d'autre.

Il s'agit d'Oren Etzioni, professeur d'informatique et ancien directeur de recherche d'un institut de recherche en IA :

Ces systèmes sont à domaine restreint et très ciblés. Le système qui joue au Go ne peut même pas jouer aux échecs, encore moins traverser la rue ou comprendre une langue. Et un système qui prédit les fluctuations du prix des billets d’avion et peut prédire avec une grande précision les augmentations ou les diminutions du prix des billets d’avion ne peut pas gérer le texte. Donc, fondamentalement, chaque fois qu'il y a une nouvelle application, vous devez former un nouveau système. Cela prend beaucoup de temps, nécessite beaucoup de données annotées, etc.

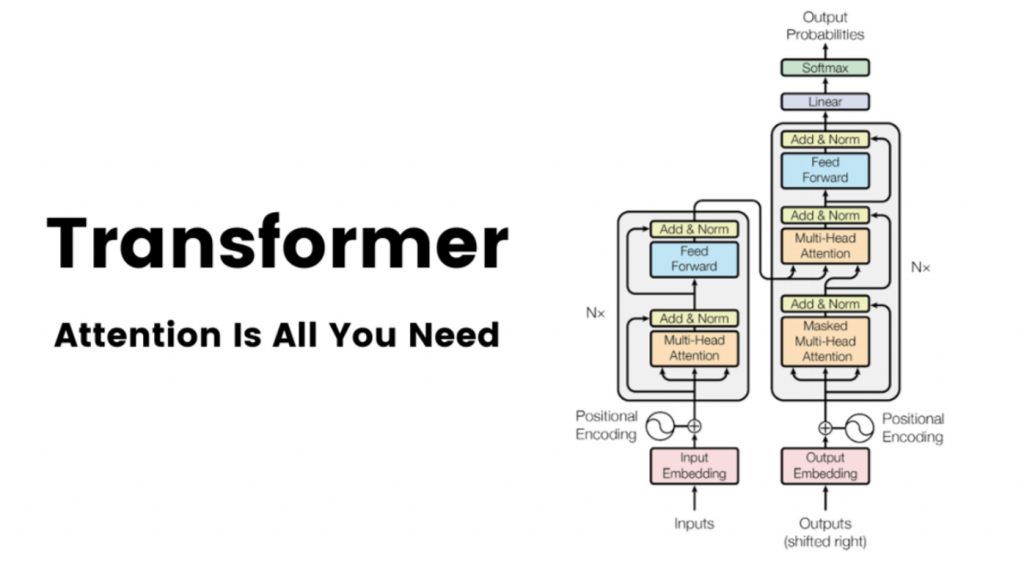

Mais ensuite, la technologie de l’IA a fait une avancée majeure. En 2017, une équipe de chercheurs de Google Brain a publié un article intitulé « L’attention est tout ce dont vous avez besoin ». Dans cet article, ils décrivent une nouvelle architecture d'IA appelée Transformer.

Transformer a fait quelque chose de très important pour son époque. Le système d'IA doit saisir des données très spécifiques, et chaque élément de données doit être étiqueté, c'est correct, c'est faux ; c'est du spam, pas du spam ;

Mais Transformer permet à l’IA de recevoir des données désordonnées et non étiquetées. En fait, il peut le faire plus efficacement que prévu, en utilisant moins de puissance de calcul.

Désormais, ces modèles basés sur Transformer peuvent apprendre par eux-mêmes. C'est un peu comme si vous vouliez apprendre à lire à un enfant, vous deviez embaucher un tuteur pour s'asseoir là et utiliser des cartes flash, mais maintenant vous pouvez laisser l'enfant aller seul à la bibliothèque et il en ressortira en sachant comment lire et écrire.

C’est une réalité surprenante et douloureuse, comme me l’a décrit un investisseur, que la meilleure IA ne vient pas des techniques de formation les plus spécialisées, mais de celles qui contiennent le plus de données.

Peter, l'un des premiers employés d'OpenAI, affirme qu'Ilya a immédiatement vu son potentiel :

Ilya a réagi avec certitude, affirmant qu'il s'agissait d'une avancée majeure à laquelle nous devions prêter attention.

Même aux débuts d’OpenAI, Ilya avait toujours eu le pressentiment que les avancées majeures en matière d’IA ne proviendraient pas d’une modification particulière ou d’une nouvelle invention, mais d’un plus grand nombre de données, injectant de plus en plus de carburant dans le moteur. Désormais, Ilya dispose de recherches pour étayer son hypothèse.

Voici ce qu'Oren a encore dit :

Ilya d'OpenAI est connu pour son point de vue selon lequel les données et leur volume, si nous les augmentons de manière significative, nous mèneront là où nous devons être. Ce n’est pas une croyance commune, et de nombreuses personnes très intelligentes et célèbres, dont moi-même, ne l’avaient pas prévu.

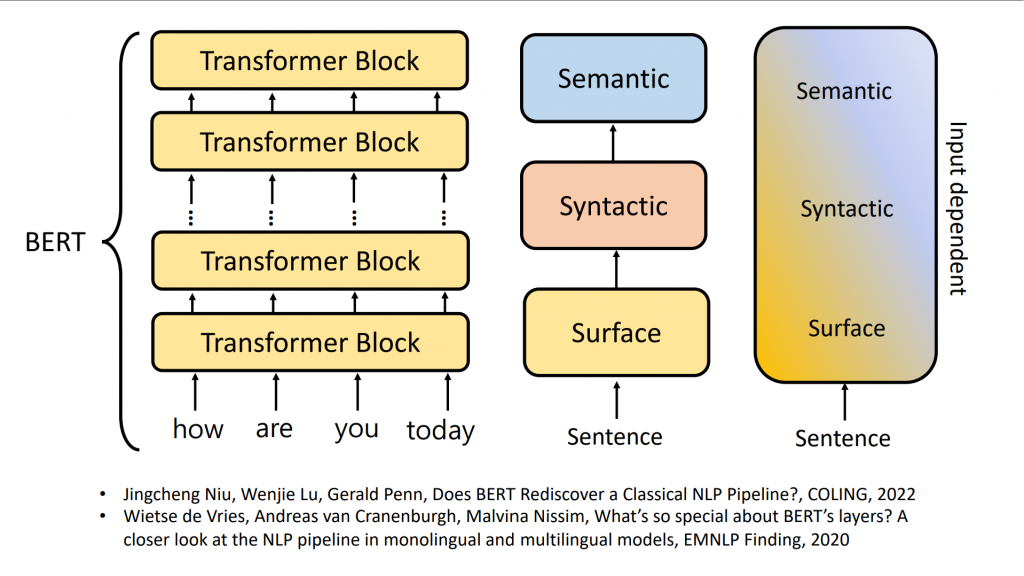

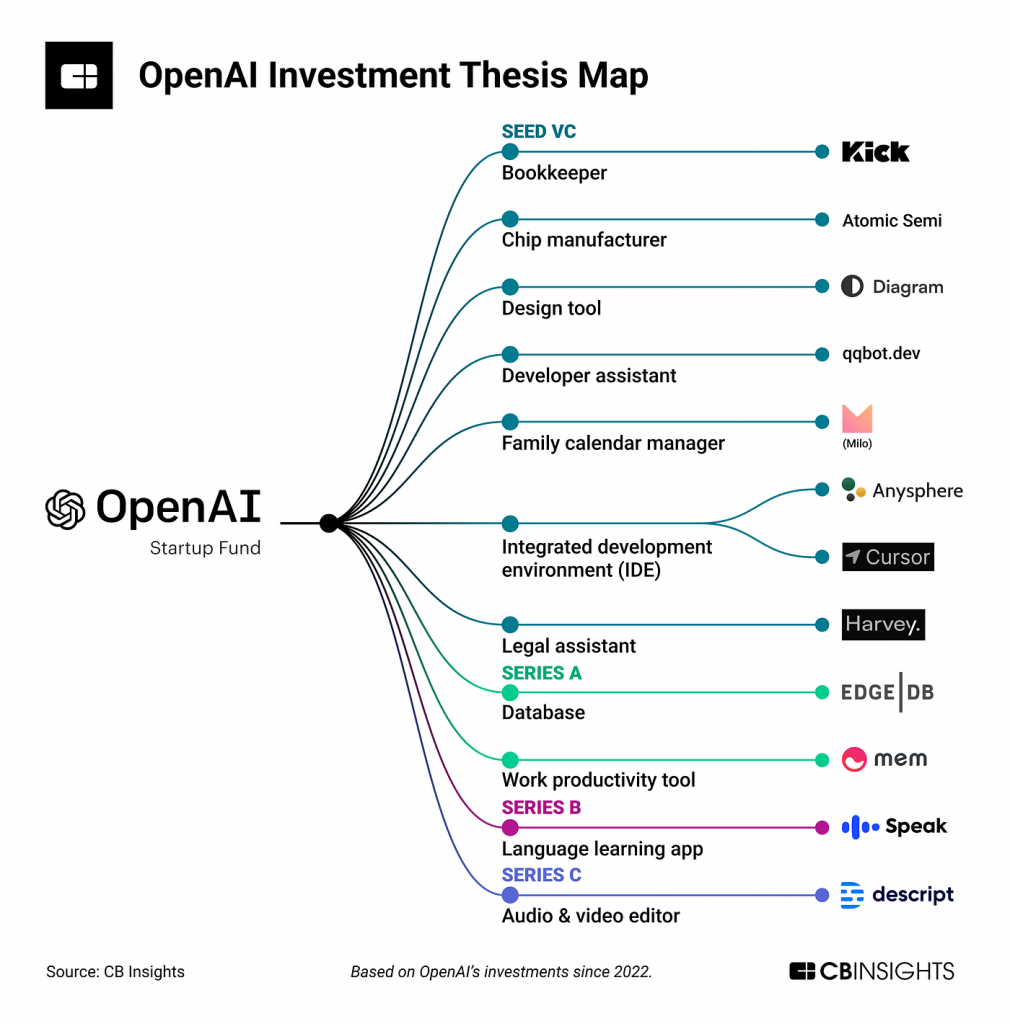

Grâce aux efforts d'Ilya, OpenAI a commencé à expérimenter Transformer. Ils ont été l’une des premières entreprises à le faire. Ils ont créé le modèle qui génère des transformateurs pré-entraînés sous l’acronyme désormais familier de GPT.

Surtout quand ils ont commencé à expérimenter les performances du Transformer lors du traitement du texte. Parce qu'ils peuvent essentiellement taper n'importe quel livre, article de journal, article Reddit, blog. Les humains passent beaucoup de temps à écrire, et ce texte a désormais un nouvel objectif : les données d’entraînement.

Internet n’a pas été créé pour former l’IA, mais en fin de compte, cela pourrait être son héritage. Les modèles d’OpenAI s’améliorent dans la génération de texte, et pas seulement dans un domaine de connaissances.

Ce qui est étonnant à propos des systèmes GPT, c’est qu’ils sont si vastes qu’ils sont en fait généralistes. Vous pouvez leur poser des questions sur presque n'importe quel sujet et ils vous donneront des réponses étonnamment bonnes. C'est parce qu'ils ont été formés pour mettre efficacement à la disposition des humains l'intégralité du corpus de textes, des milliards de phrases, tous les documents, mémos, anecdotes, fanfictions sur Harry Potter que vous avez jamais lu, tout cela étant introduit dans le moulin. Une fois que vous lisez ceci, cela devient très polyvalent. Ainsi, pour la première fois, nous disposons d'un système grâce auquel vous pouvez lui poser n'importe quelle question et qui vous donnera une réponse étonnamment intelligente, depuis l'IA d'un domaine restreint jusqu'à une IA générale ou large.

En introduisant de grandes quantités de texte dans le modèle, OpenAI a découvert qu’il pouvait créer une IA bien plus efficace pour générer des réponses convaincantes. En fait, à un moment donné, ils ont commencé à craindre que ce soit trop beau.

Lorsque le modèle de langage GPT-2 d'OpenAI est apparu pour la première fois, leur décision initiale a été de ne pas partager le modèle plus largement, car ils craignaient qu'il puisse être dangereux. Il s'agit de Peter, qui avait alors quitté OpenAI et créé sa propre entreprise, mais il se souvient de la scène du jour du lancement :

Apparemment, il comprend le langage bien mieux que tout ce sur quoi il a été formé auparavant. Sa sortie s'est accompagnée de beaucoup de marketing, peut-être de bon marketing, peut-être de prudence, ou les deux. Il a été qualifié de "trop dangereux pour être publié", donc je pense que c'est le premier projet où OpenAI a décidé de ne pas rendre publique une partie de son travail. Soudain, la chose à laquelle nous pensons devient : « Et si quelque chose était si puissant que les gens pourraient en abuser d'une manière que nous ne pouvons pas contrôler ?

Une fois qu’OpenAI aura un produit vraiment puissant, ils commenceront à repenser leur ouverture.

Pour le nom OpenAI, Open signifie en réalité que tout sera open source et que tout le monde pourra s'appuyer sur cela.

« L'ouverture » est un élément clé de la marque de l'entreprise. Lors de leur lancement, Sam a déclaré au journaliste Steven Levy : « Ce sera open source et tout le monde pourra l'utiliser. »

Il a également déclaré aux journalistes : « Leur IA appartiendra librement au monde entier. Les logiciels open source, d'une manière générale, signifient que le code source est public et que n'importe qui peut l'ajuster et le distribuer lui-même. Mais l'entreprise a rapidement commencé à se retirer progressivement. » ces engagements.

Évidemment, au fil du temps, cela est devenu quelque chose qui n'était plus entièrement open source, ni même open source du tout. Je veux dire, ils ne vont certainement pas ouvrir leur travail en open source maintenant.

Cet esprit open source semble peu à peu disparaître. Ce qui suit est un discours prononcé par Sam à Munich en 2023 :

Je suis curieux de savoir si nous maintenons la trajectoire de GPT-2, GPT-3, GPT-4, puis de GPT-5 et GPT-6, combien de personnes souhaitent que nous open source GPT-6 le jour où nous terminerons la formation. ?

Wow, d'accord, on ne va pas faire ça, mais c'est amusant.

Honnêtement, Sam semble ici plutôt arrogant. Il savait qu’OpenAI avait initialement promis d’être open source. Il interroge désormais son public sur ce qu'il pense du modèle open source, puis rejette immédiatement ses réponses.

Au fil des années, Sam a subtilement changé le sens du mot « ouvert », devenant plus ambigu. Voici ce qu’il a dit dans une société de capital-risque :

C’est ce que nous appelons OpenAI, et nous souhaitons que cette technologie soit ouverte à tous.

Il l’a dit si naturellement, comme si ce que signifiait l’ouverture était évident. Mais sa définition me semble si vague qu’elle est essentiellement dénuée de sens. Je veux dire que la recherche Google est ouverte à tout le monde. Il semble qu’OpenAI soit heureux de laisser les gens deviner ce qu’ils entendent par ouverture.

Quelques mois seulement après la création de l'entreprise, Ilya écrivait dans un e-mail interne :

À mesure que nous nous rapprochons de la construction de l’IA, il est logique de commencer à devenir moins ouvert. Le « Open » d'OpenAI signifie que tout le monde devrait bénéficier des résultats de l'IA, mais il n'est pas nécessaire de partager la science, même si à court et peut-être à moyen terme, tout partager est certainement la bonne stratégie pour recruter des talents.

Cet email est très intéressant car il montre que dès le début, OpenAI avait prévu de ne pas partager librement sa science. Ils ne veulent pas être open source comme ils le prétendent, mais ils veulent conserver une image publique ouverte car cela leur donne un avantage en matière de recrutement.

Par exemple, ne construisez pas d’IA pour les méchants, venez travailler pour nous. Lorsque nous lui avons posé des questions sur l'évolution de leur définition de l'ouverture, un porte-parole de l'entreprise a répondu : « Notre mission est restée la même, mais notre stratégie a dû changer. »

Bon, revenons à 2017. Deux ans après la création de l’entreprise, un nouveau problème est apparu chez OpenAI : une lutte de pouvoir.

Elon veut prendre la relève, c'est le genre de gars qui a l'habitude d'être aux commandes. Selon OpenAI, il souhaite déplacer l’entreprise sous Tesla et devenir PDG avec une participation majoritaire. Si cela ne lui convient pas, il démissionne.

Comme pour tout ce qui concerne Elon, il souhaite au fil du temps exercer davantage de contrôle et s'assurer que l'entreprise est gérée à l'image et de la manière qu'il souhaite. Donc ça crée des tensions.

Voici ma collègue Ashley Vance, qui a écrit une biographie sur Elon.

Le rôle préféré d'Elon dans quoi que ce soit est d'être le PDG et la force dominante dans le contrôle des opérations quotidiennes.

En fait, Greg Brockman et Ilya Sutskever, responsables des opérations quotidiennes, sont très vigilants. Bien qu'Elon soit imprudent, impulsif et difficile à vivre, il est également leur principale source de financement.

Il a promis près d'un milliard de dollars. OpenAI a d’autres donateurs, mais aucun n’atteint ce montant. Une option est de rester avec Elon et de conserver son capital.

Les employés ne sont pas entièrement convaincus par l’idée et ont certaines inquiétudes. Nous avons donc atteint ce point de décision : devons-nous rester avec Elon ou le quitter ? Ces dernières années, les gens ont presque toujours supporté Elon et ses exigences.

Ou une autre option consiste à se séparer d’Elon et à trouver d’autres sources de financement. Connaissez-vous quelqu’un qui pourrait être doué pour collecter des fonds ? Sam Altman.

L'accent était mis sur le fait qu'Elon voulait que l'entreprise aille dans un sens et que les employés voulaient aller dans un autre, c'est pourquoi Sam a été choisi pour faire avancer OpenAI.

Au cours des premières années, Sam n’était pas beaucoup impliqué dans OpenAI. Il est en fait toujours président de Y Combinator, mais dans cette lutte pour le pouvoir, Sam gagne contre Elon, et c'est un gros problème. Elon est plus connu, plus expérimenté, et surtout il déteste perdre.

Dans un conflit, la réaction d'Elon est de gagner à tout prix. Elon a rarement perdu une « bataille » ces dernières années. Généralement, s'il n'est pas à l'intérieur de l'entreprise, il poursuivra quelqu'un en justice pour le faire céder ; s'il est à l'intérieur, il fera pression sur la politique jusqu'à ce qu'il obtienne ce qu'il veut. Il est difficile de trouver un exemple ces dernières années où il n’a pas obtenu les résultats espérés. Il faut donc que les troubles au sein de l’entreprise soient très graves pour que cela n’arrive pas.

Ainsi, en 2018, Elon a pris le large et emporté son capital avec lui. Quelques années plus tard, il poursuivrait en justice Sam et OpenAI, affirmant qu'ils avaient renié leurs promesses initiales à but non lucratif et open source.

Peu de temps après le départ d'Elon, Sam est devenu PDG d'OpenAI. Il n'y avait pas eu de PDG ici auparavant, mais la lutte pour le pouvoir a défini la nouvelle domination de Sam dans l'entreprise. Vous vous souvenez de ce que le fondateur de YC a dit un jour ? "Sam est très doué pour être puissant."

L'intérêt de Sam pour OpenAI a continué de croître et son attention a commencé à se détourner de la gestion de YC. En effet, diriger un accélérateur de startups de renommée mondiale est un poste à fort impact.

Mais la course à l'AGI s'intensifie, et si OpenAI réussit à créer AGI avant tout le monde, il est difficile d'imaginer un poste avec plus de pouvoir que celui de son PDG. Cependant, Sam n'a pas immédiatement abandonné son emploi chez YC.

La situation rend mécontents certains gestionnaires d’accélérateurs. Ils estimaient que Sam était trop distrait, poussé trop vite et faisait passer ses propres intérêts avant ceux de YC. Cela lui a créé des ennemis au sein de sa propre équipe.

En fait, selon une source, le mentor de Sam, Paul Graham, l'homme qui l'a initialement nommé à ce poste, s'est envolé du Royaume-Uni pour demander personnellement à Sam de démissionner. Paul a perdu confiance en son ancien protégé, mais il ne voulait pas non plus créer de drame public. Alors Sam a été persuadé d’arrêter, ils ont fait profil bas et maintenant il se concentre uniquement sur OpenAI.

Sam a un grand objectif : collecter des fonds pour former les modèles OpenAI. Ils nécessitent beaucoup de puissance de calcul, et celle-ci coûte cher. Sam a essayé de collecter des fonds mais n'a fait aucun progrès. Voici ce qu'il a dit sur le podcast Lex Fridman :

Nous avons commencé comme une organisation à but non lucratif. Nous avons compris très tôt que nous avions besoin de beaucoup plus d’argent que ce que nous pouvions récolter en tant qu’organisation à but non lucratif pour faire ce que nous devions faire. Nous avons essayé et échoué à plusieurs reprises de collecter des fonds en tant qu'organisation à but non lucratif. Nous ne voyons pas de voie à suivre là-bas. Nous avons donc besoin de certains avantages du capitalisme, mais pas trop. Je me souviens que quelqu'un disait qu'en tant qu'organisation à but non lucratif, les choses n'iraient pas assez loin ; qu'en tant qu'organisation à but lucratif, les choses iraient trop loin.

Ils avaient besoin de quelque chose entre les deux et, pour être honnête, Sam ne se préoccupait pas trop de la vie après l'organisation à but non lucratif. Il a reconstitué quelque chose et a essentiellement créé une entité à but lucratif affiliée à l’organisation à but non lucratif d’origine.

Une entité à but lucratif peut tout faire comme une entreprise ordinaire, comme lever des investissements et fournir des capitaux propres aux employés, mais les rendements pour ses investisseurs sont limités, alors que dans d'autres entreprises, ils sont illimités.

Cette structure d'entreprise a été bricolée, OpenAI étant désormais essentiellement une entité à but lucratif contrôlée par un conseil d'administration à but non lucratif, ce qui semble un peu fragile. OpenAI a passé plusieurs années à prétendre qu'elle serait une organisation à but non lucratif, et ils ont maintenant trouvé cette solution à but lucratif.

Après ce changement, beaucoup de gens étaient mécontents. Mais OpenAI se concentre davantage sur son objectif final, ils veulent construire AGI et doivent lever des fonds pour atteindre cet objectif.

Puis, en 2019, Sam le trader a fait une grosse affaire : il a levé 1 milliard de dollars auprès de Microsoft. Voici ce que Satya Nadella, PDG de Microsoft, a déclaré après la signature de l'accord :

Bonjour, je suis ici avec Sam Altman, PDG d'OpenAI. Aujourd'hui, nous sommes très heureux d'annoncer notre partenariat stratégique avec OpenAI.

Il est important de noter que Microsoft dispose d’une grande puissance de calcul brute qu’OpenAI peut désormais utiliser. N’oubliez pas qu’OpenAI a été conçu à l’origine comme « l’antidote » de Google. Ils se sont présentés comme fondamentalement différents des géants technologiques avides de profits, et du jour au lendemain, ils sont devenus intimement associés à des entreprises technologiques valant plus de mille milliards de dollars.

OpenAI est désormais, à bien des égards, un fork de Microsoft, ce qui constitue un changement important. Reid Hoffman, qui siégeait à l'époque aux conseils d'administration d'OpenAI et de Microsoft, ne considérait pas cela comme un abandon de la promesse initiale d'OpenAI.

Certains craignaient que cela ne nuise à la mission. Mais je pense que c'est une naïveté moderne de penser que les entreprises sont mauvaises ou corrompues, car il existe de nombreuses façons par lesquelles les entreprises interagissent avec les humains et la société. Ils essaient de servir les clients, d’employer des employés, d’avoir des actionnaires et d’exister dans la société.

Le point de vue de Reid est que vouloir gagner de l’argent ne signifie pas que vous êtes mauvais, ce qui est typique d’un capital-risqueur milliardaire.

J'ai le sentiment que l'accord avec Microsoft pourrait être le moyen le plus pratique pour OpenAI de poursuivre sa mission de création d'AGI sécurisée pour toute l'humanité. Mais cela met également en évidence une caractéristique importante selon laquelle OpenAI a tendance à revenir sur ses promesses lorsque cela lui convient.

En dessous de cela, les gens ont commencé à remettre en question l’intégrité de Sam, tant à l’intérieur qu’à l’extérieur de l’entreprise.

Cela provoquera une grosse fissure.

Rendez-vous dans le prochain épisode de "Foundering" !

# Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (ID WeChat : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo