Google va commencer à étiqueter les images générées par l’IA dans la recherche

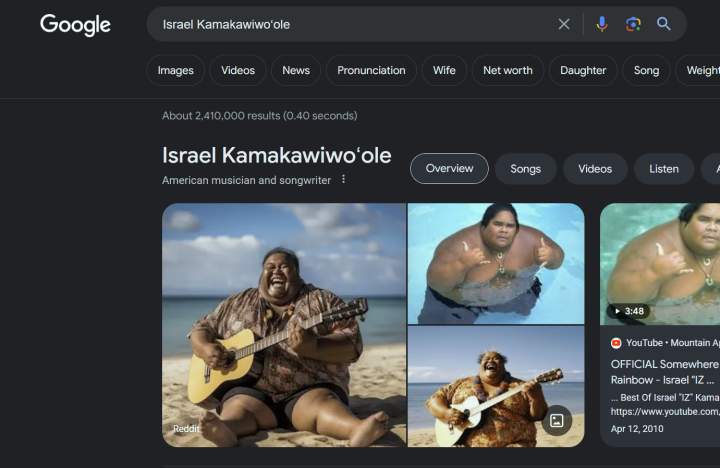

Les images générées par l'IA sont devenues de plus en plus prédominantes dans les résultats de recherche Google ces derniers mois , évinçant les résultats légitimes et rendant plus difficile pour les utilisateurs de trouver ce qu'ils recherchent réellement. En réponse, Google a annoncé mardi qu'il commencerait à étiqueter les résultats de recherche d'images générées et éditées par l'IA dans les mois à venir.

La société signalera ce contenu via la fenêtre « À propos de cette image » et il sera appliqué aux fonctionnalités de recherche, Google Lens et Circle to Search d'Android. Google applique également la technologie à ses services publicitaires et envisage d'ajouter un indicateur similaire aux vidéos YouTube, mais « aura plus de mises à jour à ce sujet plus tard dans l'année », selon le message d'annonce.

Google s'appuiera sur les métadonnées de la Coalition for Content Provenance and Authenticity (C2PA) pour identifier les images générées par l'IA. Il s'agit d'un groupe industriel que Google a rejoint en tant que membre du comité directeur plus tôt dans l'année. Ces « métadonnées C2PA » seront utilisées pour suivre la provenance de l'image, identifier quand et où une image a été créée, ainsi que l'équipement et les logiciels utilisés pour sa génération.

Jusqu’à présent, un certain nombre de poids lourds de l’industrie ont rejoint le C2PA, notamment Amazon, Microsoft, OpenAI et Adobe. Cependant, la norme elle-même a reçu peu d'attention de la part des fabricants de matériel et ne se trouve actuellement que sur une poignée de modèles d'appareils photo Sony et Leica. Quelques développeurs d'outils de génération d'IA de premier plan ont également refusé d'adopter la norme, comme Black Forrest Labs, qui crée le modèle Flux que Grok exploite pour sa génération d'images.

Le nombre d’escroqueries en ligne utilisant des deepfakes générés par l’IA a explosé au cours des deux dernières années. En février, par exemple, un financier basé à Hong Kong a été trompé et a transféré 25 millions de dollars à des fraudeurs qui se faisaient passer pour le directeur financier de l'entreprise lors d'une vidéoconférence. En mai, une étude du fournisseur de vérification Sumsub a révélé que les escroqueries utilisant des deepfakes ont augmenté de 245 % à l'échelle mondiale entre 2023 et 2024, avec une augmentation de 303 % aux États-Unis en particulier.

"L'accessibilité publique de ces services a abaissé la barrière à l'entrée pour les cybercriminels", a déclaré David Fairman, directeur de l'information et directeur de la sécurité de l'APAC chez Netskope, à CNBC en mai. «Ils n’ont plus besoin de compétences technologiques particulières.»