Tout à l’heure, le modèle d’inférence o3 le plus puissant d’OpenAI a été publié ! Pour la première fois, je peux penser avec des images, Ultraman : Genius Level Avec les détails de mesure réels

"o3 atteint ou s'approche du niveau de génie."

Tout à l'heure, le mini modèle OpenAI o3/o4 a enfin été officiellement lancé. La diffusion en direct a duré près de 30 minutes, avec un rythme rapide et de nombreuses informations.

Le processus de libération d'o3 lui-même est également très inversé. En février de cette année, OpenAI a annoncé qu'il mettrait de côté le plan de publication indépendant d'o3 et que la technologie serait emballée et intégrée dans GPT-5. Début avril, Altman, qui connaît bien le « marketing de la faim », a annoncé que son plan avait changé :

o3 doit d'abord être publié, mais GPT-5 devra attendre, peut-être quelques mois au plus tôt.

Pour mettre en évidence les points clés, les points forts d'OpenAI o3/o4 mini sont les suivants :

- o Modèle le plus intelligent de la série à ce jour, sa capacité de raisonnement a été grandement améliorée. Plus la réflexion est longue, meilleur est l’effet.

- Pour la première fois, les images sont directement intégrées dans la chaîne de pensée, « penser » avec des images, et des outils peuvent être directement appelés pour traiter les images.

- Pour la première fois, il prend entièrement en charge la recherche sur le Web, l'analyse de fichiers, l'exécution de code Python, le raisonnement approfondi par entrée visuelle et la génération d'images.

- Économiquement supérieur à la génération précédente, o3 offre des performances plus élevées pour une latence et un coût identiques.

Remplaçant les modèles tels que o1 sur le sélecteur de modèle, o3, o4-mini et o4-mini-high seront disponibles pour les utilisateurs de ChatGPT Plus, Pro et Team à partir d'aujourd'hui, les utilisateurs d'entreprise et d'éducation y ayant accès dans une semaine. o3-pro devrait sortir dans quelques semaines.

Les utilisateurs gratuits peuvent utiliser o4-mini en mode « Réfléchir » et la limite de débit reste inchangée.

Les développeurs y accèdent via l'API Chat Completions et l'API Responses, qui prennent en charge le résumé des inférences et l'optimisation des appels de fonction. Il prendra bientôt en charge des outils intégrés tels que la recherche sur le Web.

Le modèle d'inférence o3 le plus puissant d'OpenAI est publié, GPT-5 peut-il être loin derrière ?

Les nouveaux o3 et o4-mini sont les modèles les plus intelligents de la série o à ce jour.

Ces deux modèles fonctionnent bien en termes de capacités de raisonnement, d'utilisation des outils et de traitement multimodal, ce qui leur permet de réfléchir à des problèmes complexes sur des périodes plus longues. Pour la première fois, ils prennent entièrement en charge la recherche sur le Web, l’analyse de fichiers, l’exécution de code Python, le raisonnement approfondi avec entrées visuelles et la génération d’images.

Des chercheurs chevronnés aux utilisateurs ordinaires, le nouveau modèle est applicable à un plus large éventail de scénarios.

OpenAI o3 et o4-mini peuvent appeler des outils dans ChatGPT et accéder à des outils personnalisés via des appels de fonction dans l'API.

OpenAI lance o3 et o4-mini et déclare qu'o3 peut « générer de nouvelles hypothèses » | Beebom

Grâce à l'apprentissage par renforcement, OpenAI a également formé les deux modèles à l'utilisation de l'outil, non seulement en sachant comment et quand l'utiliser, mais également en étant capables de générer rapidement des réponses fiables dans le bon format, souvent en moins d'une minute.

Par exemple, lorsqu'on me demande comment la consommation d'énergie en Californie au cours de l'été se compare à celle de l'année dernière, je peux vérifier les données publiques de consommation d'énergie en ligne, écrire du code Python pour prédire, générer des graphiques ou des images, expliquer la base de la prévision et connecter couramment plusieurs outils.

L'ensemble du processus de recherche d'inférence est également plus flexible : le modèle peut appeler le moteur de recherche plusieurs fois pour valider les résultats ; si ses propres connaissances sont insuffisantes, il peut exploiter davantage les informations et intégrer des résultats de type croisé.

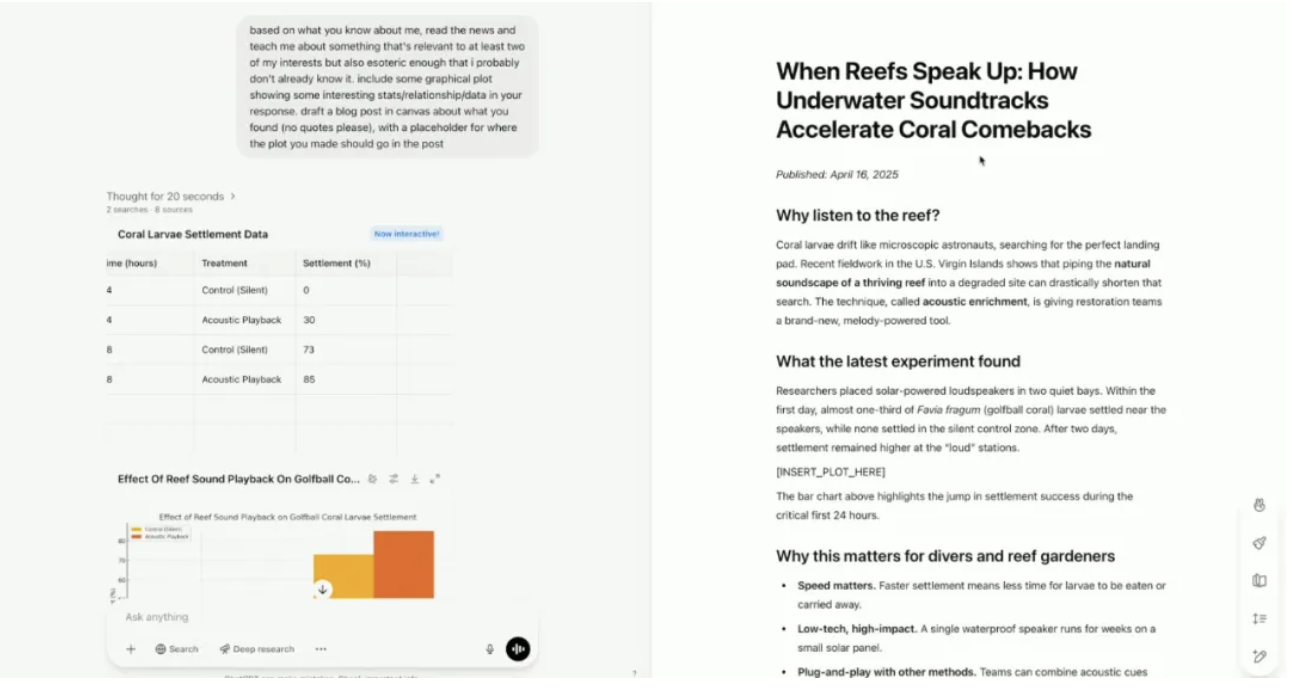

Lors de la diffusion en direct tôt ce matin, le président d'OpenAI, Greg Brockman, a également fait une rare apparition. Les présentateurs d’OpenAI ont montré comment de nouveaux modèles peuvent combiner les intérêts des utilisateurs pour découvrir du contenu qui pourrait les intéresser mais qu’ils ne connaissent pas encore.

Avec la fonction "mémoire" activée, le nouveau modèle peut connaître les intérêts et les passe-temps du démonstrateur – le parachutisme et la musique.

Plutôt que de simplement discuter des deux passe-temps séparément, le nouveau modèle a trouvé un domaine de recherche qui relie les deux : les scientifiques enregistrent les sons des récifs coralliens sains, puis rejouent ces enregistrements à l'aide de haut-parleurs sous-marins. Cette lecture sonore accélère la colonisation de nouveaux coraux et poissons, aidant ainsi les récifs à guérir et à se régénérer plus rapidement.

Au cours du processus de création de contenu, le modèle a également créé automatiquement un article de blog complet, en utilisant d'abord des outils d'analyse de données pour générer des visualisations, puis en utilisant Canvas pour créer l'article de blog, avec les citations et les sources jointes.

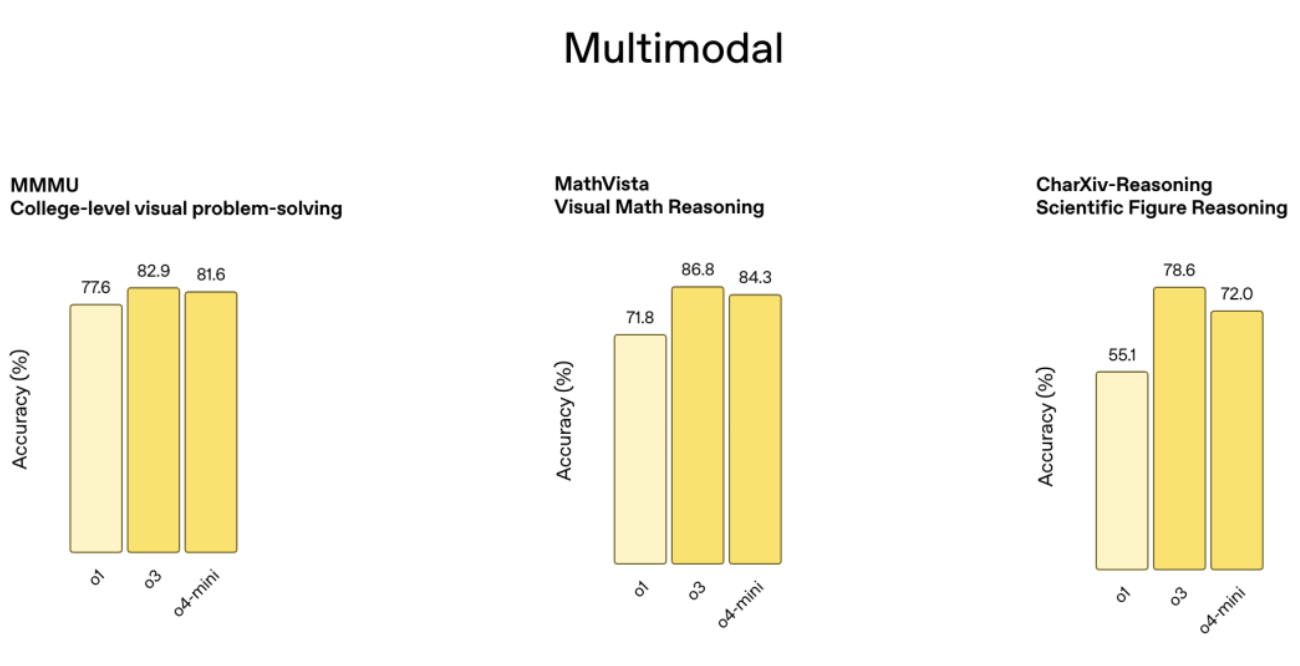

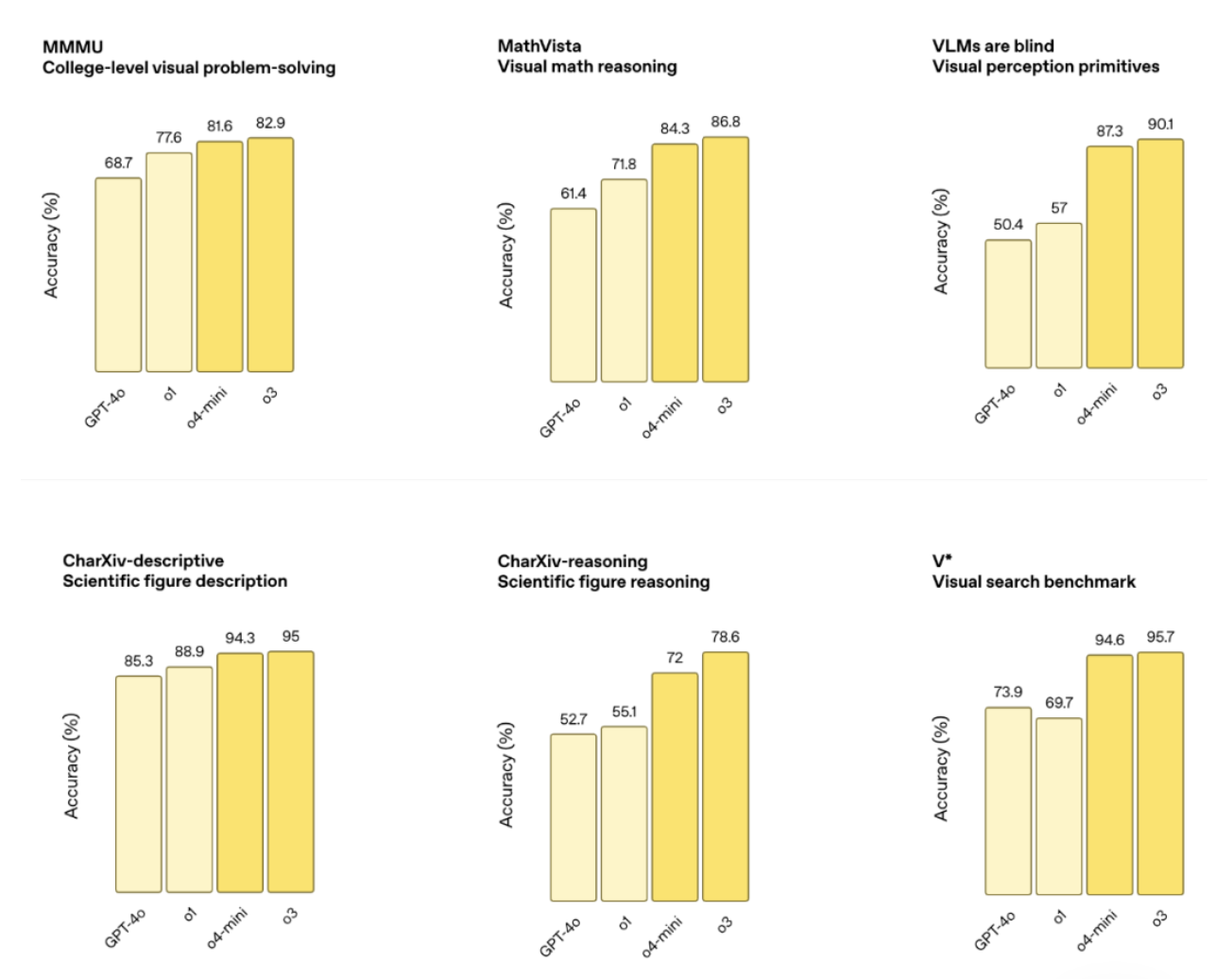

En tant que dernier modèle d'inférence phare, o3 a établi de nouveaux records dans les domaines de la programmation, des mathématiques, des sciences et de la perception visuelle, tels que les benchmarks Codeforces, SWE-bench et MMMU, avec une précision des tâches visuelles de 87,5 % et MathVista de 75,4 %.

Une évaluation par des experts externes montre que o3 a également un taux d'erreur critique 20 % inférieur à celui de o1 en matière de programmation, de conseil aux entreprises et d'idéation créative. Il peut générer et évaluer de manière critique de nouvelles hypothèses dans les domaines de la biologie, des mathématiques et de l’ingénierie, et convient aux requêtes complexes.

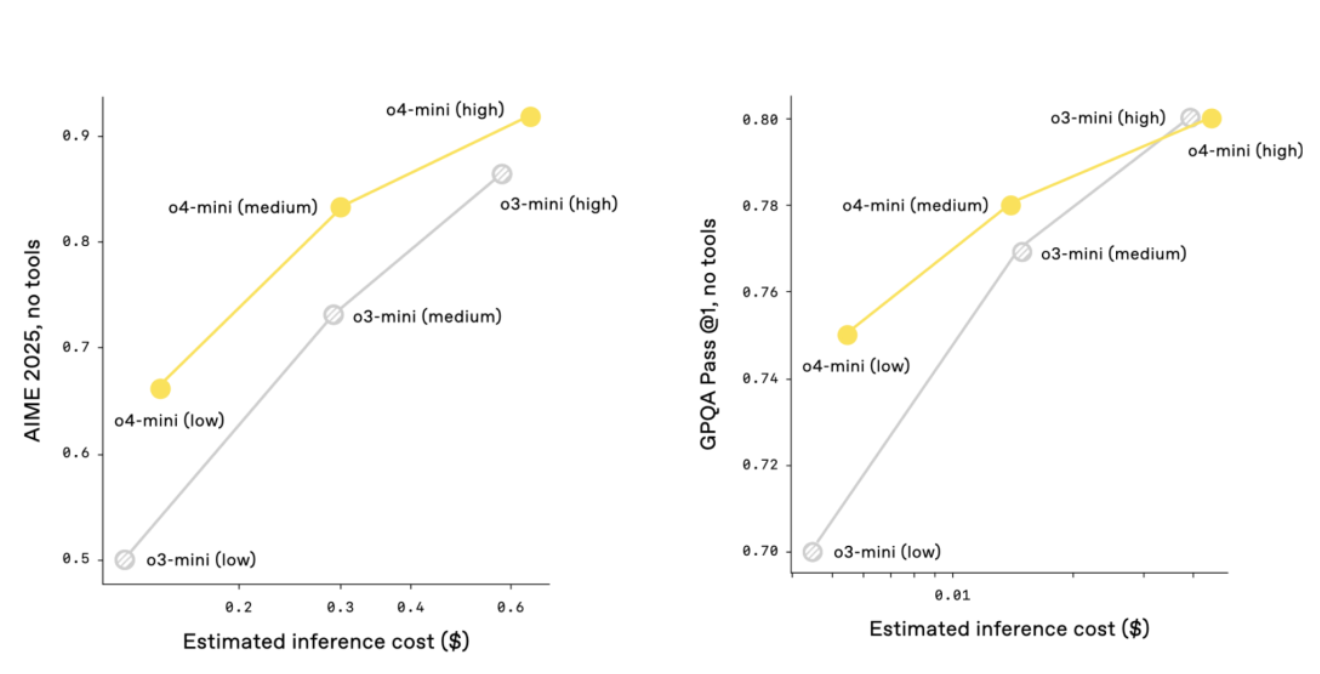

o4-mini est « plus petit » et optimisé pour un raisonnement rapide et peu coûteux. La précision des tests de mathématiques AIME 2024 et 2025 est respectivement de 92,7 % et 93,4 %. C'est mieux que o3-mini dans les tâches non STEM et de science des données. Il est très efficace, peut traiter davantage de demandes et convient mieux aux scénarios nécessitant une réponse rapide.

La comparaison des performances montre que o3 et o4-mini surpassent largement la génération précédente dans des tests tels que AIME, Codeforces, GPQA et MMMU, et que le suivi des commandes et la qualité des réponses sont également considérablement améliorés. Combinées à la fonction mémoire et aux références de dialogue historiques, les réponses sont plus personnalisées et pertinentes.

Tout au long du processus de développement d'OpenAI o3, OpenAI a observé que l'apprentissage par renforcement à grande échelle montrait la même tendance selon laquelle « plus la quantité de calcul est importante, meilleures sont les performances » que dans la pré-formation de la série GPT.

Tout au long de cette voie (apprentissage par renforcement), OpenAI a augmenté d'un ordre de grandeur en termes de calculs de formation et de temps d'inférence, mais a tout de même constaté des améliorations significatives des performances. Avec le même délai et le même coût que o1, o3 fonctionne mieux et lui donne plus de temps pour réfléchir, et l'effet peut être meilleur.

OpenAI, qui n'oublie pas de dessiner, a également déclaré que o3 et o4-mini ont démontré la tendance à l'intégration des capacités de raisonnement de la série o et du dialogue naturel et de l'utilisation des outils de la série GPT, et que le futur modèle (GPT-5) devrait intégrer davantage ces avantages pour offrir aux utilisateurs une expérience plus intelligente et pratique.

Je peux « penser » en utilisant des images, mais il m'arrive de « penser trop »

OpenAI o3 et o4-mini sont également les derniers modèles de raisonnement visuel de la série o.

Comment comprendre le modèle de raisonnement visuel ? Selon l'introduction officielle, le modèle intègre pour la première fois directement des images dans la chaîne de pensée, ouvrant ainsi la voie à une nouvelle méthode de résolution de problèmes intégrant le raisonnement visuel et textuel.

Avec des outils tels que l'analyse de données Python, la recherche sur le Web et la génération d'images, il peut également gérer des tâches plus complexes.

Téléchargez des photos sur tableau blanc, des graphiques de manuels scolaires ou des croquis dessinés à la main. Même si l'image est floue, inversée ou de mauvaise qualité, le modèle peut l'interpréter avec précision et appeler directement des outils pour traiter l'image, notamment le recadrage, la rotation, la mise à l'échelle et d'autres opérations.

L’important est que ces fonctions soient natives et ne nécessitent pas de modèle dédié séparé.

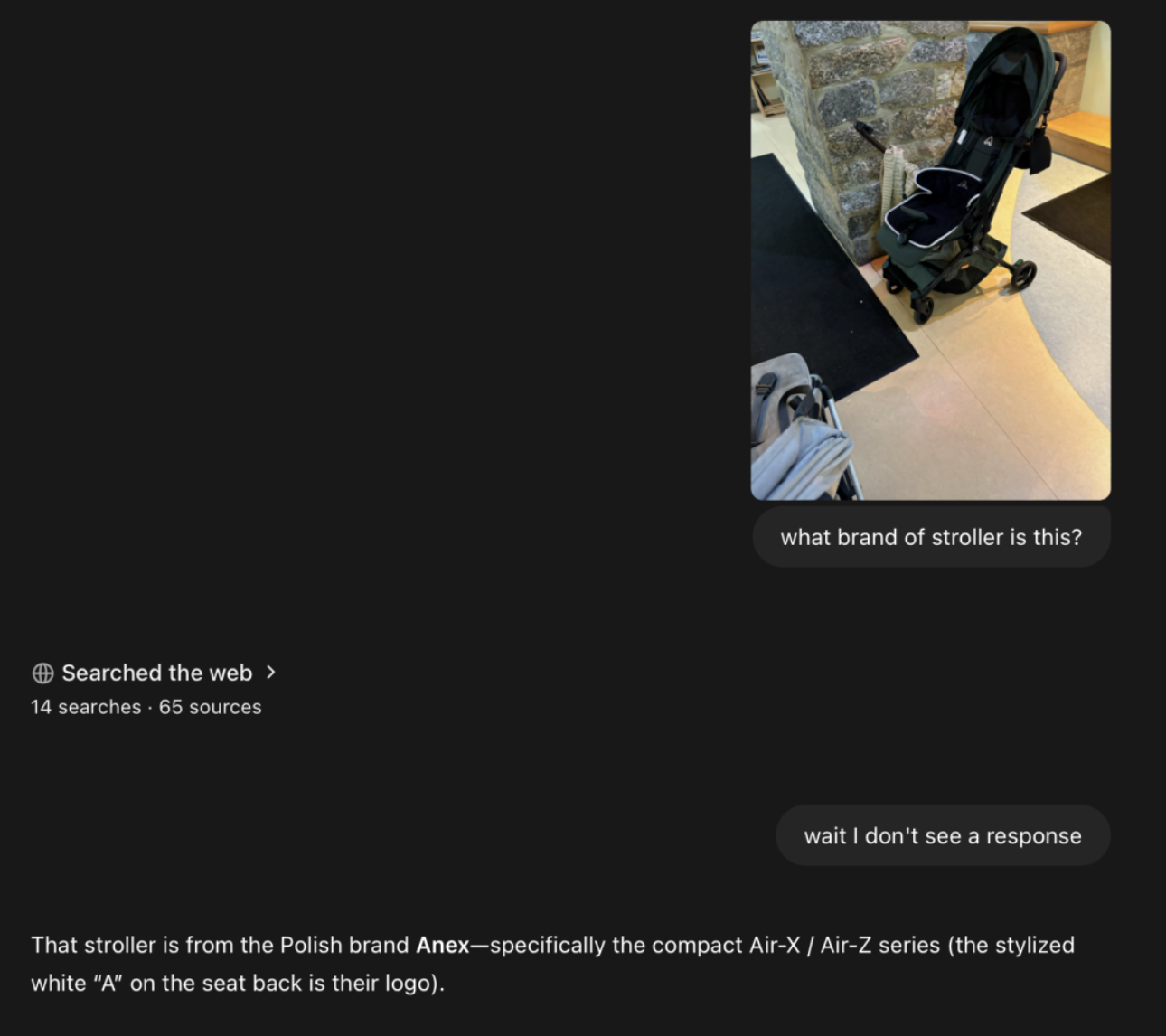

Le blogueur @danshipper a trouvé une marque de poussette grâce à une photo floue et, à en juger par son apparence, des dizaines de pages Web ont été consultées tout au long du processus.

J'ai également téléchargé une photo du bâtiment Wukang et o3 a identifié avec précision que le bâtiment est situé près de Huaihai Road. Cependant, la réponse ne donnait pas le nom du bâtiment.

Bien entendu, cette façon de penser n’est pas sans « défauts » :

- Trop réfléchir : le modèle peut trop s'appuyer sur des outils ou sur le traitement d'images, ce qui entraîne de longues chaînes de raisonnement.

- Perceptions erronées : même si les outils sont utilisés correctement, des malentendus visuels peuvent conduire à de mauvaises réponses.

- Instable : si vous essayez le même problème plusieurs fois, le modèle peut utiliser des chemins de raisonnement différents et certains résultats peuvent être erronés.

Codex CLI est gratuit et open source, OpenAI est-il vraiment ouvert ?

o3 et o4-mini sont supérieurs à la génération précédente en termes de rentabilité. Lors du test AIME 2025, le rapport qualité/prix a complètement battu o1 et o3-mini. Ils sont plus intelligents et plus rentables.

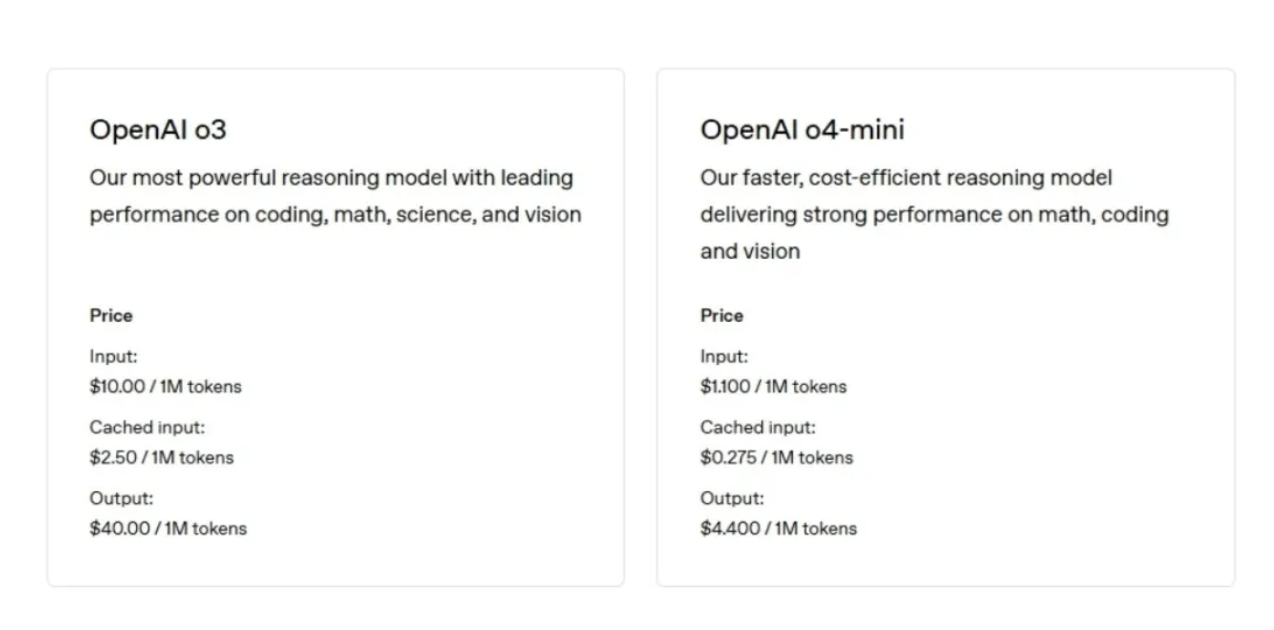

o3 coûte 10 $ par million de jetons pour l'entrée (environ 750 000 mots, plus long que la série Le Seigneur des Anneaux) et 40 $ par million de jetons pour la sortie.

o4-mini coûte 1,10 $ par million de jetons pour l'entrée et 4,40 $ par million de jetons pour la sortie.

Il n’y a pas si longtemps, il a été révélé que la durée des tests de sécurité d’OpenAI avait été réduite de quelques mois à quelques jours. Les cartes système d'o3 et d'o4-mini montrent qu'OpenAI a reconstruit l'ensemble des données de formation à la sécurité et ajouté des invites de rejet pour les menaces biologiques, la génération de logiciels malveillants et les attaques de jailbreak.

Selon le dernier cadre de préparation, les risques pour o3 et o4-mini sont inférieurs au seuil « élevé » dans les domaines de la biologie et de la chimie, de la cybersécurité et de l'auto-amélioration de l'IA.

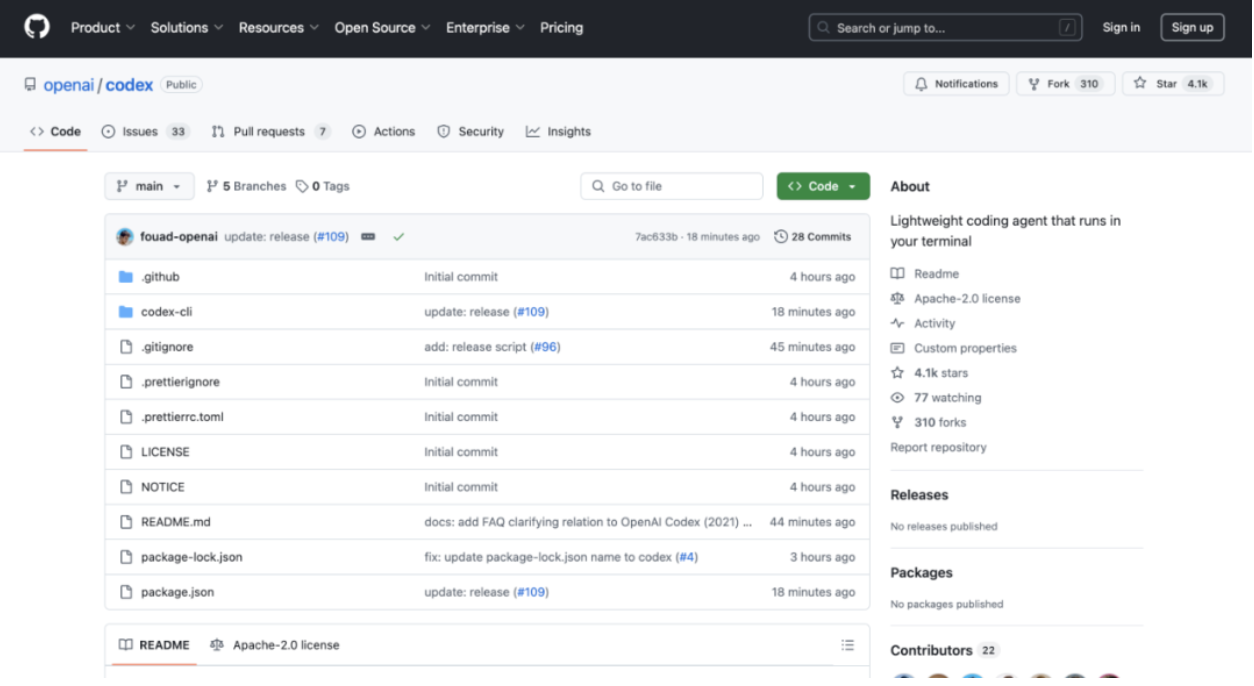

▲ L'image est jointe avec l'adresse GitHub de la CLI Codex : https://github.com/openai/codex

Bien que l'agent soit en retard, il est arrivé. OpenAI a également lancé un agent de codage de terminal léger – Codex CLI.

Basé sur les capacités de raisonnement d'o3 et o4-mini, Codex CLI prend en charge l'entrée multimodale et a été open source sur GitHub. En outre, OpenAI a également lancé un plan d'un million de dollars pour soutenir des projets connexes et accepte les demandes de financement pour des points API de 25 000 dollars.

OpenAI est vraiment ouvert cette fois.

Selon les rapports, Codex dispose de deux modes de fonctionnement, l'un est le « mode recommandation » (par défaut) : des commandes sont proposées pour confirmation à l'utilisateur, et l'autre est le « mode entièrement automatique » : l'accès au réseau est désactivé, permettant à l'agent de travailler de manière autonome tout en restant en sécurité.

Au cours de la démonstration en direct, les chercheurs d'OpenAI ont glissé des captures d'écran dans le terminal et la CLI du Codex a analysé les images via un raisonnement multimodal, accédé aux fichiers utilisateur et finalement généré des fichiers HTML, créé un générateur d'art ASCII et ajouté avec succès une API de webcam.

Il convient de mentionner que, selon Bloomberg, OpenAI envisage d'acquérir la société d'outils de programmation d'IA Windsurf pour environ 3 milliards de dollars. Si l’acquisition réussit, elle deviendra la plus grande acquisition d’OpenAI à ce jour.

Le rapport souligne qu'une fois l'accord conclu, OpenAI sera en mesure de concurrencer plus directement des sociétés telles qu'Anthropic, Github et Anysphere, propriété de Microsoft, occupant ainsi une place sur le marché en croissance rapide des outils de programmation d'IA.

Le "niveau Genius" o3 a conduit Altman à transmettre et à soutenir, mais ces questions n'ont pas reçu de réponse correcte…

Certains blogueurs de la plateforme X ont été qualifiés pour expérimenter le nouveau modèle à l'avance et ont partagé leur expérience.

@danshipper, qui en fait l'expérience depuis une semaine, a déclaré que o3 est rapide, très "exploitable", extrêmement intelligent et que le sentiment général est génial. Les utilisations préférées incluent :

- Développement d'un cours concis d'apprentissage automatique et rappel aux blogueurs d'étudier chaque matin

- J'ai trouvé une marque de poussette grâce à une photo floue

- A écrit un nouveau programme de référence en IA à une vitesse ultra rapide

- J'ai analysé un morceau classique du travail d'Annie Dillard comme une radiographie, révélant des compétences d'écriture que les blogueurs n'avaient jamais remarquées auparavant.

- Consultez les procès-verbaux des réunions pour attraper les blogueurs qui tentent d'éviter les conflits

- Après avoir analysé la structure organisationnelle, quels types de produits est-il recommandé de lancer et où sont les lacunes ?

@DeryaTR_, MD, pense qu'o3 est intelligent : « Lorsque je pose à o3 une question clinique ou médicale difficile, ses réponses semblent venir d'un médecin de haut niveau : précises, complètes, fondées sur des preuves et confiantes, avec le plus grand professionnalisme que nous attendons des experts dans ce domaine.

Altman a également transmis une citation de lui disant que "o3 est au niveau du génie ou presque".

De l'avis de @DeryaTR_, o4 mini est un peu plus "discret", et les détails des réponses ne sont pas aussi détaillés que o3. Il peut être plus concis et fluide, donnant aux gens un sentiment d'élégance, et peut même être plus « émotionnel ».

Bien entendu, nous avons également testé certains problèmes.

Il était une fois un vieil horloger qui installait une grosse cloche pour une église. Il était vieux et ébloui, et il assemblait mal les aiguilles longues et courtes. L’aiguille courte s’est déplacée 12 fois plus vite que l’aiguille longue. Il était 6 heures du matin pendant l'assemblée. Il a pointé l'aiguille courte sur "6" et l'aiguille longue sur "12". Le vieil horloger l'a installé et est rentré chez lui. Les gens ont regardé l'horloge pendant un moment et il était 7 heures, puis 8 heures. Ils furent très surpris et allèrent immédiatement voir le vieil horloger. Lorsque le vieil horloger arriva, il était déjà plus de 19 heures. Il sortit une paire de montres de poche et les horloges étaient exactes. Il soupçonnait que les gens lui jouaient des tours et revenait quand il était en colère. L'horloge tourne toujours à 8 heures et à 9 heures et les gens retournent chez l'horloger. Le vieil horloger est venu le lendemain matin à 8 heures pour utiliser une paire de montres, qui étaient encore précises. Pensez-y, à quelle heure était 7 heures lorsque le vieil horloger a réglé sa montre pour la première fois ? Quelle heure est-il encore 8h00 lorsque je vérifie la montre pour la deuxième fois ?

▲o3 Mauvaise réponse

La chorale U2 doit arriver à la salle de concert en 17 minutes et doit traverser un pont en chemin. Quatre personnes partent du même bout du pont et vous devez les aider à atteindre l'autre bout. Il fait sombre et ils n'ont qu'une lampe de poche. Au maximum deux personnes peuvent traverser le pont en même temps, et elles doivent tenir une lampe de poche lorsqu'elles traversent le pont, donc quelqu'un doit apporter une lampe de poche vers et depuis les deux extrémités du pont. Les lampes de poche ne peuvent pas être distribuées en les jetant. Quatre personnes marchent à des vitesses différentes. Si deux personnes marchent ensemble, la plus lente prévaudra. Bono met 1 minute pour traverser le pont, Edge met 2 minutes pour traverser le pont, Adam met 5 minutes pour traverser le pont et Larry met 10 minutes pour traverser le pont. Comment vont-ils traverser le pont en 17 minutes ?

▲o4 mini a répondu correctement

Dans la mesure réelle suivante, bien que o3 ait donné des étapes de raisonnement complètes, la réponse était encore une fois fausse.

▲o3 Mauvaise réponse

A l'occasion du lancement d'OpenAI, les internautes attentifs ont également découvert que le nouveau Gemini sortira la semaine prochaine (22 avril).

DeepSeek R2, Claude 4 d'Anthropic et "GroK-3.5" de Musk devraient également sortir ce mois-ci.

Même en regardant vers l'avenir, avril est le mois le plus « impliqué » pour l'IA, qui déterminera en grande partie l'orientation du développement de l'industrie de l'IA au cours de l'année prochaine. Des modèles plus solides, des coûts réduits et des scénarios plus larges nous apporteront également un avenir plus intelligent et plus inclusif.

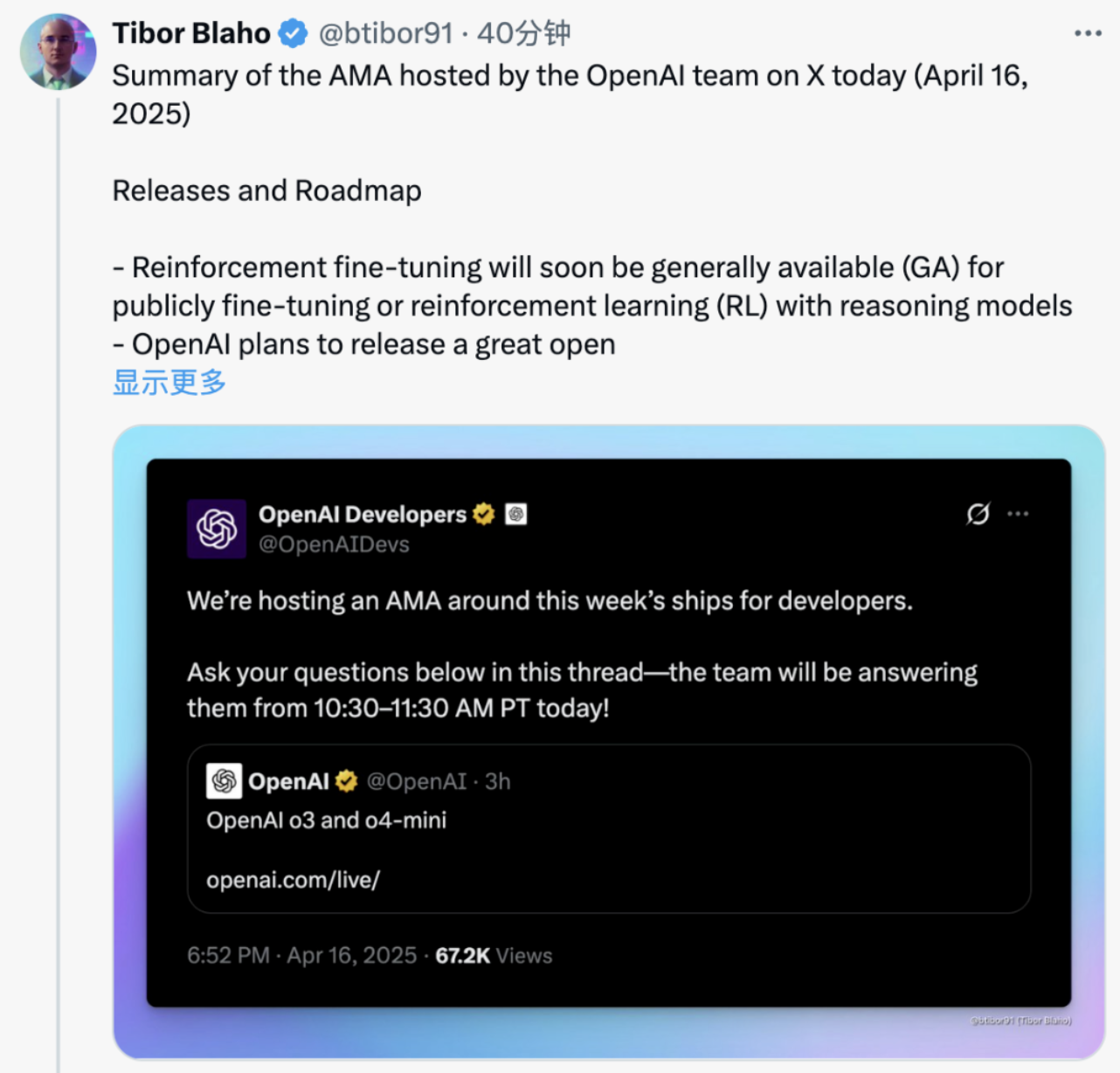

Ci-joint le résumé de l'AMA organisée par l'équipe OpenAI sur la plateforme X :

- OpenAI prévoit de publier un excellent modèle ouvert dans les mois à venir, et de nouvelles capacités de génération d'images seront bientôt disponibles dans l'API.

- o3 est désormais disponible dans l'API, tandis qu'un modèle o3-pro plus avancé est en cours de développement et devrait être publié prochainement.

- Le réglage fin du renforcement sera bientôt généralement disponible, permettant un réglage fin public ou l'utilisation de modèles d'inférence pour l'apprentissage par renforcement (RL).

- Dans l'API Responses, le basculement entre les messages du développeur et les messages système est géré automatiquement ; l'envoi de messages système à o3 ou de messages de développeur à GPT-4.1 est automatiquement converti.

- Actuellement, les outils d'hébergement ne sont pas pris en charge par l'API ChatCompletions ou Responses.

- Pendant la phase d'inférence de o3 et o4-mini, des outils tels que la recherche sur le Web, la recherche de fichiers et les interpréteurs de code sont activement utilisés ; ces outils sont actuellement pris en charge dans ChatGPT, mais pas encore dans l'API – la prise en charge devrait être ajoutée prochainement.

- OpenAI développe activement la prise en charge des threads dans le SDK Agents pour améliorer l'historique et la mémoire des conversations.

- OpenAI pense que les propositions de plate-forme low-code dans le SDK Agents sont intéressantes et accueille favorablement les commentaires des développeurs sur les fonctionnalités les plus utiles.

- La CLI Codex comprend plusieurs modes d'approbation documentés, permettant à l'utilisateur de sélectionner un mode pour chaque opération ou session.

- Codex CLI n'est pas destiné à remplacer les outils IDE tels que Cursor et Windsurf ; il est conçu pour exécuter des tâches en arrière-plan pendant que l'utilisateur utilise l'EDI principal.

- Comparez les capacités de codage et les capacités de recherche approfondies du Codex selon le modèle choisi (o3 ou o4-mini); Codex utilise spécifiquement des appels de fonction pour exécuter des commandes directement sur l'ordinateur de l'utilisateur.

- Le nouveau modèle est principalement formé sur les navigateurs à usage général, les outils d'exécution de code Python et les outils définis par l'utilisateur utiles aux développeurs.

- Bien que GPT-4.5 soit plus puissant, il est plus lent et nécessite beaucoup de calculs, GPT-4.1 offre aux développeurs une option plus rapide et plus rentable.

- Certaines améliorations de GPT-4.1 ont été intégrées à ChatGPT, et d'autres améliorations seront déployées à l'avenir.

- OpenAI reconnaît qu'il existe une confusion entre les noms de modèles tels que « 4o » et « o4 » et prévoit de simplifier bientôt la dénomination des modèles.

# Bienvenue pour suivre le compte public officiel WeChat d'aifaner : aifaner (WeChat ID : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo