Un accessoire qui permet aux iPhones d’utiliser l’IA est regardé par 13 millions de personnes, mais je ne pense pas que ce soit nécessaire

Si vous deviez faire une liste des produits technologiques les plus déroutants aujourd’hui, les influenceurs du matériel d’IA y figureraient certainement.

Du Humane Ai Pin à 699 $ au Rabbit R1 à 200 $, ces startups d'IA vendent toutes le même beau mensonge : vous avez besoin de matériel spécialisé pour découvrir la véritable IA.

Aujourd'hui, il y a un nouveau membre sur cette liste – AI Key.

Il s'agit d'un périphérique externe présenté comme un « assistant IA ». Le fabricant affirme qu'il peut être branché et débranché à tout moment. Une fois connecté via le port USB de l'iPhone, il permet d'utiliser les applications et fonctionnalités du téléphone simplement avec la bouche, qu'il s'agisse de messages, de cartes, de photos ou de réseaux sociaux, couvrant ainsi la plupart des tâches courantes.

Similaire à l’agent mobile, son utilisation n’est pas compliquée.

Il suffit d'exprimer vos besoins, de confirmer l'application appelée, et l'appareil simulera automatiquement les clics, les glissements et les saisies. Les utilisateurs peuvent soit regarder l'exécution, soit la laisser s'en occuper complètement, puis l'arrêter ou la modifier à tout moment.

Il est important de noter que si Apple propose des outils d'automatisation au niveau système comme Raccourcis, les applications tierces ne peuvent pas appeler ni contrôler en profondeur le comportement d'autres applications. Cela explique également l'apparition sur le marché de matériel externe tentant de combler cette lacune.

Ce modèle compact est disponible en trois coloris : Noir Nuit, Blanc Crème et Rose Dave. Son prix est de 89 $, et le fabricant promet une livraison mondiale avant Noël. Le fondateur, Adam Cohen Hillel, a déclaré sur la plateforme X que le premier lot avait été vendu en seulement sept heures.

La popularité des clés IA n'est pas surprenante, mais elle soulève également la question suivante : est-il vraiment nécessaire de brancher un périphérique supplémentaire pour transformer son téléphone en « téléphone IA » ? Ceci nous permet d'approfondir la question plus profonde : est-il vraiment nécessaire de créer du matériel IA spécialement pour l'IA ?

Le matériel d’IA est en plein essor, mais les téléphones portables sont fermement sous les projecteurs

Bien que le vice-président senior d'Apple, Eddy Cue, ait souligné à plusieurs reprises que l'iPhone pourrait être éliminé au cours de la prochaine décennie, il est indéniable que la meilleure forme de matériel d'IA à l'heure actuelle reste le téléphone mobile.

L'iPhone 16 Pro que vous avez dans votre poche est équipé d'une puce de deuxième génération gravée en 3 nm et peut accéder aux modèles d'IA les plus puissants de l'histoire, tels que ChatGPT, Claude, Gemini et DeepSeek. Outre la prise en charge des modèles cloud à grande échelle, les fabricants de téléphones mobiles déploient également d'importants efforts pour développer des modèles intégrés.

Même Apple, qui a été critiqué pour son retard dans le domaine de l'IA, a récemment publié FastVLM et MobileCLIP2 sur Hugging Face.

Ces modèles sont 85 fois plus rapides et 3,4 fois plus petits que les versions précédentes, ce qui rend possibles les applications de modèle de langage visuel (VLM) en temps réel et même leur exécution entièrement native dans le navigateur pour réaliser la génération de sous-titres vidéo en temps réel.

Sans parler de la série de téléphones Google Pixel 10, lancée il y a quelque temps, qui peut être considérée comme un téléphone gratuit pour l'achat de l'IA. Non seulement elle peut exécuter le modèle Gemini Nano en local, mais elle est également équipée de fonctions telles que Camera Coach et Auto Best Take. Elle peut analyser la scène, la lumière et les mouvements des personnages en temps réel, optimiser automatiquement les photos et même proposer des suggestions de prise de vue.

La raison pour laquelle cela peut être réalisé est simple : la qualité du matériel est là.

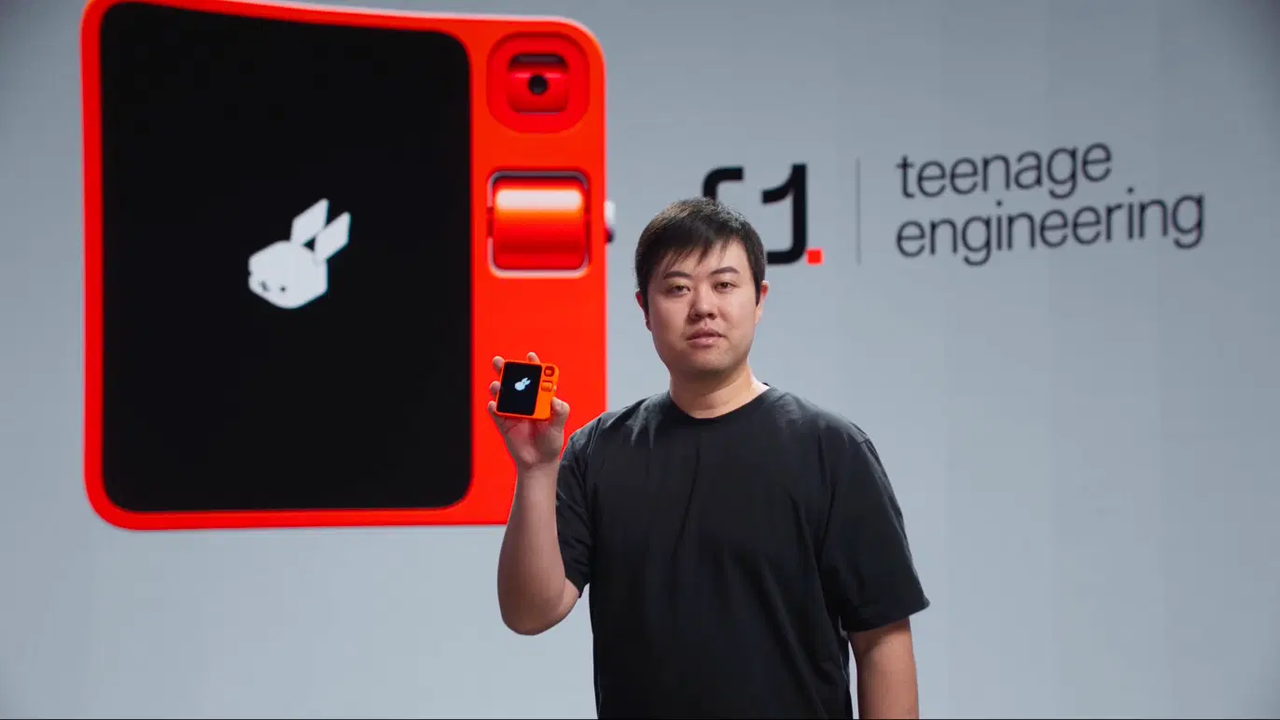

En repensant à la première vague de matériel d'IA, Humane Ai Pin et Rabbit R1 sont tous deux apparus comme des perturbateurs, tentant de remodeler l'avenir de l'informatique personnelle à travers le concept « pas d'écran/peu d'écrans ».

Le premier, Ai Pin, a été créé par un ancien cadre d'Apple avec pour mission de « faire de la technologie votre serviteur, et non votre maître ». Le second, avec son design orange audacieux et son concept de « grand modèle d'action », promet d'utiliser l'IA pour réaliser des tâches complexes au sein des applications pour les utilisateurs.

Cependant, Humane Ai Pin, qui visait à remplacer les téléphones portables, a été confronté à de graves problèmes de surchauffe et d'autonomie de la batterie et a finalement été vendu à HP.

Le Rabbit R1 a également connu un démarrage prometteur, mais a connu une fin mitigée. Lors de ses premiers lancements, son port USB-C était extrêmement exigeant en matière de câbles de charge et n'était compatible qu'avec certains câbles. De plus, son autonomie était extrêmement faible, avec une capacité de seulement 1 000 mAh. Ce problème reflétait non seulement la qualité, mais aussi le manque d'expérience de la start-up en matière de chaîne d'approvisionnement et de contrôle qualité.

Un commentaire sur le forum Reddit mentionnait même que l'équipe R1 avait « accidentellement commandé les mauvais composants mémoire ». Cet épisode illustre parfaitement le chaos et la fragilité auxquels sont confrontées les start-ups du secteur du matériel informatique dans la gestion de leur chaîne d'approvisionnement.

Lorsque les startups sont obligées de faire des compromis sur le contrôle des coûts et l'approvisionnement de la chaîne d'approvisionnement, cela est plus susceptible de conduire à un cercle vicieux : le matériel bas de gamme ne peut pas offrir une expérience fluide, les avis négatifs des utilisateurs conduisent à un effondrement du bouche-à-oreille, ce qui à son tour affecte les ventes, rendant difficile pour l'entreprise de réduire les coûts grâce à une production à grande échelle, et finalement de tomber dans des difficultés financières, voire une faillite.

Ce n’est pas que R1 et Ai Pin n’ont aucune valeur, mais leur importance peut se refléter davantage dans l’exploration des modes d’interaction de l’IA.

Les concepts qu'ils promeuvent – agents actifs, commandes vocales ambiantes, interface de tâches unifiée – sont puissants, mais ils ne prospéreront pas dans un environnement autonome. Ils seront plutôt absorbés par les plateformes dominantes et deviendront des fonctionnalités natives sur iOS, Android, etc.

La molette de défilement de Rabbit R1, la projection de Humane Ai Pin et la forme « clé » d'AI Key, ces choix de conception apparemment étranges testent en réalité différentes hypothèses d'interaction et éliminent les mauvaises options pour l'industrie.

Je ne suis pas contre l'innovation, et je ne pense pas que toutes les startups spécialisées dans le matériel d'IA soient dénuées de sens. Mais il faut se rendre à l'évidence : avec des téléphones portables déjà si puissants, tout produit qui tente d'« améliorer » les capacités d'IA d'un téléphone grâce à des accessoires externes se heurte à d'énormes défis en termes d'expérience utilisateur.

La véritable opportunité se trouve peut-être ailleurs : soit faire des choses que les téléphones portables ne pourront jamais faire, soit attendre l’émergence d’une plateforme informatique complètement nouvelle, plutôt que de brancher un plug-in sur l’iPhone et de dire aux utilisateurs : Regardez, c’est l’avenir.

Fonction ou attribut ? Notre incompréhension fondamentale de l'IA

Une philosophie technique cachée derrière le débat sur le matériel d'IA est de savoir si vous considérez l'IA comme une « fonction » ou comme un « attribut ».

Les fonctions sont discrètes et divisibles, nécessitant des supports spécialisés, tandis que les attributs sont omniprésents et omniprésents, modifiant la manière dont l’ensemble du système fonctionne.

Lorsque l’IA est utilisée comme une fonction, l’idée est de séparer l’IA et de la regrouper dans un argument de vente.

Par exemple, les chatbots, les traducteurs, le LAM de Rabbit R1 et la projection laser de Humane Ai Pin. Leur logique est la suivante : développer d'abord la technologie d'IA, puis trouver le matériel pour l'intégrer. Lorsque les utilisateurs souhaitent l'utiliser, ils doivent l'ouvrir et interagir avec elle de manière spécifique.

Le problème est que la plupart de ces « fonctionnalités » existent déjà dans les téléphones et sont mieux réalisées, de sorte que le nouveau matériel ressemble à un « intermédiaire » et manque d’un véritable fossé.

Une autre approche consiste à intégrer l’IA dans l’écosystème existant, en en faisant un « attribut » intégré du système.

L'intelligence artificielle d'Apple en est un bon exemple : notifications prioritaires, résumés d'e-mails, nettoyage des photos et améliorations de Siri sont autant de fonctionnalités basées sur l'IA, intégrées à l'expérience existante. La démarche de Google pour localiser Gemini Nano suit une logique similaire.

Les utilisateurs ne ressentent peut-être même pas la présence de l’IA, mais leur efficacité et leur expérience sont globalement améliorées.

À l'époque où la voiture fut inventée, on l'appelait à juste titre « voiture sans chevaux ». L'imagination se limitait à remplacer les chevaux, se demandant si elle pouvait courir aussi vite qu'un cheval et si elle dérangerait le bétail le long de la route.

Personne n'aurait pu prévoir que ce « monstre de fer » donnerait naissance à un réseau d'autoroutes, à une logistique moderne, à une culture suburbaine et transformerait radicalement la forme des villes et le cadre de vie des habitants. Aujourd'hui, notre vision du matériel d'IA pourrait être elle aussi prisonnière d'un cadre étroit.

Ainsi, lorsque cette « nouvelle espèce » d'intelligence artificielle est apparue, notre première réaction a été presque réflexive : elle aussi avait besoin d'un « appareil dédié ». Une « boîte à IA », un « terminal à IA », ou à tout le moins, un « PC à IA ».

Ce type de raisonnement est comparable à celui d'un homme primitif découvrant le feu pour la première fois. Au lieu de réfléchir à l'utilisation de l'énergie du feu pour cuisiner, se chauffer ou fondre, il pense qu'il doit fabriquer un « bâton de feu » pour pouvoir tenir la flamme dans sa main.

Dès 1998, Eli Zelkha et son équipe ont proposé le concept d'« intelligence ambiante », désignant des systèmes environnementaux intelligents capables de détecter et de réagir à la présence humaine. Ces environnements interagissent de manière fluide avec les utilisateurs grâce à des dispositifs intégrés (capteurs, actionneurs et modules d'IA), cherchant ainsi à intégrer la technologie à nos vies plutôt qu'à en faire un fardeau.

Les entreprises qui comprennent vraiment l’IA n’essaieront pas de créer délibérément des « appareils d’IA », mais fabriqueront tous les appareils basés sur l’IA.

Une technologie mature ne se contente pas de rester sur toutes les lèvres. De la même manière, on ne parle plus aujourd'hui de « lampes de bureau électriques » ou d'« ordinateurs connectés », car l'électricité et la connectivité internet font déjà partie intégrante de ces appareils, des fonctionnalités que nous tenons pour acquises.

De même, lorsque l’IA deviendra véritablement populaire, elle passera du statut d’« argument de vente » constamment mis en avant à celui d’infrastructure pour tous les appareils intelligents.

D'ici là, votre voiture, votre réfrigérateur, vos lunettes et même vos vêtements seront dotés de différentes formes d'intelligence. Ils seront connectés les uns aux autres et travailleront ensemble pour former votre système personnel d'« intelligence ambiante ».

Le jour où nous cesserons de parler de matériel d’IA sera le jour où l’IA deviendra omniprésente.

#Bienvenue pour suivre le compte public officiel WeChat d'iFaner : iFaner (ID WeChat : ifanr), où du contenu plus passionnant vous sera présenté dès que possible.