Ces produits d’IA brisent les barrières pour 430 millions de personnes

Nous avons déjà écrit un article intitulé « Ne me demandez plus pourquoi les personnes sourdes vont aux festivals de musique » qui popularisait la position particulière des festivals de musique à l'étranger : les interprètes en langue des signes.

Bien que les malentendants ne puissent pas entendre ou entendre clairement la musique, ils peuvent ressentir le rythme de la musique et la chaleur de l'atmosphère à travers les mouvements des mains, les expressions faciales et le langage corporel très contagieux des interprètes en langue des signes.

Il peut s’agir d’un scénario de langue des signes inattendu pour les personnes entendantes. En fait, il existe encore de nombreux endroits où des interprètes en langue des signes sont nécessaires, tant en ligne que hors ligne, mais ils ne sont pas suffisants.

Sally Chalk, une Anglaise, a ouvert une société d'interprétation en langue des signes britannique en 2002. Après 20 ans d'activité, l'entreprise a pris une taille considérable et le délai de réservation d'un interprète en langue des signes a été réduit à 30 minutes, mais elle est toujours pas satisfait.

Les personnes malentendantes peuvent-elles avoir un accès immédiat à l’interprétation en langue des signes, tout comme on active les sous-titres sur un site Web de vidéos ?

Sa réponse est d’impliquer l’IA.

En ligne comme hors ligne, les personnes malentendantes devraient être autorisées à utiliser plus souvent leur « langue maternelle »

En 2022, Sally Chalk a ouvert une nouvelle start-up, Signapse, qui se concentre sur le développement d'un logiciel de traduction générative en langue des signes par IA pour traduire des textes écrits en langue des signes américaine et en langue des signes britannique en temps réel.

En mai de cette année, Signapse a reçu 2 millions de livres sterling de financement d'amorçage, dont 500 000 livres sterling provenaient du gouvernement britannique.

L’un des scénarios hors ligne qu’ils ciblent concerne les centres de transport tels que les gares et les aéroports.

L'aéroport international de Cincinnati/Northern Kentucky aux États-Unis s'est associé à Signapse pour afficher la langue des signes américaine sur l'écran afin de fournir des informations d'accueil, de sécurité, de départ, d'arrivée et autres.

Comment fonctionne l’IA ? Signapse est basé sur un vaste ensemble de données en langue des signes et utilise des réseaux contradictoires génératifs (GAN) et des techniques d'apprentissage en profondeur pour créer des interprètes virtuels réalistes en langue des signes qui traduisent aussi précisément que possible.

Ces avatars sont basés sur de vrais interprètes en langue des signes, et chaque fois qu’ils sont utilisés commercialement, les vraies personnes obtiennent une part.

Étant donné que les destinations des aéroports, les heures de départ et les numéros de quai changent souvent, la traduction en langue des signes de Signapse peut être mise à jour en temps réel en s'intégrant aux données de trafic.

Dans le même temps, Signapse n’a pas ignoré les besoins en ligne et propose également des traductions en langue des signes pour les sites Web et le streaming vidéo.

Bien que les sites Web tels que YouTube proposent des sous-titres fermés, les personnes malentendantes préfèrent souvent la langue des signes aux sous-titres, car la langue des signes possède des structures grammaticales et des expressions indépendantes des autres langues, ce qui améliore leur expérience en ligne.

Vous auriez dû remarquer que lorsque nous parlons de langue des signes, nous utilisons la langue des signes américaine et la langue des signes britannique. Tout comme les langues parlées et écrites du monde entier sont incompréhensibles, la langue des signes est globale.

Selon les Nations Unies, environ 70 millions de personnes dans le monde utilisent la langue des signes comme principale forme de communication, et plus de 300 types différents de langue des signes sont utilisés dans le monde. Aux États-Unis seulement, 500 000 personnes utilisent la langue des signes américaine.

Par conséquent, ce que Signapse fait actuellement est en réalité très limité, couvrant seulement un petit nombre de personnes qui utilisent la langue des signes américaine et britannique, et des scénarios verticaux limités. Au cours des deux dernières années, Signapse a créé chaque jour environ 5 000 annonces routières en langue des signes britannique.

Signapse espère qu'à l'avenir, ses services seront plus universels, étendus à l'éducation et à d'autres scénarios, et également plus personnalisés, permettant aux utilisateurs de personnaliser l'apparence des interprètes virtuels en langue des signes.

L’environnement et les conditions soutiennent l’IA, et les principaux fabricants nationaux proposent également des produits similaires en langue des signes.

Des présentateurs de langue des signes IA sont apparus dans la salle de diffusion en direct Honor of Kings de Tencent et lors de la conférence des développeurs de Huawei.

Aux Jeux olympiques d'hiver de 2022, l'ancre de langue des signes IA créée conjointement par CCTV News et Baidu Intelligent Cloud Xilin a été lancée, et l'École d'intelligence artificielle pour les sourds de l'Université de technologie de Tianjin a participé à l'annotation du matériel en langue des signes.

Derrière l'ancrage de la langue des signes IA, la plate-forme de langue des signes IA de Baidu Intelligent Cloud Xiling peut également répondre aux besoins de traduction rapide en langue des signes dans différents scénarios tels que les hôpitaux, les gares, les banques, etc., ce qui est le même que le héros Signapse.

Des déplacements plus fluides, une expérience visuelle plus immersive, des services plus accessibles…

Si la marge d’amélioration dans l’interprétation de la langue des signes est plus profonde que la mer, au moins la manière dont les personnes malentendantes obtiennent des informations publiques est modifiée par l’IA, les vagues visibles continuant de monter.

Les gens de Duolingo dans le monde de la langue des signes

Les personnes malentendantes ont-elles aussi besoin d'« écouter » de la musique ? Est-il suffisant pour les personnes malentendantes de lire un texte ? Il s'agit d'un problème typique considéré du point de vue de l'écoute de la logique des gens.

En fait, nous devrions nous poser la question inverse : comment les personnes malentendantes peuvent-elles également avoir le sentiment de participer aux festivals de musique ? Comment Internet peut-il rendre la navigation plus agréable pour les malentendants ?

Ce n’est donc pas qu’il y ait un écran supplémentaire dans une gare occupée, mais que l’écran devrait être là.

De plus en plus d’entreprises et de particuliers exploitent la puissance de la technologie pour rendre la langue des signes de plus en plus pertinente.

Permettre aux personnes entendantes d’apprendre la langue des signes est l’une des idées les plus faciles à imaginer.

PopSign est une application pour apprendre la langue des signes en jouant. Elle utilise un modèle de langue des signes d'IA et a été développée conjointement par Google, le Rochester Institute of Technology et le Georgia Institute of Technology. Elle peut être utilisée sur Android et iOS. enfants malentendants de parents entendants.

Apprenant de la leçon que la mémorisation des mots commence par « abandonner » (abandonner) et se termine par l'abandon, PopSign ne diffuse pas de vidéos ennuyeuses en langue des signes, mais utilise des mini-jeux pour renforcer votre intérêt et votre confiance dans l'apprentissage de la langue des signes. Duolingo, qui vous pousse frénétiquement à vous enregistrer. .

Il existe également une société américaine appelée SLAIT qui veut devenir le « Duolingo » dans le monde de la langue des signes. Ils proposent également des cours et des tests interactifs immersifs. Si vous réussissez, le tuteur IA vous donnera un retour en temps réel et vous fournira la bonne quantité de valeur émotionnelle.

Cependant, l'enseignement de la langue des signes n'est que la deuxième meilleure option pour SLAIT. Ce qu'ils voulaient faire au début était en fait un outil de langue des signes IA pour le chat vidéo et la traduction en temps réel.

Mais il est difficile de préparer un repas sans riz. SLAIT est une petite équipe sans suffisamment de données ni de fonds. Comparé à la traduction directe de phrases en langue des signes, l’enseignement individuel du vocabulaire en langue des signes est plus simple, mais tout aussi précieux.

Le dur travail d’interprétation de la langue des signes est laissé aux riches géants.

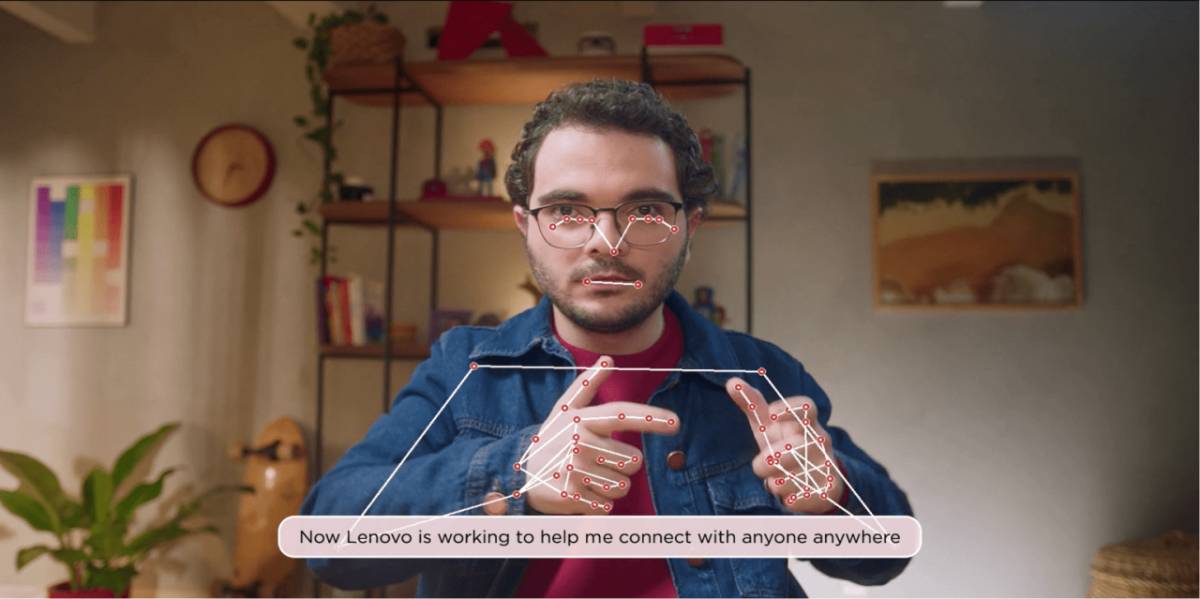

En août 2023, Lenovo Brésil a développé une application de traduction de chat en temps réel basée sur l'IA pour traduire la langue des signes portugaise et prévoit de couvrir davantage de langues des signes dans le monde à l'avenir.

Lorsqu'une personne malentendante signe devant la caméra de l'appareil, l'algorithme le traduira instantanément en texte portugais et l'enverra au destinataire à l'autre bout du fil.

Il devrait y avoir autant d'outils de ce type que possible, qui complètent les services d'enseignement de la langue des signes et permettent aux malentendants d'adopter une position plus active et de devenir davantage des initiateurs de conversations.

Google est plus axé sur les produits et a lancé le concours Kaggle AI Sign Language Recognition 2023.

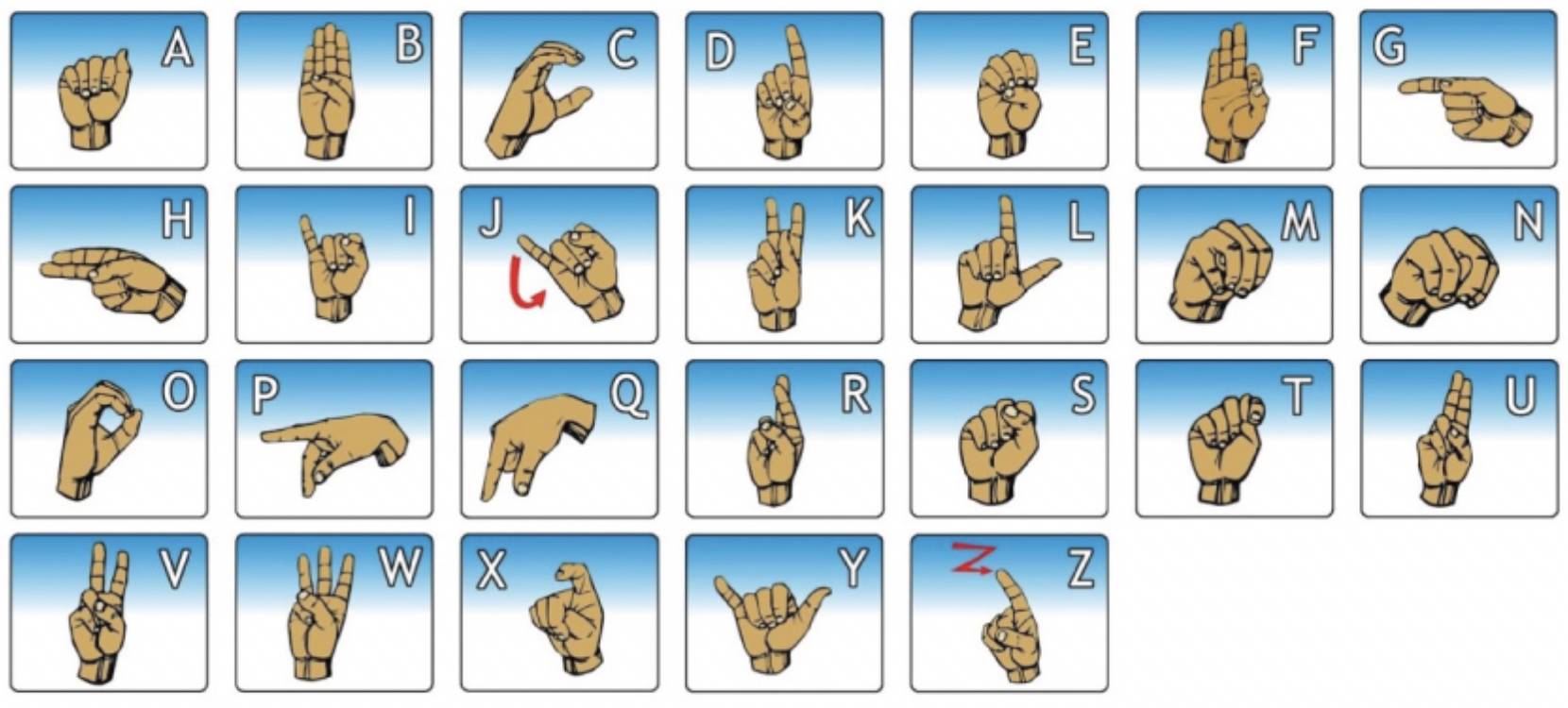

Le thème de ce concours est très intéressant : les participants construisent un modèle d'orthographe digitale qui utilise des caméras intelligentes pour suivre rapidement les doigts, les paumes et les visages, sur la base de plus de 3 millions de caractères d'orthographe digitale obtenus à partir de selfies de personnes malentendantes.

L'orthographe des doigts est un type de langue des signes qui utilise différentes formes et positions des doigts pour représenter les lettres. Pour de nombreuses personnes handicapées, l'orthographe avec les doigts est beaucoup plus rapide que la saisie sur le clavier virtuel d'un smartphone.

Par conséquent, améliorer la reconnaissance de la langue des signes et créer des modèles d'orthographe digitale consiste à permettre aux personnes malentendantes d'utiliser directement la langue des signes dans laquelle elles sont meilleures au lieu de taper et de parler, et d'utiliser des fonctions telles que la recherche, les cartes et les messages texte sur leur mobile. Téléphone (s.

En outre, cela contribuera également à développer des applications de conversion de la langue des signes à la parole, sortant ainsi de l'impasse dans laquelle les personnes malentendantes ne peuvent pas utiliser la voix pour appeler des assistants numériques.

En d'autres termes, de nombreux produits axés sur la voix n'ont pas pris en compte dès le début les utilisateurs qui ne sont pas doués pour parler.

Sam Sepah, chef de produit en chef de la recherche sur l'accessibilité chez Google, a mentionné dans une interview avec Forbes que leur objectif est de faire de la langue des signes une option linguistique universelle lors de l'utilisation des produits Google.

En fait, cela devrait également être l’objectif de l’ensemble d’Internet : faire de la langue des signes une langue universelle dans le monde numérique.

En tant que logiciel d'apprentissage des langues, Duolingo offre à chacun des chances égales en matière d'éducation. Ce que les produits d’IA en langue des signes font ressentir aux gens, c’est que les restrictions qui ne devraient pas exister sont levées et que les gens peuvent communiquer entre eux partout.

Plus l’IA devient puissante, plus nous devons valoriser l’humanité

En mai, lors de la sortie de GPT-4o, une vidéo de démonstration très touchante faisait office d'yeux, permettant aux malvoyants de « voir » l'environnement.

La personne malvoyante sait par la bouche de l'IA que des drapeaux flottent au-dessus du palais de Buckingham, que des canards jouent tranquillement dans la rivière et qu'un taxi est sur le point d'arriver. Les coins de sa bouche se soulèvent en réponse au ton joyeux de l'IA.

Comme le dit le proverbe, la technologie ouvre la porte à un monde nouveau. Peut-on à l’inverse comprendre que les personnes handicapées vivaient à l’origine dans un monde qui n’était pas conçu pour elles ?

Les données de l'OMS montrent que 430 millions de personnes dans le monde ont besoin d'un traitement de réadaptation pour traiter une perte auditive invalidante. Le nombre d’interprètes en langue des signes est loin d’être suffisant aux États-Unis, le ratio utilisateurs malentendants/interprètes en langue des signes américaine est d’environ 50 pour 1.

Alors pour l’instant, la langue des signes de l’IA ne joue qu’un rôle supplémentaire et de cerise sur le gâteau, et n’est pas encore au point de « voler des emplois ».

Les produits d'IA en langue des signes mentionnés ci-dessus sont essentiellement à petite échelle, verticaux et enracinés dans des régions spécifiques, compensant l'inaccessibilité des interprètes humains.

Le mois dernier, j'ai également vu un produit sympa en langue des signes IA.

Des chercheurs de plusieurs universités, dont l'Université Rutgers et l'Université Carnegie Mellon, ont transformé des vidéos publiques en langue des signes en un ensemble de données contenant 8 langues des signes et ont formé SignLLM, le premier modèle de génération de langue des signes multilingue.

Il couvre une variété de langues des signes et peut générer des langues des signes via des mots d'invite textuels, n'est-ce pas très pratique ? Cependant, les chercheurs ont déclaré que le monde extérieur ne devrait pas exagérer les résultats de leurs recherches. La vidéo de démonstration n'est pas une sortie directe du modèle et sa production reste très difficile.

Dans le même temps, certains experts malentendants se sont manifestés et ont déclaré que la qualité de la traduction en langue des signes dans ces vidéos varie. Certaines sont à moitié compréhensibles, d'autres complètement incompréhensibles et manquent d'expressions faciales. Le projet a du potentiel, mais il l'est. doit être amélioré.

Le plus important est de permettre aux utilisateurs malentendants de participer, d'exprimer leurs opinions et d'améliorer ensemble le produit, car « sans notre participation, il n'y aura pas de décisions nous concernant ».

Un sentiment subtil est qu’il semble difficile de rendre « sexy » des produits sans barrière.

Ils ne sont souvent pas aussi excitants que la sortie de grands modèles et de matériel d'IA. Ils vous disent toujours quelles fonctions ils ont et à qui ils servent. Ils espèrent faire mieux à l'avenir et ne « mordront pas plus qu'ils ne peuvent mâcher ».

Et aux yeux du capital-risque, ils sont également des niches, ont un potentiel inconnu et peuvent ne pas avoir de retour sur investissement.

Mais la « marraine de l'IA » Li Feifei a dit un jour que l'IA est destinée à aider les gens. Plus l'IA est puissante, plus nous devons chérir l'humanité.

Tout le monde ne devrait pas avoir peur de rater un vol, tout le monde devrait pouvoir interagir avec les produits et tout le monde devrait profiter des festivals de musique.

Ces choses qui étaient autrefois invisibles et inouïes devraient également être éclairées par la lumière de la technologie. Claquons des doigts en résonance, afin que les besoins d'un plus grand nombre de personnes puissent être satisfaits, que les capacités d'un plus grand nombre de personnes puissent être améliorées, afin que nous puissions gagner plus et perdre moins.

# Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (ID WeChat : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo