Désormais, tout le monde aura un « Van Gogh » dans son téléphone portable

Combien de temps pensez-vous qu'il faut pour faire un épisode comme celui-ci?

Dans l'industrie de l'animation traditionnelle, la production d'animation est souvent le maillon le plus chronophage.Les animateurs doivent produire les effets d'animation de chaque plan en fonction du scénario du storyboard et de la conception artistique.

De la conception des personnages au dessin des scènes, en passant par la réalisation des animations, une équipe de production met souvent plusieurs mois voire un an.

Mais récemment, cette loi de l'industrie est réécrite par des outils d'IA.

Le court métrage d'animation que vous regardez maintenant se compose de 120 plans d'effets visuels et d'une durée totale de 7 minutes, et son équipe de production, Corridor, n'a passé que quelques heures sur l'animation.

Le secret de l'efficacité réside dans l'outil qu'ils utilisent – Stable Diffusion.

La créativité est à nouveau libérée

Comme nous le savons tous, chaque plan animé de l'animation est composé d'images animées continues dessinées image par image par les artistes, et derrière chaque épisode d'animation est presque composé de milliers de croquis.

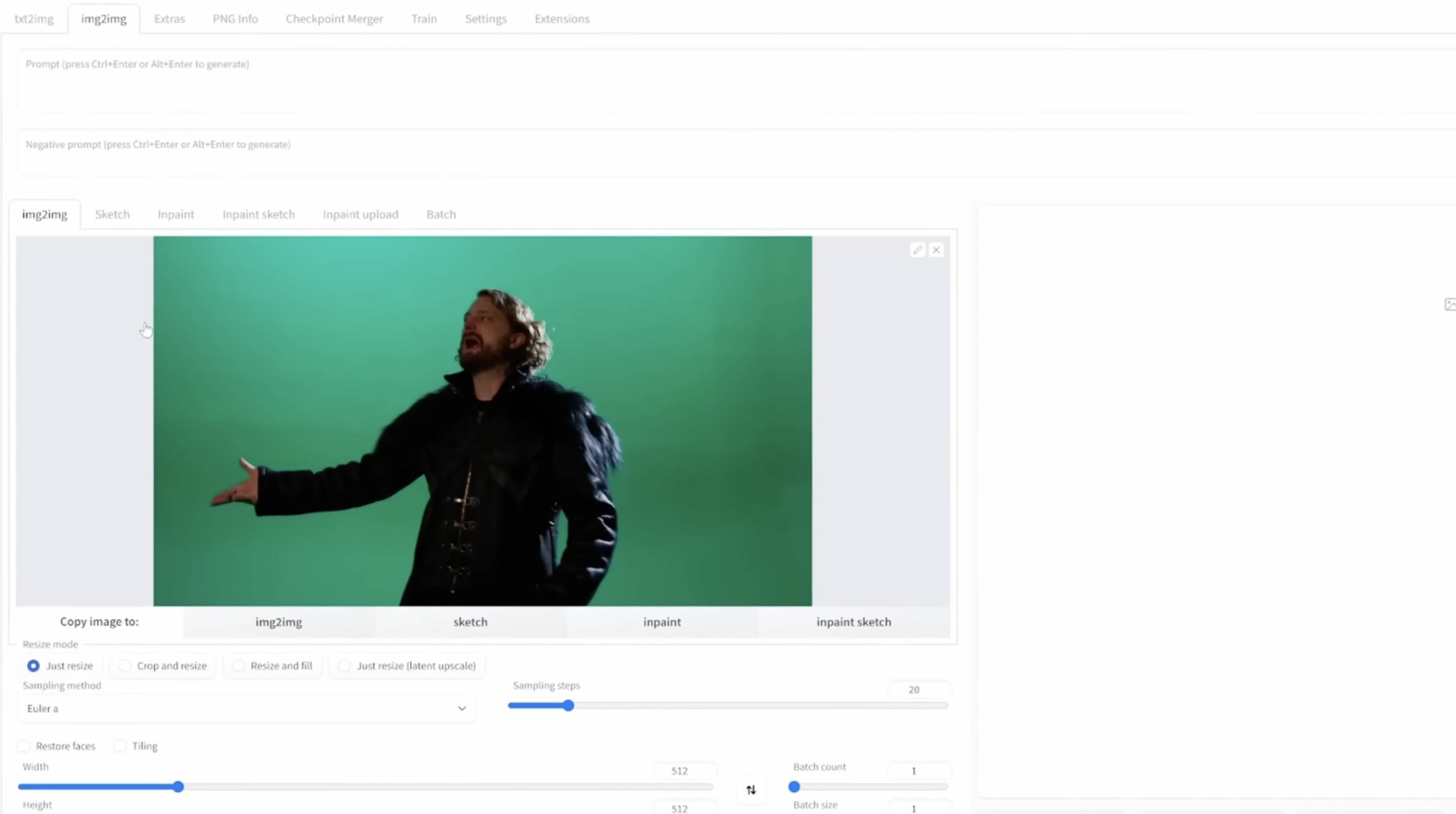

Il est presque impossible pour Corridor de dessiner une animation image par image à la main, alors ils ont pensé à une autre façon de faire une peinture : la prise de vue est essentiellement une photo image par image, si elle est transformée en un style d'animation image par image Assembler à nouveau, n'est-ce pas juste de l'animation ?

Pour convertir des photos en images d'animation par lots, Corridor a d'abord pensé à l'outil de dessin AI le plus populaire : Stable Diffusion.

Par rapport aux outils de dessin d'IA tels que Dall-E 2 et Midjourney, l'un des avantages de Stable Diffusion est qu'il s'agit d'un projet open source.Les utilisateurs peuvent préparer localement la base de données la plus appropriée, laisser l'IA apprendre le style de dessin de manière ciblée, puis générer des lots Le style de l'image.

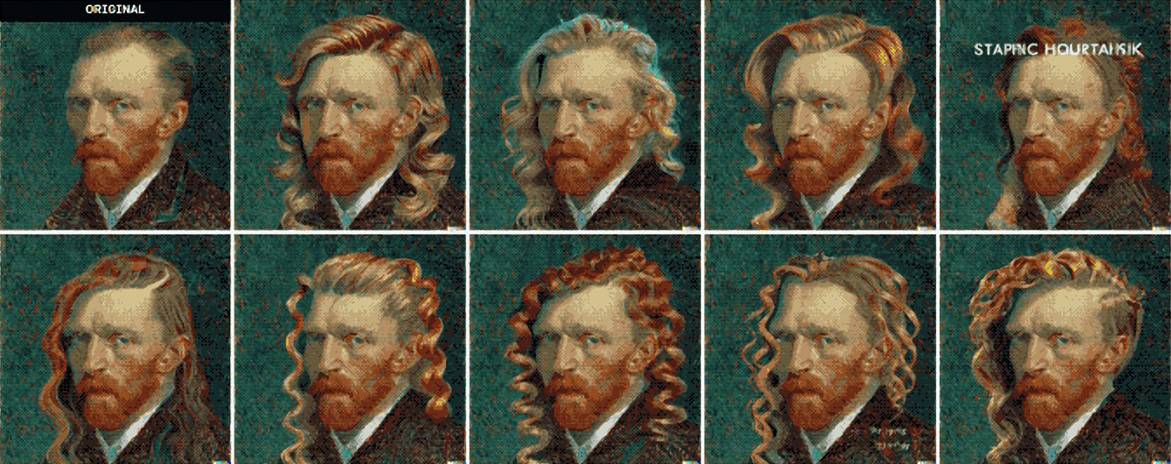

Selon le décor conçu à l'avance, Corridor a laissé Stable Diffusion apprendre un grand nombre d'images de "The Vampire Diaries", ainsi que des photos sous différents angles des deux acteurs principaux, afin que les images animées transformées soient aussi fidèles que possible. et le style tend à être unifié.

Une fois que Stable Diffusion a converti l'intégralité de la vidéo en un style d'animation, certaines images instables sont supprimées et le scintillement est éliminé, et enfin l'écran vert est remplacé par l'arrière-plan capturé par la caméra virtuelle. À l'origine, il fallait une douzaine de peintres pour dessiner pendant plusieurs semaines L'animation est terminée.

En voyant cela, voulez-vous également utiliser votre imagination, tourner vous-même un court métrage d'animation ou vous transformer en une variété de héros fantastiques ?

Bien que Stable Diffusion présente les avantages d'une grande contrôlabilité, mais pour le contrôler, vous avez d'abord besoin d'un environnement informatique puissant sur le serveur ou sur le côté local pour qu'il fonctionne.

En d'autres termes, si vous n'avez pas d'imagination, mais que vous ne disposez pas de solides capacités d'apprentissage et de traitement du langage naturel, et de la puissance de calcul de l'IA comme support, vous ne pouvez toujours pas utiliser Stable Diffusion pour créer.

Alors, existe-t-il un moyen pour que les gens ordinaires puissent facilement dessiner eux-mêmes un avatar unique ?

Il y en a vraiment, et tant que "vous avez un téléphone portable".

Lors de la conférence MWC, Qualcomm a présenté pour la première fois Stable Diffusion fonctionnant localement sur un téléphone Android, et a également montré plusieurs images AI générées côté téléphone. L'effet semble plutôt bon et l'ensemble du processus prend moins de 15 secondes.

Les paramètres de Stable Diffusion dépassent 1 milliard. Les ordinateurs ordinaires sont très difficiles à faire fonctionner. Comment Qualcomm "fourre-t-il" un modèle aussi énorme dans le téléphone mobile et le fait-il fonctionner correctement sur le SoC du téléphone mobile ?

Afin de "mettre l'éléphant au réfrigérateur", les ingénieurs de Qualcomm ont d'abord optimisé l'éléphant.

Ici, il faut d'abord mentionner une amélioration majeure de l'IA dans la plate-forme mobile Snapdragon 8 de deuxième génération, le traitement du langage naturel (NLP).

Le traitement du langage naturel est l'un des nouveaux domaines des applications d'intelligence artificielle.Afin de comprendre et de décomposer le langage humain le plus rapidement possible, Qualcomm a considérablement amélioré le processeur Hexagon et augmenté l'accélération matérielle, ce qui peut faire fonctionner le réseau Transformer plus rapidement et plus efficacement, et réduire la vitesse de traitement grâce au raisonnement par micro-tranchage.La consommation d'énergie fait que le Snapdragon 8 de deuxième génération présente des avantages uniques dans les cas d'utilisation du traitement du langage naturel.

Afin de permettre à Stable Diffusion de fonctionner côté terminal, les ingénieurs de Qualcomm ont choisi de commencer avec le modèle open source FP32 version 1-5 de Hugging Face, et d'utiliser le Qualcomm AI Model Enhancement Toolkit (AIMET) pour le quantifier après la formation sans sacrifier le modèle Dans le cas de la précision, le modèle FP32 d'origine est compressé au format INT8 avec une efficacité de calcul plus élevée.

Grâce à la pile logicielle Qualcomm AI de la solution logicielle d'IA unifiée de Qualcomm, Qualcomm peut quantifier et simplifier les modèles d'IA sans perdre la précision du modèle, améliorer considérablement les performances de raisonnement de l'IA et réduire la consommation d'énergie, ce qui rend les grands modèles d'IA plus adaptables aux téléphones mobiles et autres environnements informatiques à faible consommation d'énergie. côté terminal, ce qui facilite l'expansion côté terminal des modèles d'IA.

Grâce à l'optimisation logicielle et matérielle complète de la pile, Stable Diffusion peut enfin fonctionner sur la plate-forme mobile Snapdragon 8 de deuxième génération intégrée au processeur Hexagon, effectuer 20 étapes d'inférence en 15 secondes et générer une image de 512 × 512 pixels, de sorte que le la vitesse est déjà comparable à la latence du cloud computing.

En d'autres termes, le modèle d'IA générative à grande échelle dans le cloud a fait le premier pas dans l'expansion des applications côté terminal.

Bien que vous ne puissiez pas utiliser Stable Diffusion pour photographier des superproductions comme Corridor, il suffit amplement de l'utiliser pour dessiner votre propre tête et prendre des portraits virtuels. Que vous souhaitiez un autoportrait dans le style de Monet, Van Gogh ou Akira Toriyama, vous pouvez saisir directement des commandes sur votre téléphone pour générer une œuvre d'IA unique en un clic.

À l'avenir, les modèles d'IA avec une échelle de dizaines de milliards de paramètres pourront peut-être fonctionner côté terminal, et le niveau d'intelligence de l'assistant d'IA sur votre téléphone mobile fera un saut qualitatif. Les possibilités offertes par le déploiement sur appareil de modèles d'IA génératifs dépassent l'imagination.

Une explosion technologique naturelle

Lorsqu'il s'agit d'informatique IA, la première chose à laquelle beaucoup de gens pensent est un grand serveur cloud.L'IA semble être loin de nos vies.

Mais en fait, chaque fois que vous déverrouillez votre téléphone, réveillez votre assistant vocal ou même appuyez sur le déclencheur, c'est un contact intime avec l'informatique IA.

En raison des nombreux avantages du traitement de l'IA côté terminal, y compris les téléphones mobiles en termes de fiabilité, de délai et de confidentialité, de plus en plus de grands modèles de cloud IA ont commencé à fonctionner côté terminal.

Aujourd'hui, l'informatique IA a pénétré tous les aspects de nos vies avec le déploiement des terminaux. Vous pouvez facilement trouver l'IA dans les produits terminaux tels que les smartphones, les tablettes, les lunettes XR et même les voitures. C'est la vision de la périphérie de la connexion réseau intelligente que Qualcomm a construit, et Qualcomm travaille en silence depuis plus de dix ans.

Amener l'IA du cloud au terminal peut résoudre les deux problèmes des utilisateurs à la fois : d'une part, les données traitées par le terminal peuvent être conservées sur le terminal et la confidentialité des données personnelles de l'utilisateur est correctement protégée. . D'autre part, les terminaux peuvent effectuer des calculs et des traitements en temps opportun, offrant aux utilisateurs des résultats de traitement fiables et à faible latence.

Qualcomm est cette fois le premier à déployer Stable Diffusion sur les téléphones Android, ce qui offre non seulement aux utilisateurs la possibilité de créer de l'IA à tout moment et n'importe où, mais rend également l'édition d'images future pleine d'imagination.

Les modèles de diffusion stable encodent une richesse de connaissances linguistiques et visuelles, et peaufiner le modèle peut avoir des impacts tangibles dans l'édition d'images, la peinture d'images, le transfert de style et la super-résolution.

Imaginez, à l'avenir, vous pourrez prendre des photos ou des vidéos de style Disney ou japonais sans Internet, et tous les calculs d'image ne sont effectués que sur le téléphone mobile, ce qui est amusant et amusant tout en protégeant la confidentialité et la sécurité.

Dans la planification technique de Qualcomm, ce n'est que le début.

Auparavant, Qualcomm a publié une solution appelée "Qualcomm AI Software Stack". En termes simples, il suffit de développer un modèle une seule fois et il peut être étendu à tous les différents terminaux.

Les avancées de la recherche et les optimisations techniques réalisées par Qualcomm sur Stable Diffusion seront intégrées à l'avenir dans la pile logicielle Qualcomm AI.À l'avenir, il suffira de l'étendre sur cette base pour créer différents modèles adaptés aux plates-formes telles que les lunettes XR et Il est également appelé "feuille de route technologique unifiée" par Qualcomm.

Grâce à une telle voie de développement de produits, Qualcomm peut intégrer des technologies d'IA de pointe telles que le traitement du langage naturel et la reconnaissance faciale sur les terminaux de smartphone dans les lunettes XR, les PC, l'Internet des objets, les automobiles et d'autres produits, et finalement créer de nouvelles expériences intelligentes pour les utilisateurs.

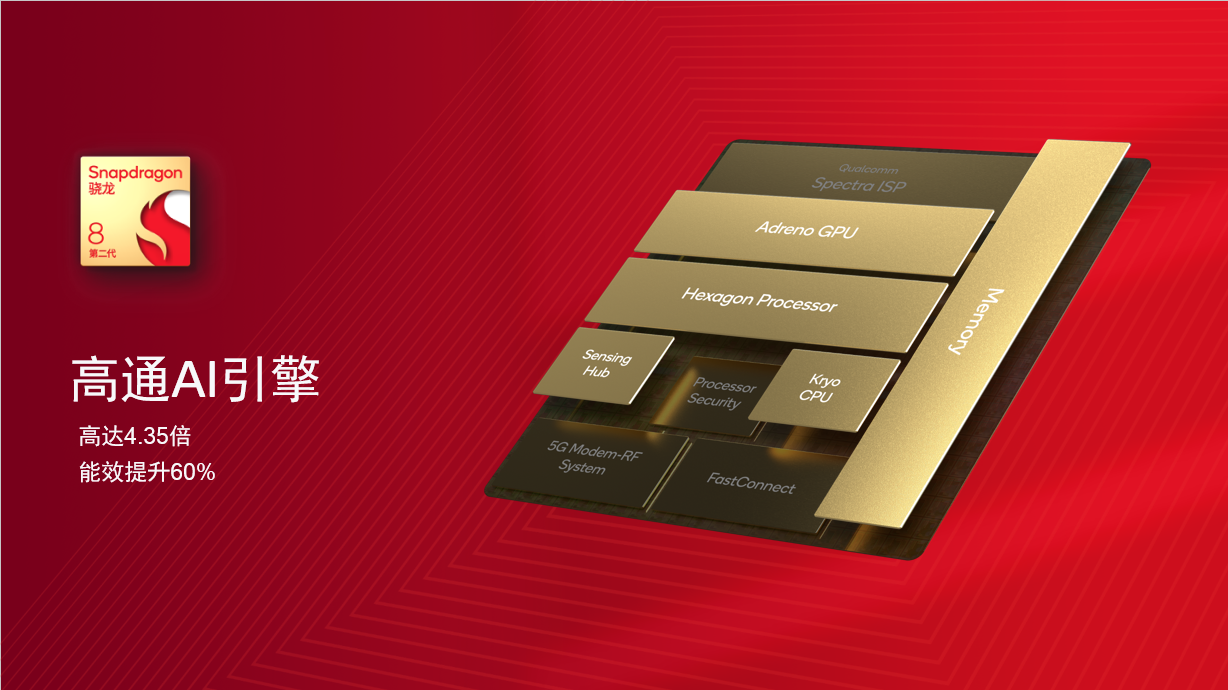

Un modèle de développement aussi flexible et efficace est indissociable du moteur d'intelligence artificielle de Qualcomm.

Le moteur Qualcomm AI comprend une unité de traitement graphique, un processeur et le processeur Hexagon le plus critique.

Parmi eux, le processeur Hexagon est composé de processeurs scalaires, vectoriels et tensoriels. Les trois accélérateurs utilisent une mémoire partagée unifiée. Qualcomm a doublé les performances de calcul de l'accélérateur tenseur et doublé la capacité de la mémoire partagée, faisant du nouveau La première génération Le moteur Qualcomm AI a amélioré l'efficacité énergétique de 70 % par rapport à la génération précédente.

Le moteur Qualcomm AI peut être étendu de manière flexible au niveau matériel, et un processeur Hexagon est généralement configuré sur une plate-forme mobile ; pour les plates-formes automobiles, cloud et edge computing, plusieurs instances de processeur Hexagon peuvent être utilisées pour augmenter la puissance de calcul.

Combinant les avantages architecturaux et les performances de puissance de calcul des principaux rivaux, on peut dire que Qualcomm utilise le moteur Qualcomm AI pour former le cœur des smartphones, de l'Internet des objets, des lunettes XR, des automobiles et d'autres entreprises.

Selon la vision de Qualcomm, l'informatique IA continuera à se développer dans une direction complètement distribuée, c'est-à-dire que le raisonnement IA sera transféré du cloud vers le côté terminal en grand nombre.

Par exemple, les téléphones mobiles apprendront l'accent de l'utilisateur pour améliorer la précision de la voix, les voitures apprendront différentes conditions de route et amélioreront le taux de reconnaissance des obstacles, etc.

En décembre de l'année dernière, Qualcomm s'est associé à la nouvelle actrice oscarisée Michelle Yeoh pour décrire une telle vision future de l'interconnexion intelligente de toutes choses :

Les smartphones deviennent plus intelligents, alimentés par le moteur AI de Qualcomm. Il a maîtrisé les compétences d'imagerie professionnelle, vous permettant de filmer des scènes de film 8K à portée de main ; il dispose également de capacités de traitement du langage naturel et peut activement vous fournir des services personnalisés tels que la traduction en temps réel comme un assistant.

Le moteur d'intelligence artificielle de Qualcomm permettra aux voitures d'évoluer en pilotes fiables. À l'avenir, les voitures peuvent détecter votre arrivée et effectuer des ajustements adaptatifs en fonction de vos habitudes ; une puissance de calcul puissante apporte des fonctions riches telles que l'assistance à la conduite, la sensibilisation à la sécurité de la situation et le divertissement en streaming, et peut également prédire la route à venir pour améliorer l'expérience de conduite, permettant vous permettre d'atteindre votre destination confortablement et en toute sécurité.

Les appareils portables tels que XR vous apporteront une expérience plus immersive et une interaction plus intuitive, vous permettant de vous déplacer librement dans les mondes virtuel et réel.

Dans l'ensemble, nous sommes actuellement au milieu d'une myriade de possibilités, et les innovations de l'IA qui nous entourent remodèlent le monde et changent tranquillement notre façon de travailler, de vivre et de communiquer.

À l'heure actuelle, les smartphones sont la meilleure plate-forme d'application pour la technologie de l'IA, mais la vulgarisation de la technologie de l'IA sur les smartphones n'est que la première étape. À l'avenir, la technologie de l'IA deviendra omniprésente, et la productivité et la créativité des gens seront davantage libérées. Qualcomm a longtemps été préparé pour cela.

#Bienvenue pour prêter attention au compte public WeChat officiel d'Aifaner : Aifaner (WeChat ID : ifanr), un contenu plus excitant vous sera présenté dès que possible.

Ai Faner | Lien d'origine · Voir les commentaires · Sina Weibo