Google mis à jour discrètement : tout ce que vous publiez sera utilisé pour la formation à l’IA

Il n'y a pas de déchets absolus dans le monde, seulement des ressources mal placées.

Dans le bouche-à-oreille des natifs numériques de la génération Z, la définition approximative de "99 % de l'information publique à l'ère d'Internet est une poubelle" est depuis longtemps monnaie courante, et ce qui est intéressant, c'est que l'arsenic de l'autre est mon miel et Google Les géants de l'IA représentés par Internet ont commencé à se concentrer sur les informations publiées sur Internet.

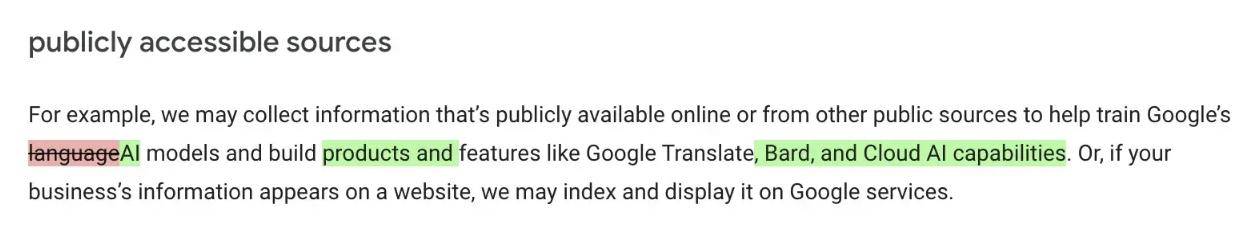

Récemment, le géant des moteurs de recherche Google a mis à jour sa politique de confidentialité afin d'utiliser les informations publiques sur Internet pour former des modèles d'IA. Il est écrit dans la politique de confidentialité que Google peut désormais aider à former le modèle d'IA de Google et à créer des fonctions pratiques, telles que Google Translate, Bard et Google Cloud AI, en collectant des informations publiques sur Internet ou des informations provenant d'autres sources publiques. sera inversé "Modèle de langage" en "Modèle AI".

Selon l'analyse du média OSCHINA, cette mise à jour de la politique montre que Google indique désormais clairement au public et à ses utilisateurs que tout contenu qu'ils publient publiquement en ligne peut utiliser Bard et ses futures versions, ainsi que tout autre produit d'intelligence artificielle développé. par Google. .

Les systèmes AIGC d'intelligence artificielle générative sont généralement pré-formés sur la base de données massives à usage général sur Internet, améliorant ainsi considérablement la généralisation, la polyvalence et la praticabilité de l'IA, ce qui conduira inévitablement à des litiges en matière de droit d'auteur et de confidentialité.

Pour le moment, personne ne peut mieux comprendre ce dilemme qu'OpenAI.

Il n'y a pas si longtemps, OpenAI, la société mère du robot de chat à intelligence artificielle ChatGPT, a été poursuivie par deux écrivains américains devant le tribunal fédéral de San Francisco, affirmant qu'OpenAI n'avait pas obtenu d'autorisation de droit d'auteur et avait abusé de leurs œuvres pour entraîner l'intelligence artificielle.

L'acte d'accusation exposé montre que les données de formation d'OpenAI dépassent 300 000 livres, y compris la controversée "Shadow Library" avec une propriété du droit d'auteur peu claire (fournissant principalement des livres et des documents gratuits au public sous la forme de sites en ligne de contenu de violation du droit d'auteur).

De plus, pas plus tard qu'hier, OpenAI a annoncé qu'il désactiverait temporairement le mode de navigation Web officiel de ChatGPT, ce qui pourrait être lié à l'exposition de ChatGPT à la possibilité de parcourir le mur payant pour obtenir du contenu payant caché. À la suite du procès en droit d'auteur de l'écrivain américain, sous l'opinion publique, OpenAI a de nouveau été profondément impliqué dans la tourmente du droit d'auteur.

Par conséquent, les leçons tirées d'OpenAI étant poursuivies, il est raisonnable pour Google de mettre à jour sa politique de confidentialité à l'avance et de se protéger à l'avance.

Bien que cette décision ait effectivement réduit le risque que Google "mange un procès", elle a également révélé le fait que l'intelligence artificielle générative utilise des données réseau massives pour la formation, ce qui a inévitablement suscité des inquiétudes du public concernant la confidentialité. Les médias étrangers Gizmodo ont également déclaré qu'il s'agissait d'un problème de confidentialité nouveau et intéressant.

En fait, même si les gens comprennent généralement que les informations sur les données diffusées publiquement sur Internet sont ouvertes et gratuites, il existe une attente psychologique selon laquelle les informations sur les données peuvent être consultées par d'autres, mais si la quantité massive d'informations sur les données sur Internet est considérée comme leur propre arrière-cour par les géants de l'IA d'Internet, ils l'utiliseront sans raison pour former l'intelligence artificielle, je pense que beaucoup de gens se sentiront "mal à l'aise" que leur domaine personnel ait été violé à partir de rien, ils adoptent donc une attitude plus prudente à son égard .

Les utilisateurs ordinaires ne sont pas les seuls concernés par ce problème. Elon Musk a récemment annoncé que Twitter allait « temporairement limiter » le nombre de tweets lus quotidiennement par les utilisateurs : les comptes non vérifiés ne peuvent voir que 600 tweets par jour, pour les nouveaux comptes non vérifiés, seulement 300. les entrées peuvent être vues par jour. Les comptes vérifiés sont limités à 6000 publications par jour.

Musk a déclaré que c'était parce que des centaines d'organisations (y compris certaines sociétés d'IA) grattaient les données de Twitter afin que cela affecte l'expérience des vrais utilisateurs.

C'est juste que le rugissement du train de l'époque suffit parfois à étouffer le bruit dissident des passagers.

Si la décision de Google est légale et conforme, et que les géants de l'IA emboîtent le pas, peut-être qu'un jour, nous trouverons tous des traces de notre propre existence dans l'intelligence artificielle générative.

#Bienvenue pour suivre le compte public WeChat officiel d'Aifaner : Aifaner (WeChat ID : ifanr), un contenu plus excitant vous sera présenté dès que possible.

Ai Faner | Lien d'origine · Voir les commentaires · Sina Weibo