Grosse mise à jour pour le géant de la vidéo IA ! Vous n’avez pas besoin de travailler dur pour écrire les mots d’invite. Il n’y a jamais eu de telle façon de créer des vidéos.

Dans quelle direction les vidéos IA peuvent-elles être diffusées ? La réponse de Luma AI est un peu différente. L'adversaire pratique toujours un mouvement après l'autre, mais c'est comme si Feng Qingyang enseignait Dugu Nine Swords. Il fait attention à la flexibilité et peut faire ce qu'il veut, comme des nuages qui coulent et de l'eau qui coule.

Luma AI n'est peut-être pas aussi connu que Keling et Runway, mais il est également au premier échelon en termes de force. Son modèle vidéo s'appelle Dream Machine. Il a été publié en juin de cette année. , ce qui constitue la plus grande dynamique depuis le lancement du produit.

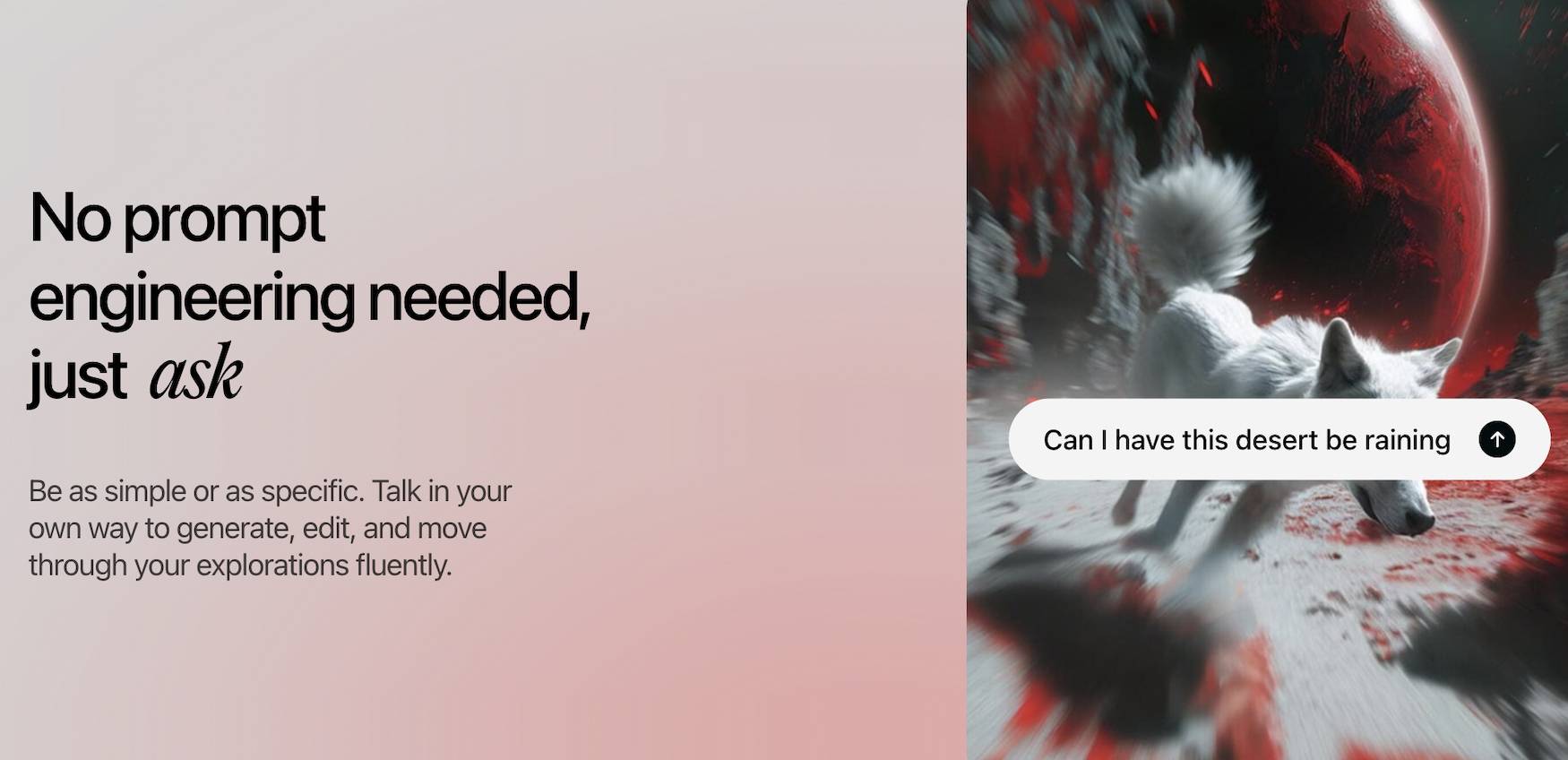

Il comprend deux mises à jour : l'une est la sortie de son propre modèle d'image Luma Photon, qui combine du texte, des images et des vidéos en un seul endroit ; l'autre est la création d'un nouveau flux de travail pour générer des vidéos IA. comme discuter avec ChatGPT sans avoir à réfléchir attentivement aux mots d'invite.

Dream Machine a été le pionnier d'une toute nouvelle façon de générer des vidéos.

guider le chemin  https://dream-machine.lumalabs.ai/

https://dream-machine.lumalabs.ai/

Pendant la conversation, la vidéo a été générée.

Lorsque nous ouvrons Dream Machine, la première chose que nous voyons est le « Tableau », qui peut être compris comme une toile créative infinie. Ici, nous utilisons le langage naturel pour générer librement des images ou des vidéos.

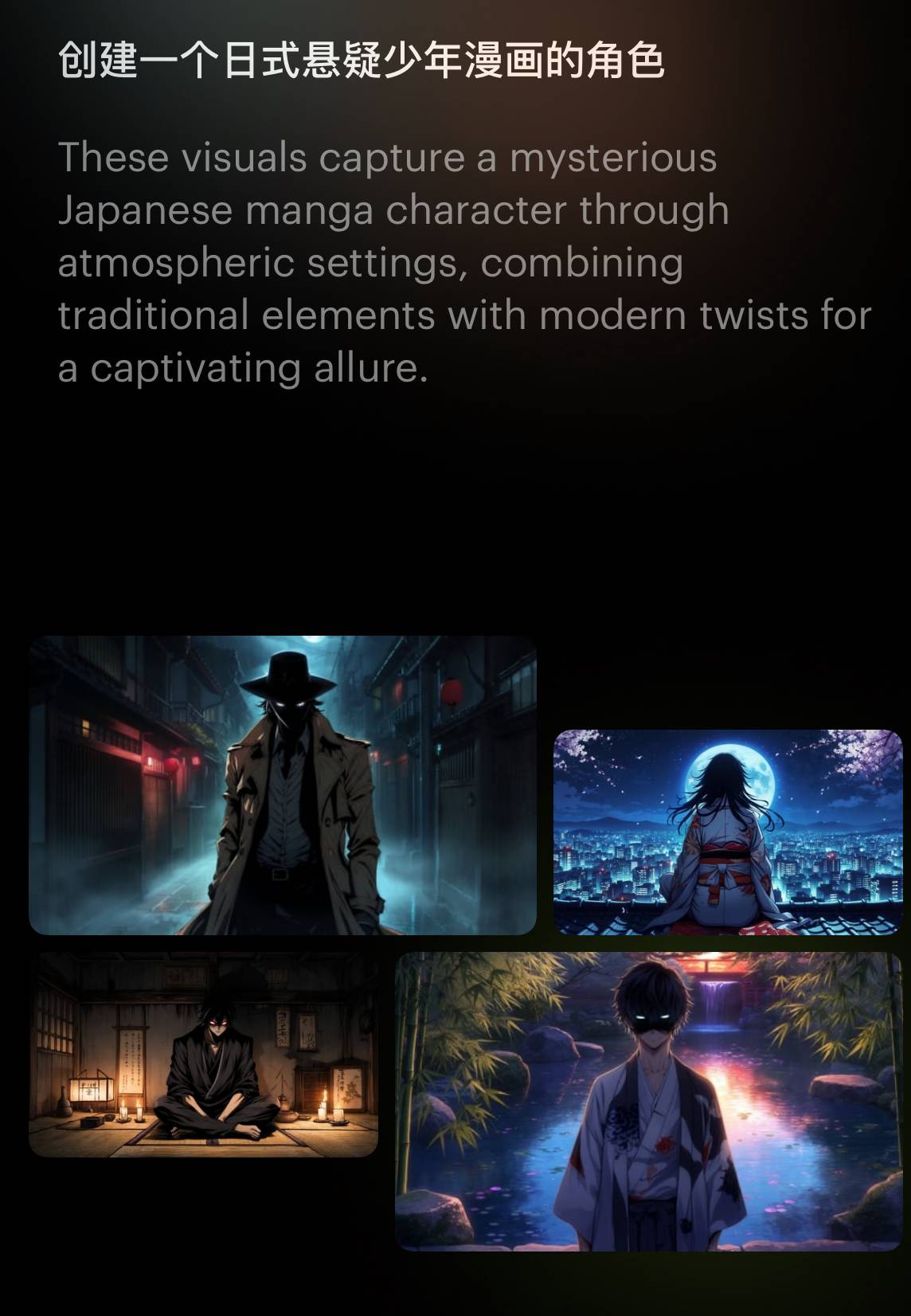

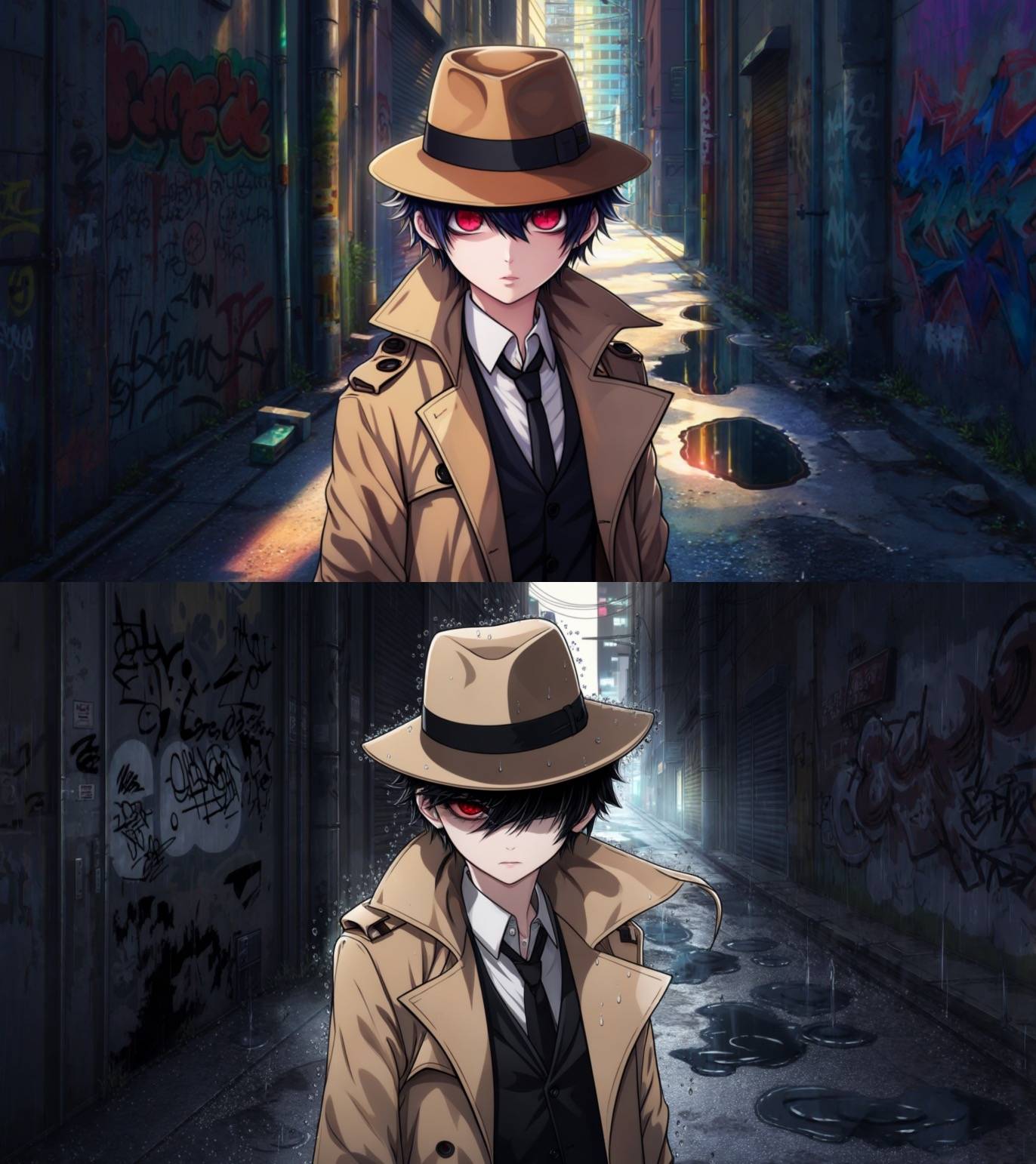

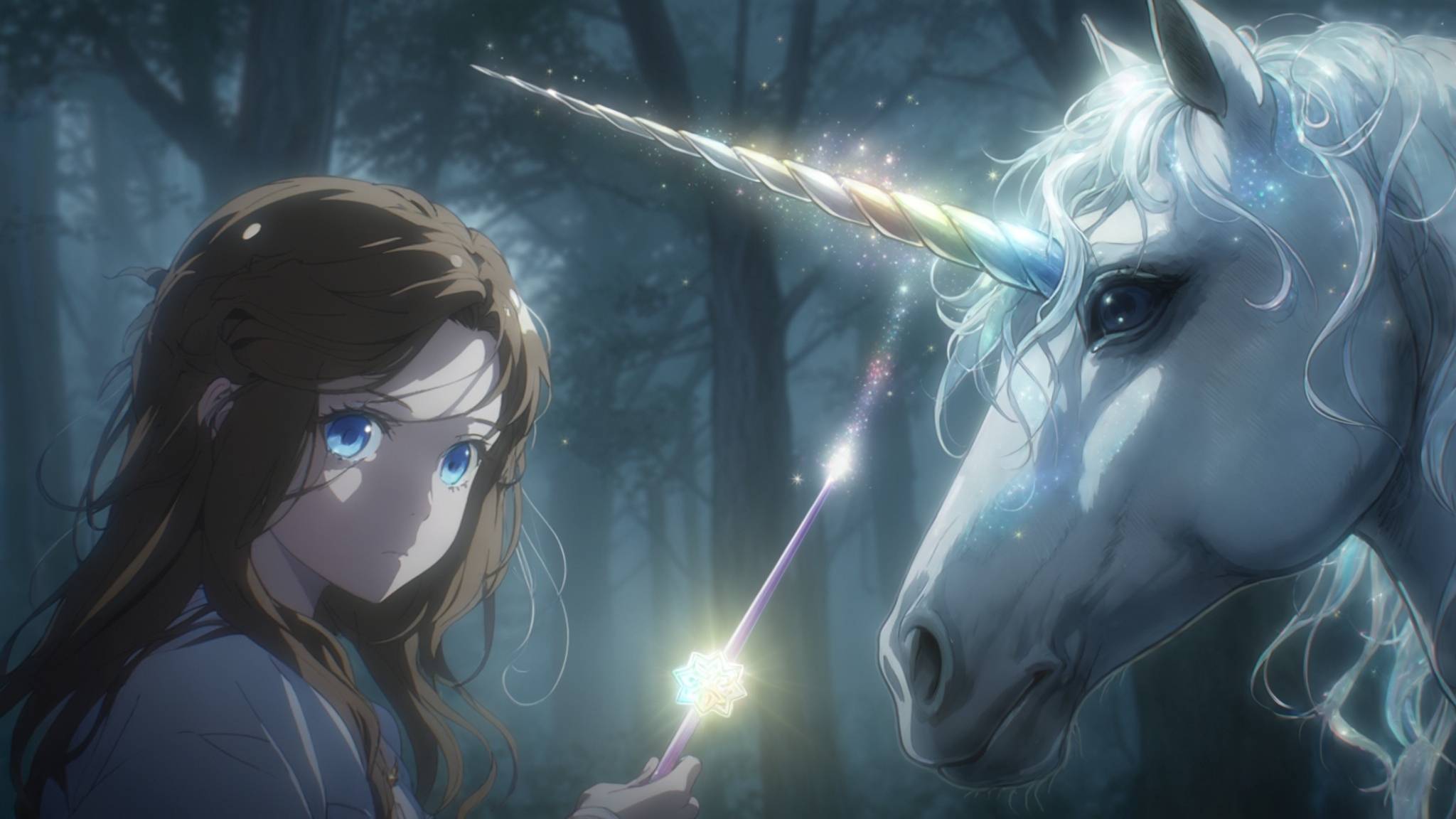

Lorsque j'ai commencé un tableau, mon message était très simple : "Créez un personnage de bande dessinée japonaise à suspense".

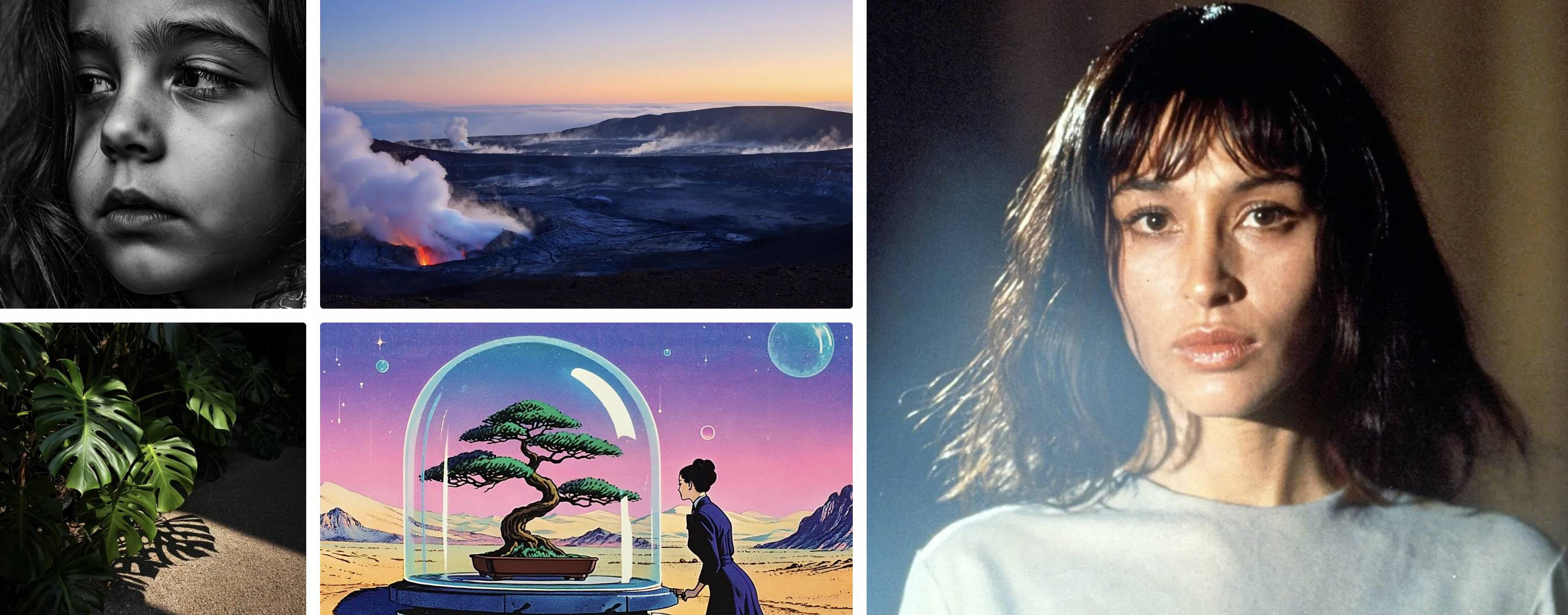

L'IA a élargi mes mots d'invite et généré 4 images à la fois, mais cela n'a pas fonctionné, l'heure n'était pas correcte.

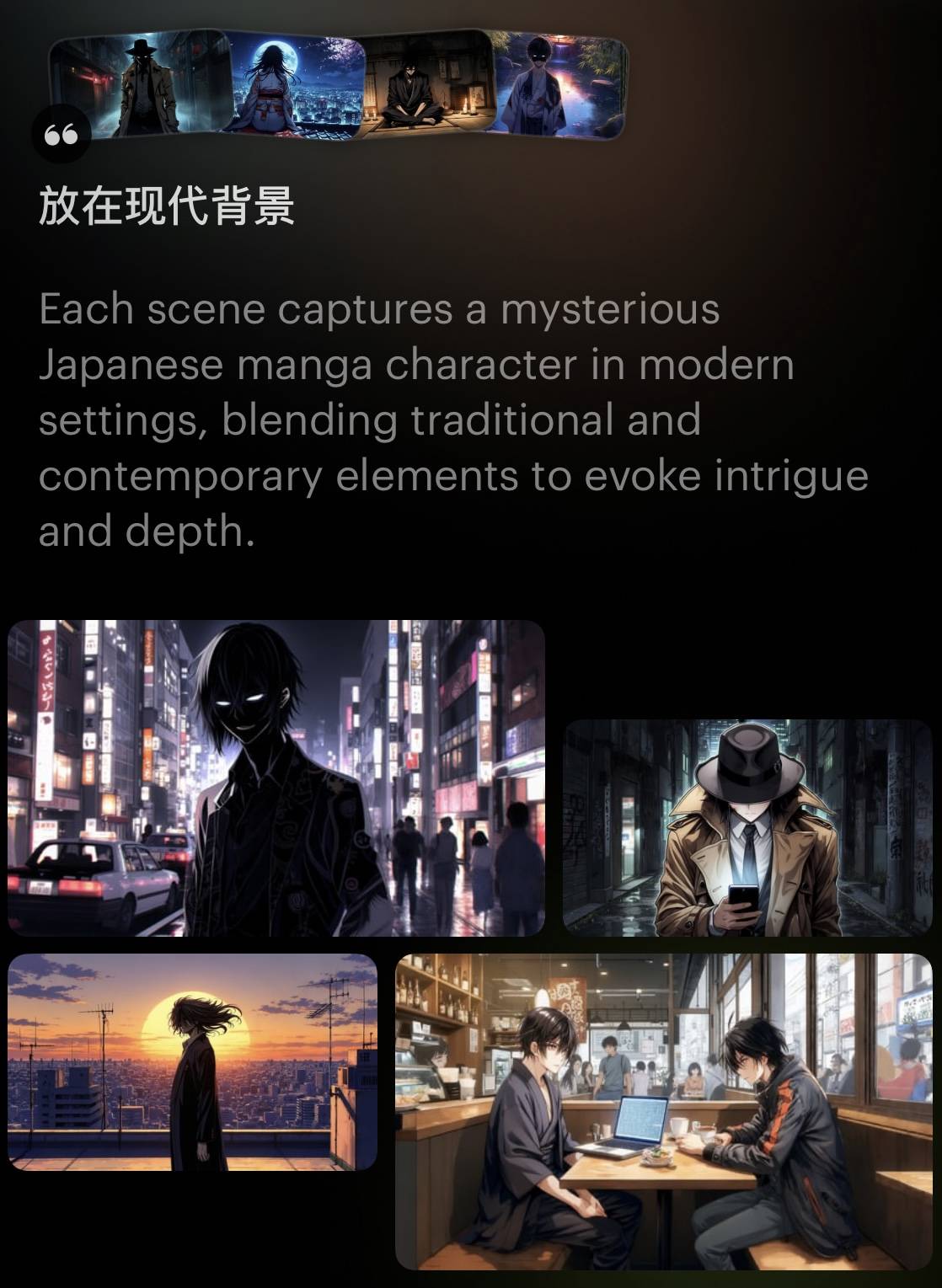

Ce n'est pas grave, entrez simplement une autre phrase dans la boîte de dialogue, "Placez-le sur un arrière-plan moderne".

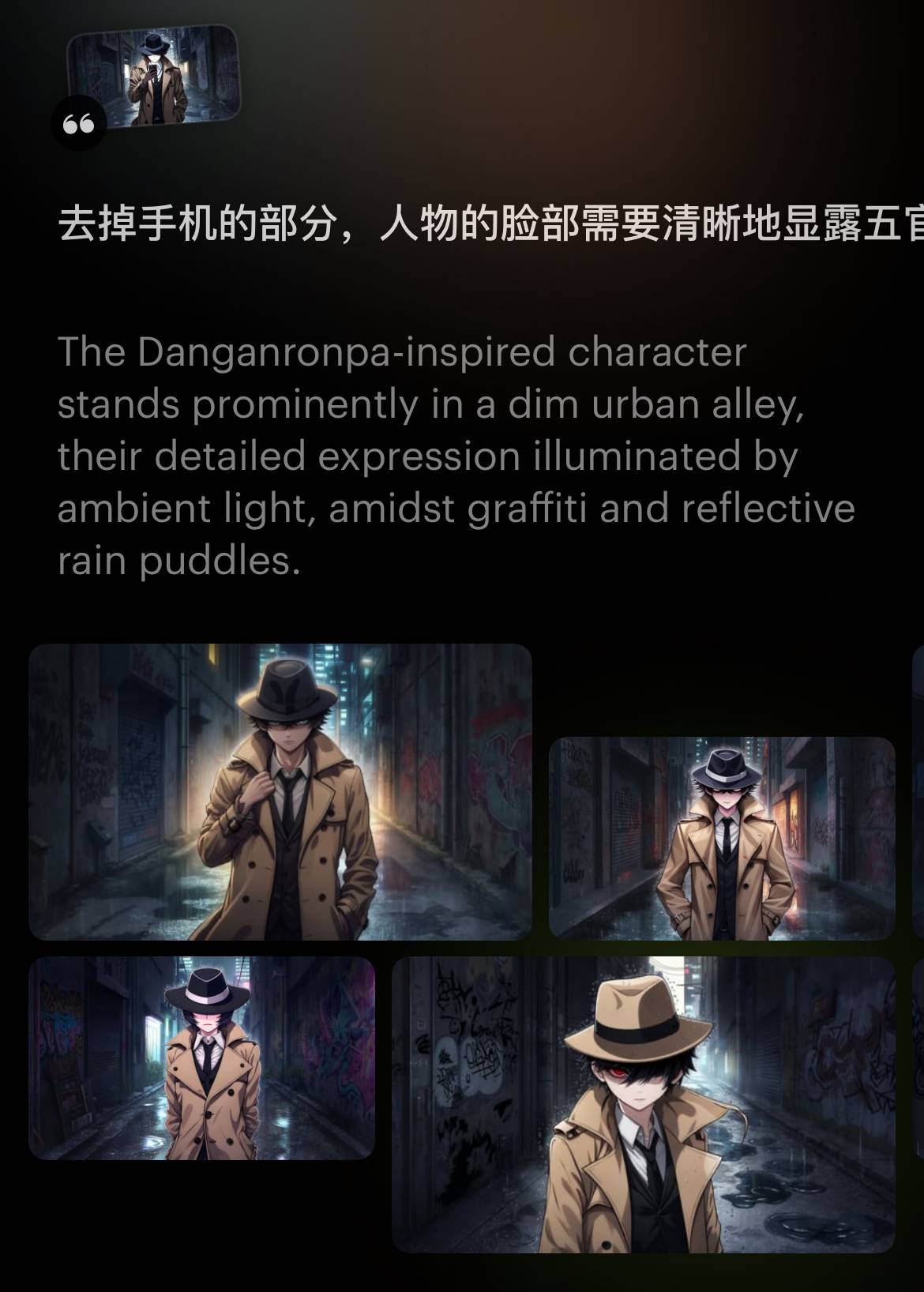

AI a dit avoir compris et a généré 4 photos supplémentaires. Celle en haut à droite, marchant seul dans une ruelle sombre, est proche du sentiment que je souhaite, mais ce n'est toujours pas suffisant. Je veux qu'il lève la tête et révèle la sienne. traits du visage.

Ce n'est pas difficile, continuez simplement à peaufiner, oubliez les mots d'invite compliqués et jouez simplement avec l'IA.

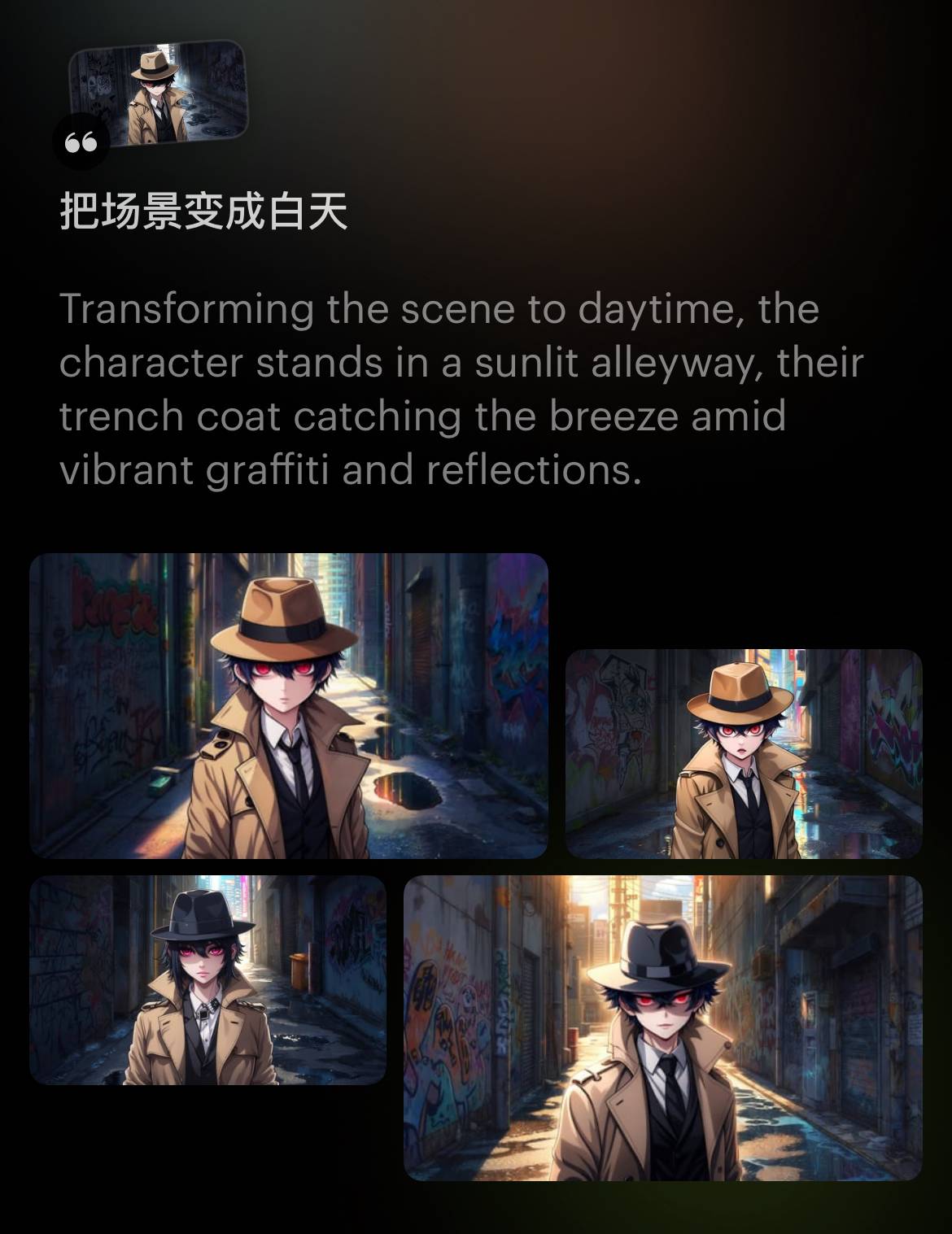

Celui en bas à droite est bon, même si l'image est un peu enfantine. Ensuite, je souhaite que l'IA génère une vidéo du protagoniste marchant de jour comme de nuit dans la même ruelle.

La fonction de Dream Machine consistant à générer les première et dernière images de la vidéo est préparée pour ce besoin – nous sélectionnons la première et la dernière image et laissons l'IA terminer le processus intermédiaire.

Ensuite, il suffit de laisser l'IA générer quelques scènes de jour basées sur les images dont nous sommes satisfaits, et la méthode de communication est toujours la même, simple et grossière. Les deux photos finalement sélectionnées présentent des détails légèrement différents, mais elles sont dans le même cadre.

Tout est prêt, il ne reste plus qu'à générer la vidéo, et la transition IA se fait tout naturellement.

À ce stade, vous devez comprendre la différence entre Dream Machine et les autres outils vidéo.

D'autres outils vidéo vous proposent généralement une zone de texte pour remplir un mot d'invite, puis vous permettent de définir des paramètres tels que le mouvement et la durée de la caméra. Définir une fois, générer une fois.

Mais l'interface de Dream Machine ressemble beaucoup à une interaction avec un chatbot. En bas se trouve une zone de saisie, dans laquelle les images de Vincent, les images de Tush, les vidéos de Tush et les vidéos de Vincent peuvent toutes être exécutées.

Les créateurs professionnels peuvent continuer à écrire des mots d'invite traditionnels, mais nous avons également le droit de « prononcer des mots humains ». La pression est exercée sur l'IA pour comprendre le contexte et nous aider à améliorer les mots d'invite. idée approximative, discuter avec elle tout en apportant des modifications et en optimisant.

Et comme Dream Machine se présente sous la forme d’une toile infinie, nous pouvons la générer à plusieurs reprises au cours d’une session, et les matériaux seront conservés et ne se recouvriront pas.

Notre réflexion ne se limitera pas à un mot ou à une vidéo, mais coulera comme de l'eau. D'autres idées pourront être générées au cours de ce processus.

Des images plus contrôlables, des vidéos plus contrôlables

Le nouveau flux de travail de Dream Machine est comme le tronc d'un grand arbre, et certaines de ses fonctionnalités amusantes et pratiques sont comme des branches qui se complètent et prospèrent.

Ce qui joue un rôle clé est Luma Photon, le dernier modèle d'image publié par Dream Machine.

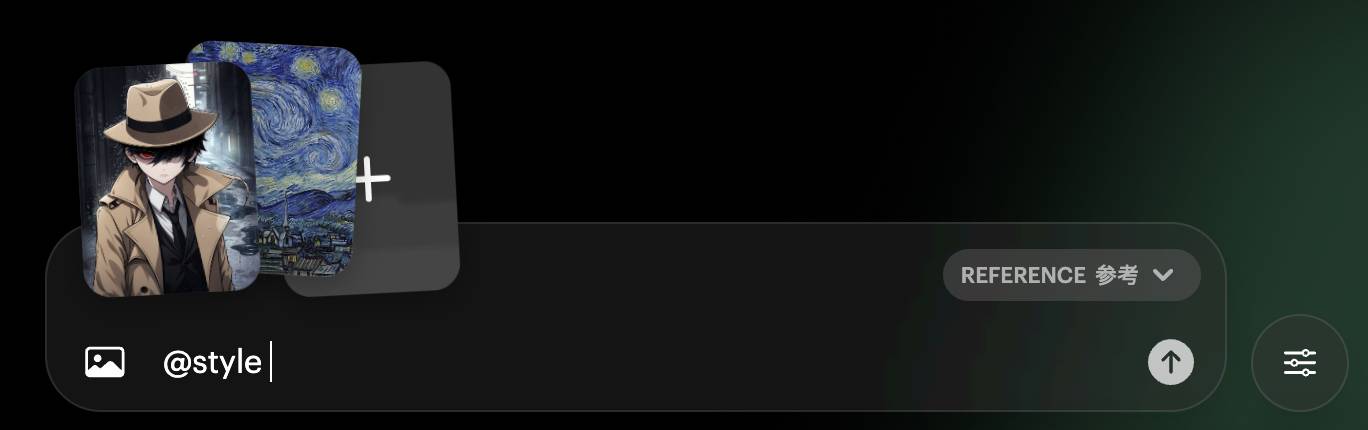

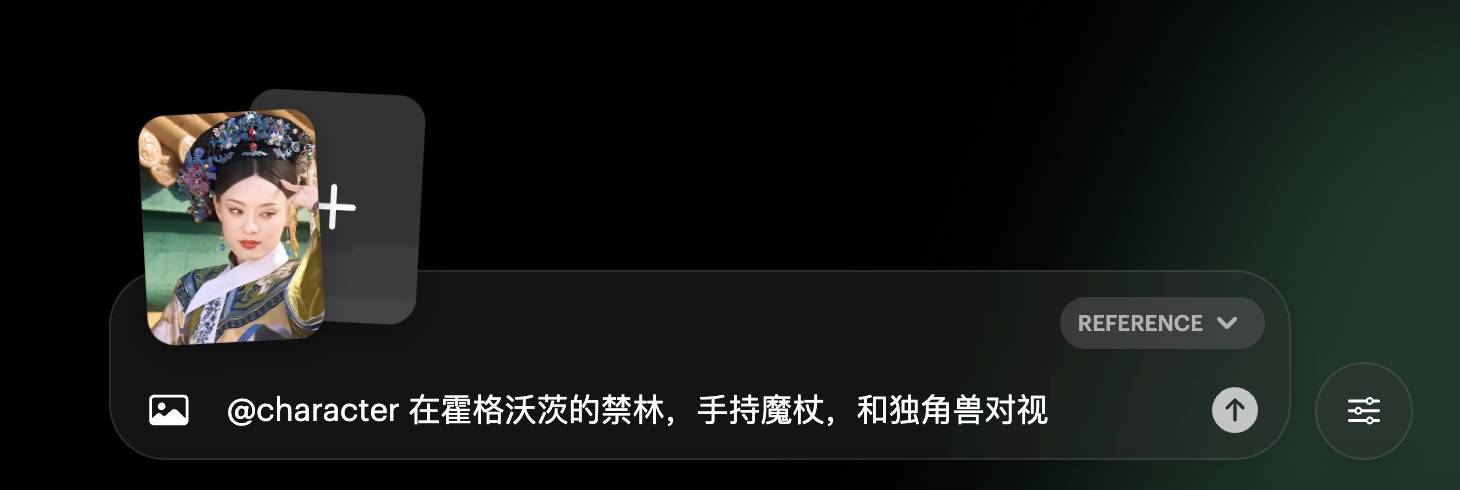

Comment générer des images plus conformes à notre esthétique ? Dream Machine prend en charge les fonctionnalités de référence de style et de référence de caractère.

Parlons d’abord de la référence de style. Nous pouvons importer nos propres images, et l’IA intégrera le style dans la création. Le responsable a donné un exemple : générer une version oiseau de « La Fille à la perle » dans le style de Mondrian.

Suivez cette idée et créez une détective féminine basée sur l'image d'un détective masculin et le style de la "Nuit étoilée" de Van Gogh.

Quand la seconde dimension rencontre le postimpressionnisme, la réaction chimique est merveilleuse.

La fonction de référence de personnage peut obtenir la cohérence du personnage à travers une seule image, afin que le personnage puisse apparaître dans plus d'images et de vidéos.

Musk est une bibliothèque de matériaux ambulante. Cet exemple est trop simple. J'ai décidé de laisser Zhen Huan se téléporter dans le monde de Harry Potter pour voir si elle pouvait encore avoir une aura de 2,8 mètres après le changement de scène.

Le résultat est un peu difficile à commenter. On voit qu'il s'agit du visage de Zhen Huan, mais l'apparence de l'impératrice suit les coutumes locales et ses traits du visage, en particulier ses yeux, sont devenus plus européens et américains.

En fait, sans chercher de références d'images supplémentaires, Dream Machine peut également empêcher que des images et des vidéos ne soient perdues pour tout le monde. À ce stade, vous devez utiliser la fonction « brainstorming ». Elle recommandera les styles de certains artistes en fonction des images. vous générez.

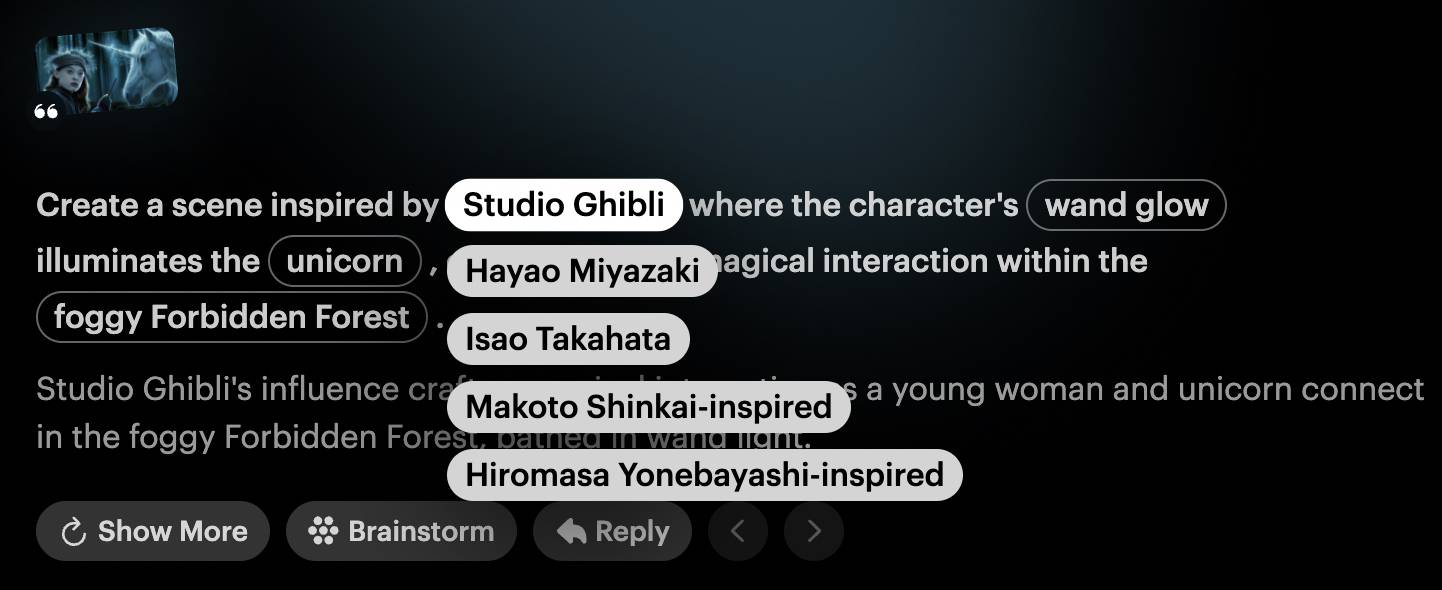

Tout comme la scène où Zhen Huan entre à Poudlard, nous pouvons la recréer dans le style Studio Ghibli.

De plus, certains mots-clés dans les mots d'invite sont encadrés et peuvent être remplacés par des options déroulantes. Dream Machine les appelle « pilules conceptuelles ». Nous n'avons pas besoin d'écrire nous-mêmes les mots d'invite et pouvons modifier le style artistique. ou des éléments d'image en un seul clic.

Il suffit de quelques clics pour remplacer « Ghibli » par « Shinkai Makoto » et « Licorne » par « Dragon ».

Le modèle Luma Photon est construit sur la base de l'architecture universelle Transformer de Luma. En développant son propre modèle d'image, Luma AI peut réduire sa dépendance à l'égard de modèles d'image externes tels que Midjourney, tout en résolvant le problème d'instabilité des vidéos de Vincent.

Bien entendu, la vidéo est la spécialité, et Dream Machine est également indispensable pour les fonctions contrôlables telles que le mouvement de la caméra.

Zhen Huan dans la Cité Interdite et Zhen Huan à Poudlard pourront-ils réaliser une transition en douceur ? Grâce à l'objectif zoom, l'image est dynamique et les personnages ne sont pas sérieusement déformés. On peut obtenir 80 points.

Pensée visuelle, narration

Par coïncidence, Runway a également officiellement annoncé son modèle de génération d'images Frame il y a deux jours, le même soir que la mise à jour Luma. En regardant la démonstration, vous pouvez voir qu'il accorde une grande attention à l'esthétique et ouvre actuellement progressivement les qualifications aux Gen-. 3Alpha.

▲ Cadre de piste

La qualité de la génération d'images, la hauteur esthétique, ainsi que la cohérence et la contrôlabilité du style visuel sont de plus en plus valorisées par les modèles visuels.

C'est une bonne chose pour les créateurs. Lorsque nous utilisons l'IA pour la conception graphique et la définition des personnages, nous générons en réalité un monde unique et racontons une histoire unique.

Cristóbal Valenzuela, PDG de Runway, estime que Runway n'est pas une entreprise d'IA, mais une entreprise de médias et de divertissement, et que l'ère des entreprises d'IA est révolue.

Il ne dénigre pas l’IA. Au contraire, il estime que l’IA est une sorte d’infrastructure. La véritable révolution ne réside pas dans la technologie elle-même, mais dans ce qu’elle réalise : de nouvelles formes d’expression, de nouvelles façons de raconter des histoires et des connexions qui en découlent. connecter l'expérience humaine. Cela coïncide avec la direction évolutive de Luma.

Après cette mise à jour, Amit Jain, PDG et co-fondateur de Luma AI, a donné à Dream Machine une définition intéressante : un partenaire de pensée visuelle.

Le concept est un peu abstrait, mais ce qu'il entend en réalité, c'est créer des créations visuelles telles que des images et des vidéos aussi simples et intuitives qu'un chat.

La façon dont nous interagissons affecte notre façon de penser. Le flux de travail de type canevas peut visualiser des idées, enregistrer tous les processus et résultats créatifs et présenter des idées complètes pour générer des vidéos.

Le canevas infini est généralement plus courant dans les modèles d'image, tels que Recraft et Ideogram's Canvas. La toile de Dream Machine est plus régulière, avec des matériaux et des variations générés par les mêmes mots-invites disposés horizontalement et différents disposés verticalement.

Le processus de discussion, de génération et d'optimisation donnera aux gens l'impression qu'un petit monde indépendant était né dans la toile.

Laissez d’abord Dream Machine utiliser un style CG de film hyper-réaliste pour créer le protagoniste d’un jeu avec un arrière-plan de friche industrielle.

Utilisez ensuite un plan surround pour animer le protagoniste et créer une impression d'espace dans l'environnement.

Ensuite, nous pouvons discuter avec l'IA et laisser l'IA continuer à générer diverses scènes intérieures et extérieures dans le monde des friches, et laisser l'IA suggérer comment nous pouvons le rendre plus apocalyptique.

D’une certaine manière, cette toile est le décor de nos histoires personnelles.

Bien sûr, Luma AI présente également de nombreux bugs, notamment le fait que l'utilisation d'une image pour obtenir la cohérence des personnages n'est pas idéale ; les points sont comme l'eau courante, et les images et les vidéos doivent toujours être dessinées à plusieurs reprises, le modèle d'image peut générer des images précises ; Anglais, mais je ne parle pas chinois…

Mais le sens est bien transmis : parlez moins de paramètres, utilisez l'interaction comme point de départ et créez un outil de création d'IA.

Un meilleur modèle vidéo offre non seulement une vitesse de génération plus rapide, des mouvements de caméra plus contrôlables et une esthétique plus unique, mais il devrait également offrir une meilleure façon de raconter des histoires, permettant d'utiliser le texte, les images et les vidéos comme outils d'expression d'idées.

Machine à rêves, machine à rêves.

Créez simplement, comme l'a dit Luma AI : « Il n'est pas nécessaire d'écrire des mots d'invite compliqués, il suffit de demander. » Les questions que nous laissera l'IA à l'avenir ne concernent plus la technologie, mais ce que nous l'utilisons pour construire.

# Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (ID WeChat : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo