Le « Pape de la mode » balaie l’écran, l’événement de fausse image de l’IA enregistré dans l’histoire, comment survivons-nous à l’IA folle

Dans le drame britannique à suspense "Truth Capture", les agences de renseignement ont falsifié des vidéos de surveillance afin de condamner les criminels.

Ils croient que la falsification des vidéos de surveillance ne fait que "reconstituer" des preuves illégales telles que des écoutes téléphoniques dans des preuves légales.La chose s'est réellement produite et le criminel a commis un crime.

Mais personne ne sait si les personnes qui utilisent la technologie franchiront la ligne. Après tout, il n'y a qu'un pas loin de la nature humaine, de l'intégration de fleurs et d'arbres à la création de quelque chose à partir de rien, de la cible à la falsification gratuite.

Lorsque la cartographie de l'IA progresse rapidement, un tel monde n'est peut-être pas loin de nous.

Trump et le pape s'affrontent pour rafraîchir l'écran, tout cela grâce à la magie de l'IA

La semaine dernière, des dizaines de photos de l'arrestation de Trump sont devenues virales sur Twitter. Vie.

Cependant, ce ne sont que des images générées par l'IA.

Le compte de l'instigateur Eliot Higgins a été fermé dans la salle noire (maintenant revenu à la normale), et le mot "arrêté" a été bloqué par la plateforme.

Au cours du week-end, c'était à nouveau le tour de Twitter @skyferrori, amenant le pape François dans une doudoune inspirée de Balenciaga .

Certaines personnes ont dit que c'était un style rap, un style DJ, et on dirait qu'un album est sur le point de sortir.

Ce tweet a été vu plus de 26 millions de fois et retransmis plus de 30 000 fois, ce qui a trompé de nombreuses personnes. La description des "images générées par l'IA" a été ajoutée ultérieurement au bas de l'image.

Certains internautes de Twitter pensent que cet incident est le premier cas de désinformation à grande échelle de l'IA, qui peut être enregistré dans l'histoire.

D'autres imitations ont suivi.

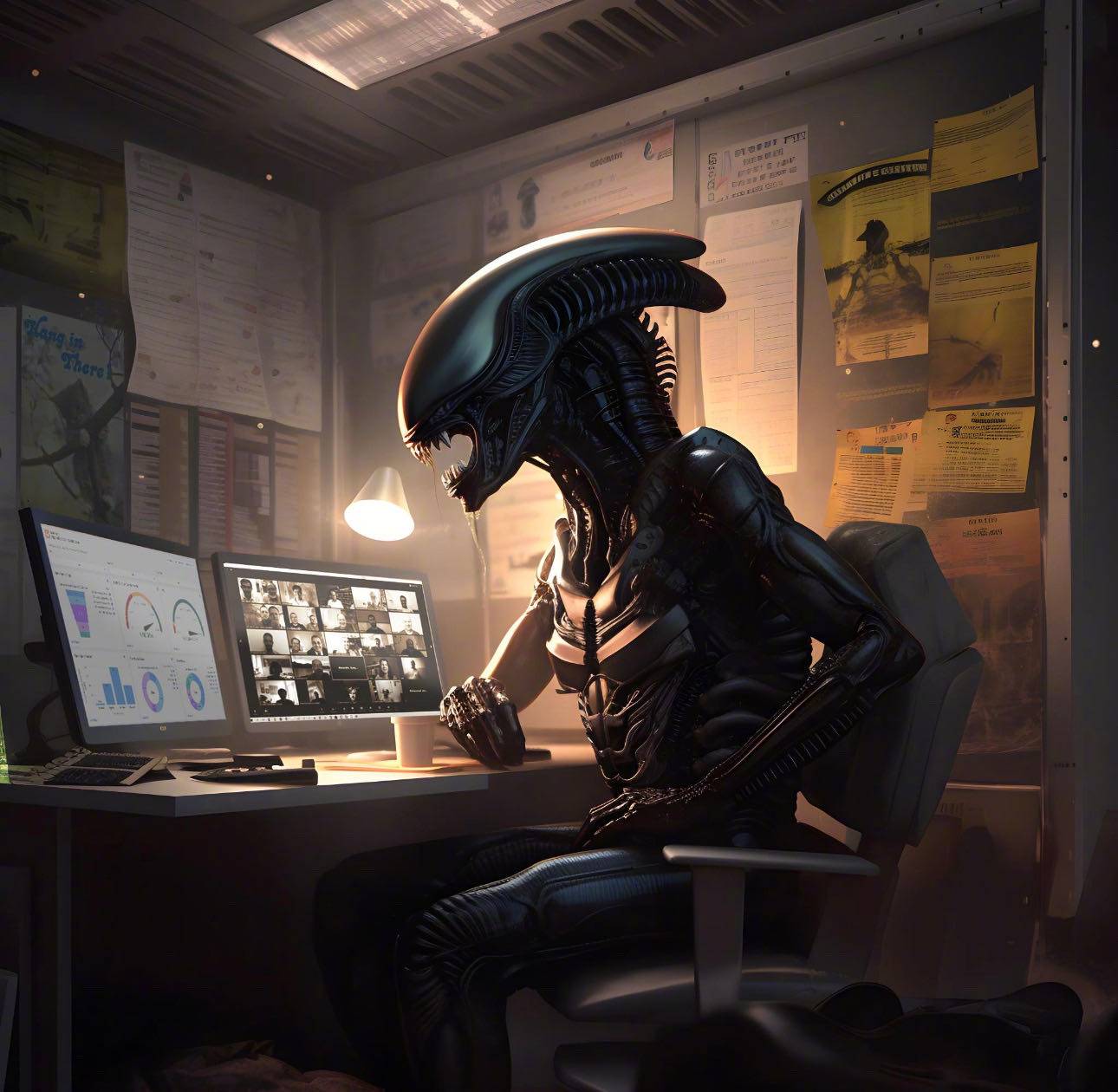

Trump est allé à la campagne pour retrouver un emploi, tirant un pousse-pousse dans la rue ; le pape s'est changé en doudoune et est allé vers les étoiles et la mer ; l'extraterrestre a connu la vie, est allé travailler une journée puis s'est saoulé tard la nuit…

La plupart de ces photos de célébrités du monde parallèle proviennent de la version de l'outil de peinture AI MidJourney V5.

Le modèle de la version V5 peut générer des images de meilleure qualité et plus réalistes que la version V4, et a plus d'options de personnalisation et une vitesse de rendu plus rapide. C'est l'un des outils de dessin d'IA de plus haut niveau à l'heure actuelle.

Le point le plus intuitif est qu'il résout essentiellement le problème que l'IA ne pouvait pas bien dessiner les doigts auparavant, et les humains ont perdu une autre façon de distinguer le vrai du faux. (Au fait, la version V1 sortira en juillet 2022, ce qui montre la vitesse d'itération rapide)

Il n'est pas difficile de saisir l'invite (mots d'invite).Le nom d'une certaine célébrité, ainsi que des actions, des lieux, etc., peuvent former une image.

Il y a aussi beaucoup d'images ci-dessus qui sont "fausses en un coup d'œil", et il y aura des versions plus avancées qui sont plus éblouissantes.

La semaine dernière, cette photo d'un couple chinois générée par Midjourney est devenue virale sur Internet.

Il y a quelques jours, les internautes de Reddit ont publié une série d'images d'actualité , enregistrant le tremblement de terre et le tsunami de magnitude 9,1 qui se sont produits à Cascadia sur la côte ouest de l'Amérique du Nord en 2001.

Vous pouvez voir tous les angles de couverture de la catastrophe : la destruction des maisons sur les lieux, les vagues déferlantes, les expressions terrifiées des personnes bloquées à l'aéroport, les sauveteurs essayant de sauver les survivants piégés des décombres et les journalistes se précipitant pour diffuser en direct .

Le ton, la robe et la scène de l'ensemble des photos ont tous le goût du début du siècle. Certaines d'entre elles ont l'air "amateur", comme si elles avaient été prises par des riverains, mais de telles photos sont souvent considérées comme des informations précieuses.

Cependant, cet ensemble d'images a également été généré avec Midjourney, et la catastrophe n'existait pas.

De même, l'internaute Arctic_Chilean a simulé l'événement " Supertempête solaire et panne d'électricité aux États-Unis en juillet 2012" . points de repère, mais n'a pas pu générer une scène d'une panne de courant dans la ville.

Un autre internaute, FinewithIX , a utilisé l'IA pour générer les images des coulisses de l'alunissage en 1969 , imitant le style de film plus granuleux de l'époque.

Ce genre d'images d'actualité réalistes n'a pas les caractéristiques personnelles distinctives de Trump et du pape, mais vous êtes plus susceptible d'être fasciné.

De Deepfake à Cheapfake

@skyferrori, qui a créé le "Fashion Pope", a été interviewé par les médias après la projection de l'œuvre.

Un ouvrier du bâtiment de 31 ans de la région de Chicago, il utilise Midjourney sans but, sans rancune envers le pape, juste pour s'amuser.

La popularité inattendue lui a fait comprendre tardivement la large influence de l'IA. Des personnes avec des arrière-pensées ont même pris ces photos pour accuser l'Église catholique d'extravagance et de gaspillage.

Je n'avais pas pensé à ça avant. C'est absolument terrifiant que les gens l'acceptent, pensent que c'est réel et ne le remettent pas en question.

La plupart des joueurs actuels ne font que s'amuser, mais comme les preuves falsifiées et la justice procédurale explorées dans "Truth Capture", nous ne savons pas quand la frontière est franchie et où se trouve le point final.

Dans la plupart des cas, la pornographie, la politique et les rumeurs viennent toujours en premier. Une photo d'une femme dans le métro a été déshabillée par l'IA en un clic, et c'est devenu une recherche à chaud sur Weibo aujourd'hui, mais les auteurs étaient cachés derrière l'IA. Quand le moment et le lieu sont bons, comment les gens ordinaires peuvent-ils faire la différence par eux-mêmes.

La vitesse à laquelle le clonage vocal se développe est tout aussi effrayante.

Les escrocs utilisent l'IA pour imiter la voix des membres de la famille de l'autre partie et passer des appels frauduleux pour extorquer de l'argent. Plusieurs cas de ce type se sont produits aux États-Unis.

La technologie du clonage de la voix n'est pas rare, le problème est que le seuil devient de plus en plus bas. Comme le dit Hany Farid, professeur à l'UC Berkeley :

Il y a deux ans, peut-être même un an, le clonage d'une voix humaine nécessitait beaucoup d'audio. Maintenant, si vous avez une page Facebook, ou si vous enregistrez un TikTok et que votre voix dure 30 secondes, les gens peuvent cloner votre voix.

Ils deviennent même moins chers.Par exemple, la technologie de clonage de la voix d'ElevenLabs ne sortira pas avant 2022, et le coût des services associés n'est que de 5 $ par mois.

Avec la voix et les images, il est également possible de générer des vidéos entièrement avec l'IA. Quelqu'un a utilisé ChatGPT pour générer du contenu vocal, Midjourney pour générer des avatars, ElevenLabs pour générer des voix et D-ID pour générer des vidéos de synchronisation labiale, et a réalisé une courte vidéo complète.

L'AS-tu trouvé? Nous pouvons toujours nous demander si une certaine image ou une certaine vidéo est réelle ou non, mais au cœur du problème se trouve la vitesse à laquelle elles ont évolué.

Deepfake changeant de visage (deep forgery) a un certain seuil technique, mais maintenant, si vous êtes prêt à passer du temps à démarrer avec un logiciel d'IA, à apprendre à écrire les mots rapides des autres et à vous abonner à un membre plus au maximum, le coût de la contrefaçon est déjà plus faible qu'auparavant.

Ensuite, ils se sont largement répandus sur les réseaux sociaux tels que Twitter, Reddit, TikTok, etc.

Certains l'appellent "Cheapfakes" (contrefaçon bon marché), ce qui est approprié compte tenu du coût de production et de diffusion.

The Verge a fait un point : l'IA n'était qu'une fonctionnalité, et maintenant elle devient progressivement un produit.

C'est un peu comme lorsque Jobs installait une souris et un système d'exploitation à interface graphique sur un ordinateur Macintosh, et connectait un écran tactile multipoint à un smartphone pour pouvoir décoller.

Dans le passé, nous disions souvent qu'il n'y a pas de vérité sans images, mais dans un avenir proche, les images ne seront plus la vérité, et les vidéos ne seront peut-être pas la vérité. Elles ne prouveront rien.

Comment survivre à l'avenir de la technologie

Face à la technologie, la sensibilisation et la loi sont toujours légèrement en retrait. Est-il encore temps de rattraper les lacunes déjà apparues ?

Les entreprises fournissant des services d'IA seront naturellement en première ligne.

Fin janvier de cette année, parce que trop d'utilisateurs utilisaient le clonage vocal pour se conduire mal, l'outil vocal d'IA ElevenLabs a annoncé l'introduction de nouvelles mesures de protection , dont les deux plus importantes sont :

Présentation de nouveaux outils de détection d'IA pour vérifier qu'un clip audio a été généré à l'aide de leur technologie ;

Rendre certaines fonctions uniquement payantes, en réduisant l'anonymat des utilisateurs, afin qu'ils "réfléchissent à deux fois" ;

Les médias sociaux trouvent également des moyens de réduire la propagation de la désinformation.

TikTok a annoncé la semaine dernière que tous les Deepfakes montrant des scènes réelles doivent être marqués comme faux (faux) ou modifiés (altérés), et que les Deepfakes de personnalités publiques ne doivent pas être utilisés à des fins politiques ou commerciales.

En fait, les fausses images, les fausses voix et les fausses vidéos existent depuis longtemps, il y a eu d'innombrables discussions et disputes auparavant, mais jusqu'à aujourd'hui, elles sont devenues un véritable problème.

En 2020, Adobe a publié la "Content Authenticity Initiative" (CAI) , dans l'espoir de créer un système qui attache en permanence la source et les détails aux images avec des signatures cryptographiques, et est toujours en cours de développement .

Chaque fois que quelqu'un télécharge, prend une capture d'écran, modifie une image, la balise de métadonnées CAI indiquera qu'elle a été traitée.

Cela semble très utile et peut également être utilisé dans les travaux d'IA.

Mais Adobe a également souligné que de nombreux supports matériels et logiciels sont nécessaires pour que le système fonctionne efficacement, notamment des caméras prenant en charge le marquage, des outils de retouche photo qui enregistrent les détails du traitement, des médias sociaux qui affichent des tags, etc.

Cela implique presque tous les maillons, de la production à la diffusion, et on conçoit à quel point c'est difficile.

Aujourd'hui, le dilemme de la contrefaçon d'IA est similaire. Tout comme les innombrables discussions sur Deepfake dans le passé, les entreprises technologiques, les organisations médiatiques et même chaque individu devraient assumer une part de responsabilité, mais c'est précisément la situation idéale qui est difficile à atteindre.

Après que le "Fashion Pope" soit sorti du cercle, Chrissy Teigen, mannequin aux près de 13 millions de fans sur Twitter, a déploré :

Je pensais que la doudoune du pape était réelle et je n'y ai pas prêté attention. Il n'y a aucun moyen que je survive à l'avenir de la technologie.

La vitesse à laquelle l'IA se développe a dépassé à la fois la sensibilisation du public et les lois et réglementations. On peut seulement dire que lorsque nous voyons une certaine image, il vaut mieux ne pas supposer qu'elle est réelle.

#Bienvenue pour prêter attention au compte public WeChat officiel d'Aifaner : Aifaner (WeChat ID : ifanr), un contenu plus excitant vous sera présenté dès que possible.

Ai Faner | Lien d'origine · Voir les commentaires · Sina Weibo