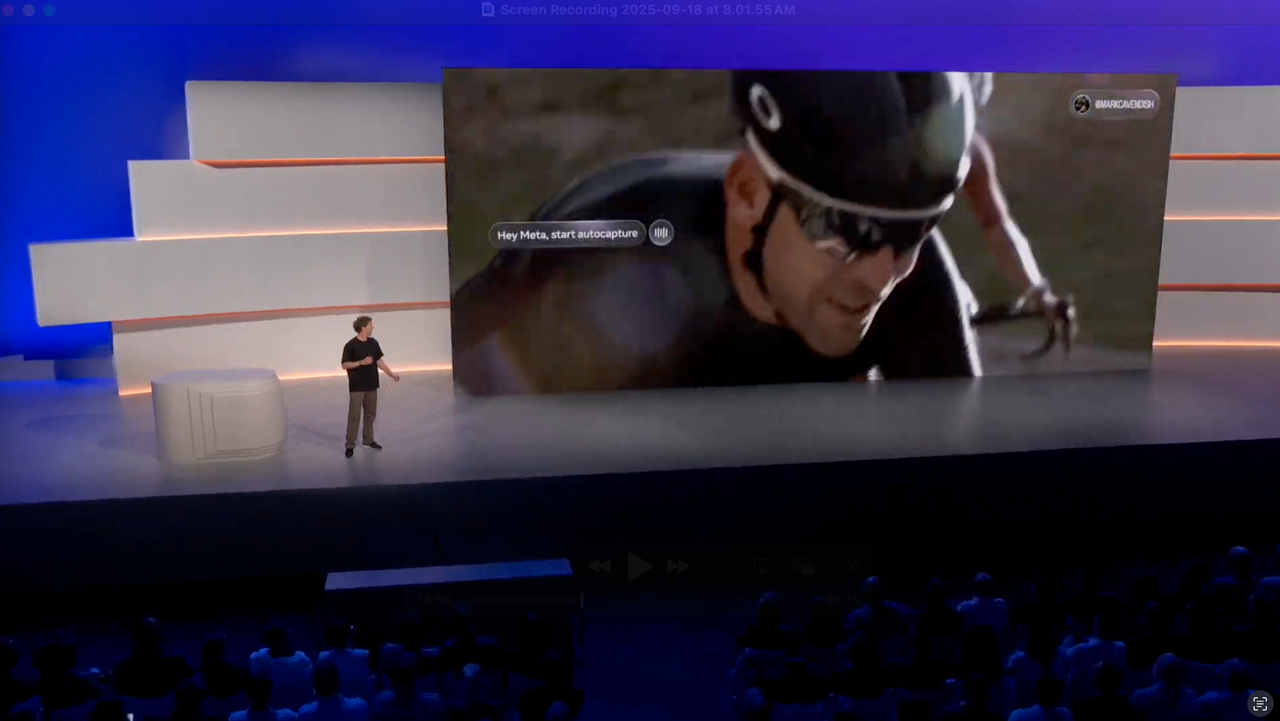

Les démonstrations de Zuckerberg ont échoué à plusieurs reprises, mais ce sont toujours les meilleures lunettes IA de 2025 Obtenez une démonstration pratique

Les produits technologiques les plus en vogue en 2025 seront naturellement des lunettes intelligentes capables de prendre des photos, d’enregistrer des vidéos et d’utiliser l’IA.

En tant que pionnier dans la catégorie (re-populaire) des lunettes intelligentes, Meta (anciennement FaceBook) nous a prouvé une chose avec ses ventes de millions de lunettes Meta Ray-Ban en deux ans :

Porter une caméra sur son visage devient peu à peu une nécessité pour les gens afin d’enregistrer leur vie.

Lors de la conférence Meta Connect 2025 qui vient de se tenir, Meta nous a présenté trois nouveaux produits. Parmi eux, non seulement les lunettes connectées Meta Ray-Ban de troisième génération, mais aussi un nouveau gadget dont on entend parler depuis longtemps :

Version de production Hyper Nova avec affichage guide de lumière couleur : Meta Ray-Ban Display.

Points clés :

- Meta Ray-Ban Display : les premières lunettes connectées Meta avec écran. Grâce à un affichage tête haute couleur et un bracelet Neural Band, elles transforment le concept d'« intelligence artificielle sur votre visage » en réalité. Prix : 799 $.

- Ray-Ban Meta (Gen 2) : Léger lifting, ce modèle est le modèle phare destiné au grand public. Il offre un look plus élégant, une autonomie et des capacités de prise de vue nettement améliorées, et son prix est de 379 $ US.

- Oakley Meta Vanguard : Conçue pour les sportifs et les passionnés d'informatique, elle présente un design en forme de masque, une caméra grand angle centrale, une longue autonomie, l'intégration des données sportives et même un voyant de rappel d'entraînement. Son prix est de 499 $.

- Hyperscape : en intégrant l'espace réel dans l'espace virtuel, les utilisateurs de Quest peuvent scanner la pièce pour générer une copie VR réaliste, mais il est toujours en version bêta.

Plus tard, à la conférence Meta Connect, @梦雅Myra, amie d'iFanr, vous fera découvrir les trois nouvelles lunettes connectées de cette année. Restez connectés pour les prochains articles.

Meta lance ses premières lunettes connectées avec écran ! Découvrez l'IA sur votre visage pour 799 $.

Sans aucun doute, le nouveau produit le plus attendu cette année sera les premières lunettes intelligentes de Meta avec écran.

Conformément aux rapports précédents, Meta a lancé une paire de lunettes intelligentes avec un petit HUD (affichage tête haute) sur l'œil droit : Meta Ray-Ban Display.

Bien que le nom soit un peu ennuyeux, Ray-Ban Display est sans aucun doute un produit révolutionnaire pour l'industrie des lunettes intelligentes (ou comme l'a dit Zuckerberg : des lunettes IA).

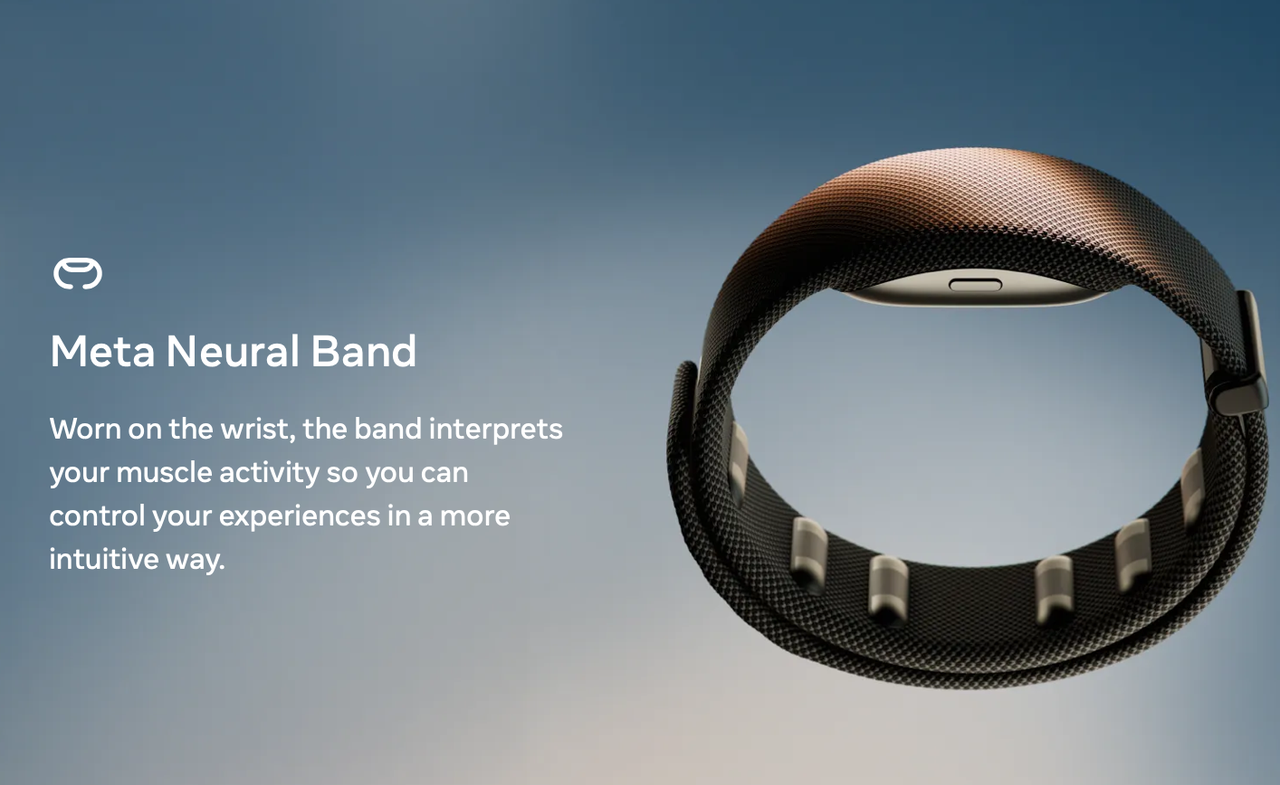

Contrairement aux opérations gestuelles basées uniquement sur la reconnaissance d'images, cette paire de lunettes est équipée du bracelet d'interface neuronale électromyographique Meta Neural Band, développé de longue date par Meta, qui permet un contrôle à distance très précis en identifiant les signaux électromyographiques et les mouvements du poignet.

▲Image|Méta

Il convient de noter que Meta Ray-Ban Display n'est pas une paire de lunettes AR complète, mais un appareil HUD monoculaire qui se concentre sur la présentation des informations clés dans le champ de vision – son écran ne couvre qu'une petite partie du champ de vision droit.

Il s'agit d'un écran couleur à guide d'ondes avec un taux de rafraîchissement variable de 30 à 90 Hz, d'une taille globale de 600 x 600 pixels, d'une densité de pixels de 42 pixels par degré et d'une luminosité maximale de plus de 5 000 nits. Il offre une excellente lisibilité en plein soleil et en extérieur.

▲Image|Méta

D'après l'expérience pratique de @梦雅Myra, amie d'Ai Faner, chez Meta Connect, l'écran à guide d'ondes des Ray-Ban Display offre une excellente luminosité et une excellente dissimulation. De face, seuls les fils latéraux sont visibles :

Le bracelet électromyographique Meta Neural Band présente également une sensibilité de reconnaissance élevée, et le taux de réussite des opérations gestuelles a été considérablement amélioré par rapport à la machine de test Orion lors de la conférence Connect de l'année dernière. Son utilisation quotidienne ne devrait poser aucun problème.

▲ Image de : @梦雅Myra

Contrairement à l'affichage tête haute qui affiche toujours les informations telles qu'elles sont imaginées, l'écran Ray-Ban s'allume uniquement lorsqu'il est activé. Il prend en charge l'affichage de contenu comme le lecteur de musique, l'aperçu du viseur de l'appareil photo, la traduction en temps réel des sous-titres, etc., et peut projeter les réponses de Live AI sous forme de texte sur l'objectif au lieu d'une simple sortie vocale.

Grâce à l'ajout d'un écran et de composants électroniques, les lunettes Ray-Ban Display pèsent environ 70 grammes, soit une légère augmentation par rapport aux 50 grammes de la version standard. En utilisation mixte, l'autonomie des Ray-Ban Display est d'environ 6 heures, extensible à environ 30 heures grâce à l'étui de recharge.

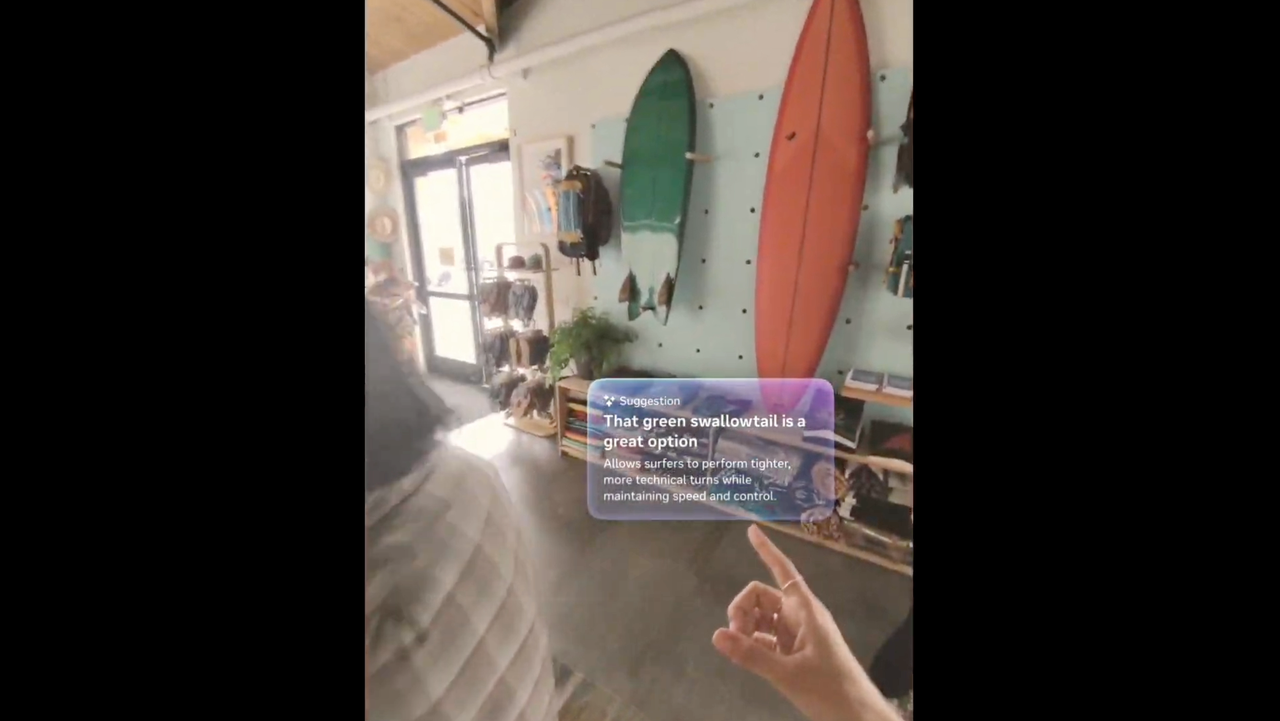

De plus, Live AI prend également en charge une fonctionnalité similaire à la fonctionnalité Magic Cue présentée par Google lors de la conférence de lancement du Pixel, qui peut afficher automatiquement diverses informations et opérations pertinentes (comme la création d'un calendrier) au milieu d'une conversation naturelle entre l'utilisateur et d'autres, sans que l'utilisateur ait à dire des mots-clés de commande.

Le bracelet Meta Neural Band fourni avec les lunettes est un autre point fort du matériel.

Ce bracelet lit les signaux électriques des muscles du poignet, aidant ainsi le gyroscope à détecter les mouvements, permettant ainsi aux utilisateurs de contrôler l'interface des lunettes par de subtils mouvements des doigts. Lors de la conférence Connect 2024 de l'année dernière, Meta a présenté un prototype de bracelet permettant de taper par pincement, attirant ainsi l'attention du secteur.

La démonstration de cette année est allée encore plus loin : Zuckerberg a même montré un court extrait montrant une personne portant des lunettes Display et utilisant un bracelet pour reconnaître des lettres manuscrites sur un ordinateur tout en éditant et en envoyant un message. Selon le communiqué de presse, la vitesse de reconnaissance de l'écriture manuscrite du bracelet est d'au moins 30 mots par minute.

En tant que premières lunettes intelligentes de Meta dotées de véritables capacités d'affichage numérique, Ray-Ban Display incarne la vision de Zuckerberg de « l'IA sur votre visage » – intégrant des assistants et des informations alimentés par l'IA dans des scénarios du monde réel sans interférer avec la vie quotidienne des utilisateurs.

Zuckerberg a déclaré que 2025 serait une année cruciale pour déterminer si les lunettes IA pourront atteindre des centaines de millions d'utilisateurs, démontrant ainsi les grands espoirs de l'entreprise. Bien sûr, il est important de noter qu'à ce stade, leurs fonctionnalités se rapprochent davantage de lunettes intelligentes avec notifications améliorées que d'un véritable appareil de réalité mixte.

Selon le communiqué de presse, le prix de départ des Ray-Ban Display est de 799 $ US (environ 5 700 RMB). Ce prix est bien supérieur à celui de toutes les lunettes connectées Meta actuelles, mais au vu de la richesse des fonctionnalités et des effets concrets de la démonstration sur site, il en vaut sans aucun doute la peine.

Ray-Ban Meta (Gen 2) : Un léger lifting, mais aussi plus beau et plus grand

En plus des lunettes HUD haut de gamme, Meta a également lancé les Ray-Ban Meta (Gen 2) pour le marché de masse.

Étant essentiellement une paire de lunettes, Meta Ray-Ban 3 offre une gamme plus large de styles et de variétés de montures, y compris un nouveau modèle de monture transparente et deux options de verres : or réfléchissant marron ou rouge rubis.

▲ Image|Méta

L'autonomie des Ray-Ban Meta (Gen 2) a été doublée par rapport à la génération précédente. Le boîtier de charge intelligent permet de recharger les lunettes à 50 % en 20 minutes, soit une légère amélioration par rapport aux 22 minutes précédentes.

De plus, l'étui de chargement offre 48 heures d'autonomie supplémentaires, contre 32 heures auparavant.

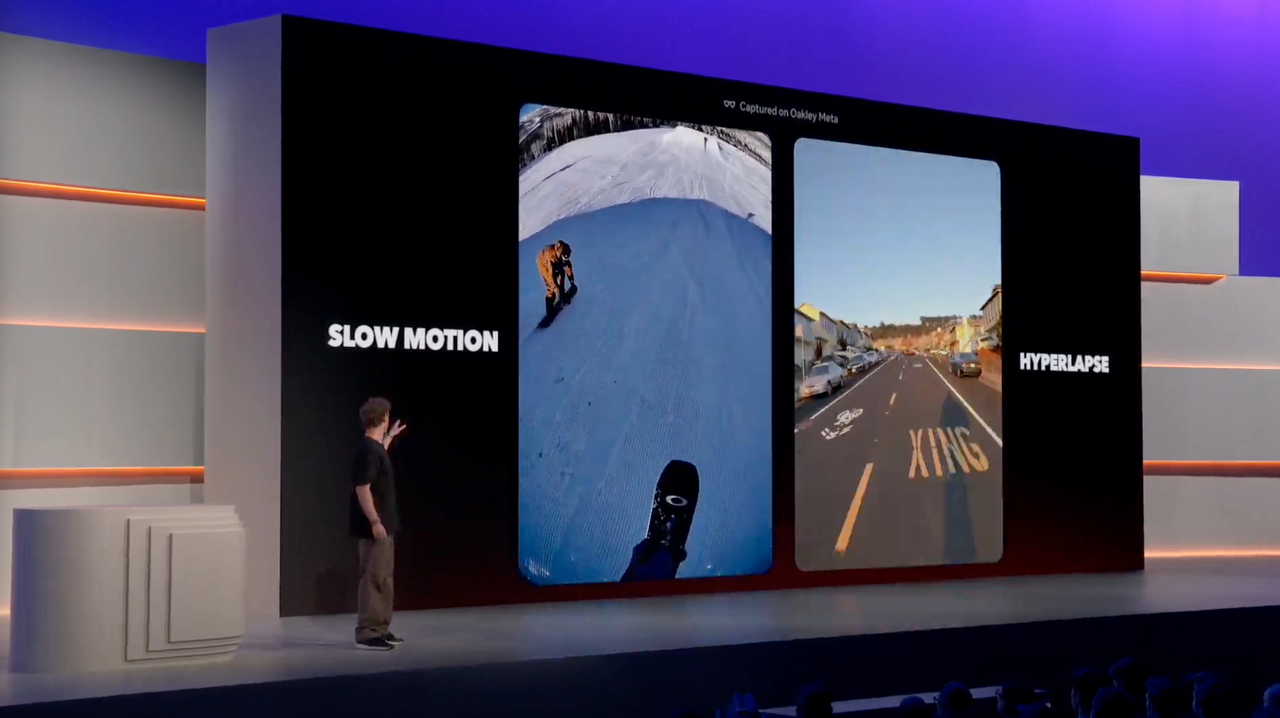

Les spécifications d'enregistrement ont également été mises à niveau vers la résolution 3K, permettant l'enregistrement de vidéos 3K à 30 ips, 1440p à 30 ips et 1200p à 60 ips, d'une durée maximale de trois minutes. Il est annoncé que Meta ajoutera plus tard cette année la possibilité de capturer des vidéos en accéléré et au ralenti ; cette fonctionnalité sera appliquée à toutes ses lunettes IA.

Les Ray-Ban Meta (Gen 2) sont équipées d'une nouvelle fonctionnalité appelée Conversation Focus. Similaire au mode avancé des casques audio, elle identifie et amplifie activement la fréquence vocale de votre interlocuteur, vous permettant ainsi d'entendre plus facilement ce qu'il dit dans les environnements bruyants.

De plus, cette fonctionnalité sera disponible sur toutes les Ray-Ban existantes sous forme de mise à jour logicielle.

Le modèle d'IA en direct de Meta a également été amélioré en conséquence. Outre la reconnaissance visuelle, il permet désormais aux utilisateurs d'interrompre activement la conversation. Malheureusement, la démonstration en direct lors de la conférence de presse a échoué. L'assistant d'IA en direct est resté bloqué sur un dialogue en boucle et n'a pas pu terminer une session de conversation complète.

Par rapport aux 299 $ de la génération précédente, la Ray-Ban Meta (Gen 2) légèrement modifiée est passée à 379 $.

Oakley Meta Vanguard : mode et sport, tout en un

La collaboration de Meta avec EssilorLuxottica s'étend au-delà de Ray-Ban et inclut désormais la marque Oakley du groupe. En juin dernier, les deux entreprises ont lancé les Oakley Meta HSTN, des lunettes connectées sportives dotées d'une autonomie prolongée et de fonctionnalités d'enregistrement vidéo avancées.

La plus grande différence entre les lunettes intelligentes Oakley Meta Vanguard lancées aujourd'hui et Ray-Ban est que les Vanguard adoptent l'apparence des lunettes de sport et que leur caméra est placée au centre du pont nasal plutôt que sur les côtés de la monture.

En termes de spécifications de caméra, l'Oakley Meta Vanguar utilise une caméra grand angle de 12 mégapixels et 122° placée au milieu du pont nasal, ce qui constitue également la plus grande différence avec la Meta Ray-Ban, qui n'a qu'une seule caméra sur le côté gauche.

Un témoin lumineux d'enregistrement est également présent sur le dessus des lunettes. Grâce au nouveau bouton d'action, vous pouvez rapidement passer d'un mode de prise de vue à l'autre : 5 minutes d'enregistrement en 1080p/30 ips, 3 minutes en 1080p/60 ips ou 3K/30 ips, et 720p/120 ips avec ralenti.

La fonction time-lapse ultra-rapide du produit peut éditer et générer automatiquement les moments forts des meilleurs clips (une mise à niveau logicielle sera déployée sur l'ensemble des lunettes intelligentes Meta cet automne), et elle fournit également une fonction anti-tremblement réglable, qui peut être réglée en fonction de l'intensité de l'exercice.

De plus, les haut-parleurs ouverts Meta de ces lunettes sont les plus puissants des lunettes IA : 6 décibels de plus que les Oakley Meta HSTN. De plus, elles sont équipées d'un ensemble de cinq microphones spécialement optimisé pour la suppression du bruit du vent, garantissant ainsi un son clair pendant les conversations.

En extérieur, l'Oakley Meta Vanguard offre une autonomie allant jusqu'à neuf heures et peut écouter de la musique en continu jusqu'à six heures. Selon Zuckerberg : « Cela suffit pour courir deux marathons – bien sûr, à condition de pouvoir en courir deux » (doge).

De plus, grâce au boîtier de charge, les lunettes connectées offrent 36 heures d'autonomie supplémentaires. Si vous êtes pressé, vous pouvez recharger rapidement les lunettes à 50 % en 20 minutes grâce au boîtier.

En termes d'intégration de l'écosystème, Vanguard a renforcé ses partenariats stratégiques avec Strava et Garmin. Les utilisateurs peuvent désormais synchroniser leurs séquences avec la plateforme Strava d'un simple clic, tout en tirant parti des capacités d'analyse intelligente de Meta AI pour récupérer rapidement leur historique d'entraînement personnel.

Les lunettes Oakley Meta Vanguard se connectent directement à la plupart des montres connectées Garmin. Une fois connectées, le logo Meta AI apparaît sur l'interface de la montre. Pendant l'exercice, il suffit de prononcer des commandes vocales pour que les lunettes fournissent des données de suivi de la fréquence cardiaque et d'autres indicateurs de performance en temps réel, avec un délai de transmission quasi-inexistant.

Dans l'expérience réelle, lorsque les utilisateurs effectuent un entraînement en zone de fréquence cardiaque, il y aura une surprise supplémentaire : une nouvelle lumière LED est ajoutée au-dessus de l'œil droit, qui deviendra rouge une fois que la zone de fréquence cardiaque cible sera déviée pendant l'entraînement, et des rappels de rythme peuvent également être définis.

Si Ray-Ban s'adresse aux adeptes de la mode et du quotidien, Oakley se concentre sur les sportifs et les geeks. Son prix est de 499 $ US et sa sortie officielle est prévue le 21 octobre, heure locale.

Meta amène le monde réel en VR avec Hyperscape

Meta ne publie pas seulement du matériel lors de sa conférence annuelle Connect, mais déploie également un grand nombre de mises à jour logicielles.

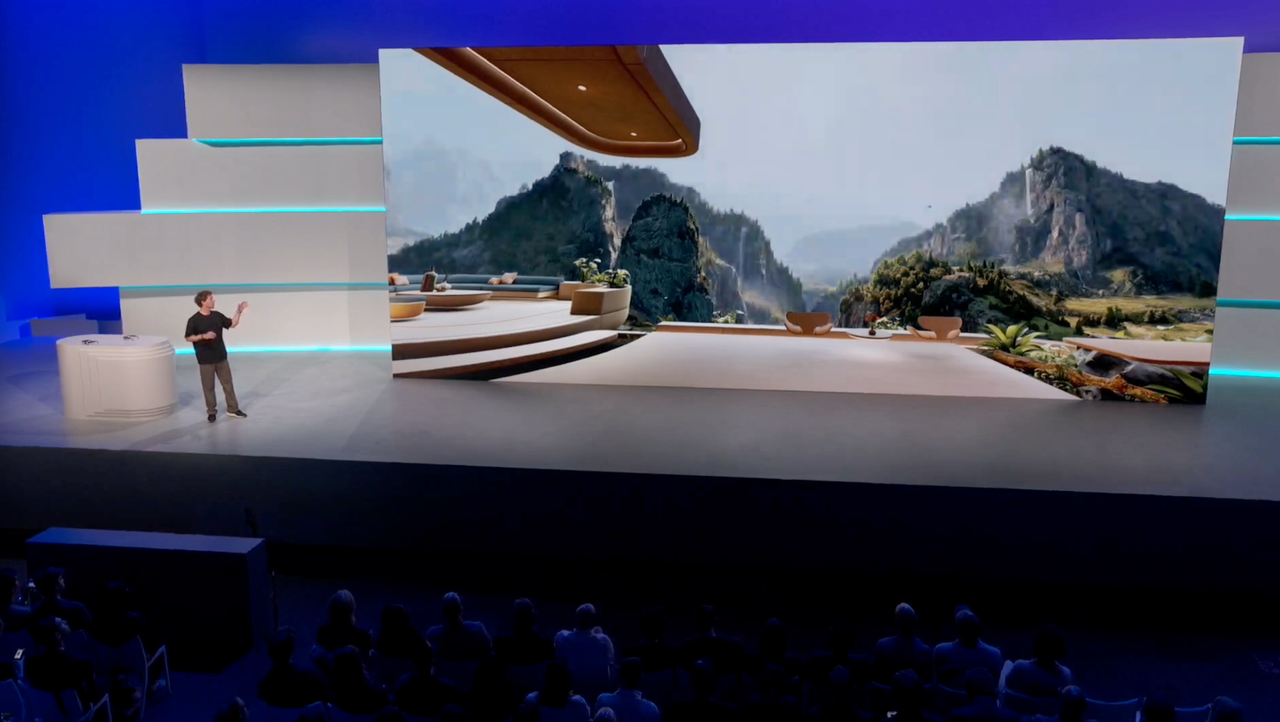

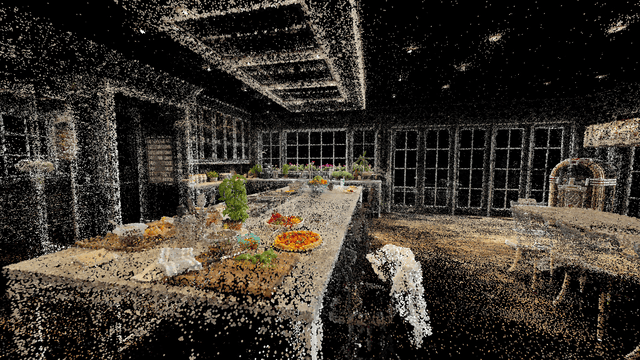

Dès aujourd'hui, Meta intégrera pleinement la réalité au monde virtuel. Sa nouvelle technologie « Hyperscape » permet de scanner l'espace réel qui vous entoure dans le casque Quest VR, générant ainsi une réplique numérique photoréaliste permettant même d'interagir avec le métavers.

Les utilisateurs de Quest 3 et Quest 3S peuvent dès maintenant télécharger la version bêta de l'application Hyperscape Capture pour l'essayer. Pour l'instant, elle est réservée à une expérience personnelle. Vous pourrez ensuite la partager via un lien afin que d'autres puissent revisiter l'espace scanné avec vous.

Cette technologie a été dévoilée pour la première fois lors de Connect 2024 l’année dernière, et un an plus tard, Meta l’a finalement amenée au niveau des utilisateurs.

Il convient de noter que le journaliste de The Verge a pu découvrir en avant-première certaines pièces pré-scannées, comme une cuisine. Selon lui, ces pièces ressemblent beaucoup à des environnements réels, et même des détails comme la nourriture sur la table et les piles de livres sont relativement nets.

Cependant, si vous vous approchez trop, l'illusion disparaît. Par exemple, le texte du New York Times sur le « journal » est lisible clairement, mais parfois un peu flou.

▲ Image de : Meta

Alors, comment scanner et capturer l’espace ?

Selon The Verge, après avoir enfilé le casque Quest 3, il a parcouru la pièce et regardé autour de lui, et une grille virtuelle a commencé à recouvrir l'objet devant lui. Après environ trois minutes de balayage, l'application a invité le journaliste à se rapprocher de l'objet, et la grille a progressivement disparu.

Cependant, cette analyse de l'espace virtuel ne s'effectue pas en temps réel. Une fois l'analyse terminée, les données doivent être téléchargées dans le cloud pour traitement, et il faut généralement plusieurs heures avant de pouvoir visualiser le résultat final.

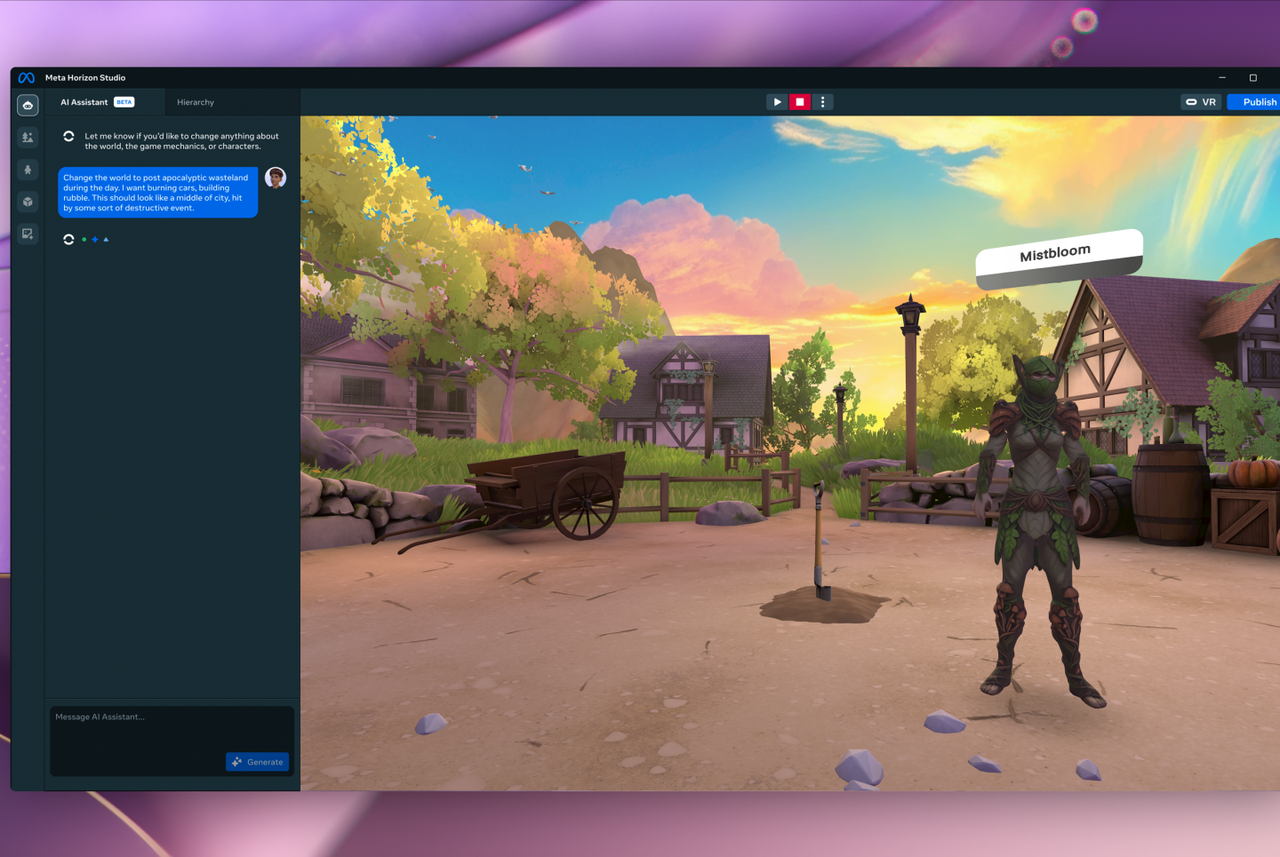

Un autre point clé est que le plus grand changement apporté à la plateforme Horizon cette année est l’introduction d’un nouveau moteur de jeu qui offre des performances graphiques de meilleure qualité, ainsi que le lancement de Meta Horizon Studio pour aider les créateurs à créer des expériences de jeu personnalisées.

Meta Horizon Studio peut être considéré comme un éditeur de mondes en réalité virtuelle. Les créateurs peuvent déjà utiliser des outils d'IA générative pour créer des textures, de l'audio et bien plus encore. Plus tard cette année, Meta ajoutera un assistant IA à l'éditeur pour soutenir le développement.

Au cœur de ces nouveaux environnements métavers se trouve le moteur Horizon, qui, selon Meta, promet « de meilleurs graphismes, des performances plus rapides et des mondes VR plus avancés », ainsi que la prise en charge de niveaux plus élevés d'expériences simultanées.

De plus, pour permettre aux utilisateurs de regarder plus facilement des films et des émissions de télévision sur le casque Quest, Meta a également annoncé le lancement du hub Horizon TV, qui donne accès à des applications de streaming comme Prime Video, Peacock, Twitch et, enfin, Disney Plus, Hulu et ESPN.

En repensant aux conférences Connect précédentes, les versions matérielles suivent souvent un modèle « un principal et plusieurs auxiliaires » : c'est-à-dire qu'une version matérielle principale est publiée chaque année, complétée par des aperçus ou des mises à jour d'autres projets.

Par exemple, le point culminant de Connect 2024 (l'année dernière) a été la sortie du casque Quest 3S et la première exposition du véritable prototype de lunettes AR Orion ; Connect 2023 a lancé la deuxième génération de lunettes intelligentes Ray-Ban Meta, annoncé les spécifications détaillées de Quest 3 et présenté en avant-première plusieurs jeux VR et projets d'IA.

Contrairement aux années précédentes, le protagoniste de cette conférence Connect n’est pas le casque, mais les lunettes intelligentes.

L'écran Meta Ray-Ban, fruit de plusieurs années de recherche et développement, est considéré comme une étape importante pour Meta dans sa conquête du marché des lunettes connectées. Comme Zuckerberg l'a souligné à plusieurs reprises, les lunettes connectées ont le potentiel de devenir la prochaine plateforme informatique polyvalente.

Un autre thème principal de la conférence est « L’IA est partout ».

L'IA est un moteur, tant dans le domaine matériel que logiciel. Meta, en particulier, a continuellement accru ses investissements en IA au cours des six derniers mois, inaugurant ainsi la compétition intense de cette année pour attirer les meilleurs talents en IA. En combinant IA et matériel, Meta vise à créer un écosystème complet, difficile à reproduire immédiatement par d'autres entreprises.

En fin de compte, cette stratégie est à la fois une réorganisation des itinéraires matériels de Meta et un pari sur l’avenir de l’informatique.

Les visiocasques (HMD) continuent de servir de terrain d'expérimentation pour les expériences immersives, tandis que les lunettes connectées sont propulsées sur le devant de la scène, porteuses d'une ambition de « portabilité ». Grâce à la forte pénétration de l'IA, Meta est bien placé pour conquérir les sommets de l'ère de l'informatique intelligente.

Texte|Myra Mengya, Mo Chongyu, Ma Fuyao

#Bienvenue pour suivre le compte public officiel WeChat d'iFaner : iFaner (ID WeChat : ifanr), où du contenu plus passionnant vous sera présenté dès que possible.