Xiaomi YU7 établit un nouveau record mondial dans l’histoire de l’automobile avec plus de 200 000 commandes en 3 minutes

Lei Jun a apporté une grande nouvelle au début de la conférence de presse d'aujourd'hui :

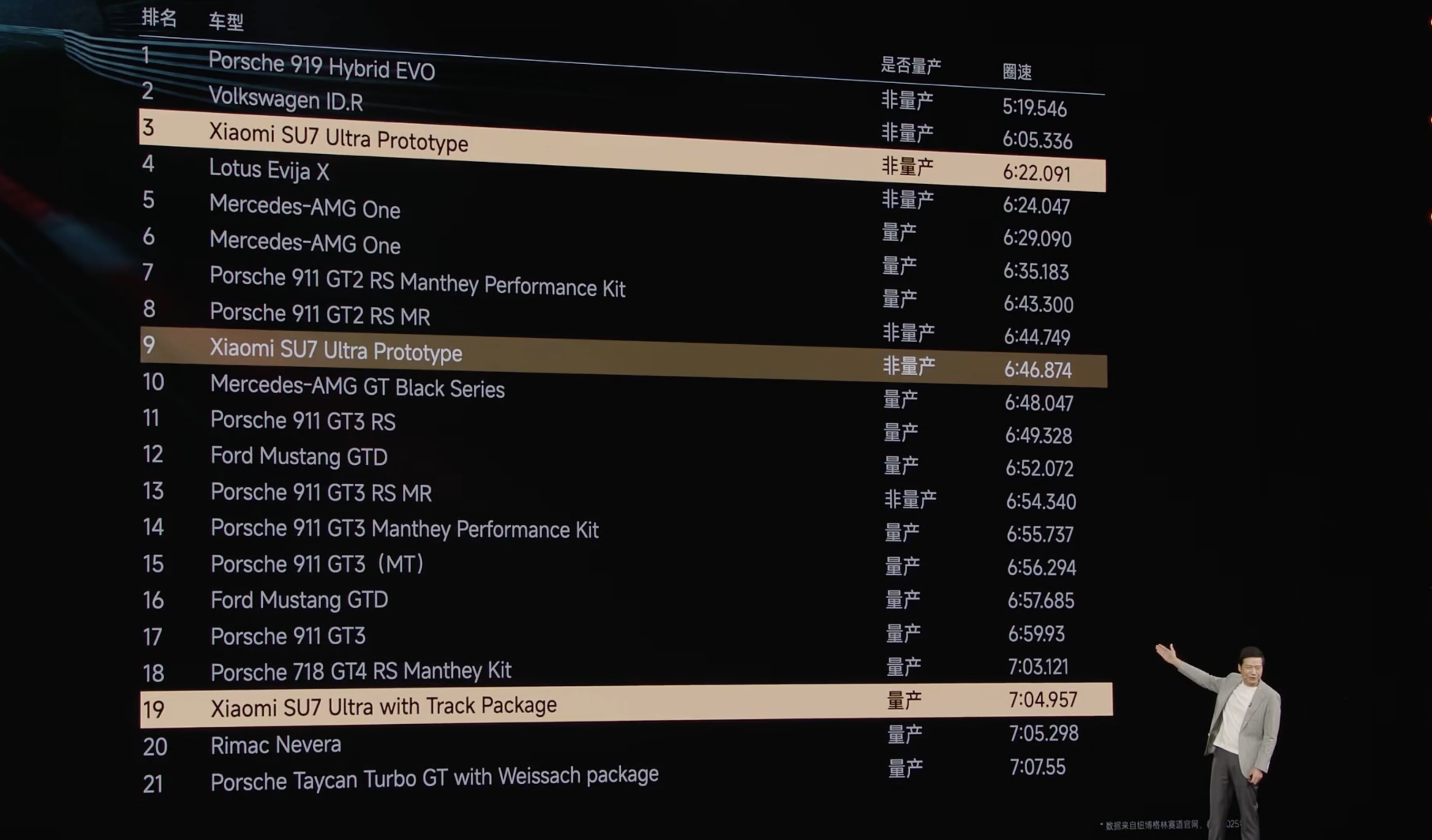

Le dernier temps au tour du prototype Xiaomi SU7 Ultra sur la Nordschleife du Nürburgring était de 6 minutes 22 secondes 091.

Ce résultat le place au troisième rang de la liste officielle des circuits du Nürburgring, les deux premiers étant la Porsche 919 Hybrid EVO et la Volkswagen ID.R.

Lei Jun a expliqué pourquoi le Xiaomi SU7 Ultra doit défier la Nordschleife du Nürburgring :

Afin de rivaliser avec les plus grands constructeurs automobiles comme Porsche, nous peaufinons soigneusement notre technologie sur circuit avant de l'appliquer aux voitures de série. Pour obtenir un bon résultat au Nürburgring, outre des performances et une puissance élevées, le véhicule doit également bénéficier d'un excellent châssis, de freins et d'une excellente dissipation thermique, ainsi que de hautes exigences en matière de fiabilité, de durabilité et de sécurité.

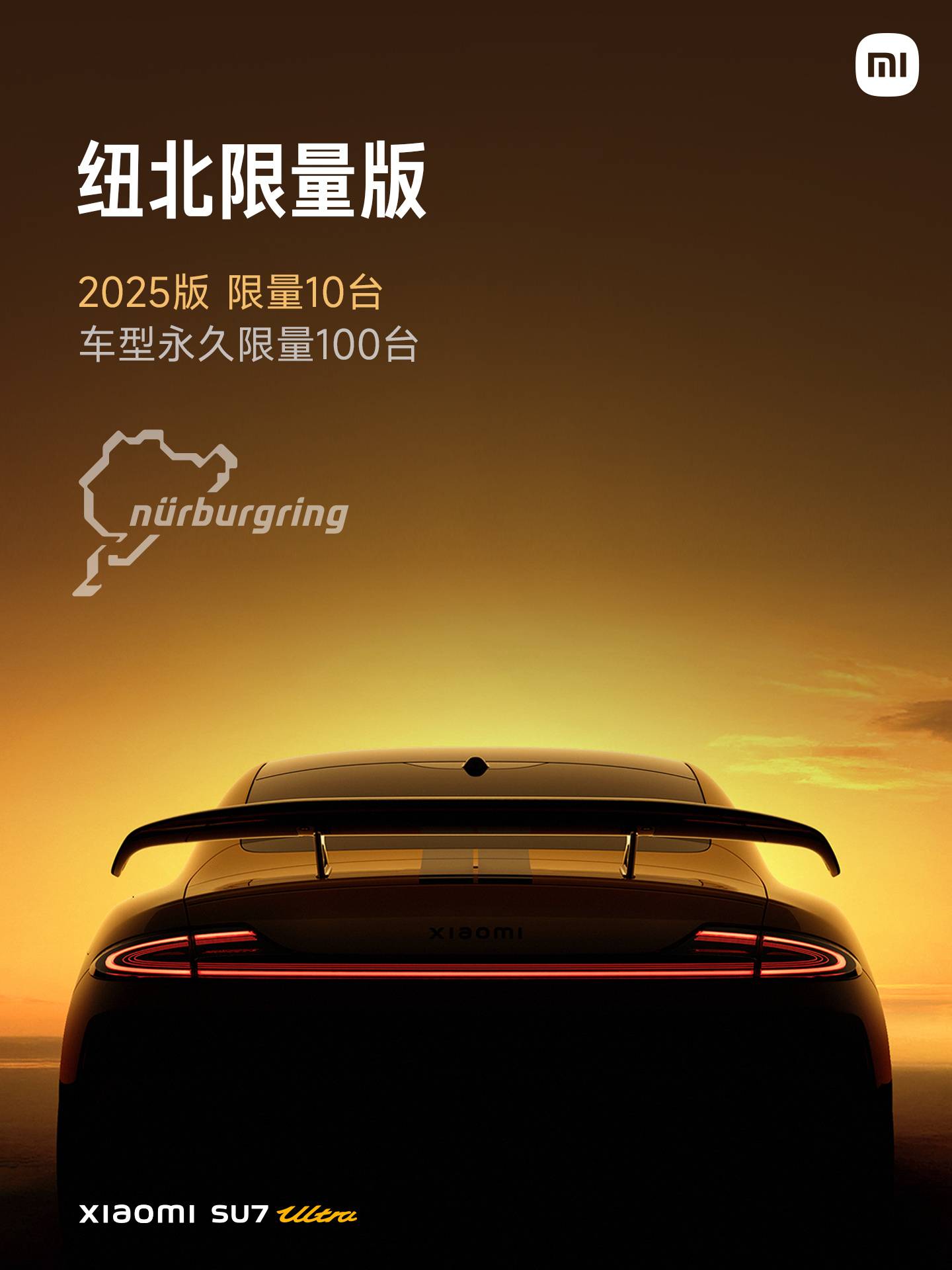

Xiaomi a également apporté la très attendue Xiaomi SU7 Ultra Nürburgring Special Edition, qui est limitée à 100 unités et le modèle 2025 est limité à 10 unités.

La configuration de l'édition spéciale du Nürburgring est fondamentalement la même que celle du modèle de prise de tour du Nürburgring, avec seulement de simples ajustements apportés à certaines configurations de conformité.

Plus précisément, l'édition spéciale Nürburgring est équipée d'une tenue de course professionnelle, comprenant des amortisseurs Bessey à ressorts hélicoïdaux, des plaquettes de frein de course, des pneus haute performance Pirelli P Zero et un pneu thermofusible PZS. Elle est également équipée de jantes forgées, d'un toit en fibre de carbone, de passages de roues arrière, de doubles prises d'air, d'un grand aileron arrière et de plaques de protection de soubassement. Les sièges ont également été remplacés par des sièges de course et des ceintures de sécurité à six points siglées Nürburgring.

Le Xiaomi SU7 Ultra Nürburgring Special Edition est vendu au prix de 814 900 yuans, et vous pouvez également acheter un survêtement pour 100 000 yuans séparément sur le SU7 Ultra.

Lei Jun n'a pas caché ses ambitions pour Xiaomi Motors.

SU7 rattrape Porsche et YU7 défie le modèle Y.

Lei Jun a dit franchement :

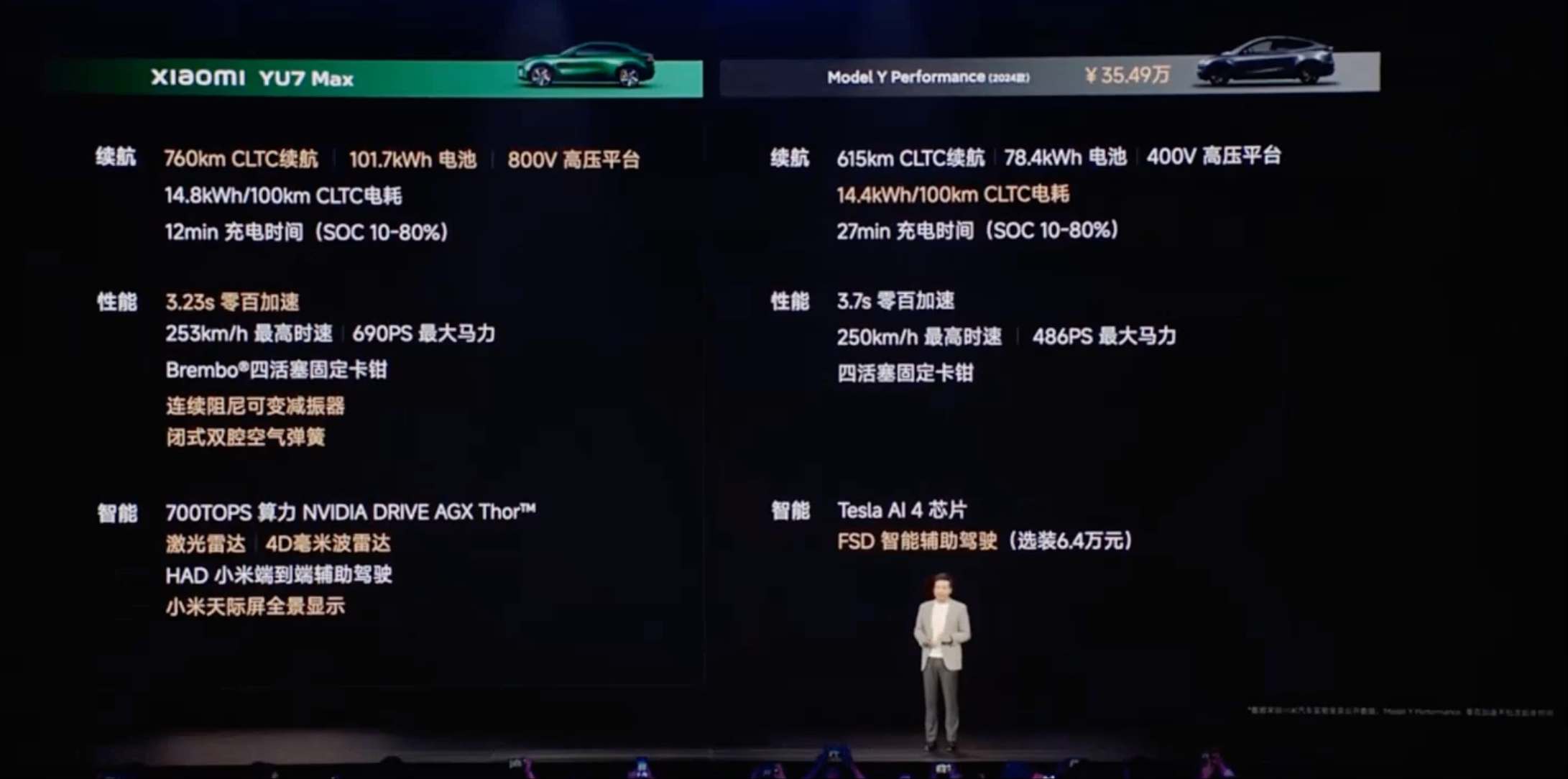

La version standard du YU7 n'est pas une version d'entrée de gamme. Sa configuration est extrêmement puissante, équivalente aux versions Max et Ultra des concurrents.

Lei Jun a non seulement créé un tableau comparatif pour prouver que le YU7 a une configuration plus élevée et plus puissante que le modèle Y, mais a également décidé de le vendre 10 000 yuans moins cher que le modèle Y.

Le prix final du premier SUV hautes performances de Xiaomi, le YU7, est donc ici.

La version standard coûte 253 500 yuans, la version Pro coûte 279 900 yuans et la version Max coûte 329 900 yuans.

La nouvelle conception du « confort » selon Xiaomi

Concernant la configuration du modèle, Xiaomi a déjà dévoilé quatre coloris pour le YU7 : Orange Lave, Vert Saphir, Titane Métal et Poudre d'Or Fluide. Lors de la conférence de presse, Xiaomi a dévoilé cinq autres coloris : Blanc Perle, Bleu Profond, Cyan Ombre, Noir Basalte et Violet Danxia.

Lei Jun a déclaré : « Xiaomi a conçu ces neuf couleurs pour répondre à différents groupes de personnes et besoins. Par exemple, si le propriétaire appartient à l'élite sociale, il est recommandé de choisir des couleurs de voiture de sport comme le vert émeraude et l'orange lave. Si vous recherchez une voiture stable, vous pouvez opter pour le titane, le blanc perle et d'autres couleurs. »

Le YU7 est livré de série avec des jantes diamantées longue portée de 19 pouces, et il existe également différentes jantes de 20 et 21 pouces et des logos de voiture flottants parmi lesquels choisir.

Aux couleurs intérieures gris turquoise, orange corail et bleu crépuscule précédemment exposées s'ajoute cette fois un nouveau violet iris. Les sièges sont gris et le revêtement extérieur est violet.

Côté confort, les sièges conducteur et passager avant du Xiaomi YU7 sont équipés de sièges zéro gravité et d'un système de massage à 10 points. Les sièges arrière sont réglables électriquement jusqu'à 135°, et les appuis-tête, plus épais et plus larges, offrent un bon maintien de la tête des deux côtés en position allongée.

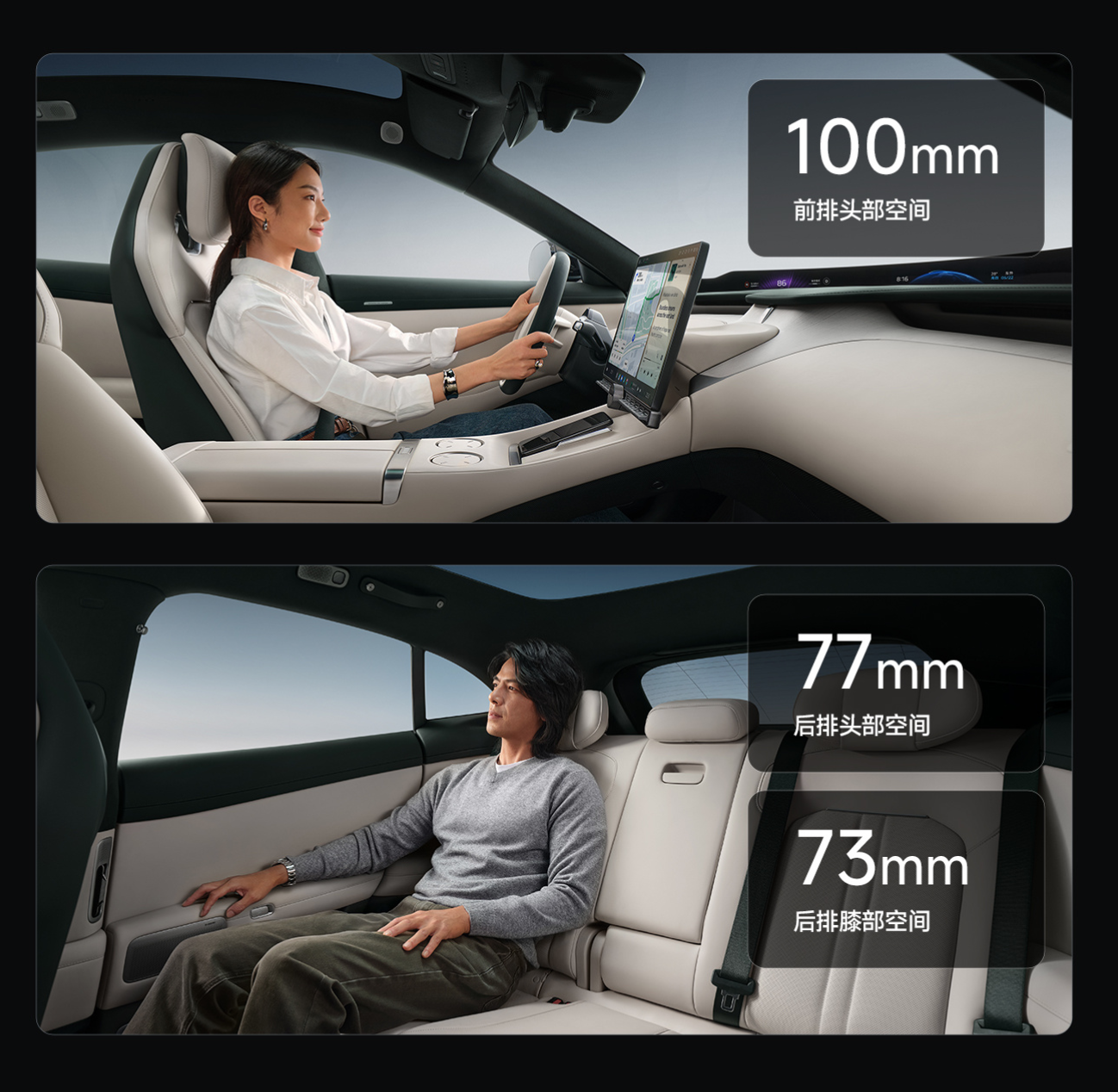

La silhouette sportive du Xiaomi YU7 a suscité quelques inquiétudes quant à son espace arrière. Cependant, après notre essai, l'espace arrière du Xiaomi YU7 est largement suffisant pour les personnes de corpulence normale. Lei Jun a également annoncé lors de la conférence de presse que Xiaomi avait utilisé un mannequin de 1,88 mètre pour la conception, avec un espace pour la tête de 100 mm et pour les genoux de 77 mm.

La nouvelle voiture ne fait aucun compromis en matière de rangement. Les sièges arrière se transforment en un lit de 1,8 m. La voiture offre 36 espaces de rangement, le coffre avant électrique offre un volume de 141 L et le coffre arrière, 678 L. Le point fort de ce rangement réside dans la conception d'une deuxième rangée de tiroirs sous les sièges arrière, idéale pour ranger les jouets, couvertures et autres objets des enfants.

En termes de fonctionnalités intelligentes dans lesquelles Xiaomi excelle, le Xiaomi YU7 propose deux chargeurs sans fil de 80 W, un miroir de maquillage réglable à trois vitesses, un rétroviseur antireflet, un voyant d'avertissement de surveillance des angles morts, un boîtier de chauffage et de refroidissement intelligent et un système audio à 25 haut-parleurs prenant en charge Dolby Atmos.

Lei Jun a également mentionné spécifiquement deux points forts du Xiaomi YU7.

Premièrement, toute la série YU7 est équipée de série de vitrage feuilleté silencieux, et plus de 200 optimisations acoustiques ont été réalisées à l'échelle du véhicule. Des matériaux d'insonorisation de pointe sont utilisés dans plus de 30 pièces clés. Deuxièmement, le Xiaomi YU7 est équipé d'un toit ouvrant panoramique utilisant la dernière génération de vitrage occultant EC, comparable à un pare-soleil physique.

Sportif, luxueux et intelligent

Bien entendu, en tant que SUV de luxe hautes performances, le Xiaomi YU7 est également au sommet de l'industrie en termes de performances et d'autonomie de la batterie.

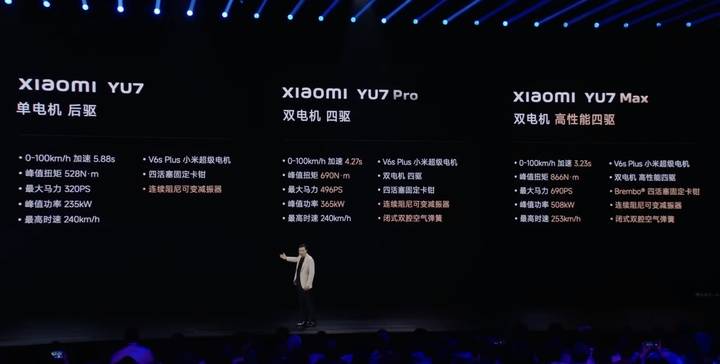

Il existe trois versions du YU7 : la version standard avec un seul moteur à propulsion arrière, la version Pro avec deux moteurs à quatre roues motrices et la version Max avec deux moteurs à quatre roues motrices.

– Le modèle standard a une puissance maximale de 235 kW (320 ch), une accélération de 0 à 100 km/h de 5,88 secondes et une vitesse de pointe de 240 km/h ;

– La version Pro a une puissance maximale de 365 kW (496 chevaux), une accélération de 0 à 100 km/h de 4,27 secondes et une vitesse de pointe de 240 km/h ;

– La version Max a une puissance maximale de 508 kW (690 chevaux), une accélération de 0 à 100 km/h en 3,23 secondes et une vitesse de pointe de 253 km/h.

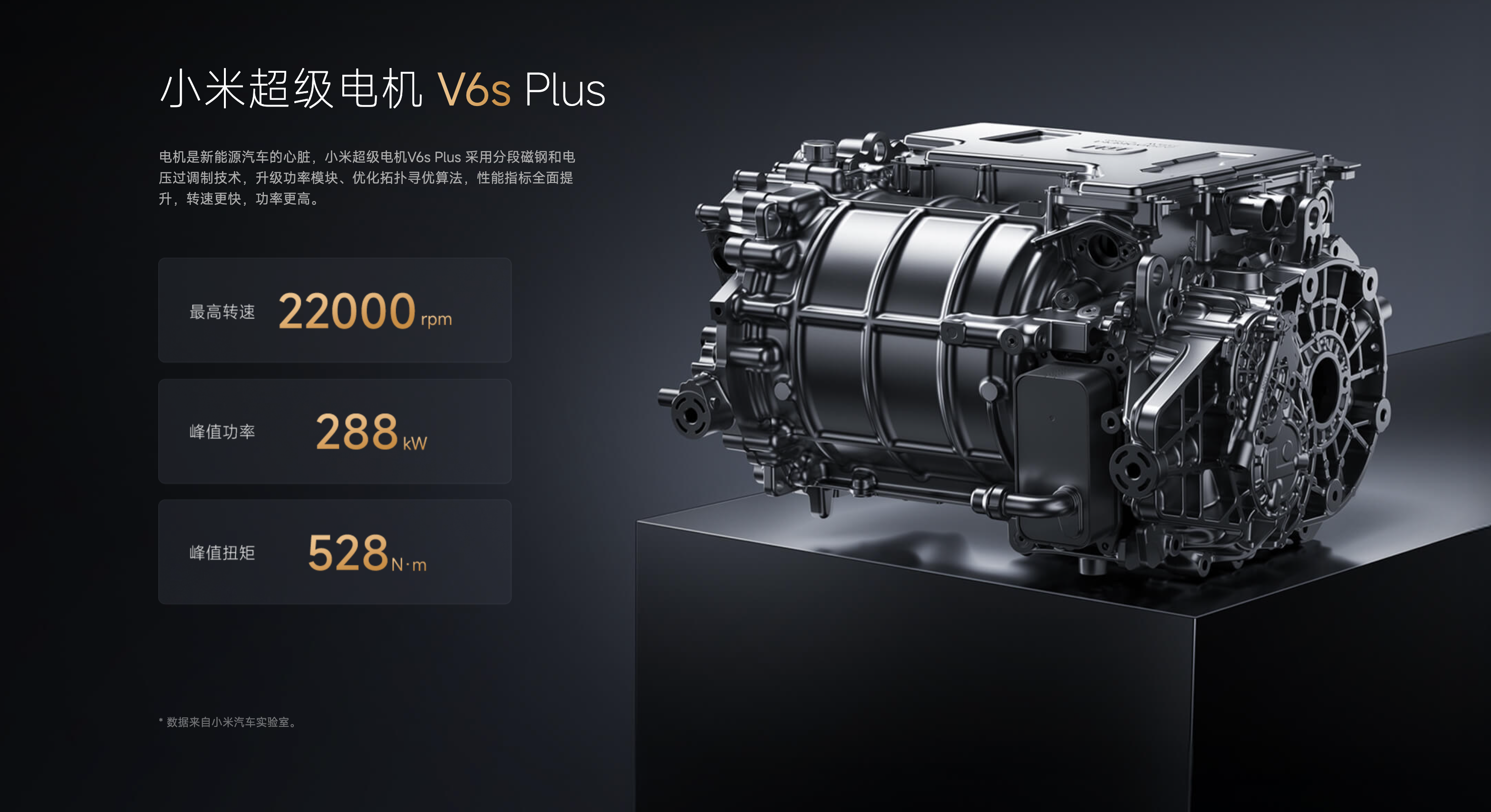

Les trois modèles sont équipés du super moteur V6s Plus de Xiaomi, dont le régime maximal est porté à 22 000 tr/min. Des amortisseurs à amortissement variable en continu sont de série. Les versions Pro et supérieures utilisent des ressorts pneumatiques à double chambre fermée, tandis que la version Max est équipée d'étriers fixes Brembo à quatre pistons. La distance de freinage à partir de 100 km/h est de seulement 33,9 mètres.

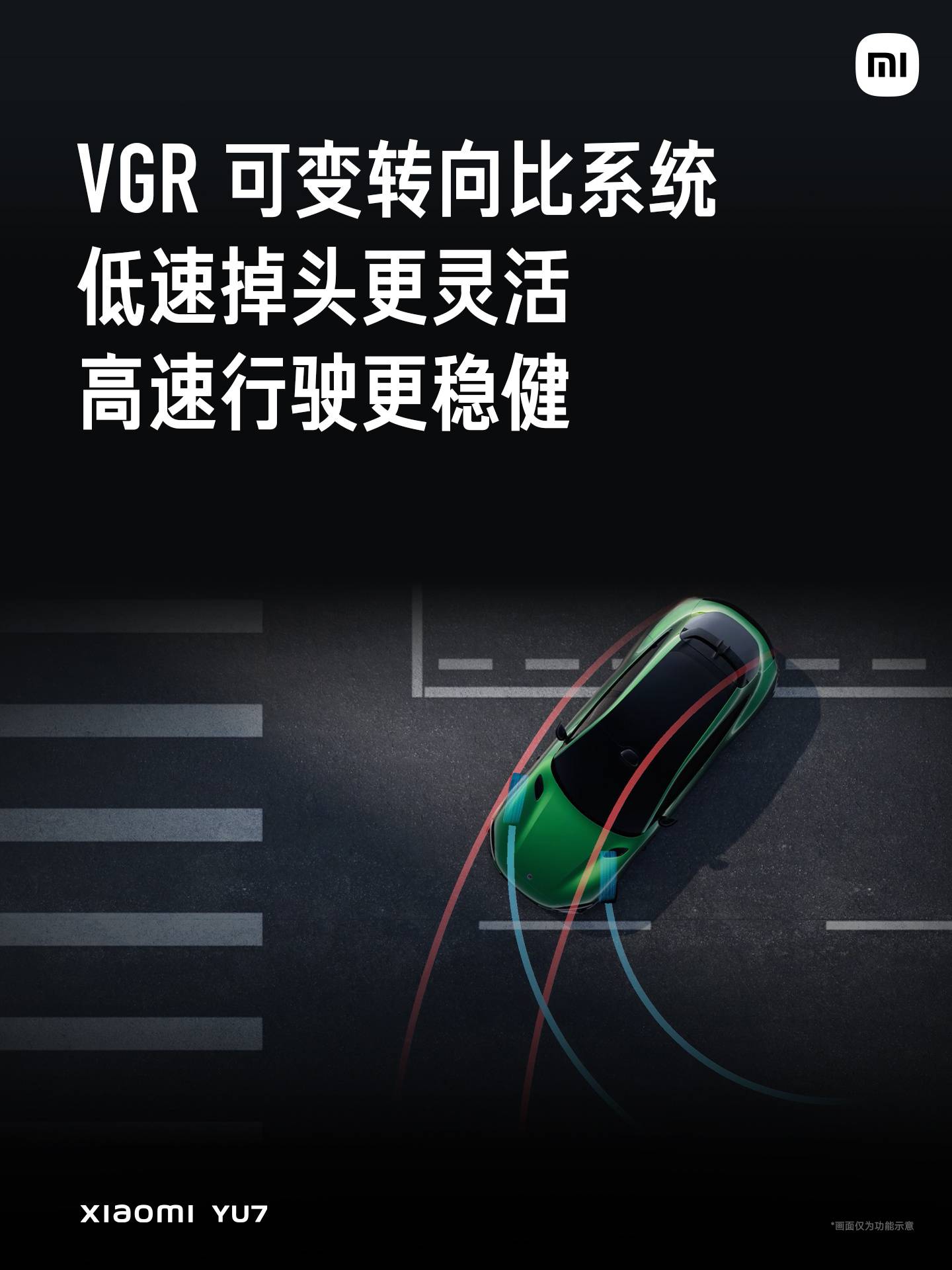

En termes de réglages, le YU7 privilégie le confort et la sportivité. Le châssis intelligent, de série sur toute la gamme, anticipe l'état de la route et l'adapte activement. Par exemple, il ajuste automatiquement la hauteur du châssis en descente et réduit automatiquement la résistance de la suspension sur les ralentisseurs. La technologie de direction à démultiplication variable, présente sur toute la gamme, permet au YU7 d'offrir une flexibilité de carrosserie variable à vitesse élevée et faible, avec un rayon de braquage minimal de 5,7 mètres.

Côté batterie, le YU7 embarque une puissante batterie de 96,3 kWh. L'autonomie CLTC de la version standard atteint 836 km, ce qui en fait le modèle le plus long parmi les SUV 100 % électriques de taille moyenne et grande ; la version Max à deux moteurs affiche également une autonomie CLTC de 770 km, ce qui la place également au sommet des SUV 100 % électriques à quatre roues motrices.

Parallèlement, toute la série YU7 adopte une plateforme haute tension en carbure de silicium de 800 V. La vitesse de charge de la version Max atteint 5,2 C. Elle permet de parcourir jusqu'à 620 km en 15 minutes de charge, et le temps de charge le plus rapide, de 10 % à 80 %, est de 12 minutes.

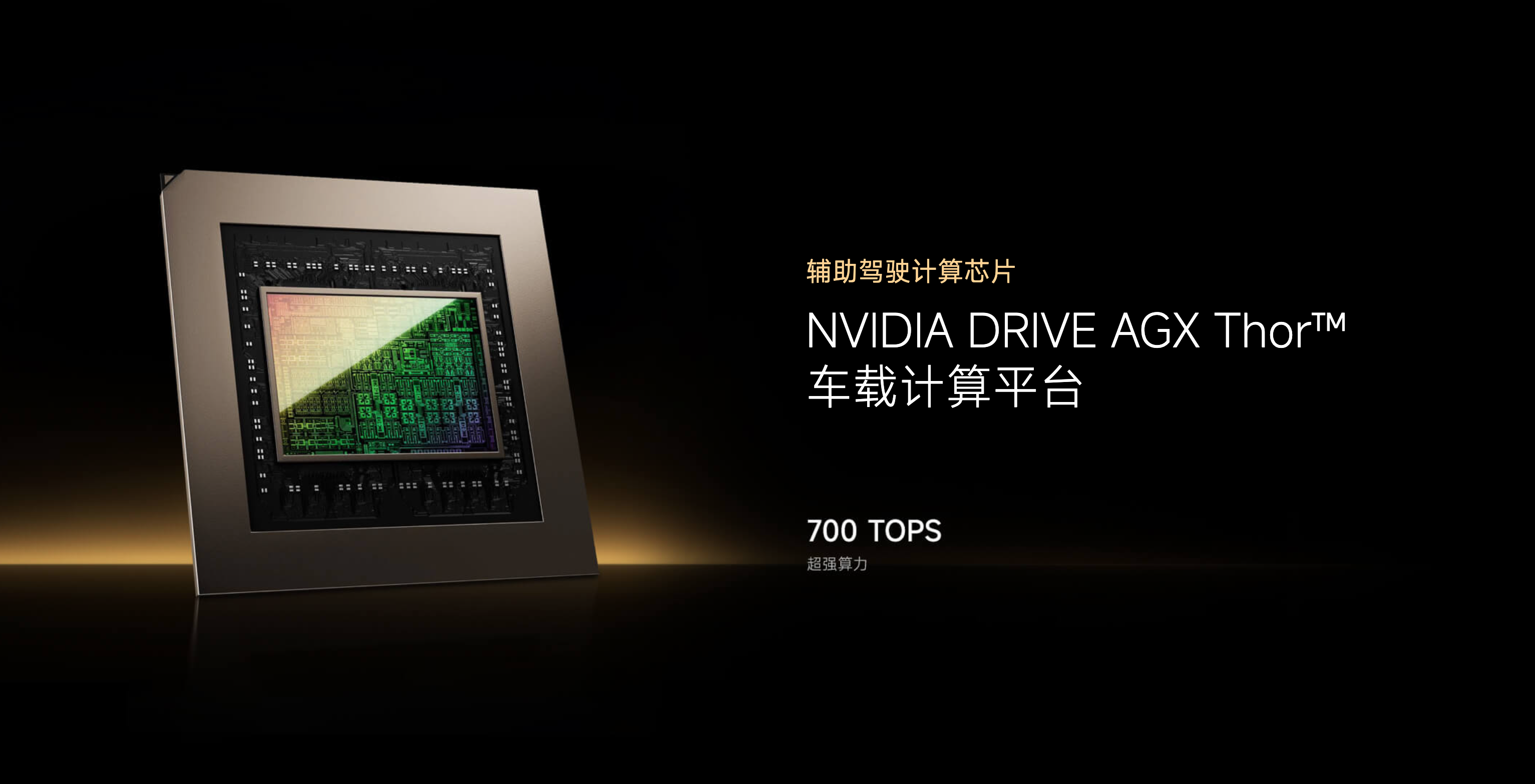

Le YU7 est équipé du contrôleur de domaine 4-en-1 développé par Xiaomi, qui intègre la conduite assistée, le cockpit intelligent, le contrôleur du véhicule et le module de communication. Grâce à une intégration poussée, il permet non seulement de réduire l'encombrement, mais aussi d'optimiser l'efficacité énergétique. Xiaomi utilise la puce NVIDIA Thor 4 nm pour la conduite assistée, tandis que la puce du cockpit utilise le Snapdragon 8 GEN 3.

Le point fort du cockpit du YU7 est son écran panoramique. Grâce à la technologie de projection, Xiaomi a créé une bande lumineuse d'information périphérique intégrée qui traverse le tableau de bord sous le pare-brise, long de 1,1 mètre.

L'écran panoramique YU7 offre une luminosité maximale visible de 1 200 nits, un contrôle global de la lumière sur 903 zones, un revêtement ultra-noir intégré et un algorithme de correction de la distorsion intégré. Le contenu est diffusé par trois mini-écrans LED.

En termes de fonctionnalités, il peut être lié à l'état du véhicule et afficher le contenu correspondant lors du changement de mode de conduite et du démarrage de la conduite assistée. L'écran d'angle mort s'affiche également lorsque le clignotant est activé, ce qui renforce considérablement l'aspect technologique et interactif du véhicule.

Le modèle Xiao Ai complet est également installé sur le Xiaomi YU7, qui permet non seulement la fusion multimodale, mais aussi les fonctions Xiao Ai hors du véhicule. Xiaomi a installé huit microphones et un haut-parleur à l'extérieur, permettant ainsi l'ouverture des coffres avant et arrière par reconnaissance vocale et par clé numérique.

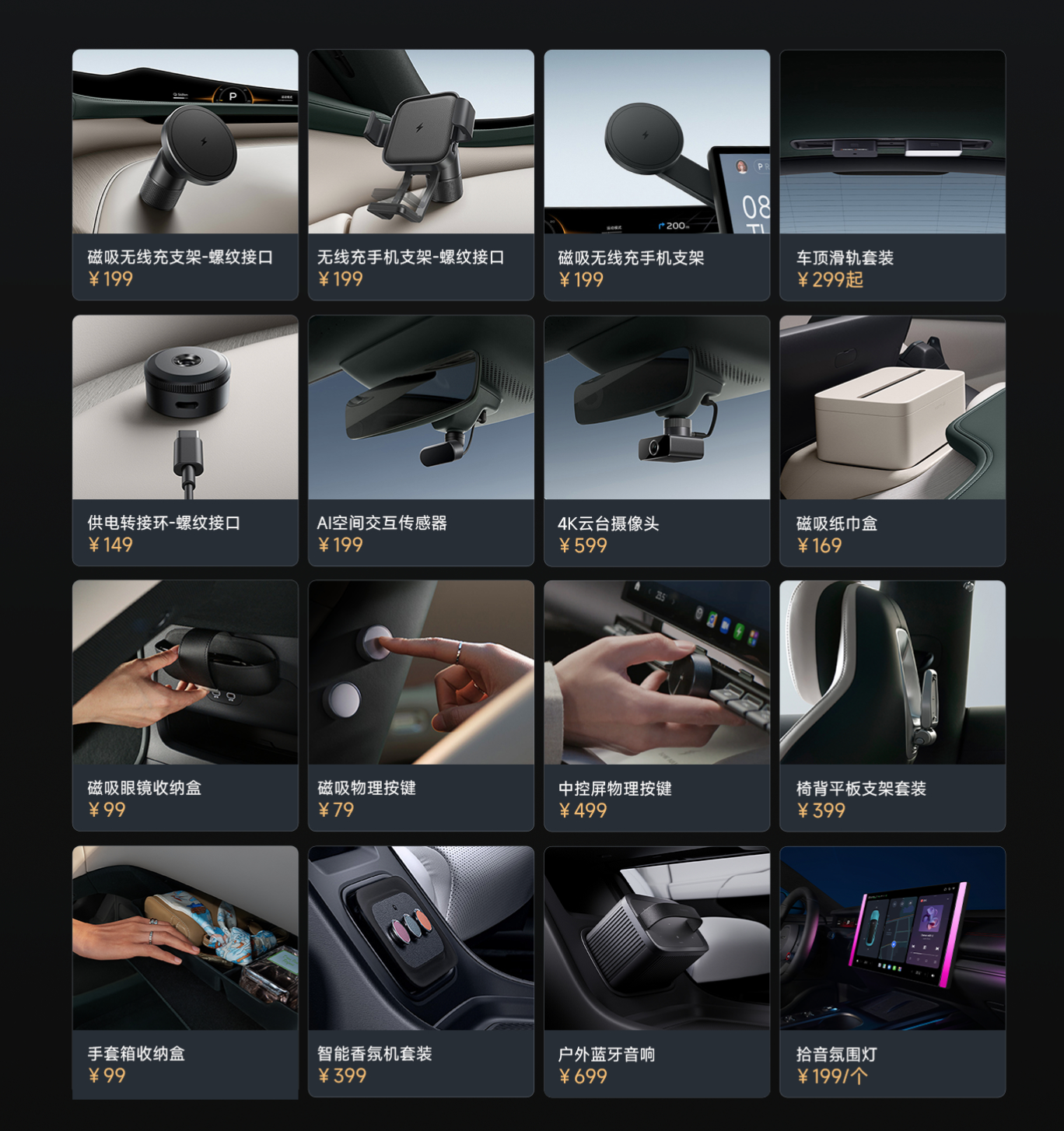

Xiaomi a pleinement exploité sa force de fabricant d'accessoires. Les interfaces filetées des sièges conducteur et passager du YU7 ont été dotées d'une alimentation de 27 watts. Neuf points magnétiques répartis dans la voiture permettent d'ajouter divers accessoires tels que des boîtes à mouchoirs, des étuis à lunettes et des supports de téléphone portable sans fil. La nouvelle caméra 4K à cardan et le capteur d'interaction spatiale IA permettent également aux conducteurs de visualiser l'état de leur véhicule en temps réel et de prendre en charge le contrôle gestuel.

Le Xiaomi YU7 a été entièrement optimisé pour répondre à ses capacités de conduite intelligente auparavant faibles.

Le YU7 utilise la dernière puce Thor de NVIDIA, d'une puissance de calcul de 700 TOPS, et est équipé de série d'un radar laser et d'un radar à ondes millimétriques 4D. Le véhicule a également amélioré sa capacité à percevoir les informations de hauteur. Le système HAD de conduite assistée de bout en bout de Xiaomi utilise actuellement une version de 10 millions de clips (clips désignant des clips de scène utilisés pour l'apprentissage de grands modèles de bout en bout), et le nombre de clips d'apprentissage ultérieurs continue d'augmenter.

Selon le plan, toute la série Xiaomi YU7 sera équipée d'une conduite assistée de bout en bout HAD avec 10 millions de clips, et SU7 Pro, SU7 Max et SU7 Ultra devraient être officiellement mis à niveau fin juillet.

Lei Jun a partagé une fois la direction du développement de Xiaomi au cours des 10 prochaines années dans « Xiaomi Entrepreneurship Thinking » :

– Promouvoir davantage « Internet + Manufacturing » du côté industriel et conduire une révolution de l’efficacité dans l’ensemble de la chaîne de fabrication.

– Promouvoir une expérience technologique axée sur les soins humanistes du côté de l’utilisateur et construire un écosystème technologique qui relie étroitement les personnes et tout ce qui entoure les utilisateurs.

La réussite des modèles SU7 et YU7 de Xiaomi est le fruit de ce développement progressif. Trois minutes seulement après la sortie du YU7, les ventes ont dépassé les 200 000 unités, établissant sans conteste un nouveau record dans l'histoire de l'automobile mondiale.

#Bienvenue pour suivre le compte public officiel WeChat d'iFanr : iFanr (ID WeChat : ifanr), où du contenu plus passionnant vous sera présenté dès que possible.