OpenAI publie le modèle o1 le plus puissant ! En brisant le goulot d’étranglement de l’IA et en ouvrant une nouvelle ère, GPT-5 pourrait ne jamais arriver

Sam Altman, PDG d'OpenAI, a déclaré : « OpenAI o1 est le début d'un nouveau paradigme : une IA capable d'effectuer un raisonnement complexe à usage général. »

Ce nouveau modèle constitue une avancée importante dans les tâches de raisonnement complexes et représente un nouveau niveau de capacités de l’IA. Sur cette base, OpenAI a choisi de renommer cette série OpenAI o1 et de commencer à compter depuis le début.

Je ne sais pas si cela signifie que le nom GPT-5 n’apparaîtra plus.

Un bref résumé des caractéristiques du nouveau modèle :

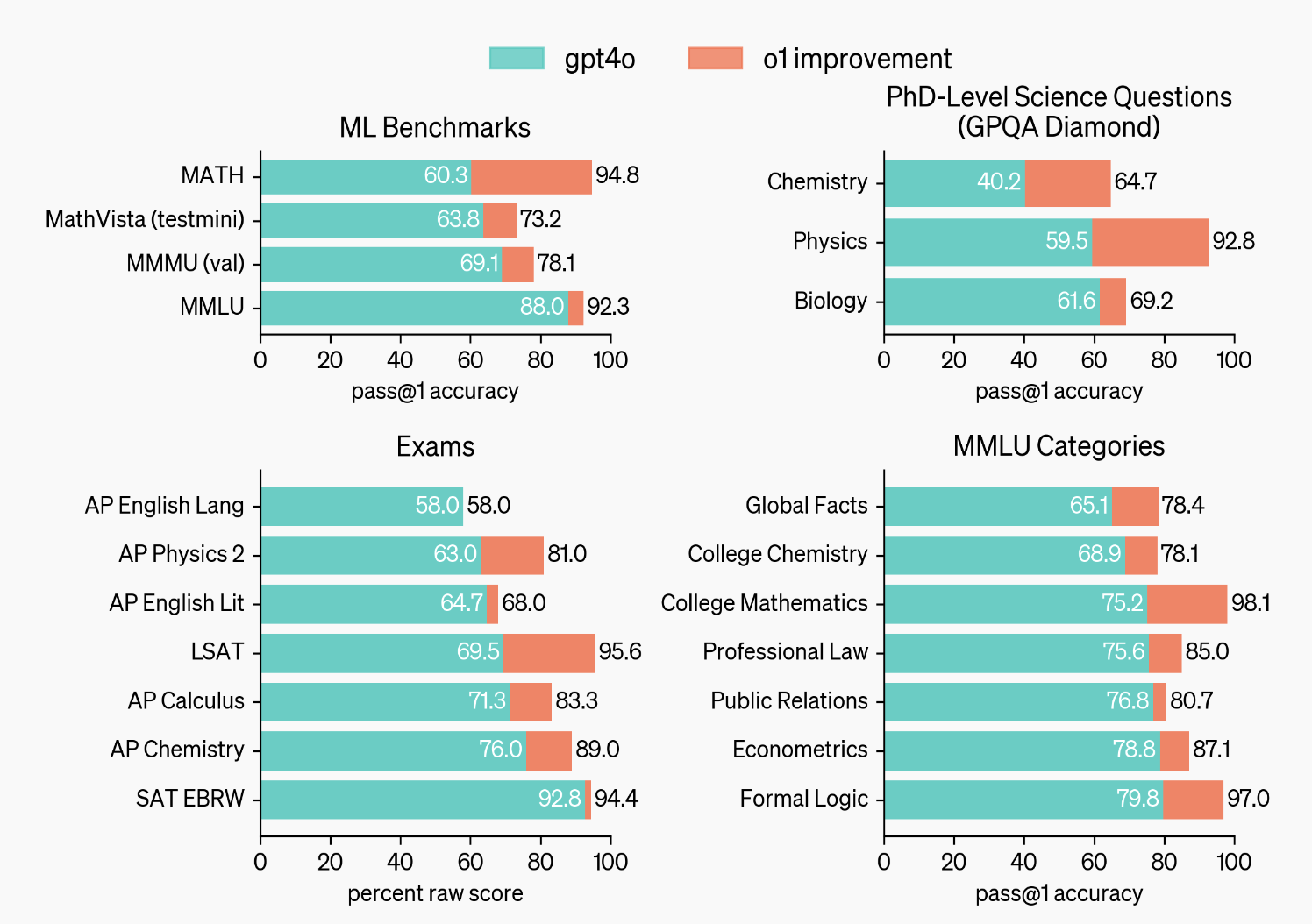

- OpenAI o1 : performances puissantes, adaptées à la gestion de tâches de raisonnement complexes dans divers domaines.

- OpenAI o1 mini : Rentable et adapté aux applications qui nécessitent un raisonnement mais ne nécessitent pas une connaissance approfondie du monde.

Désormais, le modèle a été entièrement poussé et vous pouvez y accéder via le client Web ou l'API ChatGPT.

Parmi eux, o1-preview est toujours une version préliminaire, et OpenAI continuera de mettre à jour et de développer la prochaine version. Il existe actuellement certaines limites d'utilisation, o1-preview a 30 messages par semaine et o1-mini a 50 messages par semaine.

Comme la rumeur « Strawberry », ces nouveaux modèles d'IA sont capables de raisonner sur des tâches complexes et de résoudre des problèmes plus difficiles que jamais dans les domaines des sciences, du codage et des mathématiques. Les responsables affirment que ces capacités de raisonnement améliorées seront particulièrement utiles si vous devez résoudre des problèmes complexes en sciences, en codage, en mathématiques, etc.

Par exemple, les chercheurs en médecine peuvent l'utiliser pour annoter les données de séquençage cellulaire, les physiciens peuvent l'utiliser pour générer des formules d'optique quantique complexes et les développeurs peuvent l'utiliser pour créer et exécuter des flux de travail en plusieurs étapes.

De plus, la série OpenAI o1 excelle dans la génération et le débogage de codes complexes.

Afin de fournir aux développeurs des solutions plus efficaces, OpenAI a également publié un modèle d'inférence plus rapide et moins cher, OpenAI o1-mini, particulièrement efficace en codage.

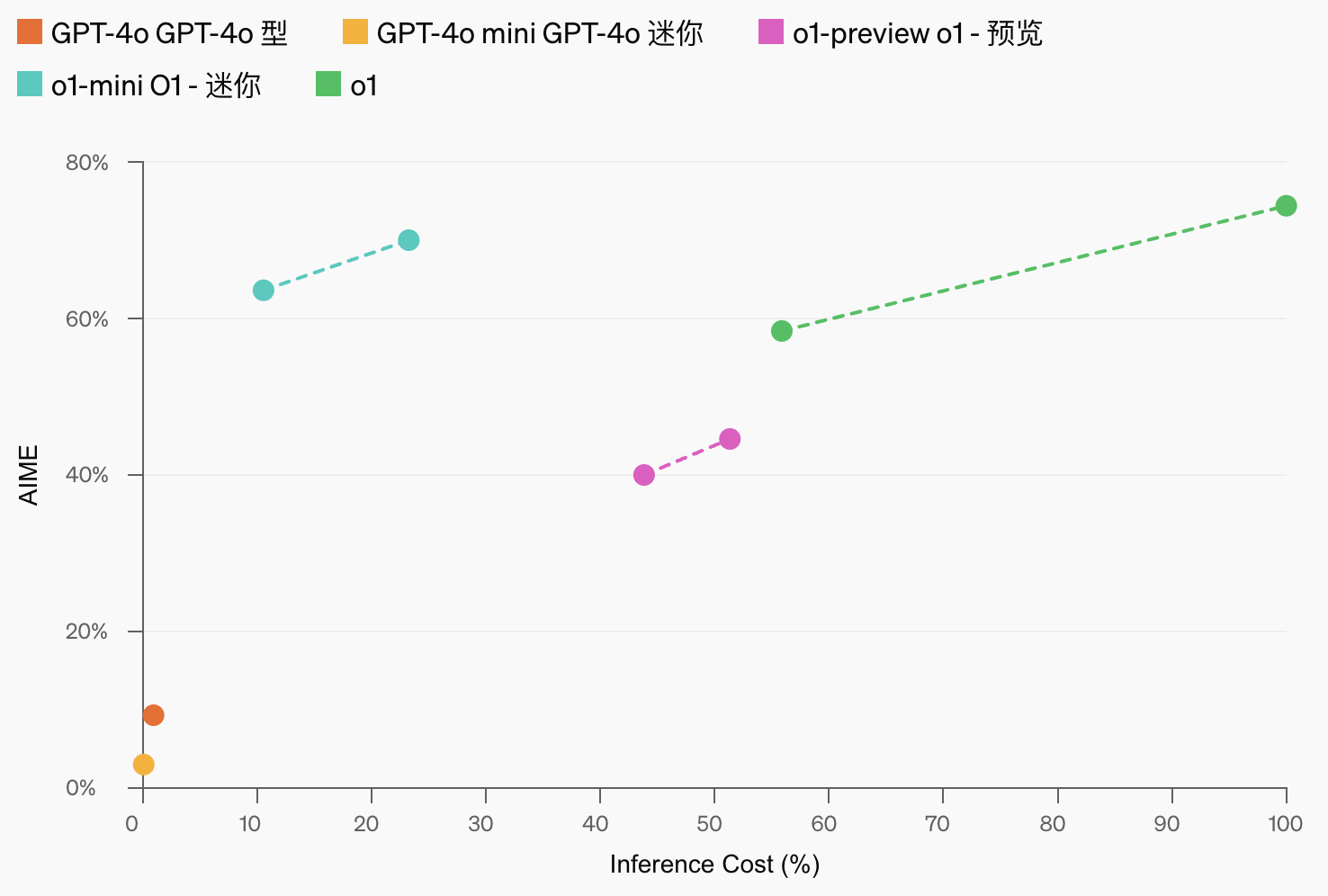

En tant que version plus petite, o1-mini coûte 80 % de moins que o1-preview et constitue un modèle puissant et efficace adapté aux scénarios d'application qui nécessitent un raisonnement mais ne nécessitent pas de connaissances approfondies du monde.

Pendant la formation, OpenAI entraîne ces modèles à réfléchir profondément avant de répondre à une question. o1 génère une chaîne interne de pensées avant de répondre à une question, ce qui lui permet de s'engager dans un raisonnement plus profond.

Grâce à la formation, le modèle OpenAI o1 apprend à perfectionner sa façon de penser, et continue de s'améliorer avec plus d'apprentissage par renforcement (compté dans le temps de formation) et plus de temps pour réfléchir (compté dans le temps de test).

Le chercheur OpenAI @yubai01 a également souligné le parcours de formation de 01 :

Nous utilisons RL pour former un modèle d'inférence plus puissant. Je suis tellement excité de faire partie de ce voyage, et cela va un long chemin !

Selon les rapports, lors des tests, ce modèle s'est comporté comme un doctorant dans des tâches telles que la physique, la chimie et la biologie, notamment dans les domaines des mathématiques et du codage.

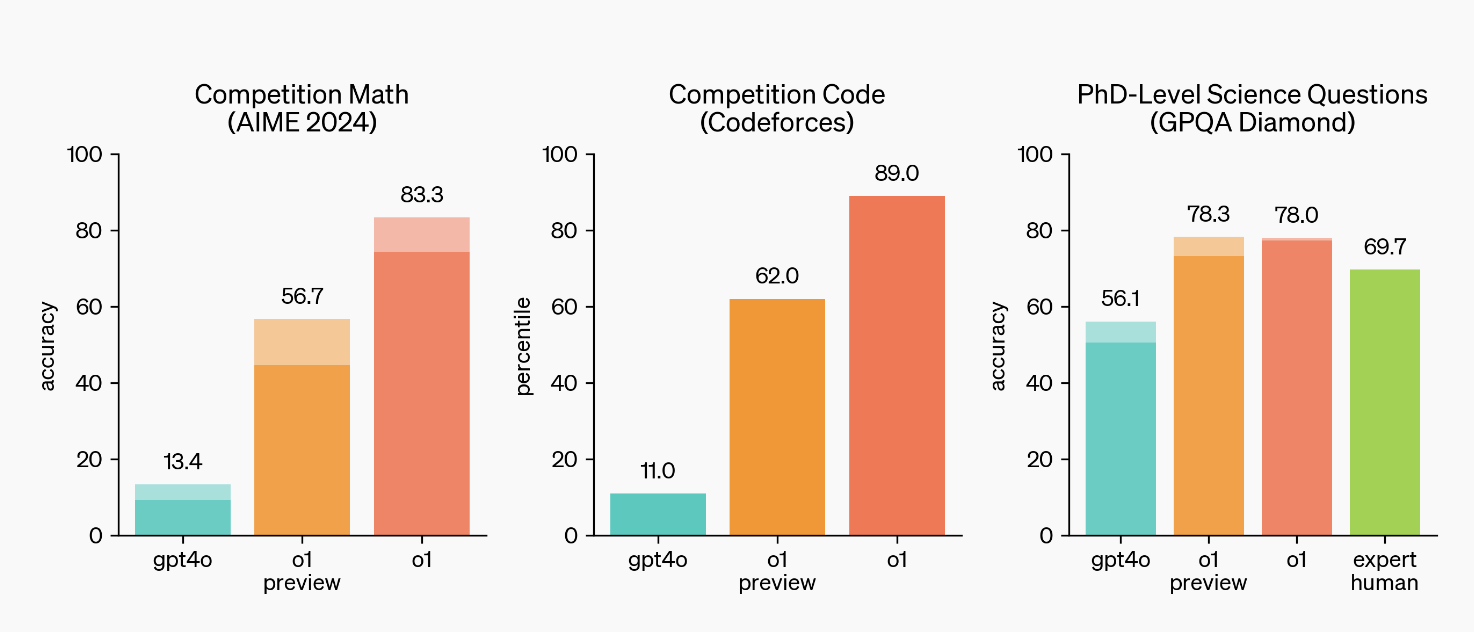

Lors de l'examen de qualification de l'Olympiade mathématique internationale (OMI), GPT-4o n'a résolu que 13 % des problèmes, tandis que le modèle d'inférence a obtenu un score allant jusqu'à 83 %. Lors du concours de programmation Codeforces, ses performances se sont classées parmi les 89 % meilleures de la cohorte.

Cependant, comme les rumeurs l'ont révélé, en tant que première version, ce modèle ne possède pas encore certaines fonctions communes de ChatGPT, telles que les capacités multimodales telles que la navigation sur le Web et le téléchargement de fichiers ou d'images.

En revanche, GPT-4o est plus capable de répondre à de nombreux scénarios d’application courants.

Pour assurer la sécurité des nouveaux modèles, OpenAI propose une nouvelle méthode de formation sécurisée.

Dans le test de « jailbreak » le plus strict, GPT-4o a obtenu un score de 22 (sur 100), tandis que le modèle o1-preview a obtenu un score de 84, ce qui est loin devant en termes de sécurité.

Les utilisateurs de ChatGPT Enterprise et Edu auront également accès aux deux modèles à partir de la semaine prochaine. Les développeurs éligibles peuvent désormais utiliser les deux modèles via l'API, avec des limites de débit par minute.

Pour souligner ici un point important, OpenAI a déclaré qu'il fournirait à l'avenir l'accès à o1-mini à tous les utilisateurs gratuits de ChatGPT. Cependant, il est fort probable que le nombre de fois soit limité.

Plus de détails sur le nouveau modèle o1 seront partagés avec vous peu de temps après une expérience plus détaillée. Si vous avez des questions intéressantes, veuillez nous en informer dans la zone de message.

Ma capacité de raisonnement est bien en avance, mais je n'arrive toujours pas à dire lequel est le plus grand, 9,11 ou 9,8.

Le responsable a également publié davantage de vidéos de démonstration d'OpenAI o1.

Par exemple, utilisez OpenAI o1 pour écrire un jeu Web de recherche d'écureuils. Le but de ce jeu est de contrôler un koala pour éviter le nombre croissant de fraises et retrouver l'écureuil qui apparaît au bout de 3 secondes.

Différent des jeux classiques traditionnels tels que Snake, la logique de ce type de jeu est relativement complexe et teste la capacité de raisonnement logique d'OpenAI o1.

Ou encore, OpenAI o1 a commencé à résoudre certains problèmes physiques simples grâce au raisonnement.

La démonstration a donné un exemple où une petite fraise était placée dans une tasse ordinaire, la tasse était retournée sur la table, puis la tasse était ramassée et on demandait où serait la fraise et on lui demandait d'expliquer le processus de raisonnement. Cela montre que le modèle est capable de comprendre les changements de position des objets dans différents états physiques.

Lorsqu'il est mis en œuvre dans des applications spécifiques, OpenAI o1 peut également devenir le bras droit du médecin, en aidant par exemple les médecins à organiser et à résumer les informations sur les cas, et même à aider au diagnostic de certaines maladies difficiles et compliquées.

Mario Krenn, un physicien quantique passionné par la combinaison de l'IA et de la science, a également posé une question au modèle o1 d'OpenAI sur l'application d'un opérateur quantique spécifique. En conséquence, OpenAI o1 l'a également facilement compris.

Combien de « r » y a-t-il dans « Strawberry » ? GPT-4o donnera de mauvaises réponses, mais cela ne peut pas déranger OpenAI o1. C'est digne d'éloges.

Cependant, après des tests réels, OpenAI o1 ne peut toujours pas résoudre le problème classique de « Quel est le plus grand, 9.11 ou 9.8 ? », ce qui entraîne une sérieuse déduction de points.

Concernant l'arrivée d'OpenAI o1, Jim Fan, responsable de l'intelligence embarquée chez NVIDIA, a déclaré :

Nous assistons enfin à la généralisation et à la mise en production du paradigme de mise à l’échelle du temps d’inférence. Comme l'a dit Sutton (le parrain de l'apprentissage par renforcement) dans "The Bitter Lessons", il n'existe que deux techniques qui peuvent évoluer sans limite avec le calcul :

Apprenez et recherchez. Il est temps de nous concentrer sur ce dernier.

Selon lui, de nombreux paramètres dans les grands modèles sont utilisés pour mémoriser des faits, ce qui est en effet utile pour « améliorer les scores » dans le test de référence des questions et réponses. Toutefois, si la capacité de raisonnement logique est séparée de la connaissance (mémoire des faits), l'utilisation d'un modèle est utilisée. small Le « noyau d'inférence » est utilisé pour appeler des outils tels que des navigateurs et des vérificateurs de code, ce qui peut réduire la quantité de calculs préalables à la formation.

Jim Fan a également souligné l'avantage le plus puissant d'OpenAI o1, à savoir que le modèle o1 peut facilement faire partie du volant d'inertie des données.

En termes simples, si le modèle donne la bonne réponse, alors l'ensemble du processus de recherche peut être transformé en un ensemble de données d'entraînement contenant des récompenses positives et négatives. De tels ensembles de données peuvent être utilisés pour former les futures versions du modèle, et à mesure que les données de formation générées s'affinent, les performances du modèle continueront de s'améliorer. C'est une bonne idée de réaliser la boucle interne de l'entraînement vous-même à travers votre propre jeu.

Cependant, les internautes ont également constaté certains problèmes lors des tests proprement dits. Par exemple, le temps de réponse était beaucoup plus long. Même si la réflexion prenait plus de temps, il y avait également des problèmes tels que des réponses incomplètes aux questions et des résultats incomplets sur certaines questions.

Cyber Zen Heart spécule que cette fois, o1 pourrait être l'agent de GPT-4o après quelques ajustements/alignements, et les performances globales sont bien inférieures aux attentes.

Sam Altman admet également que l'o1 a encore des défauts, des limites, qu'il est plus impressionnant la première fois que vous l'utilisez, et moins après avoir passé plus de temps à l'utiliser.

Malgré cela, les performances globales du modèle OpenAI o1 sont remarquables.

Désormais, la sortie du modèle OpenAI o1 peut être considérée comme le déclencheur de la guerre des modèles d'IA au second semestre. Si rien d'inattendu ne se produit, les autres sociétés d'IA ne le cacheront pas.

C'est vrai, je cible d'anciens rivaux tels que Anthropic, Meta AI et xAI, ainsi que certains chevaux noirs potentiellement profonds de l'IA.

De plus, depuis la sortie de GPT-4 jusqu'à aujourd'hui, l'importance la plus profonde de chaque version de modèle OpenAI n'est pas la puissance des performances, mais la fourniture d'une référence pour un itinéraire technique, conduisant ainsi les gens à s'enfoncer dans des eaux profondes inconnues.

GPT-4 est comme ça, et OpenAI o1 espère être comme ça.

# Bienvenue pour suivre le compte public officiel WeChat d'aifaner : aifaner (ID WeChat : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo