Utilisez l’IA pour copier votre personnalité en deux heures

Nous vivons une époque où l’IA peut être utilisée pour copier « tout » : de votre voix, votre apparence et votre style d’expression, jusqu’à certaines de vos pensées ou décisions. Désormais, l’IA peut même reproduire votre « personnalité » et le faire avec une grande précision.

Récemment, un nouvel article publié par des chercheurs de l'Université de Stanford et de Google DeepMind montre qu'ils ont utilisé l'IA pour créer une réplique virtuelle « avec des attitudes et des comportements individuels ».

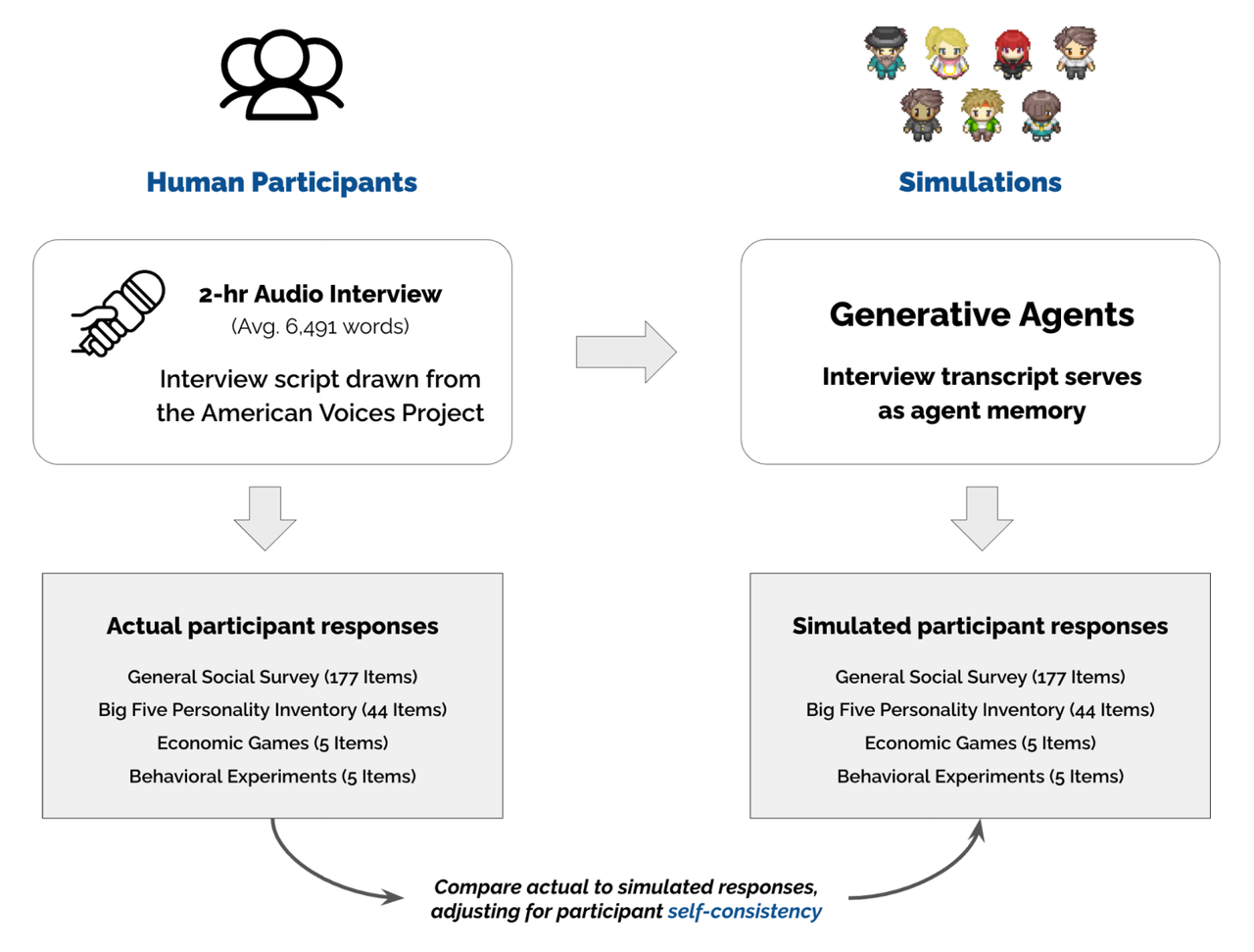

Les chercheurs l'appellent un « agent informatique universel ». Ce qui a servi à former ces « agents » n'était qu'un entretien de deux heures .

▲Source de l'image : arXiv

La recherche a été dirigée par Joon Sung Park, doctorant à l'Université de Stanford. Les chercheurs ont travaillé avec une société de recrutement et ont utilisé un échantillonnage stratifié pour recruter 1 052 participants, chacun d’entre eux ayant passé un entretien audio de deux heures en anglais.

Les chercheurs ont choisi un protocole d'entretien développé par des sociologues qui comprenait des histoires de vie personnelles et des perspectives sur les problèmes sociaux contemporains. Afin de quantifier davantage la quantité de contenu des entretiens et de contrôler les variables expérimentales, les chercheurs ont limité le nombre de mots dans les réponses de chaque sujet à environ 6 491 mots.

Il convient de mentionner que l'intervieweur dans l'interview est également joué par l'IA. Dans le cadre général et les limites de temps de la conversation, ces « enquêteurs d'intelligence artificielle » généreront dynamiquement des questions de suivi basées sur les réponses de chaque participant.

Ces réponses sont ensuite utilisées pour former le modèle d’IA génératif de chaque individu, un « agent simulé ».

Pour vérifier la capacité de ces « agents » à imiter des personnalités humaines, les participants et les agents d'IA ont été invités à passer une série de tests, dont un test de personnalité, une enquête sociale générale, cinq expériences de sciences sociales, cinq jeux d'économie comportementale bien connus. , et plus encore.

Parmi eux, cinq expériences en sciences sociales constituent un critère couramment utilisé pour évaluer si les agents générateurs peuvent simuler les réponses comportementales des participants humains publiés dans les Actes de l'Académie nationale des sciences, cinq jeux d'économie comportementale bien connus incluent Dictator Game, Prisoner's Dilemma, etc.

Deux semaines plus tard, les participants doivent « raconter » les réponses au test ci-dessus et utiliser le contenu du récit pour comparer et analyser les réponses générées par « l'agent ». Les résultats ont montré que l'agent d'IA était capable de simuler les réponses des participants avec une précision de 85 %, tout en prédisant bien les traits de personnalité et les résultats dans cinq expériences de sciences sociales .

▲Source photo : Association de la jeunesse de Hong Kong

Bien que la « personnalité » d’une personne semble impossible à quantifier, cette étude montre que l’intelligence artificielle est effectivement efficace pour « voir le grand du petit » : elle peut déduire et cloner avec précision la « personnalité » d’une personne grâce à une quantité relativement petite d’informations.

Les avantages et les inconvénients de cette « agence » sont assez évidents. L’avantage est qu’il offre aux chercheurs en sciences sociales plus de liberté dans leurs recherches.

En créant des répliques numériques qui se comportent comme de vrais individus, les scientifiques peuvent directement utiliser des « agents » pour mener des expériences ou des enquêtes sans avoir à recruter à chaque fois un grand nombre de volontaires. En outre, ces « agents » peuvent également être utilisés pour mener des expériences « controversées » sur l’éthique morale.

John Horton, professeur agrégé de technologies de l'information à la Sloan School of Management du MIT, a déclaré dans une interview que la recherche « utilise de vrais humains pour générer des personnages, puis utilise ces personnages de manière programmatique/simulée. je ne peux pas le faire."

▲Source : TechRadar

L’inconvénient est que ce type d’« agent » sera inévitablement utilisé par certaines personnes ayant des arrière-pensées de « falsification d’identité » et finalement de « fraude ».

Ce qui est encore plus inquiétant, c'est que « l'agent » a acquis dans un certain sens des pensées et une « conscience » humaines, et peut même exprimer des opinions en son nom. Le Dr Park Juncheng prédit qu'un jour, il y aura un groupe de petites versions de « vous » qui courront partout et prendront réellement les décisions que vous prendriez.

En fait, « agent IA » n’est pas un terme à la pointe de la technologie. Avant cela, il existait un concept similaire de « jumeau numérique ». Cependant, « l’agent » n’a besoin que d’une très petite quantité d’informations pour reproduire fidèlement la « personnalité » d’une personne. C’est ce qui nécessite attention et vigilance.

# Bienvenue pour suivre le compte public officiel WeChat d'Aifaner : Aifaner (ID WeChat : ifanr). Un contenu plus passionnant vous sera fourni dès que possible.

Ai Faner | Lien original · Voir les commentaires · Sina Weibo