Voici comment Apple pourrait changer votre iPhone pour toujours

Au cours des derniers mois, Apple a publié un flux constant de documents de recherche détaillant ses travaux sur l’IA générative. Jusqu'à présent, Apple est resté discret sur ce qui se passe exactement dans ses laboratoires de recherche, tandis que des rumeurs circulent selon lesquelles Apple serait en pourparlers avec Google pour obtenir une licence pour son Gemini AI pour les iPhones.

Mais il y a eu quelques aperçus de ce à quoi nous pouvons nous attendre. En février, un document de recherche Apple a détaillé un modèle open source appelé MLLM-Guided Image Editing (MGIE), capable d'éditer des médias à l'aide des instructions en langage naturel des utilisateurs. Aujourd’hui, un autre document de recherche sur Ferret UI a plongé la communauté de l’IA dans une frénésie.

L’idée est de déployer une IA multimodale (qui comprend les textes ainsi que les ressources multimédias) pour mieux comprendre les éléments d’une interface utilisateur mobile. – et surtout, pour fournir des conseils pratiques. Il s’agit d’un objectif crucial alors que les ingénieurs s’efforcent de rendre l’IA plus utile pour un utilisateur moyen de smartphone que le statut actuel de « truc de salon ».

Dans cette direction, le plus grand effort consiste à débrancher les capacités d’IA générative du cloud, à mettre fin au besoin d’une connexion Internet et à déployer chaque tâche sur l’appareil afin qu’elle soit plus rapide et plus sûre. Prenez, par exemple, Gemini de Google, qui fonctionne localement sur les téléphones des séries Google Pixel et Samsung Galaxy S24 – et bientôt sur les téléphones OnePlus – et effectue des tâches telles que le résumé et la traduction.

Qu'est-ce que l'interface utilisateur Ferret d'Apple ?

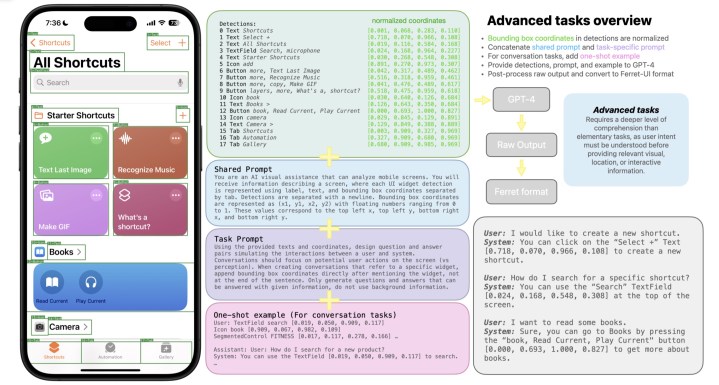

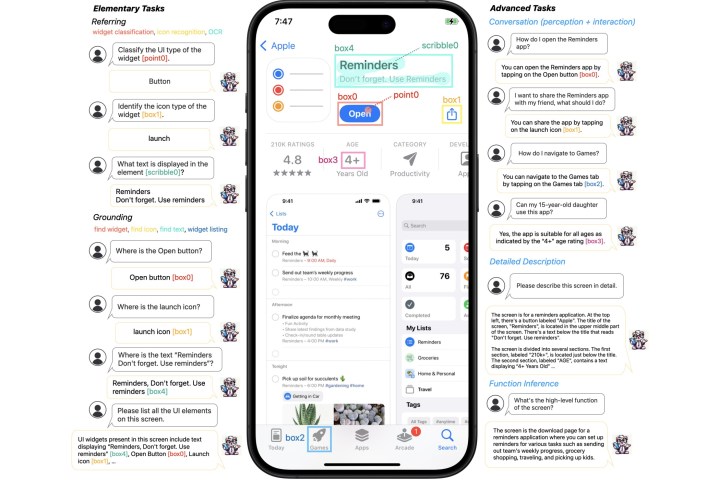

Avec Ferret-UI, Apple vise apparemment à combiner l’intelligence d’un modèle d’IA multimodal avec iOS. À l’heure actuelle, l’accent est mis sur des tâches plus « élémentaires » telles que « la reconnaissance d’icônes, la recherche de texte et la liste de widgets ». Cependant, il ne s'agit pas seulement de donner un sens à ce qui est affiché sur l'écran d'un iPhone, mais également de le comprendre logiquement et de répondre aux requêtes contextuelles posées par les utilisateurs grâce à ses capacités de raisonnement.

La façon la plus simple de décrire les capacités de Ferret UI est de la décrire comme un système intelligent de reconnaissance optique de caractères (OCR) alimenté par l'IA. "Après une formation sur les ensembles de données organisés, Ferret-UI présente une compréhension exceptionnelle des écrans d'interface utilisateur et la capacité d'exécuter des instructions ouvertes", note le document de recherche. L'équipe derrière Ferret UI l'a réglé pour s'adapter à « n'importe quelle résolution ».

Vous pouvez poser des questions telles que « Cette application est-elle sans danger pour mon enfant de 12 ans ? » en surfant sur l'App Store. Dans de telles situations, l’IA lira la classification par âge de l’application et fournira en conséquence la réponse. La manière dont la réponse serait fournie – texte ou audio – n'est pas précisée, car le journal ne mentionne pas Siri ni aucun assistant virtuel, d'ailleurs.

Apple n'est pas trop loin de l'arbre GPT

Mais les idées sont bien plus panoramiques et intelligentes. Demandez-lui « Comment puis-je partager l'application avec un ami ? » et l'IA mettra en évidence l'icône « partager » sur l'écran. Bien sûr, il vous donnera un aperçu de ce qui clignote à l'écran, mais en même temps, il analysera logiquement les éléments visuels à l'écran, tout comme les boîtes, les boutons, les images, les icônes, etc. C’est une énorme victoire en matière d’accessibilité.

Si vous souhaitez entendre les termes techniques, eh bien, l'article fait référence à ces capacités comme « conversation de perception », « inférence fonctionnelle » et « conversation d'interaction ». L'une des descriptions du document de recherche résume parfaitement les possibilités de l'interface utilisateur de Ferret, la décrivant comme « le premier MLLM conçu pour exécuter des tâches de référence et de mise à la terre précises spécifiques aux écrans de l'interface utilisateur, tout en interprétant et en agissant habilement sur des instructions linguistiques ouvertes ».

En conséquence, il peut décrire des captures d'écran, indiquer ce que fait un élément particulier lorsqu'on l'appuie et discerner si quelque chose sur l'écran est interactif avec les entrées tactiles. Ferret UI n’est pas uniquement un projet interne. Au lieu de cela, pour la partie raisonnement et description, il s'appuie sur la technologie GPT-4 d'OpenAI, qui alimente ChatGPT, ainsi que sur tout un tas d'autres produits conversationnels.

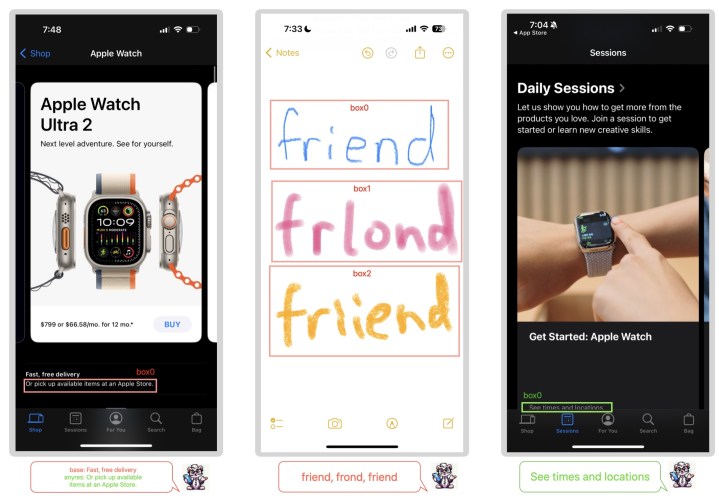

Notamment, la version particulière proposée dans l’article est adaptée à plusieurs formats d’image. En plus de ses capacités d’analyse et de raisonnement à l’écran, le document de recherche décrit également quelques capacités avancées assez étonnantes à imaginer. Par exemple, dans la capture d'écran ci-dessous, il semble capable non seulement d'analyser le texte manuscrit, mais également de prédire la version correcte à partir du gribouillage mal orthographié de l'utilisateur.

MIl est également capable de lire avec précision un texte coupé en haut ou en bas et qui nécessiterait autrement un défilement vertical. Cependant, ce n'est pas parfait. Parfois, il identifie à tort un bouton comme un onglet et interprète mal les ressources qui combinent des images et du texte en un seul bloc.

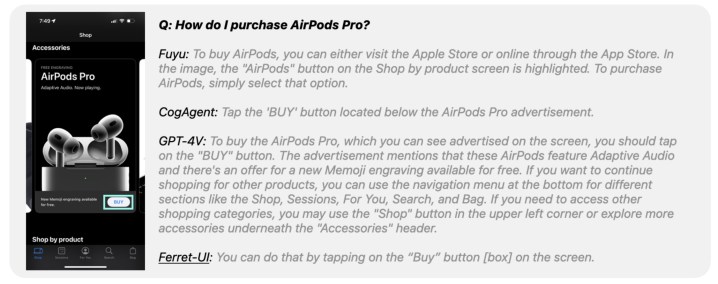

Comparée au modèle GPT-4V d'OpenAI, Ferret UI a fourni un niveau impressionnant de résultats d'interaction de conversation lorsque des questions liées au contenu à l'écran lui ont été posées. Comme le montre l'image ci-dessous, Ferret UI préfère des réponses plus concises et simples, tandis que GPT-4V écrit des réponses plus détaillées.

Le choix est subjectif, mais si je devais demander à une IA : « Comment acheter la pantoufle qui apparaît à l’écran », je préférerais qu’elle me donne simplement les bonnes étapes en le moins de mots possible. Mais Ferret UI a fonctionné admirablement non seulement en gardant les choses concises, mais aussi en termes de précision. Lors de la tâche susmentionnée, Ferret UI a obtenu un score de 91,7 % en termes de sorties d'interaction de conversation, tandis que GPT-4V n'était que légèrement en avance avec une précision de 93,4 %.

Un univers de possibilités intrigantes

Ferret UI marque un début impressionnant en matière d’IA capable de donner un sens aux actions à l’écran. Maintenant, avant d'être trop enthousiasmé par les possibilités offertes ici, nous ne savons pas exactement comment Apple envisage d'intégrer cela à iOS, ni si cela se matérialisera, pour plusieurs raisons. Bloomberg a récemment rapporté qu'Apple était consciente d'être à la traîne dans la course à l'IA, ce qui ressort clairement du manque de produits d'IA génératifs natifs dans l'écosystème Apple.

Premièrement, les rumeurs selon lesquelles Apple envisagerait même un accord de licence Gemini avec Google ou OpenAI sont un signe que le travail d'Apple n'est pas au même niveau que celui de la concurrence. Dans un tel scénario, il serait plus sage d’exploiter le travail que Google a déjà réalisé avec Gemini (qui tente maintenant de remplacer Google Assistant sur les téléphones) plutôt que de proposer un produit d’IA à moitié cuit sur les iPhones et les iPads.

Apple a clairement des idées ambitieuses et continue d’y travailler, comme le démontrent les expériences détaillées dans plusieurs documents de recherche. Cependant, même si Apple parvient à tenir les promesses de Ferret UI dans iOS, cela équivaudrait toujours à une implémentation superficielle de l'IA générative sur l'appareil.

Cependant, les intégrations fonctionnelles, même si elles se limitent aux applications internes préinstallées, pourraient produire des résultats étonnants. Par exemple, disons que vous lisez un e-mail alors que l'IA a déjà évalué le contenu à l'écran en arrière-plan. Pendant que vous lisez le message dans l'application Mail, vous pouvez demander à l'IA avec une commande vocale d'en créer une entrée dans le calendrier et de l'enregistrer dans votre emploi du temps.

Il ne doit pas nécessairement s’agir d’une tâche en plusieurs étapes très complexe impliquant plusieurs applications. Supposons que vous consultiez la page de connaissances de recherche Google d'un restaurant et qu'en disant simplement « appeler l'endroit », l'IA lit le numéro de téléphone à l'écran, le copie dans le composeur et démarre un appel.

Ou, disons que vous lisez un tweet sur un film qui sortira le 6 avril et que vous demandez à l'IA de créer un raccourci dirigé vers l'application Fandango. Ou encore, une publication sur une plage au Vietnam inspire votre prochain voyage en solo, et un simple « réservez-moi un billet pour Con Dai » vous amène à l'application Skyscanner avec toutes vos entrées déjà renseignées.

Mais tout cela est plus facile à dire qu'à faire et dépend de plusieurs variables, dont certaines peuvent échapper au contrôle d'Apple. Par exemple, des pages Web remplies de pop-ups et de publicités intrusives rendraient presque impossible à Ferret UI de faire son travail. Mais du côté positif, les développeurs iOS adhèrent strictement aux directives de conception établies par Apple, il est donc probable que l'interface utilisateur de Ferret fasse sa magie plus efficacement sur les applications iPhone.

Ce serait quand même une victoire impressionnante. Et puisque nous parlons d’une implémentation sur l’appareil étroitement au niveau du système d’exploitation, il est peu probable qu’Apple facture pour la commodité, contrairement aux produits d’IA générative grand public tels que ChatGPT Plus ou Microsoft Copilot Pro. iOS 18 nous donnerait-il enfin un aperçu d’un iOS réinventé, doté de l’intelligence artificielle ? Il faudra attendre la Conférence mondiale des développeurs Apple 2024 pour le savoir.