Après avoir utilisé cette suite spirituelle de Google Camera, j’ai l’impression que la photographie sur téléphone portable devrait être comme ça

Il y a six ans, j'ai commencé mon parcours de photographe lorsque j'ai embarqué à bord d'un Airbus 320 d'IndiGo à destination de l'Inde avec mon appareil photo Sony en main.

Aujourd'hui, six ans plus tard, la photographie sur téléphone portable couvre le domaine de l'imagerie traditionnelle à une vitesse extraordinaire, et la gamme de produits du marché des appareils photo converge progressivement vers des outils pratiques dans les domaines professionnels ou des articles de mode.

À cette époque, un autre « Indigo » a retenu mon attention : le projet Indigo d'Adobe, une application d'imagerie complètement différente.

Il apporte l'expérience de photographie informatique acclamée de Google Camera à l'iPhone dans sa forme originale, me permettant d'avoir un aperçu de la puissance de la limite ultime de la photographie informatique.

Une application d'appareil photo à l'épreuve du temps, mais un aperçu

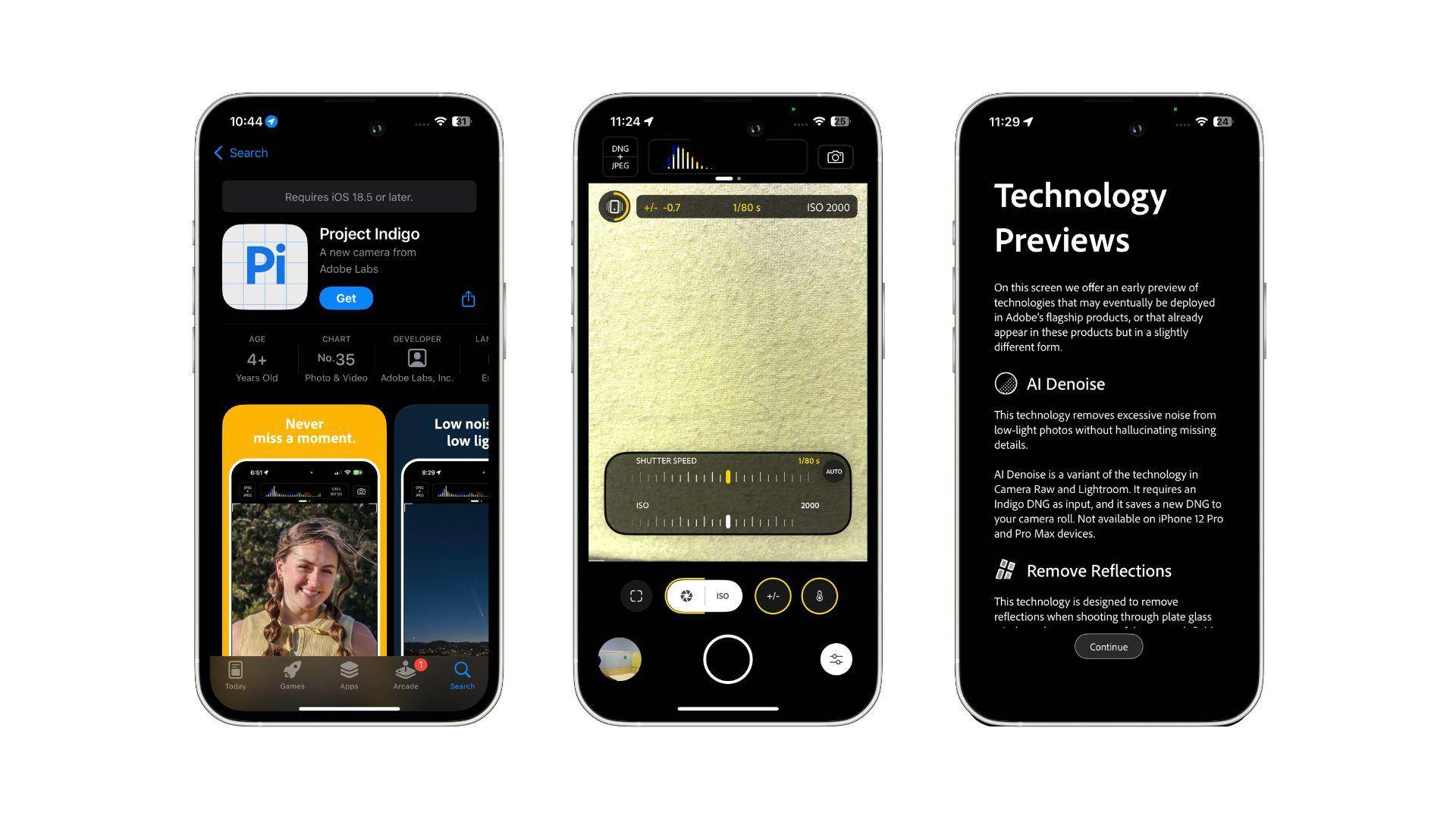

Si vous jetez un coup d’œil rapide, il peut être difficile de réaliser qu’il s’agit d’une application d’imagerie.

L'icône de l'application Project Indigo est dépourvue de tout élément graphique. Elle suit le schéma de conception habituel d'Adobe : les premières lettres des deux mots du nom y sont placées, et l'image de base est une grille de 16 carrés encadrée de lignes bleues.

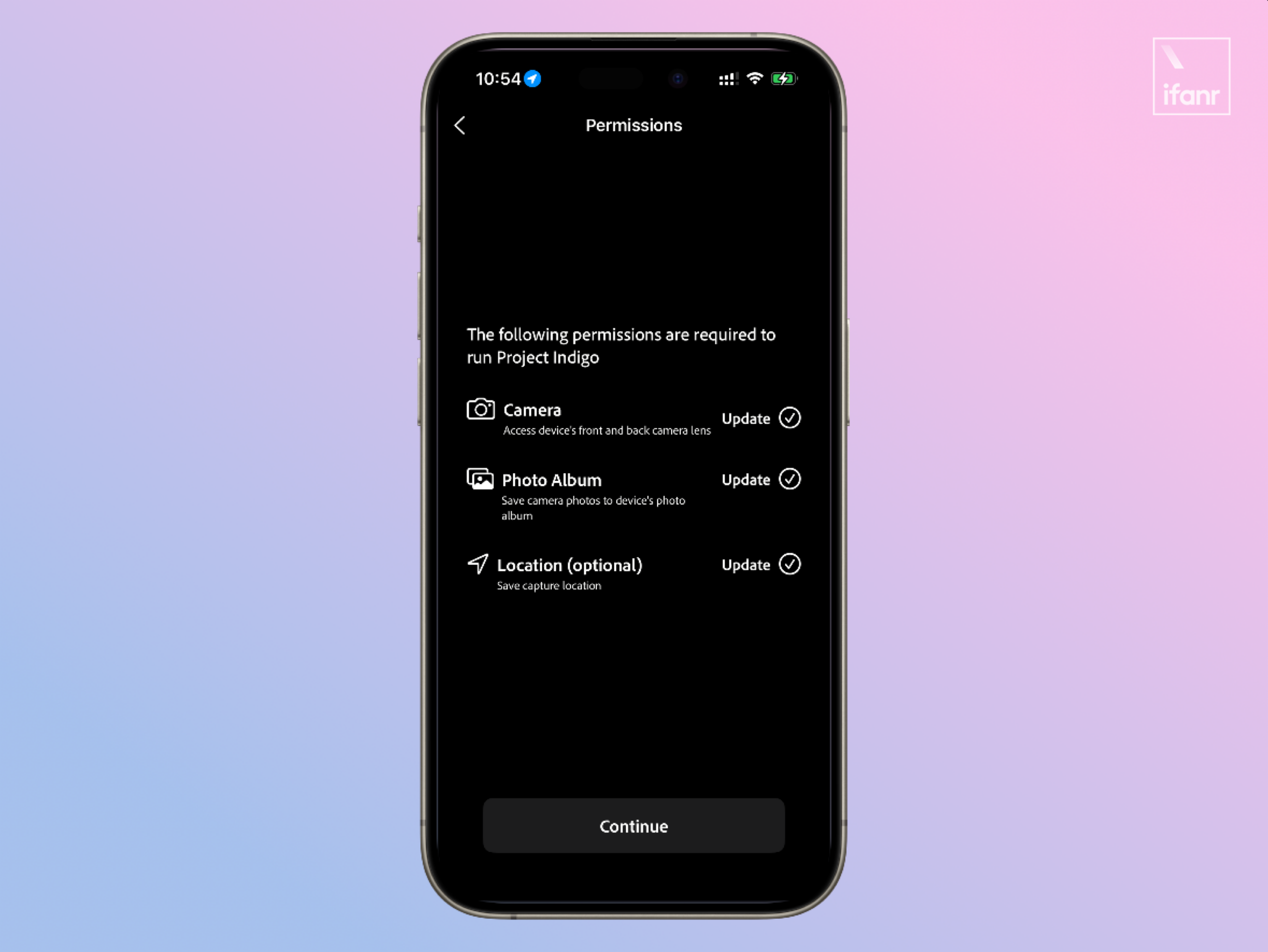

En entrant dans Project Indigo (ci-après dénommé « Indigo »), vous accédez d'abord à l'interface familière de demande d'autorisation. Cette application d'imagerie nécessite trois autorisations :

- Autorisations de contrôle de la caméra

- Autorisations d'accès à l'album

- Autorisations d'accès aux informations de localisation

L'absence de droits d'accès au microphone indique que Project Indigo est une application qui sert entièrement des images statiques, et le tournage vidéo, qui correspond davantage aux tendances Internet, n'est pas son objectif.

Une fois la demande d'autorisation complétée, Indigo vous présentera l'interface principale et les fonctionnalités de cette application d'imagerie. Nous passons rapidement à l'interface principale.

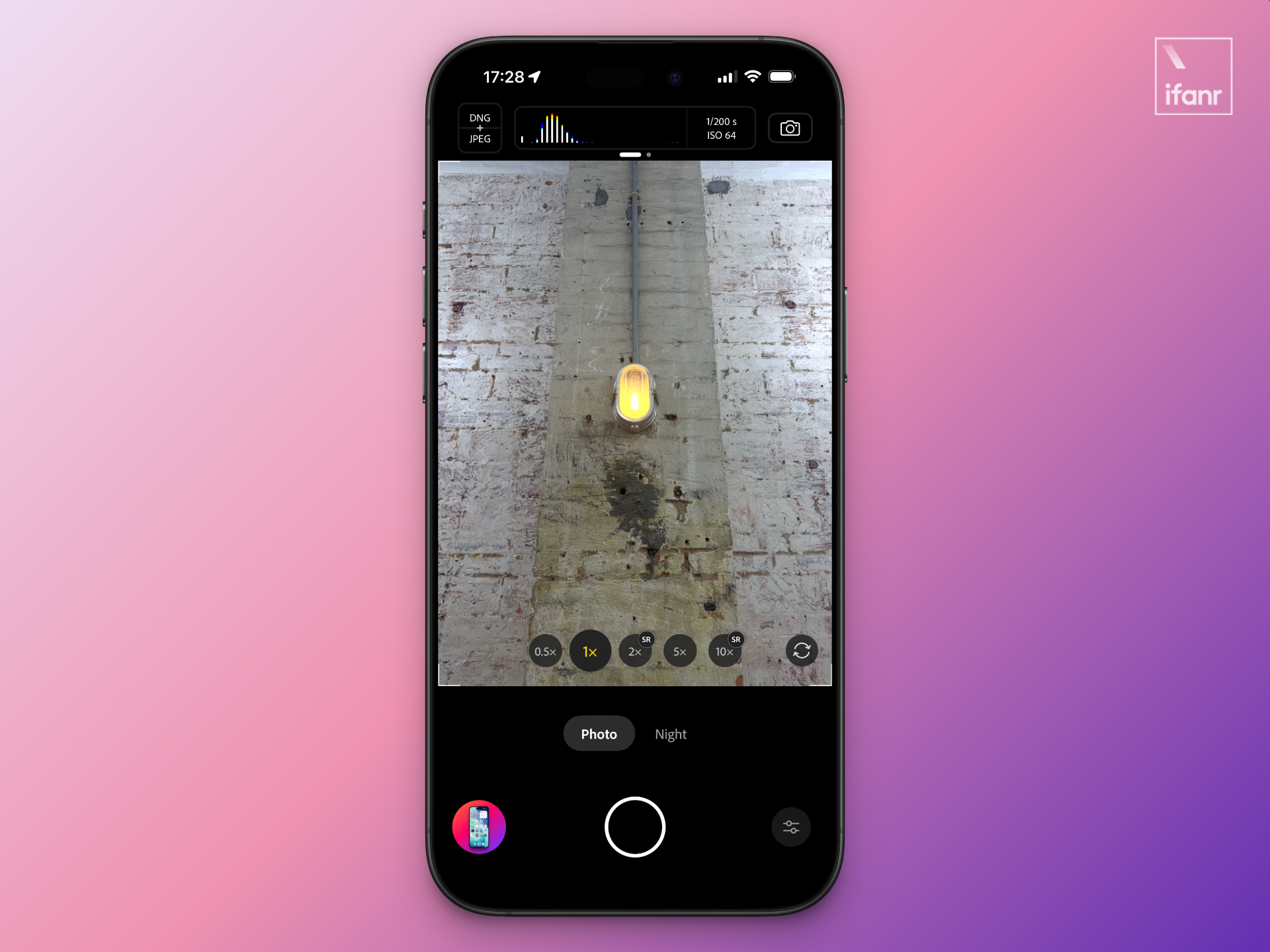

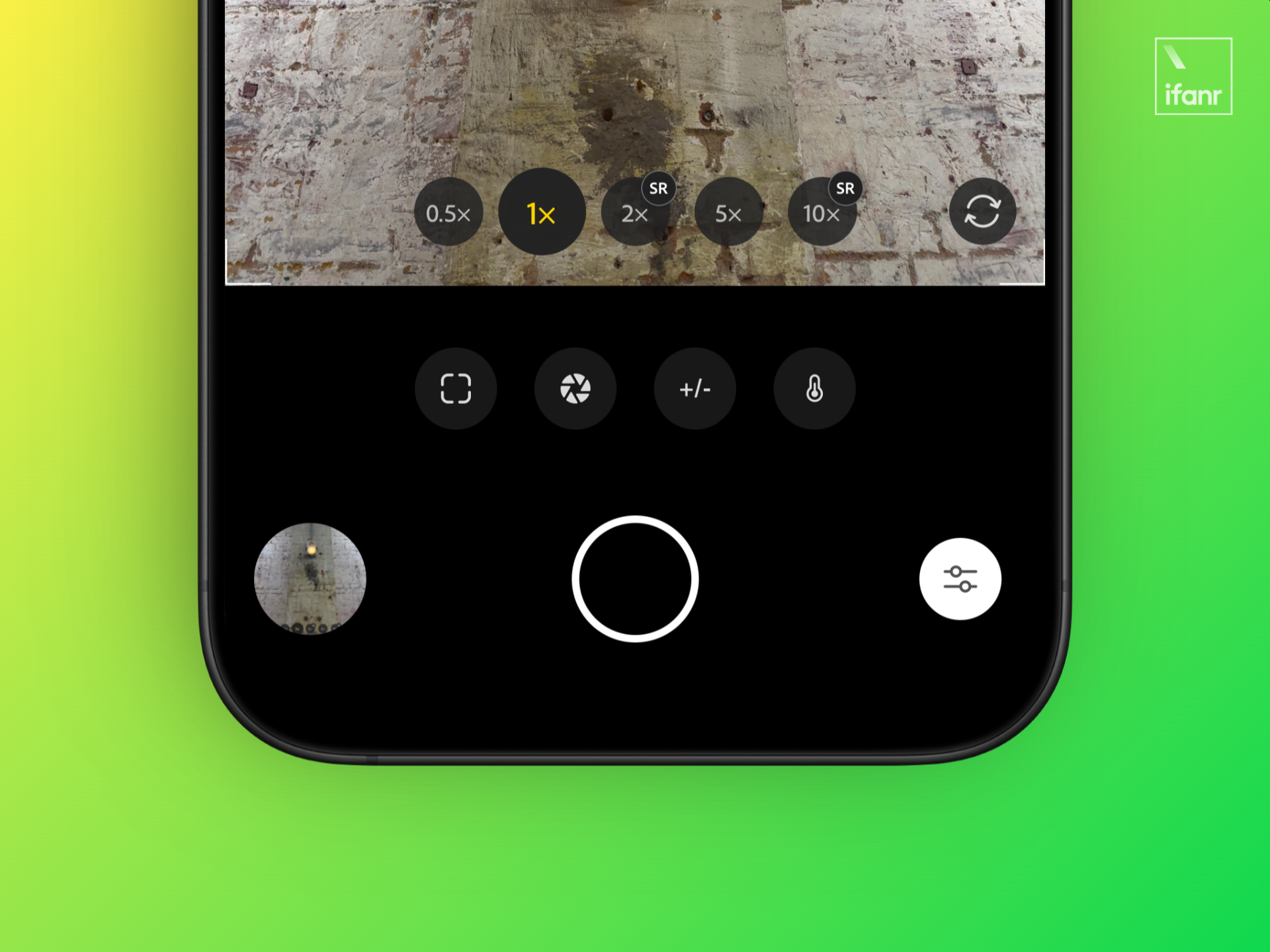

L'interface de prise de vue principale de Project Indigo ne suit pas la conception d'iOS 26, mais fournit autant d'informations et de commandes que possible, permettant aux opérateurs d'avoir un contrôle maximal sur leurs effets photo.

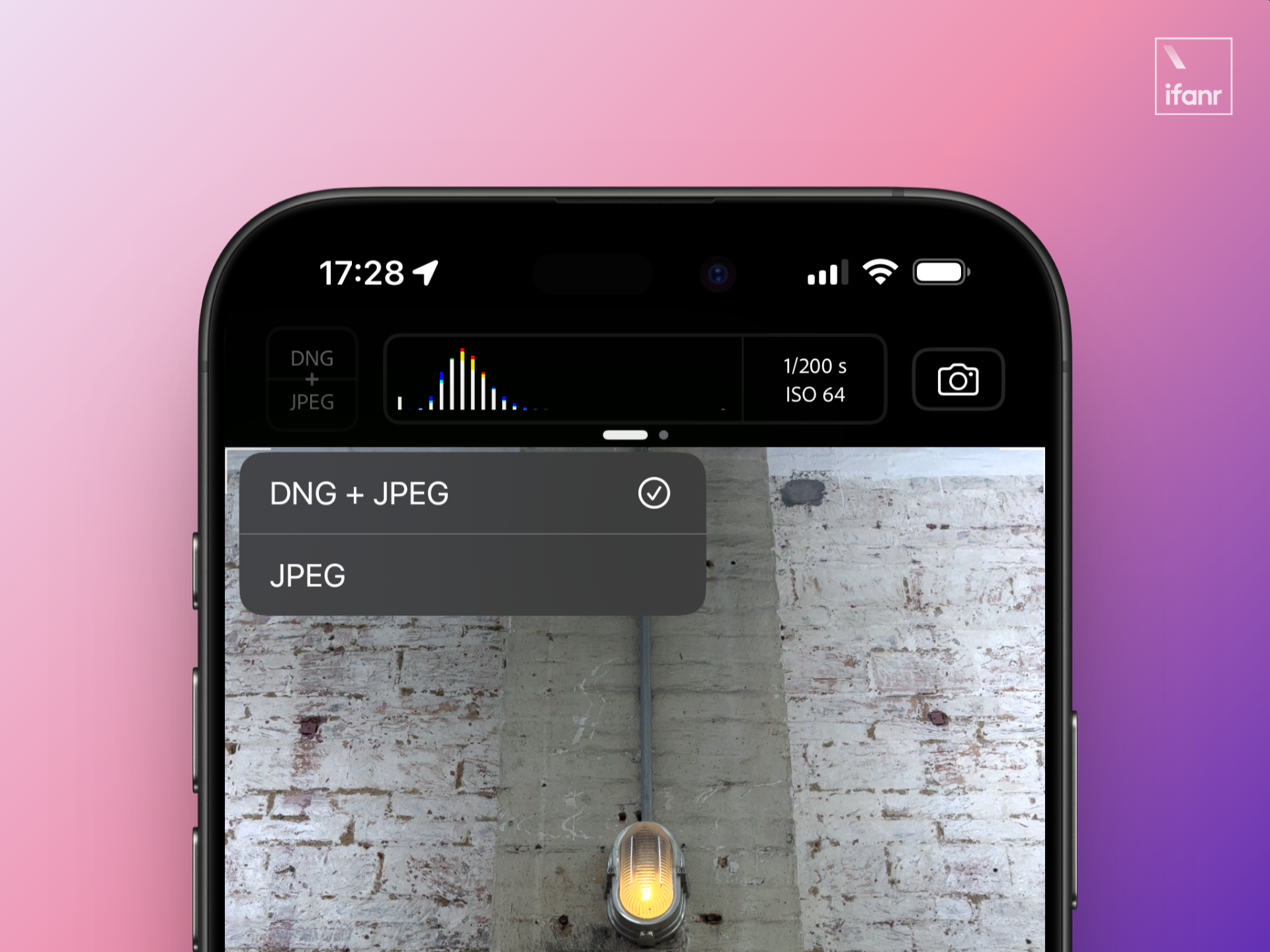

En partant du haut, l'application est divisée en trois parties : le format d'image, l'histogramme et les paramètres d'exposition, ainsi que le mode de prise de vue. Le format d'image vous permet de choisir entre les formats JPEG ou DNG+JPEG.

Le format JPEG est un format de diffusion courant, adapté à la publication directe sur Internet ou sur les réseaux sociaux après la prise de vue, tandis que ce dernier est une photo au format RAW qui enregistre des informations détaillées sur l'image, ce qui peut fournir un énorme espace de post-production et n'est pas adapté à la diffusion directe.

L'histogramme et les paramètres d'exposition, situés en haut au milieu, affichent clairement l'exposition actuelle dans le viseur, ainsi que la combinaison vitesse d'obturation/sensibilité. Vous pouvez également faire glisser cette partie pour accéder au menu secondaire. Ce menu vous permet de contrôler certaines commandes auxiliaires de cadrage et de prise de vue, telles que le compte à rebours, la grille du viseur, le niveau ou l'indicateur de surexposition des hautes lumières. Vous pouvez également accéder à l'ensemble des paramètres de l'application Indigo depuis cet emplacement.

À droite, le mode de prise de vue actuel. Les réglages de l'Indigo sont simples et se divisent en deux modes seulement : photo et scène de nuit.

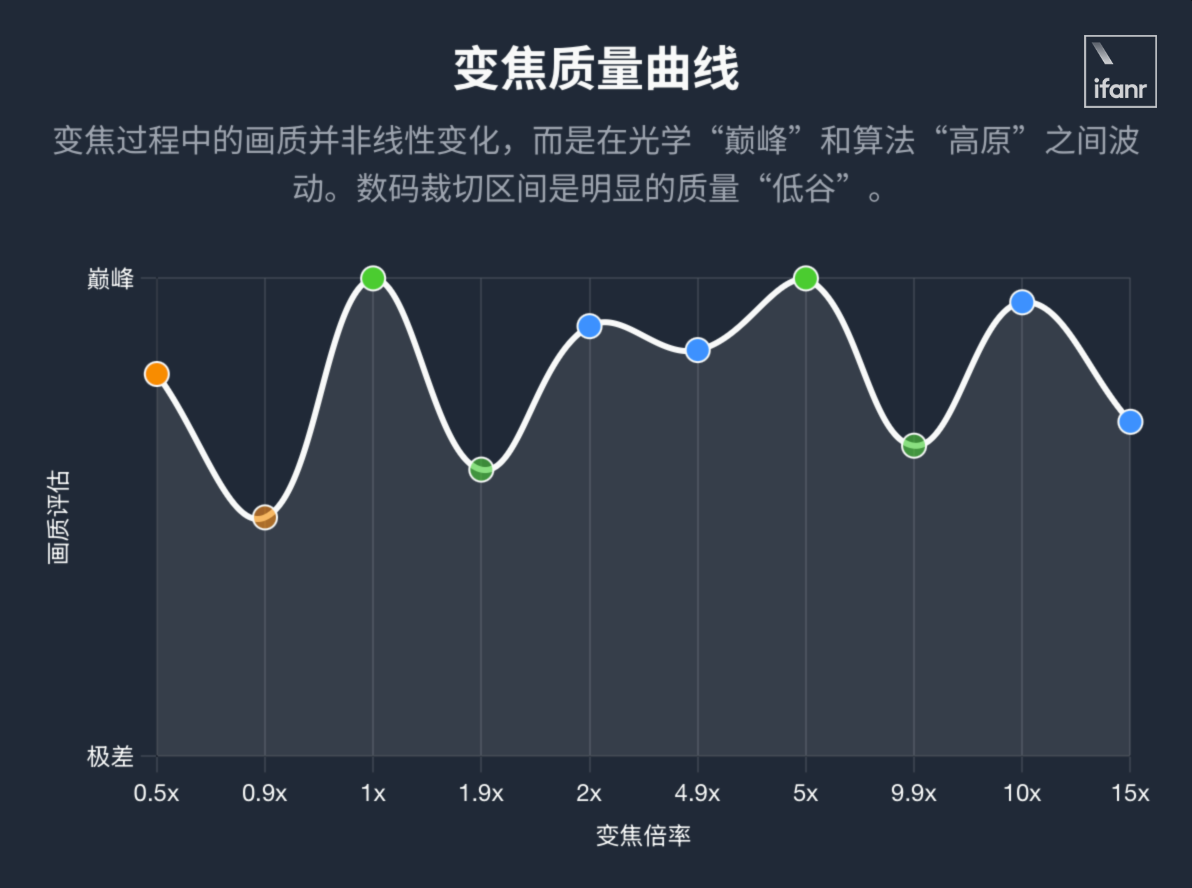

En tournant les yeux vers la moitié inférieure de l'écran, en bas du viseur, se trouve la barre de sélection de la focale habituelle. Prenons l'exemple de mon iPhone 16 Pro : Indigo propose cinq options : 0,5×, 1×, 2×, 5× et 10×.

Il est très visible que le mot SR soit inscrit sur les deux focales 2× et 10×. Le manuel officiel indique que le nom complet de SR est « Multi-frame super-resolution ». Le 2×, basé sur la caméra principale 1×, et le 10×, basé sur la caméra 5×, offrent une clarté comparable à celle des focales optiques grâce à cette technologie.

Comme son nom l'indique, le principe technique derrière la technologie de super-résolution multi-images est qu'après avoir appuyé sur l'obturateur, le téléphone prend instantanément un nombre considérable de photos, puis utilise un certain algorithme pour fusionner des dizaines de photos afin de générer des photos pleines de détails riches et à faible bruit.

▲ C'est très embarrassant, la photo vient de Xiaohongshu @KERICH誠

Lors de tests réels, j'ai constaté que la technologie de super-résolution multi-images fonctionne de 2× à 4,9×, et il en va de même pour 10× et plus.

Autrement dit, dans le projet Indigo, les tâches d'imagerie de chaque distance focale sont encore divisées :

- 0,5×-1× : Recadrage numérique basé sur un objectif ultra grand angle natif ;

- 1×-1,9× : recadrage numérique basé sur l'appareil photo principal natif ;

- 2×-4,9× : Recadrage optique basé sur la technologie de super-résolution multi-images ;

- 5×-9,9× : recadrage numérique basé sur un téléobjectif 5× natif ;

- 10× et plus : recadrage quasi-optique basé sur la technologie de super-résolution multi-images.

Après avoir observé l'éblouissante disposition des focales, nous nous intéressons à la partie inférieure. Les modes photo et scène de nuit sont placés horizontalement entre la focale et le déclencheur. Vous pouvez ainsi passer rapidement d'un mode à l'autre pour s'adapter à différentes scènes de prise de vue. Cependant, le sélecteur de mode en haut à droite présente une redondance, ce qui semble un peu encombrer l'interface utilisateur.

Plus bas se trouve le bouton principal de l'obturateur. À gauche se trouve l'album où les photos seront placées pour une fusion ultérieure. Vous pouvez voir ici plusieurs photos fusionnées en arrière-plan. Vous pouvez également accéder à Lightroom à partir de là pour approfondir vos retouches.

Le côté droit est le mode manuel plus professionnel, où vous pouvez personnaliser les paramètres qui affectent directement l'image finale, tels que la température de couleur, la distance de mise au point, la vitesse d'obturation et la sensibilité.

Après avoir lu la mise en page, j'étais très curieux de connaître les performances réelles de prise de vue du projet Indigo et de voir quelle compréhension différente cette ancienne société axée sur le domaine de l'imagerie a de l'imagerie mobile.

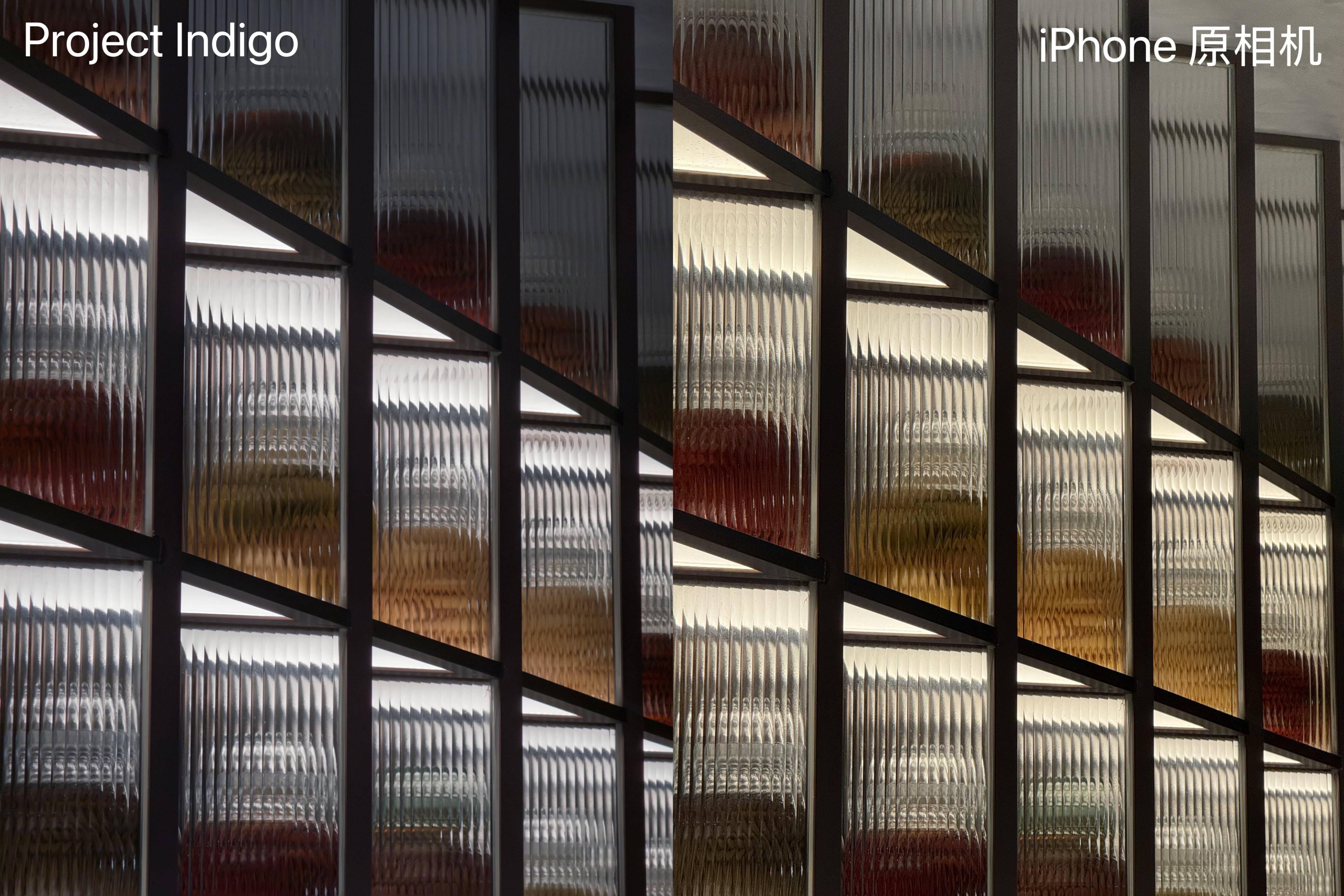

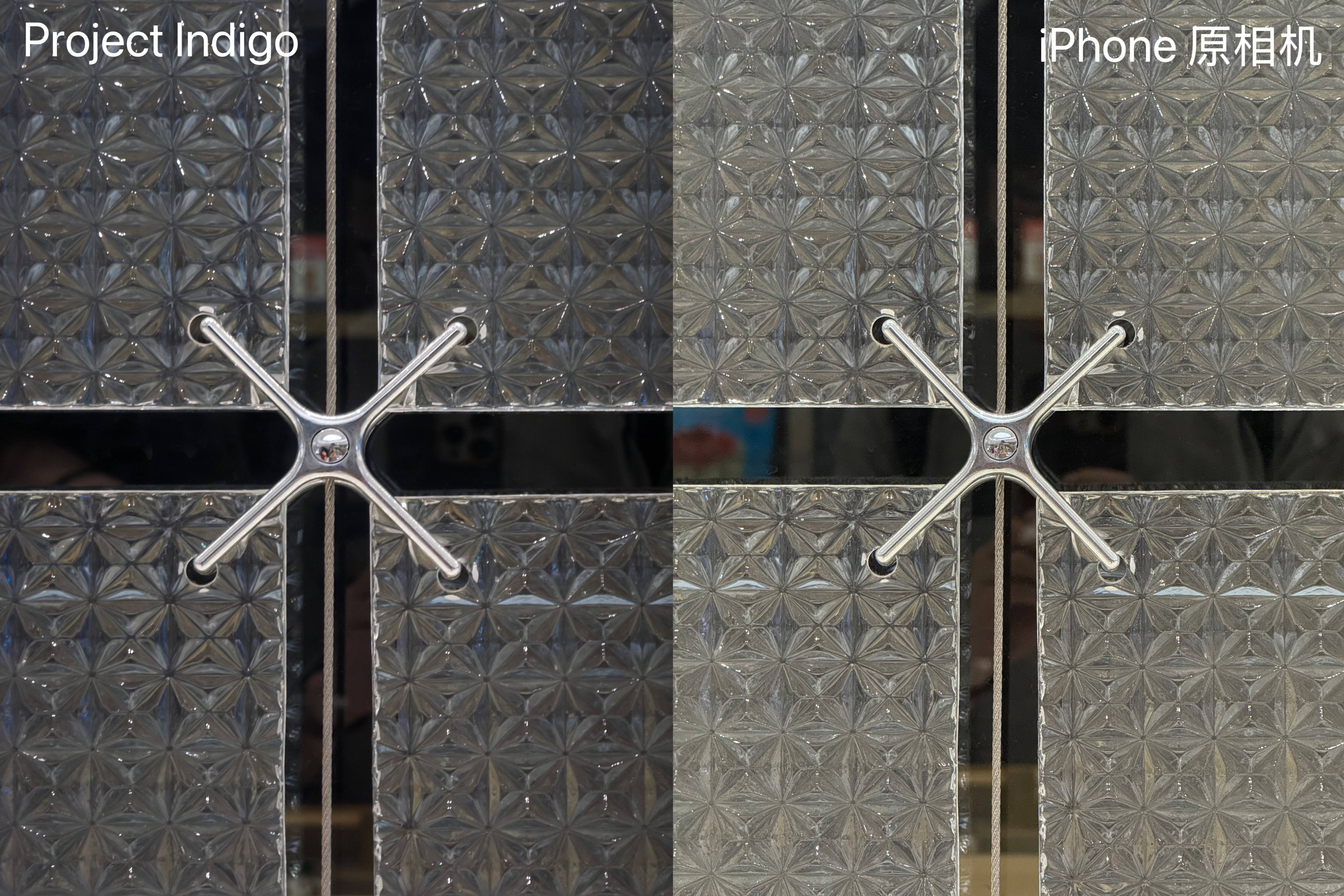

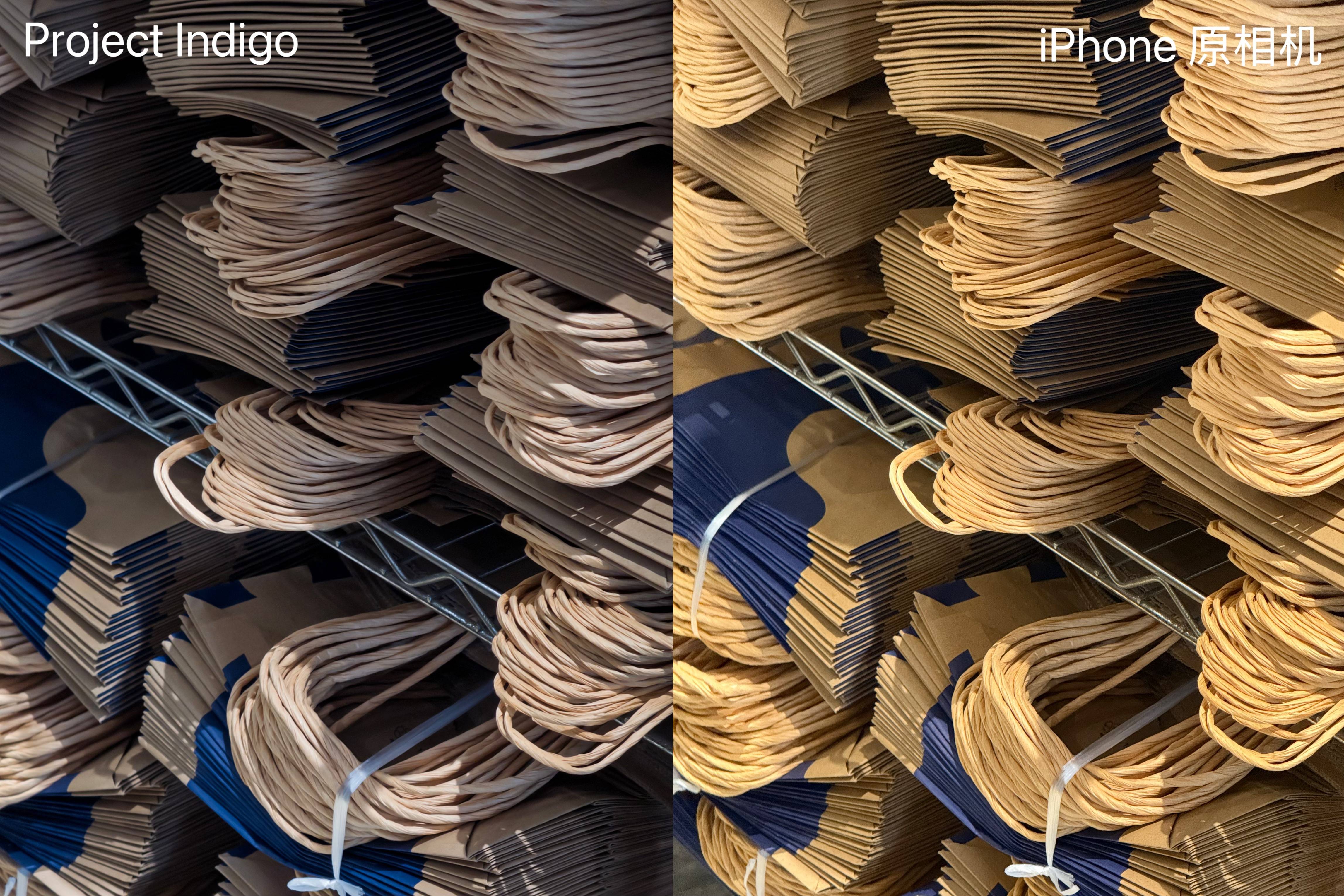

Permettez-moi d'abord de conclure. Project Indigo se distingue radicalement de l'appareil photo natif de l'iPhone sur deux points principaux. Basé sur le même matériel, l'effet d'image de Project Indigo est plus attrayant, et la transition entre la lumière et l'obscurité est plus fidèle à ce que l'on voit à l'œil nu, sans la sensation de luminosité excessive de l'iPhone.

À en juger par l'histogramme, les pixels du projet Indigo sont plus concentrés dans la moitié gauche et l'imagerie a tendance à être plus sombre, ce qui est plus conforme à la zone de confort de l'œil humain, plus stimulant la résonance émotionnelle humaine et plus conforme aux habitudes d'expression artistique profondes.

Un autre avantage est que l'imagerie du Projet Indigo présente moins de netteté et de fragmentation, mais grâce à la synthèse d'un nombre considérable d'images multiples, la netteté n'est pas excessivement atténuée. Après un zoom avant, les contours des objets et du texte de l'image restent relativement nets, préservant ainsi une certaine lisibilité.

Tout en rendant la transition lumière-ombre plus naturelle et en résolvant le problème des bords nets, Project Indigo dispose également d'une optimisation qui n'est pas facile à remarquer : l'image originale de l'appareil photo de l'iPhone peut facilement montrer un bruit subtil et dense après un zoom avant, mais Project Indigo gère très bien ce bruit de fond, et l'image peut toujours rester pure lors d'un zoom avant.

Dans l’ensemble, Project Indigo excelle en termes de détails d’image, de netteté, de suppression du bruit et de performances des couleurs, montrant une tendance esthétique plus naturelle et harmonieuse, et reproduisant plus fidèlement ce que l’œil nu voit.

On peut dire que le lancement du Projet Indigo a résolu tous les problèmes actuellement critiqués par l'iPhone, comme une netteté excessive, une courbe de luminosité peu naturelle et des détails d'image chargés de bruit de fond. Il a même élargi les limites de la focale de l'iPhone, mais je ne vous recommande pas de l'essayer immédiatement.

La raison est que cette application présente encore de nombreux problèmes : par exemple, des bordures noires apparaissent parfois en bas des photos, et les photos prises deviennent violacées une fois modifiées dans l'album. De plus, la chaleur générée et la consommation d'énergie pendant la prise de vue sont nettement supérieures à celles de l'appareil photo natif du système.

Selon les commentaires des développeurs du projet Indigo sur les réseaux sociaux, les problèmes de bordure noire et de dominante de couleur sont principalement dus à l'adaptation incomplète du système, qui est un bug typique de la phase bêta ;

Les raisons de cette surchauffe et de cette consommation d'énergie sont plus profondes. Indigo utilise un pipeline de traitement d'images totalement différent de celui de l'iPhone ; il ne peut donc pas appeler le fournisseur d'accès Internet natif d'Apple. Tous les calculs multi-images et les tâches de fusion d'images reposent presque directement sur le processeur, ce qui entraîne naturellement une charge matérielle plus élevée.

En fait, Adobe vous a déjà rappelé tout cela avant d'ouvrir le logiciel – vous vous souvenez de l'icône avec un fond blanc et un wireframe bleu ?

Cette conception, qui ressemble à un plan d'ingénierie, indique directement que le projet Indigo se concentre toujours sur les algorithmes et les cadres de photographie informatique sous-jacents, et qu'il s'agit d'une expérience axée sur la technologie plutôt que d'un produit fini entièrement fonctionnel adapté à la distribution.

Dans le même temps, l'origine du projet Indigo détermine également que son expérience utilisateur n'est certainement pas assez bonne – il s'agit d'un projet lancé par l'équipe Nextcam dans le cadre d'Adobe Labs, qui est le champ de test et l'incubateur d'Adobe pour les technologies futures, se concentrant sur la formulation de questions et la vérification des idées plutôt que sur la fourniture de points finaux.

▲ La plupart des applications ici sont incubées dans Adobe Labs

L'origine et l'avenir de la photographie computationnelle

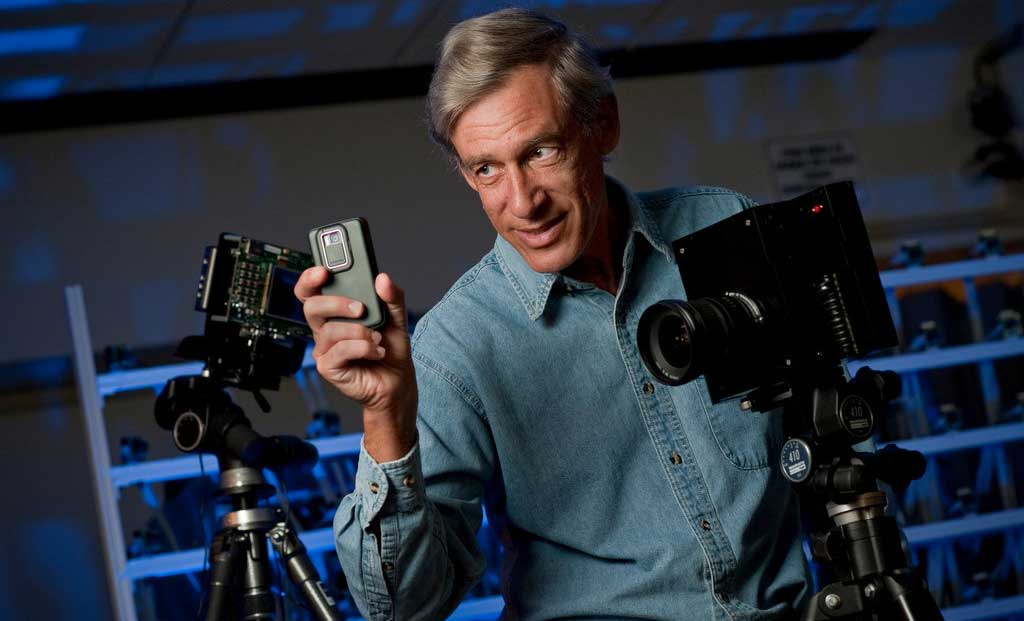

Bien que le lancement du projet Indigo soit attribué à Adobe, une entreprise qui travaille dans le domaine de l'imagerie depuis longtemps, il y a un nom qui mérite d'être noté dans l'équipe Nextcam qui a lancé Indigo – Marc Levoy.

Si vous avez vécu l'époque où l'imagerie Android domestique n'était pas encore lancée et où Google Camera était populaire, vous n'êtes peut-être pas familier avec le nom de Marc Levoy – le premier Pixel et Google Camera, célèbre pour ses algorithmes, sont tous deux des chefs-d'œuvre dirigés par lui.

▲Marc Levoy

La philosophie de Levoy est ancrée dans son parcours académique, un monde très différent de la photographie optique traditionnelle : l’infographie.

Dès ses études doctorales, la technologie de rendu volumique dont il a été le pionnier a posé les bases de la logique fondamentale de ses travaux ultérieurs : par le calcul, une série de tranches de données 2D (telles que des scanners) étaient reconstruites en un tout tridimensionnel. Ce fut le prototype de la logique fondamentale de la synthèse multi-images et de la reconstruction d'images qu'il a ensuite pratiquée en photographie mobile.

Alors qu'il enseignait à l'Université de Stanford, Levoy a construit une base théorique solide pour la photographie informatique – l'article « Light Field Rendering » qu'il a co-écrit avec ses collègues préconisait que les appareils photo enregistrent non seulement l'intensité de la lumière mais aussi sa direction, permettant des opérations révolutionnaires telles que la mise au point après la prise de vue.

Cela vous semble familier ? La caméra Lytro, désormais obsolète, est une fidèle adepte de cette voie.

En 2004, Levoy a redéfini et popularisé le terme « photographie computationnelle » dans un cours de Stanford, interprétant la connotation plus large du mot sous un autre angle :

La photographie computationnelle est une technique qui vise à améliorer ou à étendre les capacités de la photographie numérique, en produisant une photo ordinaire impossible à prendre avec un appareil photo traditionnel.

Dix ans plus tard, Levoy rejoint officiellement Google et dirige l'équipe vers la photographie mobile. Ses premières idées se concrétisent : un groupe d'images à exposition extrêmement courte est obtenu grâce à une prise de vue continue à grande vitesse, puis des algorithmes sont utilisés pour aligner, fusionner et réduire le bruit. Au final, une photo d'une qualité pure et d'une large plage dynamique, bien supérieure à celle d'une image isolée, est calculée.

Une théorie exigeant d'énormes calculs et quelque peu idéaliste a, après avoir été résumée et affinée, été mise en œuvre avec une puissance de calcul accessible à des équipements ordinaires, et est finalement tombée entre les mains de centaines de millions d'utilisateurs. Le cri d'il y a dix ans a enfin trouvé un écho.

▲ Marc Levoy tenant un Pixel 3

Les protagonistes sont ensuite le célèbre Pixel et ses fonctionnalités emblématiques. Tout d'abord, le HDR+, qui révolutionne les performances d'imagerie des téléphones portables dans des conditions d'éclairage complexes. Grâce à la technologie de synthèse multi-images, il préserve les détails des hautes lumières tout en restituant clairement les zones sombres.

Vient ensuite le mode portrait, qui utilise un algorithme pour obtenir un effet de flou d'arrière-plan comparable à celui d'un reflex sur un seul appareil. C'est l'incarnation parfaite de son concept de réduction de la dimensionnalité ; le mode scène nocturne pousse cette idée à l'extrême. Il peut combiner jusqu'à 15 images, chacune avec une exposition maximale de 16 secondes, pour créer une photo de nuit lumineuse et nette. Son effet était alors inégalé dans le domaine de l'imagerie mobile.

Ces fonctionnalités, basées sur la technologie de synthèse multi-images, ont non seulement permis au Pixel à appareil photo unique de surpasser les téléphones à double appareil photo tels que l'iPhone et le Samsung, remportant de nombreuses distinctions telles que le meilleur téléphone avec appareil photo de l'année, mais ont également fait du terme photographie informatique une formule gagnante pour l'imagerie mobile.

Bien des années plus tard, lorsque Levoy, qui avait déjà rejoint Adobe, fut interrogé sur la relation entre la photographie numérique et la création artistique, sa philosophie fut claire et résolue :

La « photographie directe » n'existe pas. La plage dynamique de la lumière dans le monde réel dépasse largement les limites de ce que peut enregistrer un capteur. L'œil humain est lui-même un moteur de photosensibilité adaptative. Les scènes que nous voyons ont été traitées subjectivement par le cerveau ; tout système d'imagerie numérique doit donc ajuster les couleurs et les tons enregistrés, et ces ajustements sont inévitablement subjectifs.

Levoy n'est pas timide à propos du produit, et est même étonnamment honnête, affirmant que depuis plusieurs années, les images Pixel sont construites selon sa philosophie et son esthétique :

J'adore les peintures du Caravage, donc le style d'imagerie du Pixel 2 au Pixel 4 a tendance à être sombre et à contraste élevé.

▲ L'œuvre « Le Dîner à Emmaüs » du Caravage

Cette philosophie a marqué toute la carrière de Levoy, jusqu'à son départ de Google pour Adobe. On retrouve encore ce style sombre sur le Projet Indigo, radicalement différent de la stratégie d'imagerie de l'appareil photo original de l'iPhone, qui privilégie les tons moyens et les hautes lumières.

Bien sûr, il s'agit d'une préférence esthétique, d'une part, et d'autre part, des exigences de l'algorithme, d'autre part. La solution actuelle du Projet Indigo consiste à prendre plusieurs photos légèrement sous-exposées afin de conserver les détails et les couleurs des hautes lumières, puis à réduire le bruit noir grâce à la synthèse multi-images. Les photos synthétisées selon cette logique ont tendance à être plus sombres.

À ce stade, les personnes intéressées peuvent déjà découvrir un Easter Egg à très long terme : tant esthétiquement que techniquement, Project Indigo peut être considéré comme la continuation spirituelle de Pixel. Le plus intéressant est que cette application exceptionnelle n'est actuellement disponible qu'en version iOS.

N’est-ce pas une sorte d’orthodoxie de Google chez Apple ?

Ne laissez pas les algorithmes s’approprier les photos

Le changement est la seule constante ; la bonne fortune ne dure jamais éternellement.

La photographie computationnelle, un terme qui représentait autrefois la technologie et le progrès à ses débuts, a connu une tendance à la baisse au cours de la période suivante.

Après le lancement du Pixel, Google Camera est devenu l'appareil photo natif du Pixel et a progressivement cessé d'exister en tant qu'application distincte. La difficulté d'adaptation s'est considérablement accrue. De plus, l'amélioration continue des téléphones portables nationaux a progressivement attiré l'attention et gagné en popularité, ce qui a également détourné l'attention de Google Camera.

![]()

▲ En commençant par la série Pixel 8 classique « yeux laser », Pixel Camera a commencé l'intégration du système

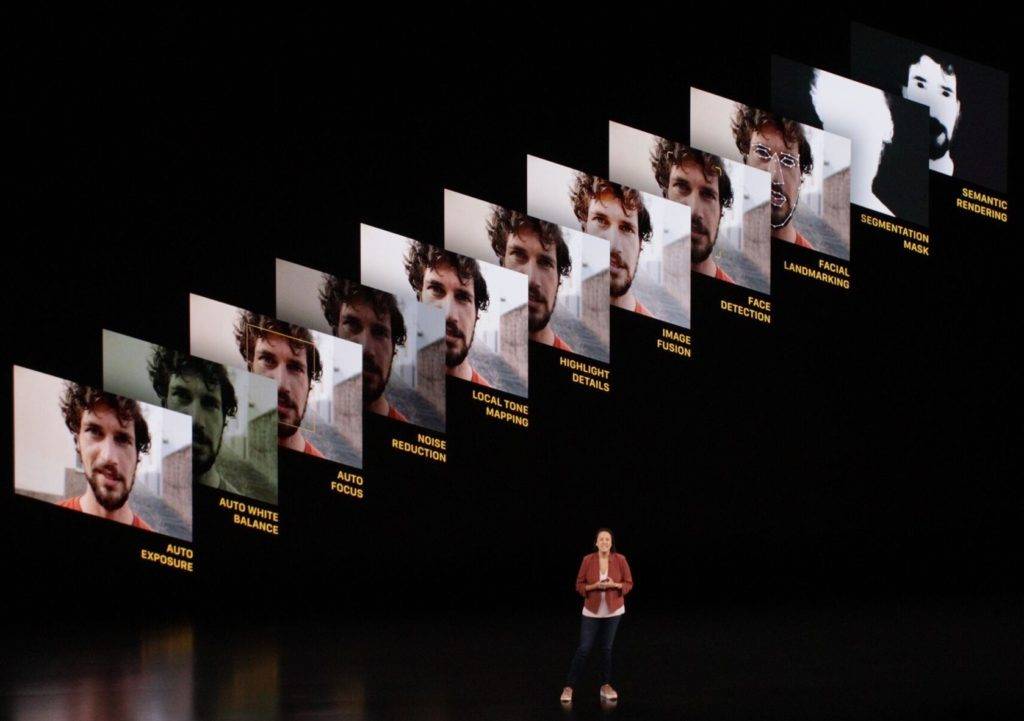

D'autre part, Apple, qui occupe la moitié de l'écosystème de la téléphonie mobile, a pleinement intégré la technologie Deep Fusion à la série iPhone 11. Elle utilise également la technologie d'empilement multi-images, mais elle a reçu des critiques mitigées.

Quant à l'iPhone sans Deep Fusion, bien que l'effet soit naturel, il souffre en termes de qualité d'image et a finalement été progressivement éliminé dans les mises à niveau ultérieures du processeur.

▲ Le Deep Fusion familier est ici

Depuis lors, le terme « photographie computationnelle » a commencé à être de plus en plus associé à des connotations négatives : les photos sont fortement tachées, trop nettes et présentent un fort sentiment de fragmentation. Ces adjectifs visuels inconfortables sont progressivement devenus des stéréotypes.

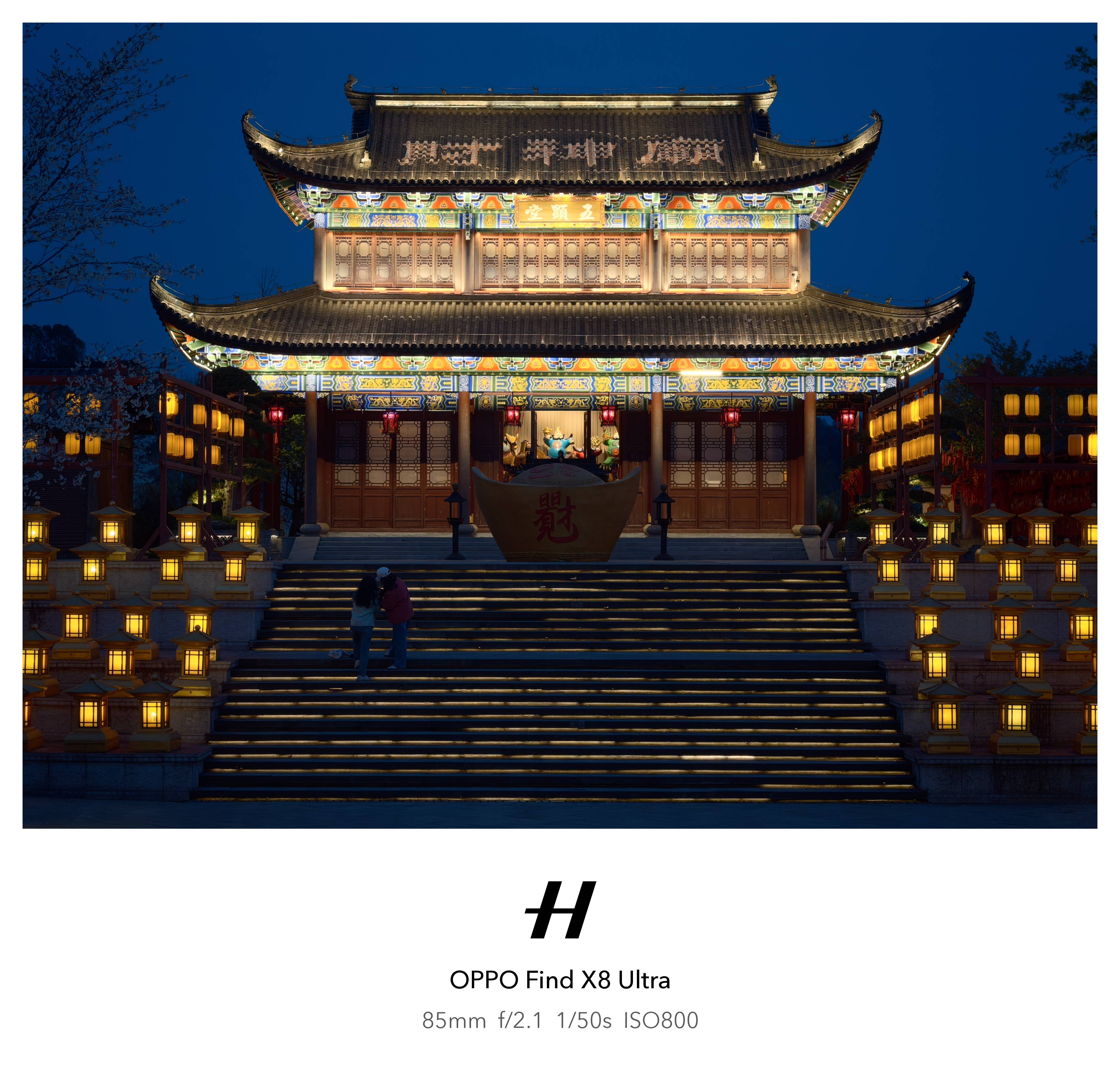

Les choses ont changé cette année. L'OPPO Find X8 Ultra propose un « Mode Maître » conçu pour les photographes. Son style d'image est plus sobre et plus doux que celui de la photographie numérique classique : il supprime efficacement la sensation de fragmentation causée par la netteté numérique, tout en offrant une courbe de luminosité plus naturelle.

Mais il est un peu regrettable que, tout en recherchant l'apparence et la douceur, la netteté du mode Master ne soit pas maintenue, la clarté des bords des objets diminue et la qualité de l'image manque de solidité.

L'approche du Projet Indigo est plus radicale. Il utilise un algorithme qui optimise les performances et synthétise des dizaines de photos en une seule fois, tout en éliminant complètement l'impact négatif des calculs sur le film final, ne laissant que le calcul en cours de traitement. Le résultat final est une photo à l'aspect naturel, avec une luminosité linéaire et une netteté digne d'un film.

On peut dire que c'est la meilleure application d'imagerie que j'ai vue jusqu'à présent qui sépare les algorithmes des produits finis.

En fin de compte, nos doutes sur la photographie numérique viennent en réalité de notre dégoût pour les « traces de traitement » évidentes sur les photos.

Oui, les algorithmes sont effectivement importants et ils travaillent très dur, mais ce que les gens veulent, c'est juste une bonne photo ordinaire, comme le disait Marc Levoy, qui ne nécessite aucun équipement professionnel mais qui ne peut produire des résultats inattendus que par le calcul.

Plutôt qu'un morceau de papier avec un algorithme écrit dessus revendiquant le mérite.

#Bienvenue pour suivre le compte public officiel WeChat d'iFanr : iFanr (ID WeChat : ifanr), où du contenu plus passionnant vous sera présenté dès que possible.