Tout à l’heure, Windows prend en charge le port C à l’ère de l’IA pour la première fois ! Microsoft fait appel à trois géants de l’IA pour redéfinir les systèmes d’exploitation

« Le premier agent XX au monde » devient presque une fonctionnalité standard des versions de produits d'IA, et vous pouvez le voir presque tous les jours lorsque vous ouvrez les yeux. Altman a mentionné dans un discours récent que 2025 serait une année décisive pour les agents IA.

Cette fièvre des agents a également envahi la conférence des développeurs Microsoft Build 2025 en cours.

Tout au long de la conférence de presse, le mot-clé le plus fréquemment revenu n’était pas IA, ni le protagoniste de l’année dernière, Copilot, mais Agent, Agent et Agent.

Mais pour Microsoft, cette conférence est clairement plus qu’un simple rassemblement de développeurs de routine.

Copilot évolue d'un produit unique vers un centre de capacités au niveau du système d'exploitation. De plus, le PDG de Microsoft, Satya Nadella, l'a clairement indiqué : « Aujourd'hui, nous avons franchi une nouvelle étape importante pour faire de Windows la meilleure plateforme pour l'IA. »

Microsoft ajoute un « port USB-C pour les applications d'IA » à Windows

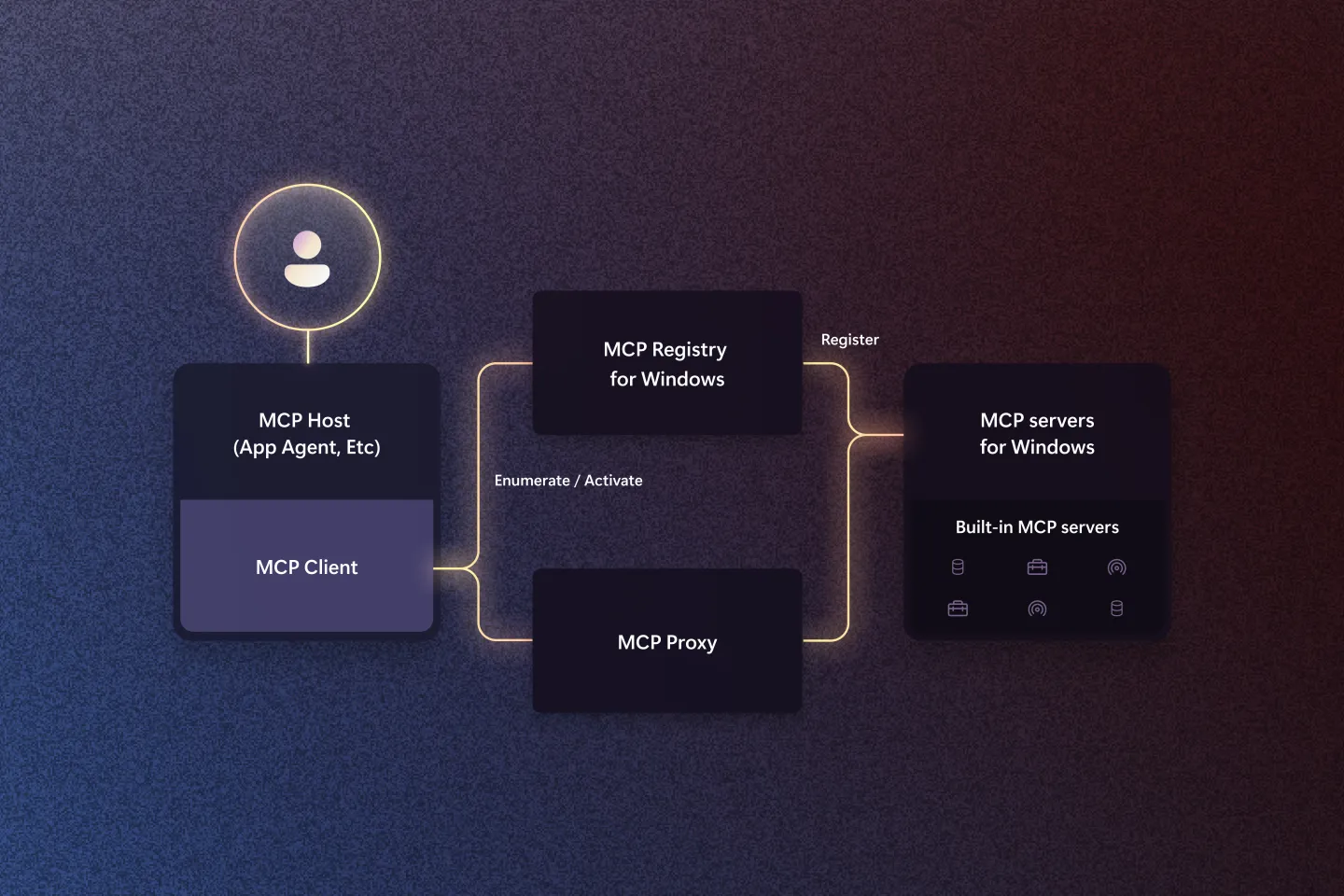

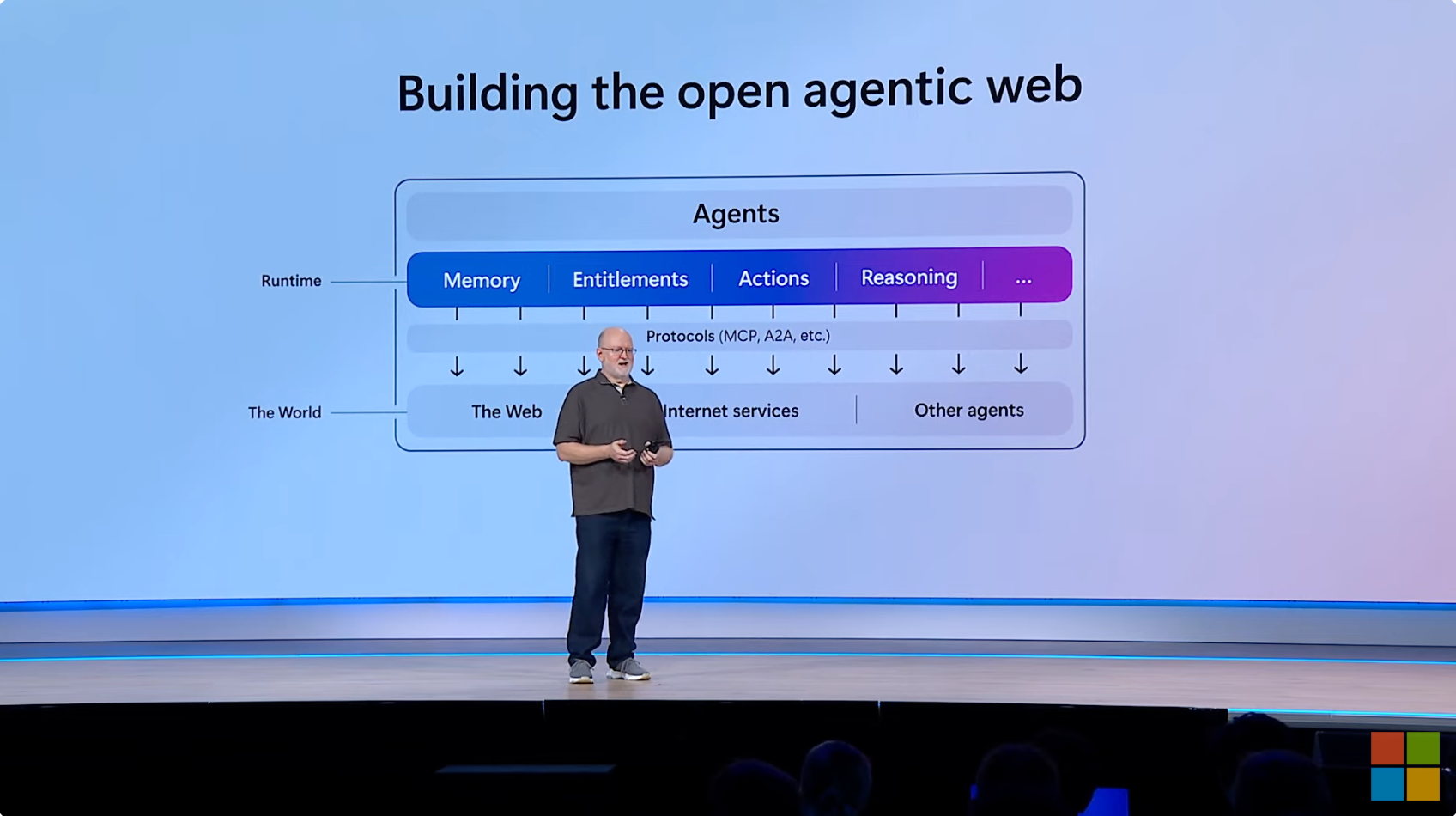

Lors de cette conférence, Microsoft a lancé plusieurs mises à jour clés, parmi lesquelles MCP a attiré beaucoup d'attention.

Le MCP, ou « Model Context Protocol », a été initialement lancé en open source par la société d’IA Anthropic l’année dernière.

Vous pouvez simplement le comprendre comme un « port USB-C pour les applications d'IA ». Tout comme l’USB-C unifie les connexions physiques de différents appareils, le MCP peut unifier les « connexions numériques » pour que les modèles d’IA obtiennent des informations et utilisent des outils.

Cela permettra à diverses applications d'IA ou agents intelligents d'accéder plus facilement à l'écosystème Windows, faisant ainsi appel aux ressources système, accédant aux fichiers et communiquant efficacement.

Désormais, Windows 11 prend en charge nativement le protocole de contexte de modèle (MCP).

L'intégration de MCP et de Windows fournira un cadre standardisé permettant aux agents d'IA de se connecter aux applications Windows natives, permettant aux applications de participer de manière transparente aux interactions des agents. Cette fonctionnalité sera disponible pour certains partenaires dans les mois à venir afin de recueillir des commentaires.

▲Architecture MCP sous Windows

Il est rapporté qu'afin d'accélérer la construction de l'écosystème, Microsoft a coopéré avec des développeurs tels que OpenAI, Anthropic, Perplexity, Figma, etc. pour intégrer progressivement les capacités MCP dans davantage d'applications.

Par le passé, permettre à un modèle d’IA d’accéder au système de fichiers Windows ou de contrôler les paramètres du système nécessitait beaucoup de développement personnalisé ; après l'introduction de MCP, les développeurs peuvent encapsuler ces fonctionnalités sous forme de « points de terminaison de service » (serveurs MCP) et permettre aux agents de les découvrir et de les appeler via le registre Windows MCP.

Microsoft a souligné que cela permettra non seulement aux agents d'IA de « voir » plus de ressources dans le système d'exploitation, mais leur ouvrira également de nouvelles possibilités de collaboration avec les applications.

Par exemple, le moteur de recherche IA Perplexity peut localiser et appeler automatiquement les documents pertinents dans le système de fichiers Windows via MCP sans que l'utilisateur ait à sélectionner manuellement le répertoire.

Il suffit à l'utilisateur de faire une demande en langage naturel, telle que « Rechercher tous les fichiers liés à mes vacances », et l'IA peut effectuer automatiquement la recherche. À l’avenir, des opérations telles que l’appel de données réseau dans Excel et la localisation et la définition de paramètres dans le système pourront toutes être effectuées automatiquement par l’IA.

« Nous voulons que Windows évolue en tant que plate-forme et permette à terme aux agents d'être intégrés dans le fonctionnement quotidien du système d'exploitation et de devenir un moyen important pour les utilisateurs d'interagir en permanence avec les applications et les appareils », a déclaré Pavan Davuluri, responsable de Windows, dans une interview avec The Verge.

GitHub Copilot bénéficie d'une mise à niveau majeure pour corriger automatiquement les bugs et optimiser le code

En plus des mises à jour au niveau de Windows, Microsoft augmente également ses investissements dans « l'agentisation » dans le domaine du développement de logiciels.

La nouvelle version de GitHub Copilot aidera les développeurs à effectuer des tâches quotidiennes telles que la refactorisation du code, l'amélioration de la couverture des tests, la correction des vulnérabilités et même la mise en œuvre de nouvelles fonctionnalités. Actuellement, cette fonctionnalité est disponible en version préliminaire.

Les développeurs qui étaient réveillés tard dans la nuit par des appels d'exploitation ont désormais la possibilité de passer une bonne nuit de sommeil.

GitHub Copilot détecte désormais automatiquement les fuites de mémoire la nuit, génère un rapport de diagnostic et envoie des correctifs à Copilot. Finalement, Copilot terminera les correctifs de code et soumettra le PR, vous permettant de dormir sur vos deux oreilles.

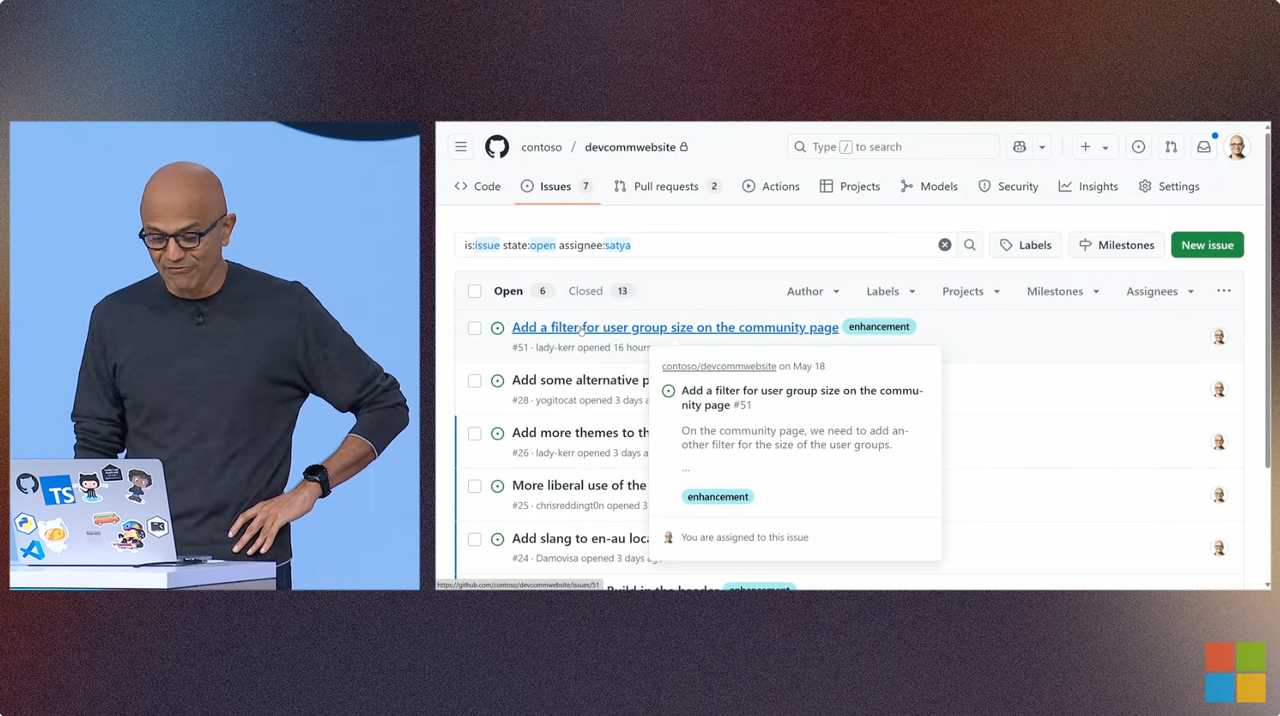

Afin de souligner que l’IA peut réellement fonctionner, Nadella l’a également démontré sur place.

Par exemple, lorsque vous souhaitez utiliser Copilot pour ajouter des filtres à une page de communauté, non seulement il comprend les instructions avec précision, mais il fait également de manière proactive des suggestions d'optimisation, telles que l'ajout d'éléments de filtre petits, moyens et grands, ou le regroupement et la catégorisation par catégorie.

Nadella n'a plus qu'à confier la tâche à Copilot, qui prend automatiquement le relais, génère une demande d'extraction et développe enfin avec succès la fonctionnalité.

Pour les systèmes d'application de niveau entreprise qui ont traditionnellement des coûts de maintenance élevés et des cycles de mise à niveau longs, en particulier ceux basés sur les architectures Java et .NET, Microsoft fournit également des kits d'outils de modernisation correspondants.

Les développeurs peuvent utiliser AI Agent pour générer automatiquement des plans de mise à niveau, analyser les dépendances et exécuter des processus de migration, réduisant ainsi considérablement le temps nécessaire pour effectuer une tâche qui prendrait normalement des semaines, voire des mois, à quelques heures seulement.

Bien qu'il y ait eu des spéculations selon lesquelles Microsoft et OpenAI s'éloignaient, Nadella a quand même eu une conversation vidéo à distance avec le PDG d'OpenAI, Sam Altman.

Les deux hommes ont discuté de la manière dont les outils d’IA modifient l’ingénierie logicielle. Altman a rappelé qu'OpenAI explore des expériences de codage intelligentes depuis le lancement de Codex en 2021.

Aujourd’hui, les agents IA sont devenus des « membres virtuels » des équipes de développement, capables de travailler de manière indépendante et d’effectuer des tâches par lots. « Vous pouvez même lui attribuer directement des correctifs de bugs, et il vous enverra une PR (pull request) en quelques minutes. »

En parlant du développement futur du modèle, Altman a déclaré que la prochaine étape du modèle sera plus fiable, plus automatisée et plus facile à utiliser. Les développeurs n'auront plus besoin de sélectionner manuellement les modèles, mais parviendront à une véritable « prise de décision automatique + plug and play ».

Nadella a souligné que le plus grand défi actuel est la vitesse du changement technologique. Les développeurs qui sauront s’engager en profondeur dans les nouvelles technologies dès le début bénéficieront d’énormes avantages.

Le nouveau service de Microsoft permet à chaque entreprise de créer son propre Copilot

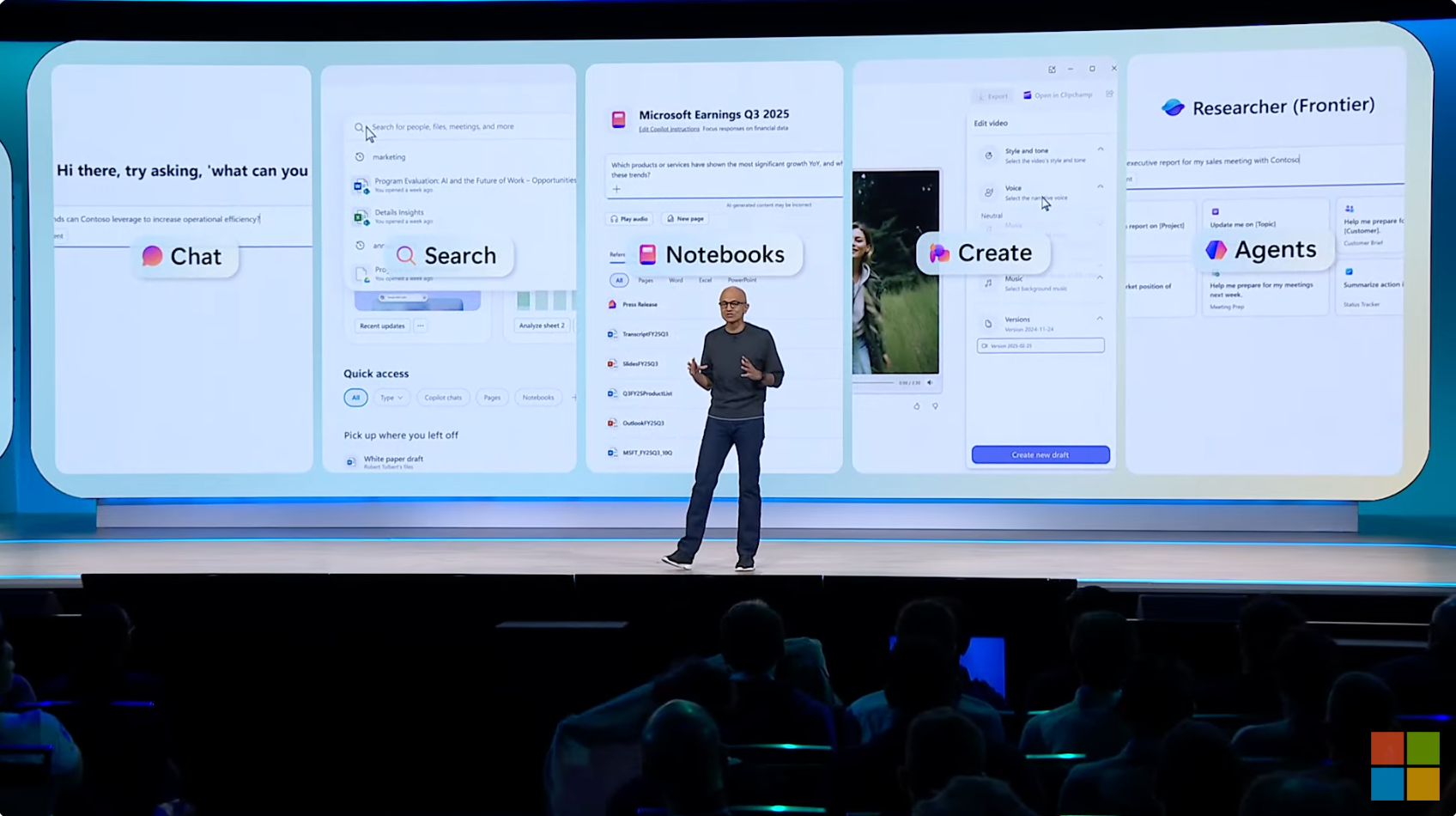

Lors de la conférence, Microsoft a également présenté les cinq principales entrées fonctionnelles de Copilot : Chat, Recherche, Agent, Notebooks et Create.

Lorsque vous soumettez vos exigences à Copilot, il vous montrera le processus de réflexion, c'est-à-dire le processus de raisonnement de la longue chaîne de réflexion CoT.

Dans la démonstration en direct, Copilot Studio peut appeler des modèles tels que GPT-4 ou des serveurs tiers tels que Docusign, pour traiter automatiquement les éléments à effectuer dans le flux de travail.

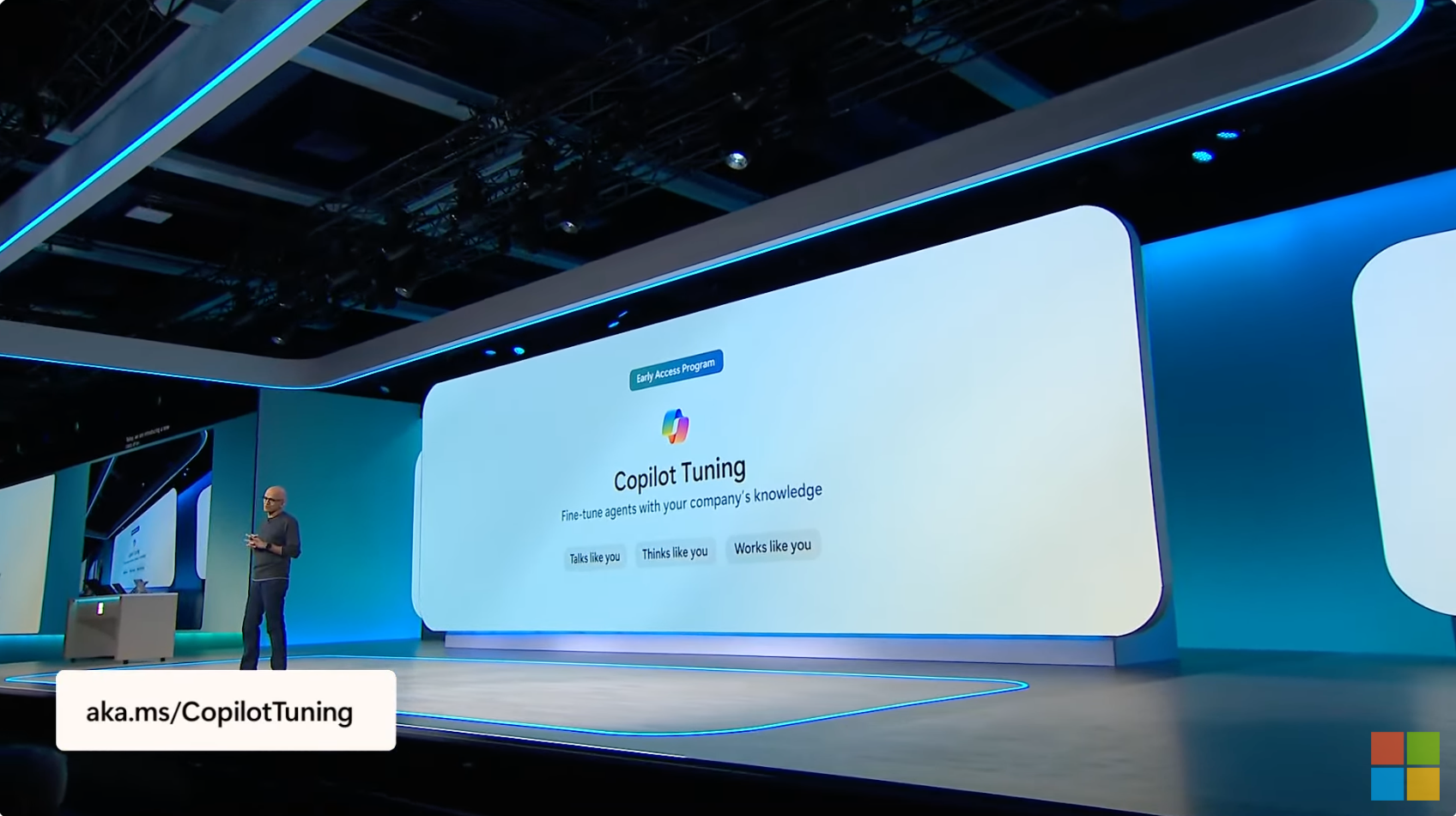

Pour les utilisateurs d'entreprise, Microsoft a lancé le service « Copilot Tuning ».

Avec Microsoft 365 Copilot Tuning, les clients d’entreprise peuvent utiliser leurs propres données pour affiner les modèles et créer des assistants IA qui répondent mieux aux besoins internes. De plus, pour garantir la sécurité des données, ces modèles affinés ne sont accessibles qu’au sein de l’entreprise et les autorisations sous-jacentes sont contrôlées par le système.

Sur cette base, les développeurs peuvent utiliser l’outil Agent Builder de Microsoft 365 Copilot pour créer des agents exclusifs.

Par exemple, un cabinet d’avocats peut créer un assistant de documents juridiques pour générer des documents de conformité adaptés à son style d’entreprise et à sa terminologie professionnelle. Dans un autre exemple, une société de conseil impliquée dans des secteurs réglementés tels que l'aviation peut créer un agent de questions-réponses basé sur les documents réglementaires accumulés par l'entreprise pour fournir aux consultants des réponses réglementaires plus précises.

Enfin, Microsoft a également lancé une plateforme d'agrégation appelée « Agent Store ».

Comme son nom l'indique, cette nouvelle plateforme peut être comprise comme un « App Store » pour les agents, présentant divers agents intelligents créés par Microsoft, des partenaires et des clients. Vous pouvez explorer, tester et partager ces agents intelligents en un seul endroit, et distribuer les agents intelligents appropriés à vos collègues pour une utilisation commune, améliorant ainsi considérablement l'efficacité de la collaboration.

Agent Store est désormais officiellement lancé, vous pouvez donc l'essayer.

Huang Renxun, Musk et Ultraman sont tous apparus ensemble, et Microsoft a intégré la moitié du cercle de l'IA

La plateforme de développement d'IA unique au niveau de l'entreprise de Microsoft, Azure AI Foundry, a également lancé un certain nombre de mises à jour majeures.

La première chose qui attire l'attention des gens est que le modèle phare de xAI, Grok 3, a atterri sur Azure AI Foundry, offrant un support solide aux services d'entreprise de Microsoft en matière de prévisions financières, d'assistance au diagnostic médical, d'analyse de documents juridiques et d'assistance à la recherche scientifique.

À partir d’aujourd’hui, Grok 3 est disponible en essai gratuit dans Azure AI Foundry pendant deux semaines. À partir de juin, le prix sera de 15 $ par million de jetons pour la production mondiale et de 16,5 $ par million de jetons pour la production au sein de la zone de données.

De plus, de la même manière que l’utilisation des modèles OpenAI et Hugging Face sur Azure AI Foundry, Grok 3 prendra également en charge le PTU (débit provisionné), une méthode de déploiement plus rentable.

Avant la conférence Build, le fondateur et PDG de xAI, Musk, a accepté une interview à distance avec Nadella, dans laquelle il a révélé que le cœur de la recherche et du développement du prochain modèle Grok 3.5 est étroitement lié aux premiers principes.

Il a partagé : « La clé est de trouver les connaissances de base de la physique, d’appliquer les outils de la physique dans le processus de raisonnement et de rechercher la vérité avec le minimum de coûts d’erreur. »

Nadella a également donné un exemple : tout comme dans la vie réelle, les voitures doivent toujours rouler en toute sécurité et correctement, de même, les robots doivent également effectuer des tâches assignées par les humains, qui obéissent toutes aux lois de la physique dans le monde.

Lorsqu'il a parlé des problèmes de sécurité de l'IA, Musk a résumé ses pensées en une phrase : « L'honnêteté est la meilleure politique. »

Actuellement, plus de 1 900 modèles d’IA ont été intégrés dans Azure AI Foundry, notamment divers modèles de réponse, modèles de raisonnement, modèles de tâches spécifiques, modèles multimodaux, etc., qui peuvent être utilisés librement par les développeurs.

Outre les célèbres OpenAI et xAI, les sociétés membres de Foundry Models incluent désormais également Mistral AI, Meta, Black Forest Labs et l'acteur vedette chinois DeepSeek.

Peut-être cela confirme-t-il aussi indirectement que les rumeurs précédentes n’étaient pas sans fondement. Selon les médias étrangers, Microsoft teste des modèles d'IA d'entreprises telles qu'Anthropic, DeepSeek, Meta et xAI pour examiner leurs performances dans la prise en charge de Copilot.

Il convient de mentionner que parmi les trois invités de poids de cette conférence Build, le dernier à apparaître était Huang de Nvidia, qui venait de terminer son discours lors de sa propre exposition Computex.

Lors d'une conversation avec le PDG de Microsoft, Satya Nadella, Huang a avancé un chiffre étonnant : la technologie progressera 40 fois tous les deux ans. Cela signifie également que pour suivre le rythme de l’évolution de l’IA, il ne suffit plus de mettre à jour le matériel toutes les quelques années. Il est nécessaire de faire des « mises à jour mineures chaque année » pour suivre le rythme.

Selon Nadella, l’investissement à long terme de Nvidia dans l’écosystème CUDA et son insistance sur la compatibilité architecturale permettent aux efforts des développeurs d’être réutilisés à travers les générations. Même les produits datant de quelques années peuvent bénéficier des derniers algorithmes logiciels.

Huang a également ajouté : De Hopper à Blackwell, NVIDIA a une fois de plus réalisé un bond de performance de 40 fois, qui est indissociable de la mise à niveau des algorithmes, comme l'optimisation de l'architecture Transformer et l'itération du décodage prédictif.

Ce qui soutient tout cela est un écosystème CUDA énorme et en constante expansion. Chaque optimisation et amélioration que les développeurs mondiaux investissent dans cet écosystème se propagera comme des ondes, affectant des milliers d’utilisateurs et d’entreprises.

L’avenir de Windows appartient aux humains, mais aussi aux agents

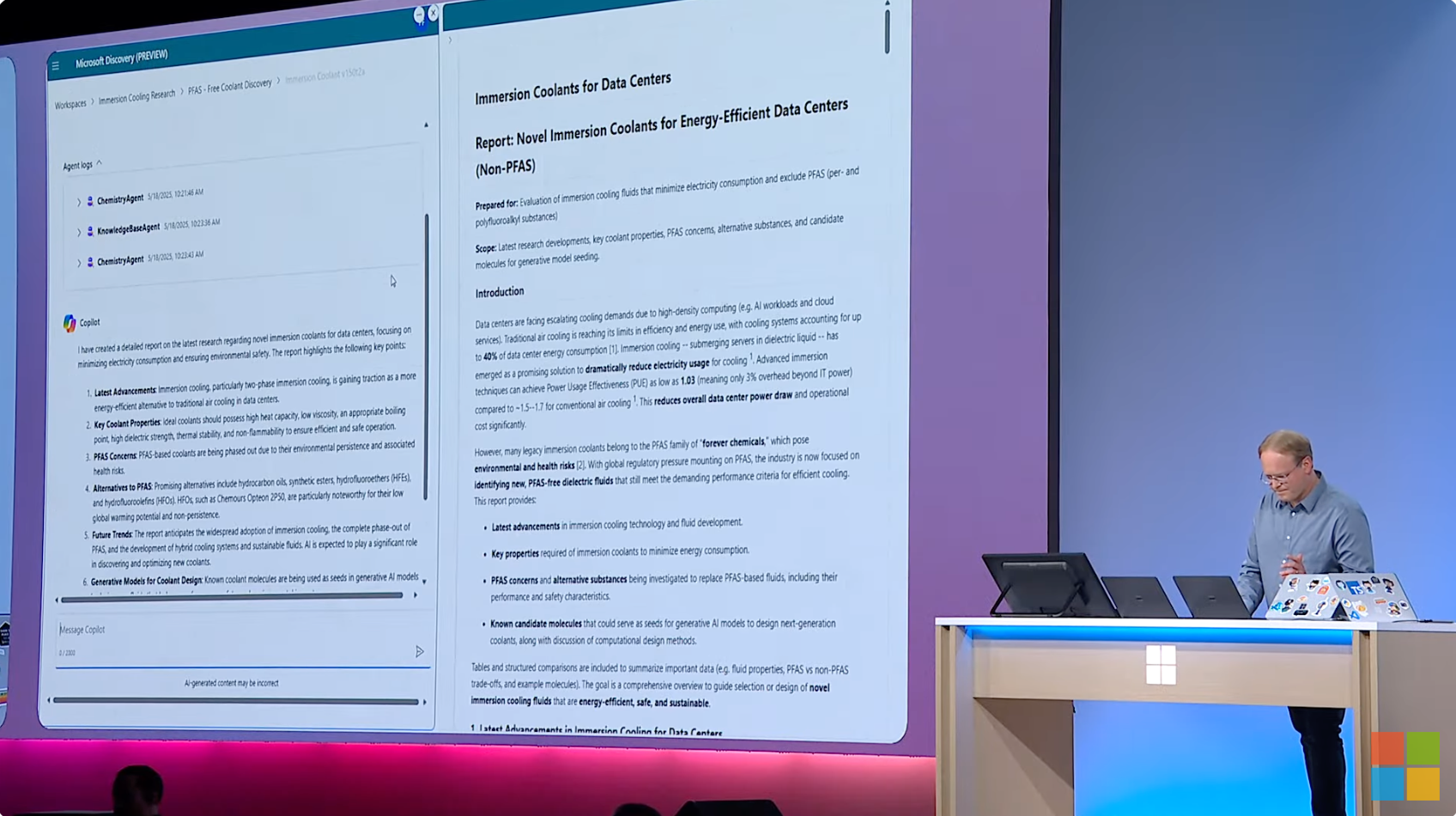

Le simple fait de parler de l'intégration profonde de l'agent IA dans chaque maillon du flux de travail peut sembler un peu abstrait, alors pourquoi ne pas jeter un œil à une démonstration en direct de John Link, directeur principal de l'innovation produit chez Microsoft.

Maintenant, votre assistant de laboratoire, agent scientifique, est assis à côté de vous, tenant un ordinateur. Vous devez réaliser un projet qui comprend trois étapes principales : le raisonnement intellectuel, la génération d’hypothèses et la réalisation d’expériences.

Dans la première partie du raisonnement de connaissance, l'agent scientifique appelle d'abord le « ChemistryAgent » puis le « Knowledge BaseAgent » pour vous aider à récupérer, filtrer et intégrer les informations nécessaires au projet à partir de la quantité massive d'informations. Enfin, l'agent Science présente les résultats du travail sous forme de résumé à gauche et de rapport complet à droite, et fournit les liens cités par l'agent au cours du travail.

Dans la deuxième partie de la génération d'hypothèses, l'agent scientifique attribue la tâche à l'agent chimique, qui traite les hypothèses que vous avez proposées et met à jour vos nouvelles idées et exigences en temps réel. Ensuite, GenChemAgent a généré un plan de conception expérimentale basé sur des hypothèses.

À l’étape suivante, vous pouvez utiliser les données et le plan pour vérifier les résultats expérimentaux.

Si l'agent doit véritablement réaliser le « dernier kilomètre » des actions au nom des humains – acheter des billets, réserver des hôtels, faire des expériences, etc., le directeur technique Kevin Scott a déclaré qu'une sorte de protocole est nécessaire pour fournir des contraintes et un support, d'où le support Microsoft MCP mentionné ci-dessus.

Scott a plus de plans en tête pour la forme finale de l'Agent.

Scott pense que ce que les gens veulent vraiment, c’est un agent doté de ressources de mémoire riches, capable de retracer et de localiser des fragments de mémoire avec une grande précision.

Dans le même temps, à l’avenir, Agent ne sera pas seulement un réseau « Agentic » ouvert, mais aussi une application d’IA.

Kevin Scott a mentionné qu'avec l'avancement de la technologie de l'IA, les agents seront en mesure d'effectuer des tâches plus complexes, d'interagir avec divers services et contenus via des protocoles ouverts et d'entreprendre un travail collaboratif multitâche et multiplateforme.

Il a expliqué : « J'espère que grâce à un protocole ouvert, tous les agents pourront atteindre une véritable interopérabilité, afin que toute personne disposant de services ou de contenus puisse accéder à l'agent d'une manière ou d'une autre et dire : « Hey, je suis là. » Et quel que soit le concepteur de l'agent, il pourra se connecter à ces contenus et services.

Afin de soutenir le fonctionnement de tels agents, une plate-forme système flexible, puissante et facile à intégrer est essentielle.

Autrement dit, le signal envoyé par cette conférence Build est suffisamment clair : à l’avenir, Windows ne sera plus seulement un système d’exploitation pour les humains, mais deviendra également une plateforme conçue spécifiquement pour les agents IA.

Auteurs : Li Chaofan, Xu Yu, Mo Chongyu

#Bienvenue pour suivre le compte public officiel WeChat d'iFanr : iFanr (ID WeChat : ifanr), où du contenu plus passionnant vous sera présenté dès que possible.